创建一个包含用于定义逻辑回归的Python代码的JupyterNotebook,然后使用TensorFlow(tf.keras)实现它在本教程中,了解如何创建包含用于定义逻辑回归的Python代码的JupyterNotebook,然后使用TensorFlow(tf.keras)实现它。Notebook在IBMCloudPak®forDataasaServiceonIBMCloud®上运行。IBMCloudPakforData平台提供了额外的支持,例如与多个数据源的集成、内置分析、JupyterNotebook和机器学习。它还通过跨多个计算资源分配进程来提供可扩展性。您可以选择在Python、S

目录初识逻辑回归逻辑回归实操分类评估方法初识逻辑回归逻辑回归(LogisticRegression)是机器学习中的一种分类模型,逻辑回归是一种分类算法,虽然名字中带有回归,但是它与回归之间有一定的联系。由于算法的简单和高效,在实际中应用非常广泛。逻辑回归就是解决二分类问题的利器,以下是逻辑回归的应用场景:1)广告点击率2)是否为垃圾邮件3)是否患病 4)金融诈骗5)虚假账号逻辑回归原理:逻辑回归是一种常用于解决二分类问题的统计学习方法。它的原理基于以下几个关键概念:假设函数:逻辑回归的输入值就是一个线性回归的结果:Sigmoid函数:sigmoid函数是一种常用的激活函数,它将任意实数映射到(

导言在机器学习领域,线性回归是最基础且重要的算法之一。它用于建立输入特征与输出目标之间的线性关系模型,为我们解决回归问题提供了有效的工具。本文将详细介绍线性回归的原理、应用和实现方法,帮助读者快速了解和上手这一强大的机器学习算法。一、线性回归简介线性回归是一种监督学习算法,适用于处理连续数值预测问题。其基本思想是通过拟合最佳直线(或超平面)来预测输出变量与输入特征之间的关系。线性回归的目标是找到最优的模型参数,使得模型对训练数据的预测值与真实值之间的误差最小化。二、线性回归原理假设函数线性回归假设输入特征与输出目标之间存在线性关系,即数学上的假设函数为:y=w0+w1x1+w2x2+...+w

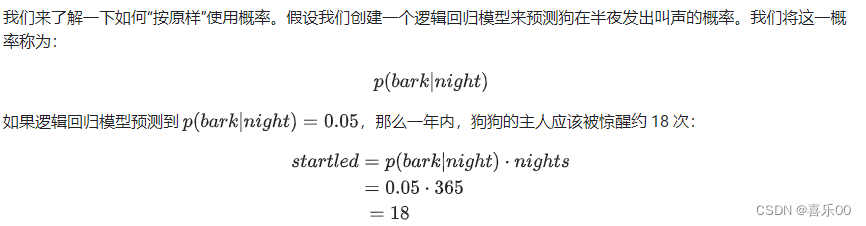

重点:1.逻辑回归模型会生成概率。2.对数损失是逻辑回归的损失函数。3.逻辑回归被许多从业者广泛使用。#1.逻辑回归:计算概率**许多问题需要将概率估算值作为输出。逻辑回归是一种非常高的概率计算机制。**实际上,您可以通过以下两种方式之一使用返回的概率:*原样*已转换为二元类别。在许多情况下,您需要将逻辑回归输出映射到二元分类问题,其中目标是正确预测两个可能的标签之一(例如,“垃圾邮件”或“不是垃圾邮件”)。后续模块会重点介绍

线性回归1.概述回归是一种应用广泛的预测建模技术,这种技术的核心在于预测的结果是连续型变量。决策树,随机森林,支持向量机的分类器等分类算法的预测标签是分类变量,多以{0,1}来表示,而无监督学习算法比如PCA,KMeans的目标根本不是求解出标签,注意加以区别。回归算法源于统计学理论,它可能是机器学习算法中产生最早的算法之一,其在现实中的应用非常广泛,包括使用其他经济指标预测股票市场指数,根据喷射流的特征预测区域内的降水量,根据公司的广告花费预测总销售额,或者根据有机物质中残留的碳-14的量来估计化石的年龄等等,只要一切基于特征预测连续型变量的需求,都使用回归技术。既然线性回归是源于统计分析,

机器学习第五课逻辑回归概述逻辑回归应用领域逻辑回归vs线性回归基本定义输出类型函数关系误差计算使用场景数据分布逻辑回归的数学原理Sigmoid函数多数几率似然函数逻辑回归损失函数正则化L1正则化L2正则化L1vsL2实例标准化为什么要标准化?如何进行标准化?梯度下降工作原理梯度下降的公式梯度下降的变种学习率前向传播vs反向传播前向传播反向传播手把手计算回归前向传播反向传播参数更新实战逻辑回归预测乳腺癌逻辑回归鸢尾花手搓逻辑回归概述逻辑回归(LogisticRegression)尽管名字中带有“回归”两个字,但主要是用来解决分类问题,尤其是二分类问题.逻辑回归的核心思想是:通过将线性回归的输出传

为了避免过多的测试,我想向质量保证(QA)团队提供提示,说明哪些功能必须在开发迭代后进行回归测试。您知道可以在C++和Subversion(以及VisualStudio)开发环境中执行此操作的工具吗?有关用例的详细信息:特征将由开发团队在入门方面点,通常是类(class)或类(class)方法。比如说,功能“excel文件import"由方法定义类的ImportExcelFile(...)文件导入器。在开发迭代期间,开发团队promise了一些一些方法的改变类。比如说,这些类(class)之一被方法间接使用导入Excel文件()在迭代结束时,所有提交由该工具分析,并且生成并交付报告给质

我们正处于portingourcodebase的过程中转到Eigen3.3(所有32字节对齐问题都是一项艰巨的任务)。然而,有几个地方的性能似乎受到了严重影响,这与预期相反(鉴于对FMA和AVX的额外支持,我期待一些加速......)。这些包括特征值分解和matrix*matrix.transpose()*vector产品。我已经编写了两个最小的工作示例来进行演示。所有测试都在最新的ArchLinux系统上运行,使用IntelCorei7-4930KCPU(3.40GHz),并使用g++版本6.2.1编译。1。特征值分解:使用Eigen3.3.0进行简单的自伴随特征值分解所需的时间是使

给定一组具有N个独立值和1个相关值的(N+1)维实值vector,我想计算一个1(线性)、2(二次)或更高阶的多项式,它提供了一个相当好的适合(例如,由最小二乘误差确定)。换句话说,当应用于集合的元素时,多项式应该将每个元素的独立值映射到关联的相关值(具有一些合理的误差范围)。我希望自变量的维度在2..8范围内,并且适用于20..200个元素的集合。我希望以毫秒而不是秒来拟合多项式。:-)我很快找到了一维数据的多项式回归算法,但我还没有想出任何适用于多维数据的算法。我主要对算法描述或源代码感兴趣。有什么指点吗? 最佳答案 您可能想探

一、分类问题 在接下来的内容中将开始介绍分类问题,在分类问题中,我们要预测的变量y是离散的值,我们将学习一种叫做逻辑回归(LogisticRegression)的算法,这是目前使用最广泛的一种学习算法。分类问题的例子有:判断一封电子邮件是否是垃圾邮件、判断肿瘤是恶性的还是良性的等等。 简单起见,我们从二元的分类问题开始讨论。我们将因变量可能属于的两个类分别称为负向类和正向类,则因变量,其中0表示负向类,1表示正向类,但如果你使用的是线性回归算法,那么假设函数的输出值可能远大于1,或者远小于0,即使所有训练样本的标签y都等于0或1,尽管我们知道标签应该取值0或者1,但是如果算