授权是指用户可以访问的资源,比如:授权用户张三不能访问ods层的表,可以访问dwd层和dws层的表。再比如java中基于角色的身份认证RBAC(Role-Based Access Control)基于角色的权限控制。通过角色关联用户,角色关联权限的方式间接赋予。比如大数据中使用的Sentry和Ranger的授权框架的权限管理。

认证主要是对用户的身份确认,比如最简单的用户的登录需要账户和密码;比如java的认证框架sa-token、Shiro、SpringSecurity等。

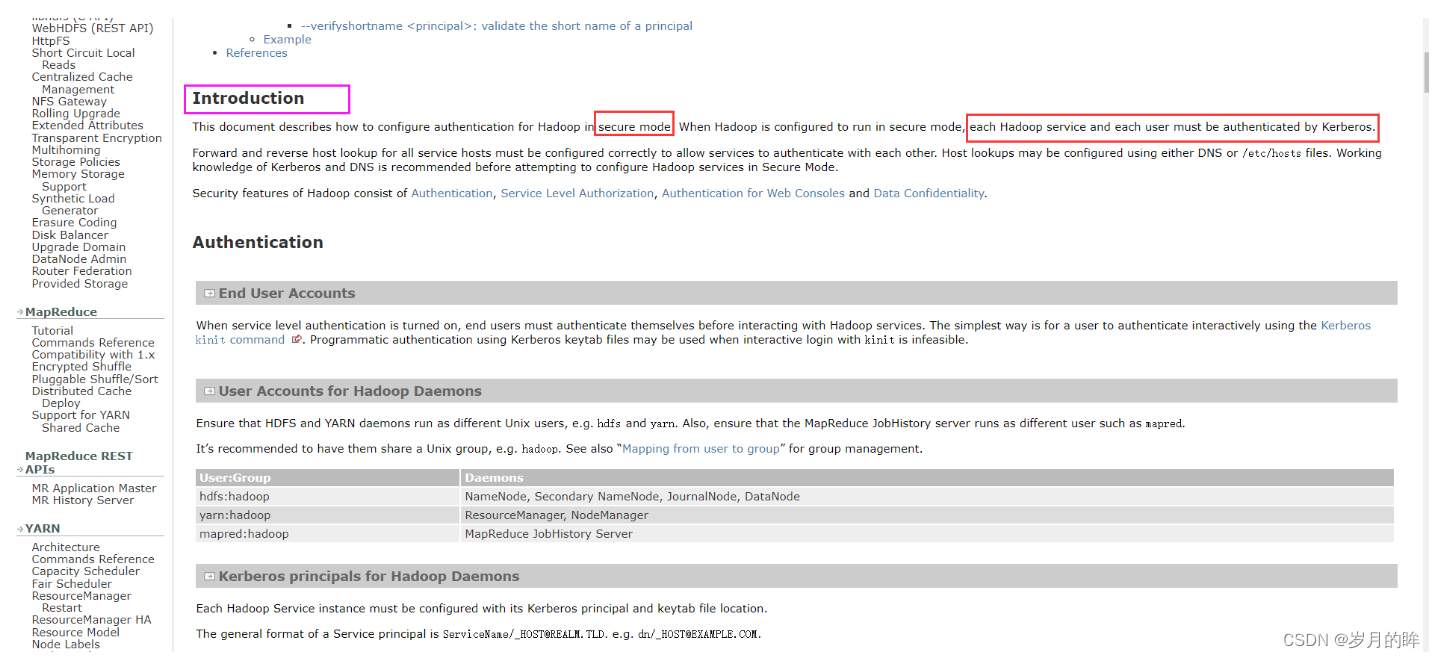

hadoop官网的认证主要是使用麻省理工MIT的kerberos认证的。

hadoop官网文档关于安全认证的相关介绍链接:https://hadoop.apache.org/docs/r3.2.2/hadoop-project-dist/hadoop-common/SecureMode.html

授权使用什么框架呢?目前授权,一般使用Sentry和Ranger来进行授权管理。比如目前比较强大的Ranger授权框架,可以精确都某张表的字段的操作,比如:可以定义张三用户可以访问某表的那些字段,那些字段无法访问。

Kerberos 是一种计算机网络认证协议,用来在非安全网络中,对个人通信以安全的手段进行身份认证。这个词又指麻省理工学院为这个协议开发的一套计算机软件。软件设计上采用客户端/服务器结构,并且能够进行相互认证,即客户端和服务器端均可对对方进行身份认证。可以用于防止窃听、防止重放攻击、保护数据完整性等场合,是一种应用对称密钥体制进行密钥管理的系统。

对以上的专业术语进行解释:

Hadoop的认证使用的是Kerberos协议。

keytab:Kerberos 中的用户认证,可通过密码或者密钥文件证明身份,keytab 指密钥文件。

AS: Authentication Server认证服务器,首先用户进行身份认证,kinit命令进行认证,然后输入密码;此时认证服务器会根据用户输入的账号和密码到数据库Database中查询,看是否正确,如果正确颁发临时的票据,这个票据就是TGT,它是Ticket Granting Ticket的缩写,这个票据名称为:申请票据的票据。

用户拿到这个用来申请服务票据的票据后,然后携带该票据TGT去访问票据授权服务器,然后票据授权服务器TGS去数据库中查询服务是否为合法的服务;

查询到相关服务名和秘钥后,颁发票证给用户。

用户拿到这个TG票证后然后才能访问我们的服务,比如上图拿到票证访问hdfs服务。这就是kerberos的基本认证原理。

启动 KDC服务:

若未启动 执行启动命令:

启动 Kadmin,该服务为 KDC 数据库访问入口:

查看kadmin服务状态

在 KDC 所在主机(hadoop102),执行以下命令,并按照提示输入密码,若已经创建,无需重复重复创建。

1)本地登录(无需认证)

[root@warehouse ~]# kadmin.local

Authenticating as principal root/admin@EXAMPLE.COM with

password.

kadmin.local: (这里执行一些命令)

list_principals ==> 查看所有主体

addprinc test ==> 创建主体名称test

cpw test ==> 修改主体的密码

退出输入:exit

也可通过以下 shell 命令直接创建主体

[root@warehouse ~]# kadmin.local -q"addprinc test"

2)远程登录(需进行主体认证,认证操作见下文)

[root@warehouse ~]# kadmin —>按照提示输入密码

Authenticating as principal admin/admin@EXAMPLE.COM with

password.

Password for admin/admin@EXAMPLE.COM:

kadmin:

1)使用 kinit 进行主体认证,并按照提示输入密码

[root@warehouse ~]# kinit test

Password for test@EXAMPLE.COM:

2)查看认证凭证 klist

[root@warehouse keytab]# klist

Ticket cache: FILE:/tmp/krb5cc_0

Default principal: test@EXAMPLE.COM

Valid starting Expires Service principal

2022-08-08T00:43:12 2022-08-09T00:43:12 krbtgt/EXAMPLE.COM@EXAMPLE.COM

1)生成主体 test 的 keytab 文件到指定目录

[root@warehouse ~]# kadmin.local -q “xst -norandkey -k /etc/security/keytab/test.keytab test@EXAMPLE.COM”

Authenticating as principal test/admin@EXAMPLE.COM with password.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type aes256-cts-hmac-sha1-96 added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type aes128-cts-hmac-sha1-96 added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type des3-cbc-sha1 added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type arcfour-hmac added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type camellia256-cts-cmac added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type camellia128-cts-cmac added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type des-hmac-sha1 added to keytab WRFILE:/etc/security/keytab/test.keytab.

Entry for principal test@EXAMPLE.COM with kvno 3, encryption type des-cbc-md5 added to keytab WRFILE:/etc/security/keytab/test.keytab.

注:-norandkey 的作用是声明不随机生成密码,若不加该参数,会导致之前的密码失效。

2)使用 keytab 进行认证

[root@warehouse ~]# kinit -kt /etc/security/keytab/test.keytab test

3)查看认证凭证

[root@warehouse keytab]# klist

Ticket cache: FILE:/tmp/krb5cc_0

Default principal: test@EXAMPLE.COM

Valid starting Expires Service principal

2022-08-08T01:02:06 2022-08-09T01:02:06 krbtgt/EXAMPLE.COM@EXAMPLE.COM

3. 销毁凭证 kdestroy

在安装 Kerberos的kdc服务的机器上进入 kadmin(Kerberos 服务端上使用 kadmin.local,安装了 Kerberos Client 的机器上可以使用 kadmin),然后执行如下命令分别创建服务端和客户端的 keytab:

# 创建服务端的keytab,在不同的机器上使用不同主机名对应的keytab文件,格式:principal/hostname@realm

[root@warehouse keytab]# kadmin

Authenticating as principal admin/admin@EXAMPLE.COM with password.

Password for admin/admin@EXAMPLE.COM:

kadmin远程登录数据库kadmin ==> 创建kafka-server的服务主体生成秘钥

kadmin: add_principal -randkey kafka-server/warehouse

WARNING: no policy specified for kafka-server/warehouse@EXAMPLE.COM; defaulting to no policy

Principal “kafka-server/warehouse@EXAMPLE.COM” created.

导出秘钥到对应的目录/etc/security/keytab/kafka-service.keytab ==> 生成的秘钥文件为kafka-service.keytab

kadmin: xst -k /etc/security/keytab/kafka-service.keytab kafka-server/warehouse@EXAMPLE.COM

shell命令的方式创建服务主体:kafka-client

$ kadmin.local -q “add_principal -randkey kafka-client”

Authenticating as principal admin/admin@EXAMPLE.COM with password.

WARNING: no policy specified for kafka-client@EXAMPLE.COM; defaulting to no policy

Principal “kafka-client@EXAMPLE.COM” created.

导出秘钥到指定的文件夹下

[root@warehouse keytab]# kadmin.local -q “xst -k /etc/security/keytab/kafka-client.keytab kafka-client@EXAMPLE.COM”

Authenticating as principal admin/admin@EXAMPLE.COM with password.

Entry for principal kafka-client@EXAMPLE.COM with kvno 2, encryption type aes256-cts-hmac-sha1-96 added to keytab WRFILE:/etc/security/keytab/kafka-client.keytab.

kinit -kt /etc/security/keytab/kafka-server.service.keytab kafka-server/warehouse@EXAMPLE.COM

kinit -kt /etc/security/keytab/kafka-client.service.keytab kafka-client/warehouse@EXAMPLE.COM

拷贝 krb5.conf 及kafka.keytab 文件都放到 Kafka 的 $KAFKA_HOME/config/kerberos 目录下(kerberos 目录需新建)。

这个路径:/opt/module/kafka/config/kerberos

$ mkdir $KAFKA_HOME/config/kerberos

$ cp /etc/security/keytab/kafka*.keytab $KAFKA_HOME/config/kerberos/

将krd5.conf也复制到$ KAFKA_HOME/config/kerberos目录下

# 将krd5.conf也复制到$KAFKA_HOME/config/kerberos目录下

$ cp /etc/krb5.conf $KAFKA_HOME/config/kerberos/

复制 $KAFKA_HOME/config/server.properties(复制动作能帮助我们在 认证/非认证 模式自由切换)重命名为 $KAFKA_HOME/config/server-sasl.properties

cd … 到config目录下

然后执行cp命令,如下所示:

[root@warehouse config]# cp server.properties server-sasl.properties

[root@warehouse config]# ll

增加或修复如下配置:

【温馨提示】其中sasl.kerberos.service.name要和principal的名称相同

listeners=SASL_PLAINTEXT://0.0.0.0:19092

advertised.listeners=SASL_PLAINTEXT://warehouse:19092

security.inter.broker.protocol=SASL_PLAINTEXT

sasl.mechanism.inter.broker.protocol=GSSAPI

sasl.enabled.mechanisms=GSSAPI

sasl.kerberos.service.name=kafka-server

新建 kafka-server-jaas.conf 文件,该文件也放到 Kafka 的 $KAFKA_HOME/config/kerberos/ 目录下:

vim kafka-server-jaas.conf

KafkaServer {

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

//不同的主机,需修改成不同的keytab文件

keyTab="/opt/module/kafka/config/kerberos/kafka-server.service.keytab"

storeKey=true

useTicketCache=false

//不同的主机,需修改为本机的主机名

principal="kafka-server/warehouse@EXAMPLE.COM";

};

//Zookeeper client authentication,配置跟KafkaServer 一样,如果zookeeper开启了kerberos认证,就得加这段配置,我

这没开,所以先注释了

//Client {

// com.sun.security.auth.module.Krb5LoginModule required

// useKeyTab=true

// 不同的主机,需修改成不同的keytab文件

// keyTab="/opt/bigdata/hadoop/server/kafka_2.13-3.1.1/config/kerberos/kafka-server.keytab"

// storeKey=true

// useTicketCache=false

// 不同的主机,需修改为本机的主机名

// principal="kafka-server/hadoop-node1@HADOOP.COM";

//};

复制 bin/kafka-server-start.sh 脚本重命名为 bin/kafka-server-start-sasl.sh

$ cp $KAFKA_HOME/bin/kafka-server-start.sh $KAFKA_HOME/bin/kafka-server-start-sasl.sh

在倒数第二行增加如下配置(bin/kafka-server-start-sasl.sh):

export KAFKA_OPTS="-Dzookeeper.sasl.client=false -Dzookeeper.sasl.client.username=zk-server

-Djava.security.krb5.conf=/opt/module/kafka/config/kerberos/krb5.conf

-Djava.security.auth.login.config=/opt/module/kafka/config/kerberos/kafka-server-jaas.conf"

【温馨提示】如果 Zookeeper 开启 Kerberos 认证,则这里 zookeeper.sasl.client 就得设为 true。

该配置主要为了使用 bin/kafka-topics.sh、bin/kafka-console-consumer.sh、kafka-console-producer.sh 等命令。

新建 client.properties 文件,该文件也放到 Kafka 的 $KAFKA_HOME/config/kerberos 目录下:

执行命令

$ cat > $KAFKA_HOME/config/kerberos/client.properties <<EOF

security.protocol=SASL_PLAINTEXT

sasl.mechanism=GSSAPI

sasl.kerberos.service.name=kafka-server

EOF

新建 kafka-client-jaas.conf 文件,该文件也放到 Kafka 的 config/kerberos 目录下:

$ cat > $KAFKA_HOME/config/kerberos/kafka-client-jaas.conf <<EOF

KafkaClient {

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

keyTab="/opt/module/kafka/config/kerberos/kafka-client.service.keytab"

storeKey=true

useTicketCache=false

principal="kafka-client/warehouse@EXAMPLE.COM";

};

EOF

复制 bin/kafka-topics.sh、bin/kafka-console-producer.sh、bin/kafka-console-consumer.sh 脚本,分别重命名为 bin/kafka-topics-sasl.sh、bin/kafka-console-producer-sasl.sh、bin/kafka-console-consumer-sasl.sh 执行一下命令:

$ cp $KAFKA_HOME/bin/kafka-topics.sh $KAFKA_HOME/bin/kafka-topics-sasl.sh

$ cp $KAFKA_HOME/bin/kafka-console-producer.sh $KAFKA_HOME/bin/kafka-console-producer-sasl.sh

$ cp $KAFKA_HOME/bin/kafka-console-consumer.sh $KAFKA_HOME/bin/kafka-console-consumer-sasl.sh

$ cp $KAFKA_HOME/bin/kafka-consumer-groups.sh $KAFKA_HOME/bin/kafka-consumer-groups-sasl.sh

在倒数第二行增加如下配置(bin/kafka-xxx.sh):

export KAFKA_OPTS="-Djava.security.krb5.conf=/opt/module/kafka/config/kerberos/krb5.conf

-Djava.security.auth.login.config=/opt/module/kafka/config/kerberos/kafka-client-jaas.conf"

【温馨提示】上面创建了两个keytab文件,但是权限都是一样,都可以操作所有,所以在企业生成环境中,可以考虑把客户端的用户权限控制一下。

# kafka kerberos配置

$ scp -r $KAFKA_HOME/config/kerberos hadoop-node2:$KAFKA_HOME/config/

$ scp -r $KAFKA_HOME/config/kerberos hadoop-node3:$KAFKA_HOME/config/

# kafka server启动脚本

$ scp $KAFKA_HOME/bin/kafka-server-start-sasl.sh hadoop-node2:$KAFKA_HOME/bin/

$ scp $KAFKA_HOME/bin/kafka-server-start-sasl.sh hadoop-node3:$KAFKA_HOME/bin/

# 【温馨提示】注意修改broker.id、advertised.listeners

# kafka server 配置

$ scp $KAFKA_HOME/config/server-sasl.properties hadoop-node2:$KAFKA_HOME/config/

$ scp $KAFKA_HOME/config/server-sasl.properties hadoop-node3:$KAFKA_HOME/config/

# topic操作

$ scp $KAFKA_HOME/bin/kafka-topics-sasl.sh hadoop-node2:$KAFKA_HOME/bin/

$ scp $KAFKA_HOME/bin/kafka-topics-sasl.sh hadoop-node3:$KAFKA_HOME/bin/

# 生产者

$ scp $KAFKA_HOME/bin/kafka-console-producer-sasl.sh hadoop-node2:$KAFKA_HOME/bin/

$ scp $KAFKA_HOME/bin/kafka-console-producer-sasl.sh hadoop-node3:$KAFKA_HOME/bin/

# 消费者

$ scp $KAFKA_HOME/bin/kafka-console-consumer-sasl.sh hadoop-node2:$KAFKA_HOME/bin/

$ scp $KAFKA_HOME/bin/kafka-console-consumer-sasl.sh hadoop-node3:$KAFKA_HOME/bin/

# 消费组

$ scp $KAFKA_HOME/bin/kafka-consumer-groups-sasl.sh hadoop-node2:$KAFKA_HOME/bin/

$ scp $KAFKA_HOME/bin/kafka-consumer-groups-sasl.sh hadoop-node3:$KAFKA_HOME/bin/

运行 bin/kafka-server-start-sasl.sh 启动 Kafka 集群:

# 启动kafka

$ cd $KAFKA_HOME

$ ./bin/kafka-server-start-sasl.sh config/server-sasl.properties

# 还是跟之前的一样查询,会发现已经不能查询了

$ ./bin/kafka-topics-sasl.sh --list --bootstrap-server warehouse:19092

查询主题列表,服务端报的错误,无法查询证明安全认证生效了

正确访问方式

$ cd $KAFKA_HOME

$ ./bin/kafka-topics-sasl.sh --list --bootstrap-server warehouse:19092 --command-config config/kerberos/client.properties

$ cd $KAFKA_HOME

$ ./bin/kafka-topics-sasl.sh --create --topic test-sasl --bootstrap-server warehouse:19092 --partitions 1 --replication-factor 1 --config retention.ms=259200000 --command-config config/kerberos/client.properties

$ cd $KAFKA_HOME

$ ./bin/kafka-topics-sasl.sh --bootstrap-server warehouse:19092 --describe --topic test-sasl --command-config config/kerberos/client.properties

彻底删除topic:

1、删除kafka存储目录(server.properties文件log.dirs配置,默认为"/tmp/kafka-logs")相关topic目录

2、如果配置了delete.topic.enable=true直接通过命令删除,如果命令删除不掉,直接通过zookeeper-client 删除掉broker下的topic即可。

命令示例: kafka-topics.sh --delete --topic XXX --zookeeper localhost:2181

$ cd $KAFKA_HOME

$ ./bin/kafka-topics-sasl.sh --delete --topic test-sasl --bootstrap-server warehouse:19092 --command-config config/kerberos/client.properties

运行 kafka-console-producer-sasl.sh 生产消息:

$ cd $KAFKA_HOME

$ ./bin/kafka-console-producer-sasl.sh --bootstrap-server warehouse:19092 --topic test-sasl --producer.config config/kerberos/client.properties

-------------------------------------------

./bin/kafka-console-producer-sasl.sh --broker-list warehouse:19092 --topic test-sasl --producer.config config/kerberos/client.properties

-------------------------------------------

{"id":"1","name":"n1","age":"20"}

{"id":"2","name":"n2","age":"21"}

{"id":"3","name":"n3","age":"22"}

运行 bin/kafka-console-consumer-sasl.sh 消费消息:

$ cd $KAFKA_HOME

$ ./bin/kafka-console-consumer-sasl.sh --bootstrap-server warehouse:19092 --topic test-sasl --from-beginning --consumer.config config/kerberos/client.properties

#消费组

$ ./bin/kafka-console-consumer-sasl.sh --bootstrap-server warehouse:19092 --topic test-sasl --from-beginning --group test-sasl --consumer.config config/kerberos/client.properties

$ cd $KAFKA_HOME

$ ./bin/kafka-consumer-groups-sasl.sh --bootstrap-server warehouse:19092 --describe --group test-sasl --command-config config/kerberos/client.properties

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

我有一个在Linux服务器上运行的ruby脚本。它不使用rails或任何东西。它基本上是一个命令行ruby脚本,可以像这样传递参数:./ruby_script.rbarg1arg2如何将参数抽象到配置文件(例如yaml文件或其他文件)中?您能否举例说明如何做到这一点?提前谢谢你。 最佳答案 首先,您可以运行一个写入YAML配置文件的独立脚本:require"yaml"File.write("path_to_yaml_file",[arg1,arg2].to_yaml)然后,在您的应用中阅读它:require"yaml"arg

我已经在Sinatra上创建了应用程序,它代表了一个简单的API。我想在生产和开发上进行部署。我想在部署时选择,是开发还是生产,一些方法的逻辑应该改变,这取决于部署类型。是否有任何想法,如何完成以及解决此问题的一些示例。例子:我有代码get'/api/test'doreturn"Itisdev"end但是在部署到生产环境之后我想在运行/api/test之后看到ItisPROD如何实现? 最佳答案 根据SinatraDocumentation:EnvironmentscanbesetthroughtheRACK_ENVenvironm

有时我需要处理键/值数据。我不喜欢使用数组,因为它们在大小上没有限制(很容易不小心添加超过2个项目,而且您最终需要稍后验证大小)。此外,0和1的索引变成了魔数(MagicNumber),并且在传达含义方面做得很差(“当我说0时,我的意思是head...”)。散列也不合适,因为可能会不小心添加额外的条目。我写了下面的类来解决这个问题:classPairattr_accessor:head,:taildefinitialize(h,t)@head,@tail=h,tendend它工作得很好并且解决了问题,但我很想知道:Ruby标准库是否已经带有这样一个类? 最佳

我正在尝试使用Curbgem执行以下POST以解析云curl-XPOST\-H"X-Parse-Application-Id:PARSE_APP_ID"\-H"X-Parse-REST-API-Key:PARSE_API_KEY"\-H"Content-Type:image/jpeg"\--data-binary'@myPicture.jpg'\https://api.parse.com/1/files/pic.jpg用这个:curl=Curl::Easy.new("https://api.parse.com/1/files/lion.jpg")curl.multipart_form_

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

本教程将在Unity3D中混合Optitrack与数据手套的数据流,在人体运动的基础上,添加双手手指部分的运动。双手手背的角度仍由Optitrack提供,数据手套提供双手手指的角度。 01 客户端软件分别安装MotiveBody与MotionVenus并校准人体与数据手套。MotiveBodyMotionVenus数据手套使用、校准流程参照:https://gitee.com/foheart_1/foheart-h1-data-summary.git02 数据转发打开MotiveBody软件的Streaming,开始向Unity3D广播数据;MotionVenus中设置->选项选择Unit

之前在培训新生的时候,windows环境下配置opencv环境一直教的都是网上主流的vsstudio配置属性表,但是这个似乎对新生来说难度略高(虽然个人觉得完全是他们自己的问题),加之暑假之后对cmake实在是爱不释手,且这样配置确实十分简单(其实都不需要配置),故斗胆妄言vscode下配置CV之法。其实极为简单,图比较多所以很长。如果你看此文还配不好,你应该思考一下是不是自己的问题。闲话少说,直接开始。0.CMkae简介有的人到大二了都不知道cmake是什么,我不说是谁。CMake是一个开源免费并且跨平台的构建工具,可以用简单的语句来描述所有平台的编译过程。它能够根据当前所在平台输出对应的m

文章目录一、概述简介原理模块二、配置Mysql使用版本环境要求1.操作系统2.mysql要求三、配置canal-server离线下载在线下载上传解压修改配置单机配置集群配置分库分表配置1.修改全局配置2.实例配置垂直分库水平分库3.修改group-instance.xml4.启动监听四、配置canal-adapter1修改启动配置2配置映射文件3启动ES数据同步查询所有订阅同步数据同步开关启动4.验证五、配置canal-admin一、概述简介canal是Alibaba旗下的一款开源项目,Java开发。基于数据库增量日志解析,提供增量数据订阅&消费。Git地址:https://github.co

我正在尝试在Rails上安装ruby,到目前为止一切都已安装,但是当我尝试使用rakedb:create创建数据库时,我收到一个奇怪的错误:dyld:lazysymbolbindingfailed:Symbolnotfound:_mysql_get_client_infoReferencedfrom:/Library/Ruby/Gems/1.8/gems/mysql2-0.3.11/lib/mysql2/mysql2.bundleExpectedin:flatnamespacedyld:Symbolnotfound:_mysql_get_client_infoReferencedf