OpenGL 学习教程

Android OpenGL ES 学习(一) – 基本概念

Android OpenGL ES 学习(二) – 图形渲染管线和GLSL

Android OpenGL ES 学习(三) – 绘制平面图形

Android OpenGL ES 学习(四) – 正交投影

Android OpenGL ES 学习(五) – 渐变色

Android OpenGL ES 学习(六) – 使用 VBO、VAO 和 EBO/IBO 优化程序

Android OpenGL ES 学习(七) – 纹理

Android OpenGL ES 学习(八) –矩阵变换

Android OpenGL ES 学习(九) – 坐标系统和。实现3D效果

Android OpenGL ES 学习(十) – GLSurfaceView 源码解析GL线程以及自定义 EGL

Android OpenGL ES 学习(十一) –渲染YUV视频以及视频抖音特效

之前学习到的图片,这一章,我们使用OpenGL 来解析 yuv 视频,并实现一些效果,废话不多说,先上效果:

当然,在进入主题之前,先学习一些基础知识。

在说 yuv 之前,就不得不说 RGB 图像空间,顾名思义,RGB 是值图像的每一个像素都有 R、G,B 三个值,且三个值一次排列存储;但不一定说一定是按照 R,G,B 顺序排列,也可以是 B,G,R 这样的顺序。其中 R,G,B 的位深为 8 bit。

我们常见的图片处理,都是用 R,G,B 的图像格式,比如bitmap,比如图像的存储,基本使用 R,G,B

我们知道,视频是由一张张图片组成,假设有一个 1920 * 1080 分辨率、帧率为60帧的视频,如果不进行压缩处理,并且使用RGB进行存储的话,仅仅一分钟的视频就能达到 ( 1920 * 1080 * 8 * 60 * 60 )bit (约等于56G),这显然是很夸张的。

但R,G,B这三个颜色是彼此是由相关性的,不利于编码压缩,所以,我们需要另外一种图像格式,来解决图像压缩问题,这个时候,yuv 就被提升来了。

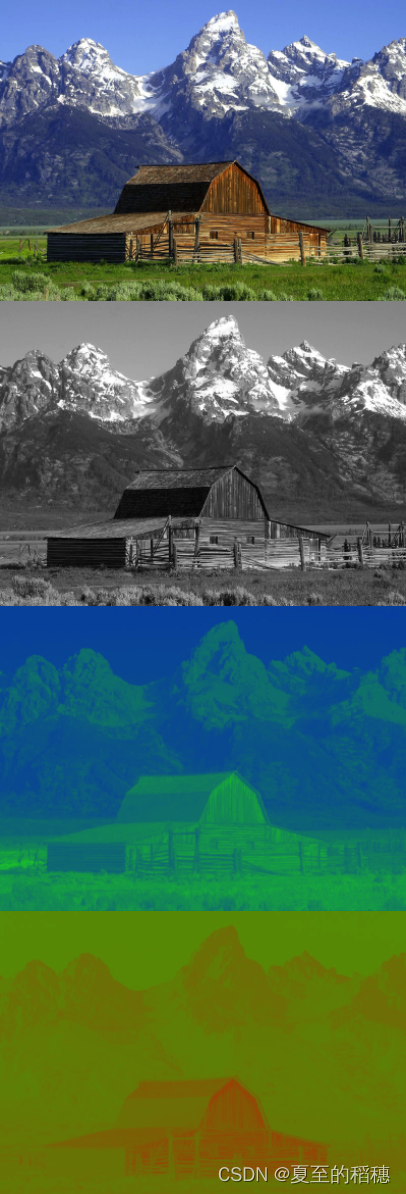

yuv 图像格式将亮度信息 Y 和 色彩信息 UV 分离开来,Y 表示亮度,是图像的总体轮廓,即我们常说的灰度值,UV 表示色度,主要描绘图像的色彩信息,即颜色饱和度。如下图(图片来源wiki百科):

yuv 最早用于电视系统和模拟视频领域,它兼容了黑白电视和彩色电视,如果你家有vcd,dvd 这种设备,就会发现有 YCbCr(YUV) 这种接口,如果是黑白电视,值需要接入Y分量即可。

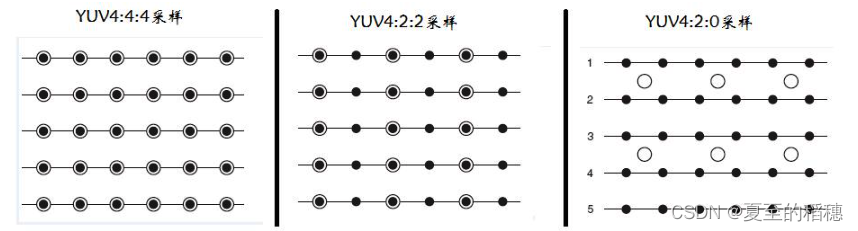

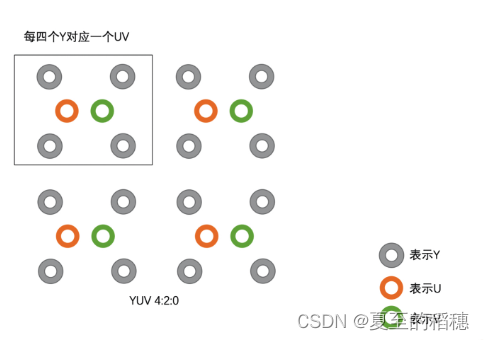

从很早的时候,人们就发现,人类对亮度信息比较敏感,而对色彩信息不那么敏感,比如我们降低一些颜色值,并不影响人对这张图像感官。因此,yuv 的编码压缩,又可以分为 YUV 4:4:4、YUV 4:2:2、YUV 4:2:0 这几种常用的类型

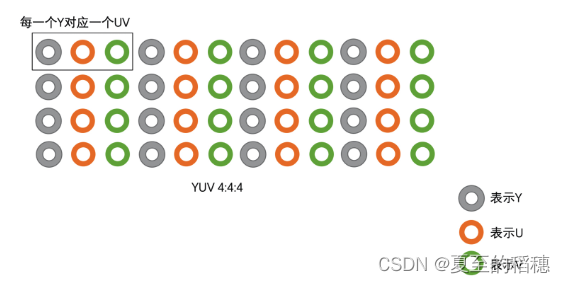

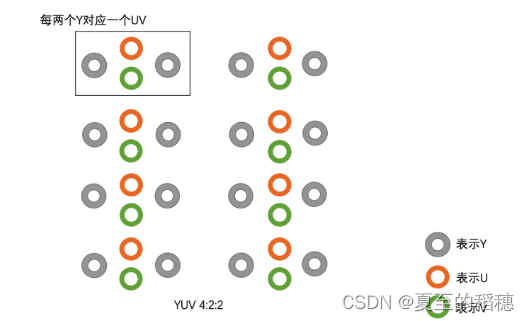

YUV 4:4:4、YUV 4:2:2、YUV 4:2:0,指的是U,V 分量像素点的个数和采集方式,其中又以 YUV 4:2:0 最为常用。

可以这样简单理解:

如下图(图片来源极客时间):

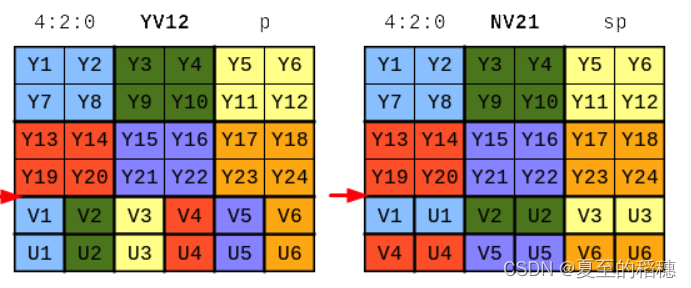

其中,YUV 又有不同的存储方式:

更多内容和YUV转RGB,可以参考:https://time.geekbang.org/column/article/449795

从之前OpenGL 的纹理教程中,我们是把一张图片,通过纹理的方式,传递给片段着色器,最终通过纹理采样,复制给片段颜色值,呈现出来的。

现在使用 YUV ,该如何处理呢?我们知道,视频最终的呈现还是RGB格式的数据,因此,我们需要把 YUV 的数据,所以需要在片段着色器赋值之前,把YUV转换成 RGB。

在OpenGL 的api 中,可以发现有个 GL_LUMINANCE 格式,它表示只取一个颜色通道,这样的话,就可以把 YUV 拆分成3个通道来读取,然后我们设置 3个纹理,把 YUV 数据传入其中,并最终把这三个通道合并在一起。

为了方便演示,我们使用 YUV420P 的视频,即4个Y共用一个U,V 分量,且存储是先存储Y,然后是U,最后再存储V分量。

这里我们可以用 ffmepg 的命令,轻松把一个 MP4 的视频转换成 YUV,由于 YUV 比较大,记得修改分辨率,这样小一些:

ffmpeg -i input.mp4 -s 288x512 -r 30 -pix_fmt yuv420p out.yuv

之后,就可以通过不断读取这个yuv文件,拿到y,u,v的数据,假设视频大小为 wxh ,则先读取 wh 个y,再读取 wh/4 个u,再读取 w*h/4 个 v;一帧读取完后,就进行渲染,然后再重复操作,直到文件被读取完毕。

我们把文件放在 assert 文件夹下:

/**

* 读取yuv数据,注意 w,h 为视频宽高

*/

private fun readYuvData(w: Int, h: Int) {

val input = context.resources.assets.open(YUV_FILE)

//视频时 yuv420p ,4 个 y 共用一个 uv,先存储y,再u,和v

val y = ByteArray(w * h)

val u = ByteArray(w * h / 4)

val v = ByteArray(w * h / 4)

while (true) {

if (isExit) {

Log.d(TAG, "readYuvData,手动退出")

return

}

val readY = input.read(y)

val readU = input.read(u)

val readV = input.read(v)

//都读到分量

if (readY > 0 && readU > 0 && readV > 0) {

//从这里触发刷新

bufferY = ByteBuffer.wrap(y)

bufferU = ByteBuffer.wrap(u)

bufferV = ByteBuffer.wrap(v)

val glView = view as GLSurfaceView

//主动触发刷新

glView.requestRender()

//延时30ms,控制速度

Thread.sleep(30)

} else {

Log.d(TAG, "readYuvData,文件末尾,退出")

return

}

}

}

顶点着色器,沿用上一章,不需要改变,但是我们把位置改一下,让它填充整个屏幕:

private val POINT_RECT_DATA2 = floatArrayOf(

// positions // texture coords

1f, 1f, 0.0f, 1.0f, 0.0f, // top right

1f, -1f, 0.0f, 1.0f, 1.0f, // bottom right

-1f, -1f, 0.0f, 0.0f, 1.0f, // bottom left

-1f, 1f, 0.0f, 0.0f, 0.0f // top left

)

片段着色中,设置三个纹理,用来读取 yuv分量的数据:

private const val FRAGMENT_SHADER = """#version 300 es

precision mediump float;

out vec4 FragColor;

in vec2 vTexture;

uniform sampler2D textureY;

uniform sampler2D textureU;

uniform sampler2D textureV;

void main() {

//采样到的yuv向量数据

float y,u,v;

//yuv转化得到的rgb向量数据

vec3 rgb;

//分别取yuv各个分量的采样纹理

y = texture(textureY, vTexture).r;

u = texture(textureU, vTexture).g - 0.5;

v = texture(textureV, vTexture).b - 0.5;

//yuv转化为rgb, https://en.wikipedia.org/wiki/YUV

rgb.r = y + 1.540*v;

rgb.g = y - 0.183*u - 0.459*v;

rgb.b = y + 1.818*u;

FragColor = vec4(rgb, 1.0);

}

"""

可以看到,我们使用了三个纹理textureY,textureU,textureV,然后用了三个变量 y,u,v 用来接收纹理数据。

前面说到,OpenGL 的分量,除了包含位置信息{x,y,z,w},还有颜色(r,g,b,a)和纹理信息(s,t,r,q):

当我们设置 sampler2D 的类型为 GL_LUMINANCE,所以 texture().r 拿到的是yuv 的第一个颜色向量的第一个分量信息,就是y;

那这个 0.5 是什么?为啥要减去它?

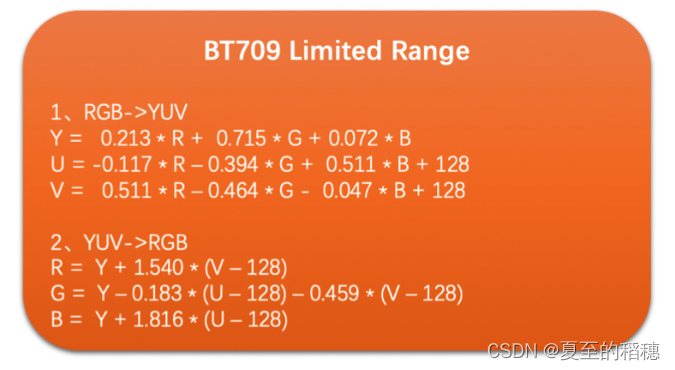

先看到YUV与RGB 的转换公司,这里用高清模式(BT709),颜色空间为 Limited Range 的转换公式:(图片来源)

可以看到,有个转换偏差值,而 U,V 默认是127 ,Y 的偏移量为0。8 个 bit 位的取值范围是 0 ~ 255,由于在 shader 中纹理采样值需要进行归一化(注意,纹理的范围是[0,1]),所以 UV 分量的采样值需要分别减去 0.5 ,确保 YUV 到 RGB 正确转换。

编写完着色器,就可以编写纹理对象了。首先,设置纹理的下标:

private val textures = IntArray(3)

//三个纹理,需要设置纹理的下标

GLES30.glUniform1i(GLES30.glGetUniformLocation(programId, "textureY"), 0)

GLES30.glUniform1i(GLES30.glGetUniformLocation(programId, "textureU"), 1)

GLES30.glUniform1i(GLES30.glGetUniformLocation(programId, "textureV"), 2)

设置纹理的对象:

GLES30.glGenTextures(3, textures, 0)

for (i in 0..2) {

GLES30.glBindTexture(GLES30.GL_TEXTURE_2D, textures[i])

//纹理环绕

GLES30.glTexParameteri(GLES30.GL_TEXTURE_2D, GLES30.GL_TEXTURE_WRAP_S, GLES30.GL_REPEAT)

GLES30.glTexParameteri(GLES30.GL_TEXTURE_2D, GLES30.GL_TEXTURE_WRAP_T, GLES30.GL_REPEAT)

//纹理过滤

GLES30.glTexParameteri(

GLES30.GL_TEXTURE_2D,

GLES30.GL_TEXTURE_MIN_FILTER,

GLES30.GL_NEAREST

)

GLES30.glTexParameteri(

GLES30.GL_TEXTURE_2D,

GLES30.GL_TEXTURE_MAG_FILTER,

GLES30.GL_LINEAR

)

//解绑纹理对象

GLES30.glBindTexture(GLES30.GL_TEXTURE_2D, 0)

}

前面2.3章节,已经拿到了 yuv 的数据,这里,我们使用 glTexImage2D 把数据设置给纹理:

override fun onDrawFrame(gl: GL10?) {

//步骤1:使用glClearColor设置的颜色,刷新Surface

GLES30.glClear(GLES30.GL_COLOR_BUFFER_BIT)

//使用 y 数据

GLES30.glActiveTexture(GLES30.GL_TEXTURE0)

GLES30.glBindTexture(GLES30.GL_TEXTURE_2D, textures[0])

GLES30.glTexImage2D(

GLES30.GL_TEXTURE_2D,

0,

GLES30.GL_LUMINANCE,

w,

h,

0,

GLES30.GL_LUMINANCE,

GLES30.GL_UNSIGNED_BYTE,

bufferY

)

//使用 u 数据

GLES30.glActiveTexture(GLES30.GL_TEXTURE1)

GLES30.glBindTexture(GLES30.GL_TEXTURE_2D, textures[1])

GLES30.glTexImage2D(

GLES30.GL_TEXTURE_2D,

0,

GLES30.GL_LUMINANCE,

w / 2,

h / 2,

0,

GLES30.GL_LUMINANCE,

GLES30.GL_UNSIGNED_BYTE,

bufferU

)

//使用 v 数据

GLES30.glActiveTexture(GLES30.GL_TEXTURE2)

GLES30.glBindTexture(GLES30.GL_TEXTURE_2D, textures[2])

GLES30.glTexImage2D(

GLES30.GL_TEXTURE_2D,

0,

GLES30.GL_LUMINANCE,

w / 2,

h / 2,

0,

GLES30.GL_LUMINANCE,

GLES30.GL_UNSIGNED_BYTE,

bufferV

)

GLES30.glBindVertexArray(vao[0])

GLES30.glDrawElements(GLES30.GL_TRIANGLE_STRIP, 6, GLES30.GL_UNSIGNED_INT, 0)

bufferY?.clear()

bufferU?.clear()

bufferV?.clear()

}

效果如下:

从纹理那张可知

Android OpenGL ES 学习(七) – 纹理

我们可以通过:

FragColor = mix(texture1,texture2,0.5);

的方式去添加纹理的效果。因此,我们也可以修改片段着色器中的 RGB 数据,实现不同的效果。

比如灰度,只需要修改rgb的颜色,即可,你可以把 u,v 分量去掉:

// u = texture(textureU, vTexture).g - 0.5;

// v = texture(textureV, vTexture).b - 0.5;

u = 0.0;

v = 0.0;

也可以使用算法:

float gray = rgb.r * 0.2126 + rgb.g * 0.7152 + rgb.b * 0.0722;

FragColor = vec4(gray,gray,gray, 1.0);

得到灰度视频:

让每个颜色值反转,我们只需要1 - 颜色值即可:

rgb.r = 1.0 - (y + 1.540*v);

rgb.g = 1.0 - (y - 0.183*u - 0.459*v);

rgb.b = 1.0 - (y + 1.818*u);

FragColor = vec4(rgb, 1.0);

什么意思呢?就是让左上角颜色反转,右下角灰色,其他区域正常显示,如下视频:

思路是对y进行分割,取中间(0.5,0.5)作为分割点:

if(vTexture.x <= 0.5 && vTexture.y <= 0.5){

//左上角,使用反色

float r = 1.0 - rgb.r;

float g = 1.0 - rgb.g;

float b = 1.0 - rgb.b;

FragColor = vec4(r,g,b, 1.0);

}else if(vTexture.x > 0.5 && vTexture.y > 0.5){

//右下角,使用灰度

float gray = rgb.r * 0.2126 + rgb.g * 0.7152 + rgb.b * 0.0722;

FragColor = vec4(gray,gray,gray, 1.0);

}else{

FragColor = vec4(rgb, 1.0);

}

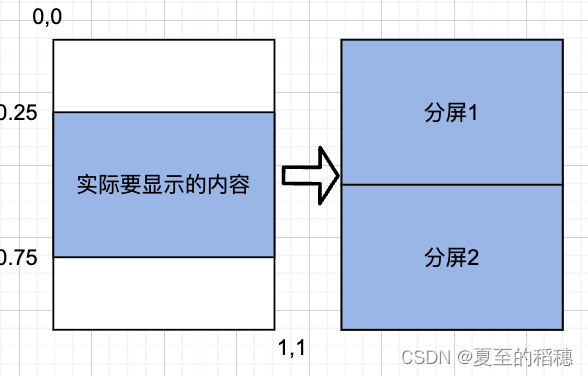

分屏这个原理呢,需要抽象一下,拿二分屏来说,其实最终操作的是纹理坐标的值。

如下图:

比如,因为要二分屏,实际上显示的,肯定不是全部内容,如显示区域为 0.25 到0.75 范围,实际就是把这个范围,填充到上下两个区域,分割线为0.5.

这样,上半部分(0,0)到(0,0.5) 要显示时,实际是从(0,0.25),(0,0.75)的内容,同理下半部分,也是(0,0.5)到(0,1.0),实际也是 (0,0.25),(0,0.75)。

因此,我们修改 y 分量的大小即可:

//输入是不能被修改的,所以使用一个vec2 分量

vec2 uv = vTexture.xy;

if(uv.y >= 0.0 && uv.y <= 0.5){

uv.y = uv.y + 0.25;

}else{

uv.y = uv.y - 0.25;

}

//分别取yuv各个分量的采样纹理

y = texture(textureY, uv).r;

u = texture(textureU, uv).g - 0.5;

v = texture(textureV, uv).b - 0.5;

就可以得到二分屏:

同理,我们可以得到三分屏的效果:

if(uv.y >= 0.0 && uv.y <= 0.2){

uv.y = uv.y + 0.3;

}else if(uv.y > 0.8){

uv.y = uv.y - 0.5;

}

参考:

https://juejin.cn/post/7160304816877469733

https://juejin.cn/post/7168042219163779108

https://time.geekbang.org/column/article/449795

https://learnopengl-cn.github.io/04%20Advanced%20OpenGL/05%20Framebuffers/

我正在使用的第三方API的文档状态:"[O]urAPIonlyacceptspaddedBase64encodedstrings."什么是“填充的Base64编码字符串”以及如何在Ruby中生成它们。下面的代码是我第一次尝试创建转换为Base64的JSON格式数据。xa=Base64.encode64(a.to_json) 最佳答案 他们说的padding其实就是Base64本身的一部分。它是末尾的“=”和“==”。Base64将3个字节的数据包编码为4个编码字符。所以如果你的输入数据有长度n和n%3=1=>"=="末尾用于填充n%

我想要做的是有2个不同的Controller,client和test_client。客户端Controller已经构建,我想创建一个test_clientController,我可以使用它来玩弄客户端的UI并根据需要进行调整。我主要是想绕过我在客户端中内置的验证及其对加载数据的管理Controller的依赖。所以我希望test_clientController加载示例数据集,然后呈现客户端Controller的索引View,以便我可以调整客户端UI。就是这样。我在test_clients索引方法中试过这个:classTestClientdefindexrender:template=>

在我的Controller中,我通过以下方式在我的index方法中支持HTML和JSON:respond_todo|format|format.htmlformat.json{renderjson:@user}end在浏览器中拉起它时,它会自然地以HTML呈现。但是,当我对/user资源进行内容类型为application/json的curl调用时(因为它是索引方法),我仍然将HTML作为响应。如何获取JSON作为响应?我还需要说明什么? 最佳答案 您应该将.json附加到请求的url,提供的格式在routes.rb的路径中定义。这

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

在应用开发中,有时候我们需要获取系统的设备信息,用于数据上报和行为分析。那在鸿蒙系统中,我们应该怎么去获取设备的系统信息呢,比如说获取手机的系统版本号、手机的制造商、手机型号等数据。1、获取方式这里分为两种情况,一种是设备信息的获取,一种是系统信息的获取。1.1、获取设备信息获取设备信息,鸿蒙的SDK包为我们提供了DeviceInfo类,通过该类的一些静态方法,可以获取设备信息,DeviceInfo类的包路径为:ohos.system.DeviceInfo.具体的方法如下:ModifierandTypeMethodDescriptionstatic StringgetAbiList()Obt

目录前言滤波电路科普主要分类实际情况单位的概念常用评价参数函数型滤波器简单分析滤波电路构成低通滤波器RC低通滤波器RL低通滤波器高通滤波器RC高通滤波器RL高通滤波器部分摘自《LC滤波器设计与制作》,侵权删。前言最近需要学习放大电路和滤波电路,但是由于只在之前做音乐频谱分析仪的时候简单了解过一点点运放,所以也是相当从零开始学习了。滤波电路科普主要分类滤波器:主要是从不同频率的成分中提取出特定频率的信号。有源滤波器:由RC元件与运算放大器组成的滤波器。可滤除某一次或多次谐波,最普通易于采用的无源滤波器结构是将电感与电容串联,可对主要次谐波(3、5、7)构成低阻抗旁路。无源滤波器:无源滤波器,又称

最近在学习CAN,记录一下,也供大家参考交流。推荐几个我觉得很好的CAN学习,本文也是在看了他们的好文之后做的笔记首先是瑞萨的CAN入门,真的通透;秀!靠这篇我竟然2天理解了CAN协议!实战STM32F4CAN!原文链接:https://blog.csdn.net/XiaoXiaoPengBo/article/details/116206252CAN详解(小白教程)原文链接:https://blog.csdn.net/xwwwj/article/details/105372234一篇易懂的CAN通讯协议指南1一篇易懂的CAN通讯协议指南1-知乎(zhihu.com)视频推荐CAN总线个人知识总

深度学习部署:Windows安装pycocotools报错解决方法1.pycocotools库的简介2.pycocotools安装的坑3.解决办法更多Ai资讯:公主号AiCharm本系列是作者在跑一些深度学习实例时,遇到的各种各样的问题及解决办法,希望能够帮助到大家。ERROR:Commanderroredoutwithexitstatus1:'D:\Anaconda3\python.exe'-u-c'importsys,setuptools,tokenize;sys.argv[0]='"'"'C:\\Users\\46653\\AppData\\Local\\Temp\\pip-instal

作为新的阿里云用户,您可以50免费试用多种优惠,价值高达1,700美元(或8,500美元)。这将让您了解和体验阿里云平台上提供的一系列产品和服务。如果您以个人身份注册免费试用,您将获得价值1,700美元的优惠。但是,如果您是注册公司,您可以选择企业免费试用,提交基本信息通过企业实名注册验证,即可开始价值$8,500的免费试用!本教程介绍了如何设置您的帐户并使用您的免费试用版。关于免费试用在我们开始此试用之前,您还必须遵守以下条款和条件才能访问您的免费试用:只有在一年内创建的账户才有资格获得阿里云免费试用。通过此免费试用优惠,用户可以免费试用免费试用活动页面上列出的每种产品一次。如果您有多个帐

动漫制作技巧是很多新人想了解的问题,今天小编就来解答与大家分享一下动漫制作流程,为了帮助有兴趣的同学理解,大多数人会选择动漫培训机构,那么今天小编就带大家来看看动漫制作要掌握哪些技巧?一、动漫作品首先完成草图设计和原型制作。设计草图要有目的、有对象、有步骤、要形象、要简单、符合实际。设计图要一致性,以保证制作的顺利进行。二、原型制作是根据设计图纸和制作材料,可以是手绘也可以是3d软件创建。在此步骤中,要注意的问题是色彩和平面布局。三、动漫制作制作完成后,加工成型。完成不同的表现形式后,就要对设计稿进行加工处理,使加工的难易度降低,并得到一些基本准确的概念,以便于后续的大样、准确的尺寸制定。四、