h264文件不能直接在网页上播放,比如在浏览器上输入http://10.0.0.2/2022-01-08T22-32-58.h264,变成了下载。

若在浏览器上输入http://10.0.0.2/2022-01-08T22-32-58.mp4,则可以播放。

本文讲解用ffmpeg将h264文件转换成mp4。

首先,准备h264文件,这个可以用ffmpeg将一个mp4的视频部分转成h264,命令如下:

ffmpeg -i 2022-01-08T22-32-58.mp4 -an -vcodec copy 2022-01-08T22-32-58.h264

注意,我这里mp4里面的视频编码格式是h264,故用的vcodec copy,否则用vcodec libx264。

下面是将这个2022-01-08T22-32-58.h264封装成mp4,注意,没有解码编码过程,速度会很快。

大概过程如下:

1.启动两个线程

2.第一个线程av_read_frame读到packet,然后av_packet_clone拷贝出一个packet,塞入队列

3.第二个线程从队列中读取packet,进行pts,dts,duration设置,然后调用av_interleaved_write_frame写入。

这里面需要注意的地方在于pts,dts的设置,从ffmpeg源码上看,对于pts,dts的设置,也是很麻烦的,源码中,很多地方,动不动就看pts,dts是否需要设置。

本人之前采取下列方式进行dts和pts的设置,即由于读的context和写入的context的时间基(time_base)不一致,需要转换成目标文件context的时间基。

pPacketVideoA->dts = av_rescale_q_rnd(pPacketVideoA->dts, m_pFormatCtx_File->streams[m_iVideoIndex]->time_base, m_pFormatCtx_Out->streams[m_iVideoIndex]->time_base, AVRounding(1));

但实际运行时,出现了问题,读取出来的packet的pts和dts都是AV_NOPTS_VALUE,经过转换还是AV_NOPTS_VALUE,然后调用av_interleaved_write_frame出错。

最后调试ffmpeg源码,得到pts和dts的处理如下:

pPacketVideoA->duration = av_rescale_q_rnd(pPacketVideoA->duration, m_pFormatCtx_File->streams[m_iVideoIndex]->time_base, m_pFormatCtx_Out->streams[m_iVideoIndex]->time_base, AVRounding(1));

if (pPacketVideoA->dts != AV_NOPTS_VALUE)

{

pPacketVideoA->dts = av_rescale_q_rnd(pPacketVideoA->dts, m_pFormatCtx_File->streams[m_iVideoIndex]->time_base, m_pFormatCtx_Out->streams[m_iVideoIndex]->time_base, AVRounding(1));

pPacketVideoA->pts = pPacketVideoA->dts;

}

else

{

pPacketVideoA->pts = pPacketVideoA->dts = m_iTotalDuration;

}

m_iTotalDuration += pPacketVideoA->duration;

m_iTotalDuration的初始值,本人设置的是0,即第一帧的pts和dts都设置成0,下一帧的dts就是前面总帧的duration和,这个是ffmpeg里面的逻辑。

当然,ffmpeg里面判断复杂多了,比如参考了是否有B帧,本人所写的没考虑B帧,只考虑一个文件里面只有I帧,P帧的情况。

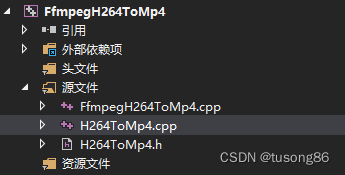

下面是代码结构

其中FfmpegH264ToMp4.cpp的内容如下:

// FfmpegH264ToMp4.cpp : 此文件包含 "main" 函数。程序执行将在此处开始并结束。

//

#include <iostream>

#include "H264ToMp4.h"

int main()

{

CVideoConvert cVideoConvert;

std::string strVideoFile = "2022-01-08T22-32-58.h264";

std::string strOutFile = "out.mp4";

cVideoConvert.StartConvert(strVideoFile, strOutFile);

cVideoConvert.WaitFinish();

return 0;

}

H264ToMp4.h里面的内容如下:

#pragma once

#include <string>

#include <Windows.h>

#include <deque>

#define MAX_VIDEOPACKET_NUM 100

#ifdef __cplusplus

extern "C"

{

#endif

#include "libavcodec/avcodec.h"

#include "libavformat/avformat.h"

#include "libswscale/swscale.h"

#include "libswresample/swresample.h"

#include "libavdevice/avdevice.h"

#include "libavutil/audio_fifo.h"

#include "libavutil/avutil.h"

#include "libavutil/fifo.h"

#include "libavutil/frame.h"

#include "libavutil/imgutils.h"

#include "libavfilter/avfilter.h"

#include "libavfilter/buffersink.h"

#include "libavfilter/buffersrc.h"

#ifdef __cplusplus

};

#endif

class CVideoConvert

{

public:

CVideoConvert();

~CVideoConvert();

public:

int StartConvert(std::string strFileName, std::string strFileOut);

void StopConvert();

public:

int OpenFile(const char *pFile);

int OpenOutPut(const char *pFileOut);

private:

static DWORD WINAPI FileReadProc(LPVOID lpParam);

void FileRead();

static DWORD WINAPI FileWriteProc(LPVOID lpParam);

void FileWrite();

public:

void WaitFinish();

public:

AVFormatContext *m_pFormatCtx_File = NULL;

AVFormatContext *m_pFormatCtx_Out = NULL;

std::deque<AVPacket *> m_vecReadVideo;

int m_iVideoWidth = 1920;

int m_iVideoHeight = 1080;

int m_iYuv420FrameSize = 0;

int m_iVideoFrameNum = 0;

int m_iVideoIndex = -1;

bool m_bStartConvert = false;

int64_t m_iTotalDuration = 0;

private:

CRITICAL_SECTION m_csVideoReadSection;

HANDLE m_hFileReadThread = NULL;

HANDLE m_hFileWriteThread = NULL;

};

H264ToMp4.cpp里面的内容如下:

#include "H264ToMp4.h"

#ifdef __cplusplus

extern "C"

{

#endif

#pragma comment(lib, "avcodec.lib")

#pragma comment(lib, "avformat.lib")

#pragma comment(lib, "avutil.lib")

#pragma comment(lib, "avdevice.lib")

#pragma comment(lib, "avfilter.lib")

#pragma comment(lib, "postproc.lib")

#pragma comment(lib, "swresample.lib")

#pragma comment(lib, "swscale.lib")

#ifdef __cplusplus

};

#endif

CVideoConvert::CVideoConvert()

{

InitializeCriticalSection(&m_csVideoReadSection);

}

CVideoConvert::~CVideoConvert()

{

DeleteCriticalSection(&m_csVideoReadSection);

}

int CVideoConvert::StartConvert(std::string strFileName, std::string strFileOut)

{

int ret = -1;

do

{

ret = OpenFile(strFileName.c_str());

if (ret != 0)

{

break;

}

ret = OpenOutPut(strFileOut.c_str());

if (ret != 0)

{

break;

}

if (ret < 0)

{

break;

}

m_bStartConvert = true;

m_hFileReadThread = CreateThread(NULL, 0, FileReadProc, this, 0, NULL);

m_hFileWriteThread = CreateThread(NULL, 0, FileWriteProc, this, 0, NULL);

} while (0);

return ret;

}

void CVideoConvert::StopConvert()

{

m_bStartConvert = false;

}

int CVideoConvert::OpenFile(const char *pFile)

{

int ret = -1;

do

{

if ((ret = avformat_open_input(&m_pFormatCtx_File, pFile, 0, 0)) < 0) {

printf("Could not open input file.");

break;

}

if ((ret = avformat_find_stream_info(m_pFormatCtx_File, 0)) < 0) {

printf("Failed to retrieve input stream information");

break;

}

if (m_pFormatCtx_File->nb_streams > 2)

{

break;

}

for (int i = 0; i < m_pFormatCtx_File->nb_streams; i++)

{

if (m_pFormatCtx_File->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_VIDEO)

{

m_iVideoIndex = i;

}

}

if (m_iVideoIndex == -1)

{

break;

}

ret = 0;

} while (0);

return ret;

}

int CVideoConvert::OpenOutPut(const char *pFileOut)

{

int iRet = -1;

AVStream *pVideoStream = NULL;

do

{

avformat_alloc_output_context2(&m_pFormatCtx_Out, NULL, NULL, pFileOut);

if (m_iVideoIndex != -1)

{

AVCodecID eTargetVideoCodecId = m_pFormatCtx_File->streams[m_iVideoIndex]->codecpar->codec_id;

AVCodec* pCodecEncode_Video = (AVCodec *)avcodec_find_encoder(eTargetVideoCodecId);

pVideoStream = avformat_new_stream(m_pFormatCtx_Out, pCodecEncode_Video);

if (!pVideoStream)

{

break;

}

avcodec_parameters_copy(pVideoStream->codecpar, m_pFormatCtx_File->streams[m_iVideoIndex]->codecpar);

pVideoStream->codecpar->codec_tag = 0;

}

if (!(m_pFormatCtx_Out->oformat->flags & AVFMT_NOFILE))

{

if (avio_open(&m_pFormatCtx_Out->pb, pFileOut, AVIO_FLAG_WRITE) < 0)

{

break;

}

}

if (avformat_write_header(m_pFormatCtx_Out, NULL) < 0)

{

break;

}

iRet = 0;

} while (0);

if (iRet != 0)

{

if (m_pFormatCtx_Out != NULL)

{

avformat_free_context(m_pFormatCtx_Out);

m_pFormatCtx_Out = NULL;

}

}

return iRet;

}

DWORD WINAPI CVideoConvert::FileReadProc(LPVOID lpParam)

{

CVideoConvert *pVideoConvert = (CVideoConvert *)lpParam;

if (pVideoConvert != NULL)

{

pVideoConvert->FileRead();

}

return 0;

}

void CVideoConvert::FileRead()

{

AVPacket packet = { 0 };

int ret = 0;

int iPicCount = 0;

const int genpts = m_pFormatCtx_File->flags & AVFMT_FLAG_GENPTS;

while (m_bStartConvert)

{

av_packet_unref(&packet);

ret = av_read_frame(m_pFormatCtx_File, &packet);

if (ret == AVERROR(EAGAIN))

{

continue;

}

else if (ret == AVERROR_EOF)

{

break;

}

else if (ret < 0)

{

break;

}

if (packet.stream_index == m_iVideoIndex)

{

while (1)

{

int iAudioPacketNum = m_vecReadVideo.size();

if (iAudioPacketNum >= MAX_VIDEOPACKET_NUM)

{

Sleep(10);

continue;

}

else

{

AVPacket *pAudioPacket = av_packet_clone(&packet);

if (pAudioPacket != NULL)

{

EnterCriticalSection(&m_csVideoReadSection);

m_vecReadVideo.push_back(pAudioPacket);

LeaveCriticalSection(&m_csVideoReadSection);

}

}

break;

}

}

}

//FlushVideoDecoder(iPicCount);

}

DWORD WINAPI CVideoConvert::FileWriteProc(LPVOID lpParam)

{

CVideoConvert *pVideoConvert = (CVideoConvert *)lpParam;

if (pVideoConvert != NULL)

{

pVideoConvert->FileWrite();

}

return 0;

}

void CVideoConvert::FileWrite()

{

int ret = 0;

AVPacket packet = { 0 };

int iRealPicCount = 0;

while (m_bStartConvert)

{

int iVideoSize = m_vecReadVideo.size();

if (iVideoSize > 0)

{

AVPacket *pPacketVideoA = NULL;

EnterCriticalSection(&m_csVideoReadSection);

if (!m_vecReadVideo.empty())

{

pPacketVideoA = m_vecReadVideo.front();

m_vecReadVideo.pop_front();

}

LeaveCriticalSection(&m_csVideoReadSection);

pPacketVideoA->stream_index = m_iVideoIndex;

pPacketVideoA->duration = av_rescale_q_rnd(pPacketVideoA->duration, m_pFormatCtx_File->streams[m_iVideoIndex]->time_base, m_pFormatCtx_Out->streams[m_iVideoIndex]->time_base, AVRounding(1));

if (pPacketVideoA->dts != AV_NOPTS_VALUE)

{

pPacketVideoA->dts = av_rescale_q_rnd(pPacketVideoA->dts, m_pFormatCtx_File->streams[m_iVideoIndex]->time_base, m_pFormatCtx_Out->streams[m_iVideoIndex]->time_base, AVRounding(1));

pPacketVideoA->pts = pPacketVideoA->dts;

}

else

{

pPacketVideoA->pts = pPacketVideoA->dts = m_iTotalDuration;

}

m_iTotalDuration += pPacketVideoA->duration;

//ret = av_write_frame(m_pFormatCtx_Out, pPacketVideoA);

ret = av_interleaved_write_frame(m_pFormatCtx_Out, pPacketVideoA);

av_packet_free(&pPacketVideoA);

if (ret == AVERROR(EAGAIN))

{

continue;

}

else if (ret == AVERROR_EOF)

{

break;

}

iRealPicCount++;

}

else

{

Sleep(10);

}

}

///FlushEncoder(iRealPicCount);

av_write_trailer(m_pFormatCtx_Out);

avio_close(m_pFormatCtx_Out->pb);

}

void CVideoConvert::WaitFinish()

{

int ret = 0;

do

{

if (NULL == m_hFileReadThread)

{

break;

}

WaitForSingleObject(m_hFileReadThread, INFINITE);

CloseHandle(m_hFileReadThread);

m_hFileReadThread = NULL;

while (m_vecReadVideo.size() > 0)

{

Sleep(1000);

}

m_bStartConvert = false;

WaitForSingleObject(m_hFileWriteThread, INFINITE);

CloseHandle(m_hFileWriteThread);

m_hFileWriteThread = NULL;

} while (0);

}

我有一个Ruby程序,它使用rubyzip压缩XML文件的目录树。gem。我的问题是文件开始变得很重,我想提高压缩级别,因为压缩时间不是问题。我在rubyzipdocumentation中找不到一种为创建的ZIP文件指定压缩级别的方法。有人知道如何更改此设置吗?是否有另一个允许指定压缩级别的Ruby库? 最佳答案 这是我通过查看rubyzip内部创建的代码。level=Zlib::BEST_COMPRESSIONZip::ZipOutputStream.open(zip_file)do|zip|Dir.glob("**/*")d

我试图在一个项目中使用rake,如果我把所有东西都放到Rakefile中,它会很大并且很难读取/找到东西,所以我试着将每个命名空间放在lib/rake中它自己的文件中,我添加了这个到我的rake文件的顶部:Dir['#{File.dirname(__FILE__)}/lib/rake/*.rake'].map{|f|requiref}它加载文件没问题,但没有任务。我现在只有一个.rake文件作为测试,名为“servers.rake”,它看起来像这样:namespace:serverdotask:testdoputs"test"endend所以当我运行rakeserver:testid时

我的目标是转换表单输入,例如“100兆字节”或“1GB”,并将其转换为我可以存储在数据库中的文件大小(以千字节为单位)。目前,我有这个:defquota_convert@regex=/([0-9]+)(.*)s/@sizes=%w{kilobytemegabytegigabyte}m=self.quota.match(@regex)if@sizes.include?m[2]eval("self.quota=#{m[1]}.#{m[2]}")endend这有效,但前提是输入是倍数(“gigabytes”,而不是“gigabyte”)并且由于使用了eval看起来疯狂不安全。所以,功能正常,

Rails2.3可以选择随时使用RouteSet#add_configuration_file添加更多路由。是否可以在Rails3项目中做同样的事情? 最佳答案 在config/application.rb中:config.paths.config.routes在Rails3.2(也可能是Rails3.1)中,使用:config.paths["config/routes"] 关于ruby-on-rails-Rails3中的多个路由文件,我们在StackOverflow上找到一个类似的问题

对于具有离线功能的智能手机应用程序,我正在为Xml文件创建单向文本同步。我希望我的服务器将增量/差异(例如GNU差异补丁)发送到目标设备。这是计划:Time=0Server:hasversion_1ofXmlfile(~800kiB)Client:hasversion_1ofXmlfile(~800kiB)Time=1Server:hasversion_1andversion_2ofXmlfile(each~800kiB)computesdeltaoftheseversions(=patch)(~10kiB)sendspatchtoClient(~10kiBtransferred)Cl

我正在寻找执行以下操作的正确语法(在Perl、Shell或Ruby中):#variabletoaccessthedatalinesappendedasafileEND_OF_SCRIPT_MARKERrawdatastartshereanditcontinues. 最佳答案 Perl用__DATA__做这个:#!/usr/bin/perlusestrict;usewarnings;while(){print;}__DATA__Texttoprintgoeshere 关于ruby-如何将脚

使用带有Rails插件的vim,您可以创建一个迁移文件,然后一次性打开该文件吗?textmate也可以这样吗? 最佳答案 你可以使用rails.vim然后做类似的事情::Rgeneratemigratonadd_foo_to_bar插件将打开迁移生成的文件,这正是您想要的。我不能代表textmate。 关于ruby-使用VimRails,您可以创建一个新的迁移文件并一次性打开它吗?,我们在StackOverflow上找到一个类似的问题: https://sta

好的,所以我的目标是轻松地将一些数据保存到磁盘以备后用。您如何简单地写入然后读取一个对象?所以如果我有一个简单的类classCattr_accessor:a,:bdefinitialize(a,b)@a,@b=a,bendend所以如果我从中非常快地制作一个objobj=C.new("foo","bar")#justgaveitsomerandomvalues然后我可以把它变成一个kindaidstring=obj.to_s#whichreturns""我终于可以将此字符串打印到文件或其他内容中。我的问题是,我该如何再次将这个id变回一个对象?我知道我可以自己挑选信息并制作一个接受该信

我正在编写一个小脚本来定位aws存储桶中的特定文件,并创建一个临时验证的url以发送给同事。(理想情况下,这将创建类似于在控制台上右键单击存储桶中的文件并复制链接地址的结果)。我研究过回形针,它似乎不符合这个标准,但我可能只是不知道它的全部功能。我尝试了以下方法:defauthenticated_url(file_name,bucket)AWS::S3::S3Object.url_for(file_name,bucket,:secure=>true,:expires=>20*60)end产生这种类型的结果:...-1.amazonaws.com/file_path/file.zip.A

我注意到像bundler这样的项目在每个specfile中执行requirespec_helper我还注意到rspec使用选项--require,它允许您在引导rspec时要求一个文件。您还可以将其添加到.rspec文件中,因此只要您运行不带参数的rspec就会添加它。使用上述方法有什么缺点可以解释为什么像bundler这样的项目选择在每个规范文件中都需要spec_helper吗? 最佳答案 我不在Bundler上工作,所以我不能直接谈论他们的做法。并非所有项目都checkin.rspec文件。原因是这个文件,通常按照当前的惯例,只