目录

Hello!

非常感谢您阅读海轰的文章,倘若文中有错误的地方,欢迎您指出~

ଘ(੭ˊᵕˋ)੭

昵称:海轰

标签:程序猿|C++选手|学生

简介:因C语言结识编程,随后转入计算机专业,获得过国家奖学金,有幸在竞赛中拿过一些国奖、省奖…已保研

学习经验:扎实基础 + 多做笔记 + 多敲代码 + 多思考 + 学好英语!

唯有努力💪

本文仅记录自己感兴趣的内容

torch.matmul(input, other, *, out=None) → Tensor

两个张量的矩阵乘积

行为取决于张量的维度,如下所示:

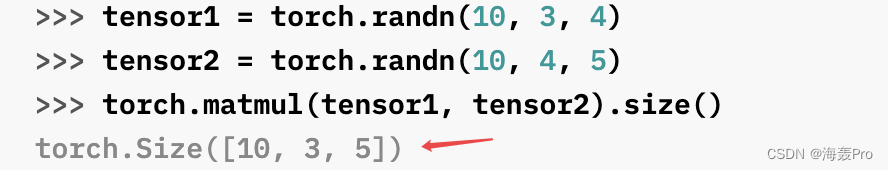

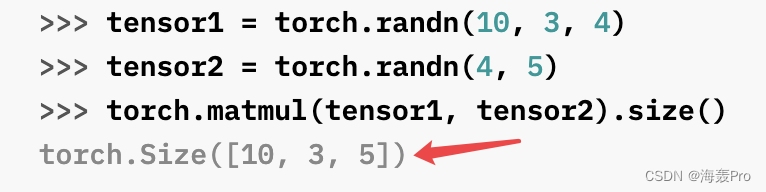

请注意,广播逻辑在确定输入是否可广播时仅查看批处理维度,而不是矩阵维度

例如

该运算符支持 TensorFloat32。

在某些 ROCm 设备上,当使用 float16 输入时,此模块将使用不同的向后精度

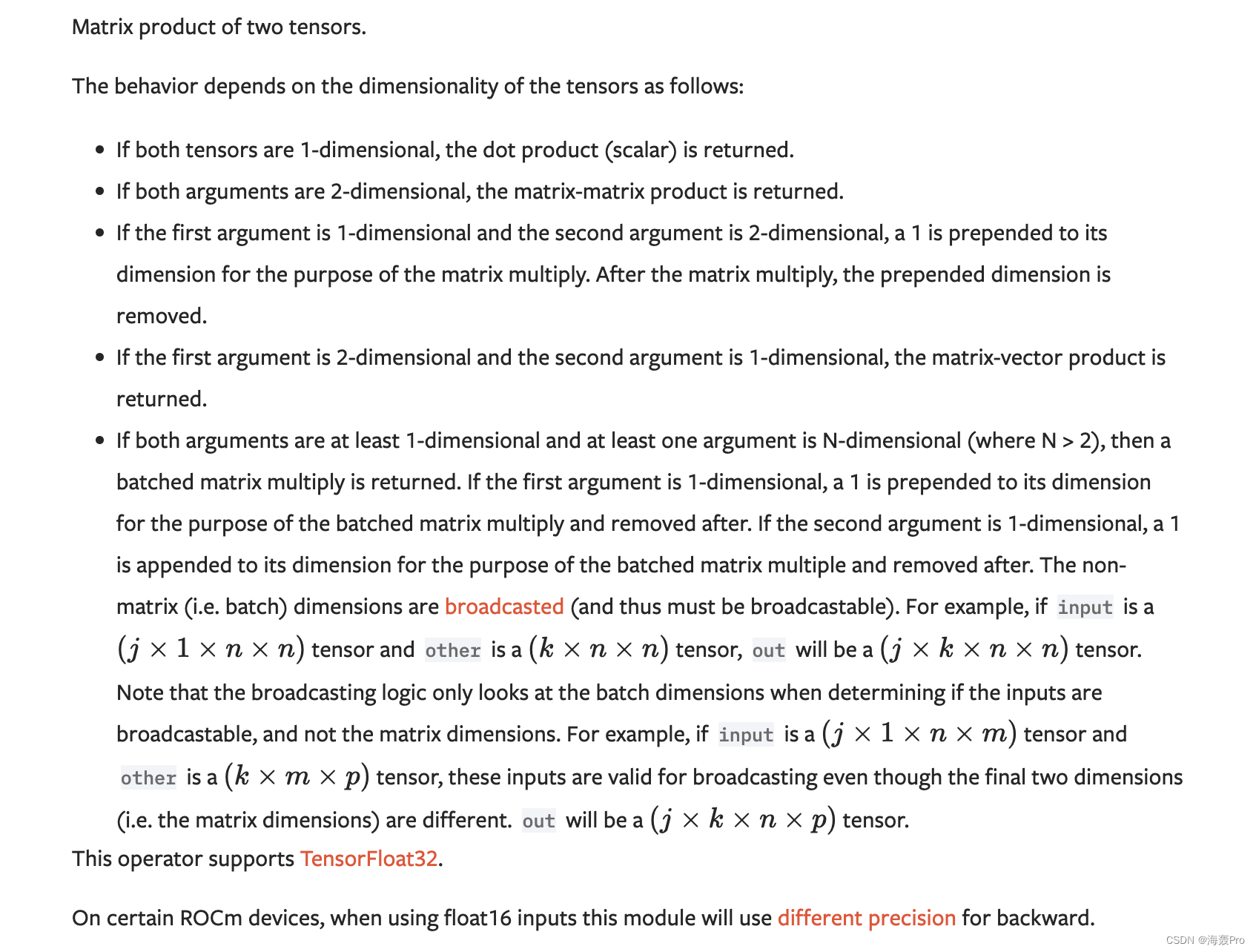

如果两个张量都是一维的,则返回点积(标量)

tensor1 = torch.Tensor([1,2,3])

tensor2 =torch.Tensor([4,5,6])

ans = torch.matmul(tensor1, tensor2)

print('tensor1 : ', tensor1)

print('tensor2 : ', tensor2)

print('ans :', ans)

print('ans.size :', ans.size())

ans = 1 * 4 + 2 * 5 + 3 * 6 = 32

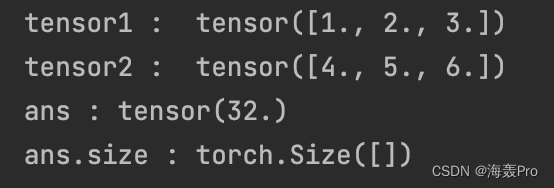

如果两个参数都是二维的,则返回矩阵-矩阵乘积

也就是 正常的矩阵乘法 (m * n) * (n * k) = (m * k)

tensor1 = torch.Tensor([[1,2,3],[1,2,3]])

tensor2 =torch.Tensor([[4,5],[4,5],[4,5]])

ans = torch.matmul(tensor1, tensor2)

print('tensor1 : ', tensor1)

print('tensor2 : ', tensor2)

print('ans :', ans)

print('ans.size :', ans.size())

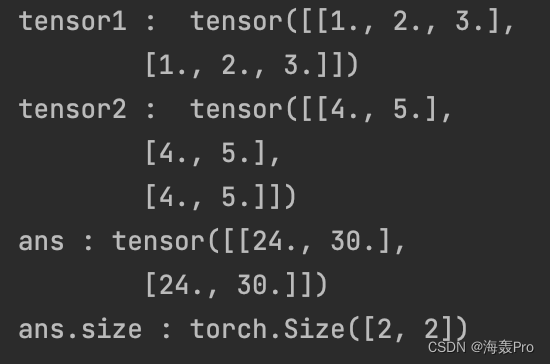

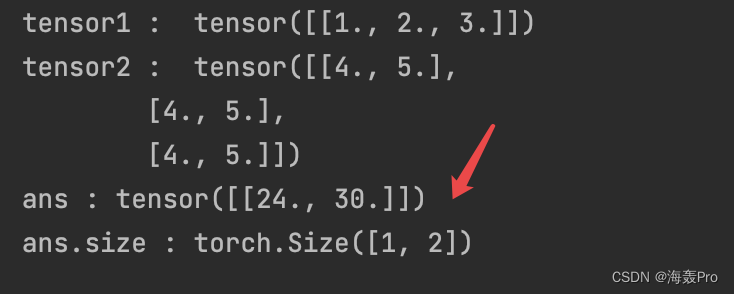

如果第一个参数是一维的,第二个参数是二维的,为了矩阵乘法的目的,在它的维数前面加上一个 1

在矩阵相乘之后,前置维度被移除

tensor1 = torch.Tensor([1,2,3]) # 注意这里是一维

tensor2 =torch.Tensor([[4,5],[4,5],[4,5]])

ans = torch.matmul(tensor1, tensor2)

print('tensor1 : ', tensor1)

print('tensor2 : ', tensor2)

print('ans :', ans)

print('ans.size :', ans.size())

tensor1 = torch.Tensor([1,2,3]) 修改为 tensor1 = torch.Tensor([[1,2,3]])

发现一个结果是[24., 30.] 一个是[[24., 30.]]

所以,当一维 * 二维时, 开始变成 1 * m(一维的维度),也就是一个二维, 再进行正常的矩阵运算,得到[[24., 30.]], 然后再去掉开始增加的一个维度,得到[24., 30.]

想象为二维 * 二维(前置维度为1),最后结果去掉一个维度即可

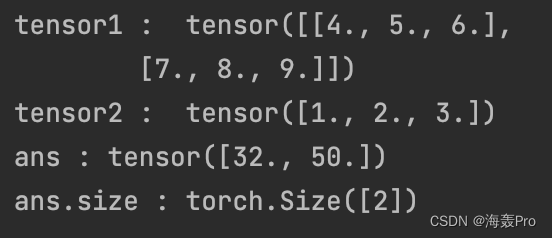

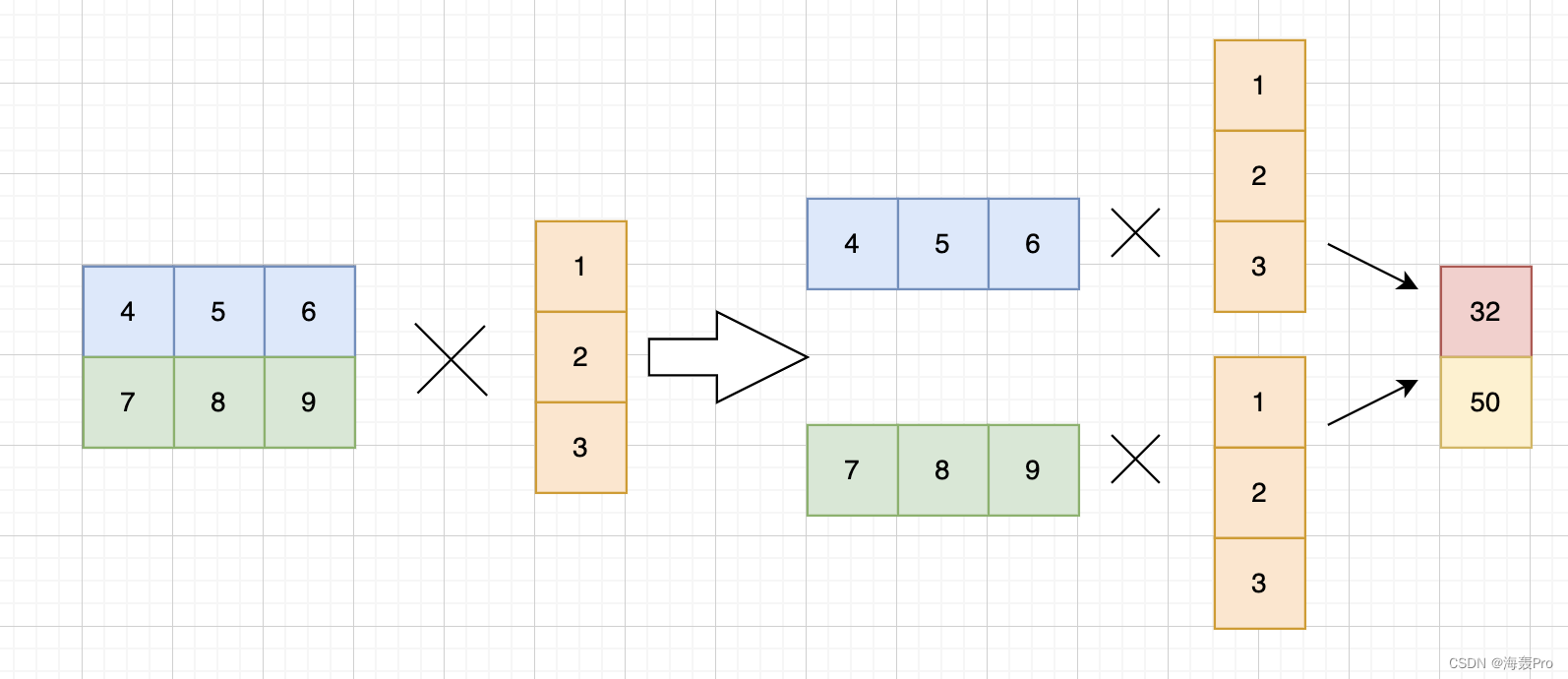

如果第一个参数是二维的,第二个参数是一维的,则返回矩阵向量积

tensor1 =torch.Tensor([[4,5,6],[7,8,9]])

tensor2 = torch.Tensor([1,2,3])

ans = torch.matmul(tensor1, tensor2)

print('tensor1 : ', tensor1)

print('tensor2 : ', tensor2)

print('ans :', ans)

print('ans.size :', ans.size())

理解为:

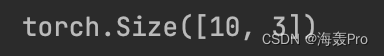

tensor1 = torch.randn(10, 3, 4)

tensor2 = torch.randn(4)

print(torch.matmul(tensor1, tensor2).size())

(4) 先添加一个维度 (4 * 1)

得到(10 * 3 * 4) *( 4 * 1) = (10 * 3 * 1)

再删除最后一个维度(添加的那个)

得到结果(10 * 3)

tensor1 = torch.randn(10,2, 3, 4) #

tensor2 = torch.randn(4)

print(torch.matmul(tensor1, tensor2).size())

(10 * 2 * 3 * 4) * (4 * 1) = (10 * 2 * 3) 【抵消4,删1】

tensor1 = torch.randn(4)

tensor2 = torch.randn(10, 4, 3)

print(torch.matmul(tensor1, tensor2).size())

tensor2 中第一个10理解为批次, 10个(4 * 3)

(1 * 4)与每个(4 * 3) 相乘得到(1,3),去除1,得到(3)

批次为10,得到(10,3)

tensor1 = torch.randn(4)

tensor2 = torch.randn(10,2, 4, 3)

print(torch.matmul(tensor1, tensor2).size())

这里批次理解为[10, 2]即可

tensor1 = torch.randn(4)

tensor2 = torch.randn(10,4, 2,4,1)

print(torch.matmul(tensor1, tensor2).size())

个人理解:当一个参数为一维时,它要去匹配另一个参数的最后两个维度(二维 * 二维)

比如上面的例子就是(1 * 4) 匹配 (4,1), 批次为(10,4,2)

注:这不太好理解 … 感觉就是要找准批次,再进行乘法(靠感觉了 哈哈 离谱)

文章仅作为个人学习笔记记录,记录从0到1的一个过程

希望对您有一点点帮助,如有错误欢迎小伙伴指正

最近在矩池云的的TeslaK80机子上跑MMYOLO,跟着MMYOLO官方文档《自定义数据集标注+训练+测试+部署全流程》操作到“2.1.1软件或者算法辅助”时,利用预训练模型+官方脚本去辅助标注时,一按下回车就报错:报错信息AssertionErrorTorchnotcompiledwithCUDAenabled报错信息分析说的是torch编译的时候CUDA不可用但是服务器已经预装有pytorch和cuda了,我分别用nvidia-smi和nvcc-V都可以查到CUDA的版本本机配置如下:但是我在ipython中查看torch.cuda.is_available()返回结果是false,报错

Anaconda+PyCharm+PyTorch(GPU)+虚拟环境声明一、安装Anaconda二、安装PyCharm三、创建虚拟环境并安装PyTorch四、关联虚拟环境五、致谢声明感谢姜小敏同学对我的支持、鼓励和鞭策!默认你的电脑上已经装有GPU,如果没有GPU,可以正常的进行各种下载安装操作,但是最终结果会有所不同。一、安装Anaconda首先,进入Anaconda官网,单击Download按钮,稍微等待即可下载安装包。下载好之后,双击打开安装包,进行一系列安装操作。建议安装路径全英文,并且一定要记住安装地址。此处不勾选第二项,因此之后需要人为配置环境变量。没啥用,不用勾选,就是跳出两个打

目录简介torch.nn.init.xavier_uniform_()语法作用举例参考结语简介Hello!非常感谢您阅读海轰的文章,倘若文中有错误的地方,欢迎您指出~ ଘ(੭ˊᵕˋ)੭昵称:海轰标签:程序猿|C++选手|学生简介:因C语言结识编程,随后转入计算机专业,获得过国家奖学金,有幸在竞赛中拿过一些国奖、省奖…已保研学习经验:扎实基础+多做笔记+多敲代码+多思考+学好英语! 唯有努力💪 本文仅记录自己感兴趣的内容torch.nn.init.xavier_uniform_()语法torch.nn.init.xavier_uniform_(tensor,gain=1.0)作用根据了解训练深度

一、报错信息之前写代码时碰到了这样一个错误:RuntimeError:Expectedtohavefinishedreductionintheprioriterationbeforestartinganewone.Thiserrorindicatesthatyourmodulehasparametersthatwerenotusedinproducingloss.Youcanenableunusedparameterdetectionby(1)passingthekeywordargumentfind_unused_parameters=Truetotorch.nn.parallel.Dist

前言本项目使用了EcapaTdnn模型实现的声纹识别,不排除以后会支持更多模型,同时本项目也支持了多种数据预处理方法,损失函数参考了人脸识别项目的做法PaddlePaddle-MobileFaceNets,使用了ArcFaceLoss,ArcFaceloss:AdditiveAngularMarginLoss(加性角度间隔损失函数),对特征向量和权重归一化,对θ加上角度间隔m,角度间隔比余弦间隔在对角度的影响更加直接。源码地址:VoiceprintRecognition-Pytorch(V1)使用环境:Python3.7PaddlePaddle1.10.2模型下载模型预处理方法数据集类别数量分

关闭。这个问题需要debuggingdetails.它目前不接受答案。编辑问题以包含desiredbehavior,aspecificproblemorerror,andtheshortestcodenecessarytoreproducetheproblem.这将有助于其他人回答问题。关闭3年前。Improvethisquestion问题:给定一个非重复正整数数组,表示“n”个人的穿越时间。这n个人站在桥的一侧。Bridge一次最多可容纳两个人。当两个人过桥时,他们必须以较慢的人的速度移动。找出所有人可以过桥的最短总时间。我无法找到关于如何针对“n”个人进行缩放的模式。但不知何故,我

pytorch1.13安装,个人参考情况交代安装流程注意事项显卡配置查看创建环境激活环境安装对应的torch版本检查使用piplist导入查看卸载下载gpu版本的验证把这个内核加到jupyter完成情况交代显卡3060,cuda版本12.0已有一个虚拟环境安装了cuda11.2和cudnn8.1.0以及对应的tensorflow现在需要创建一个可以使用GPU加速的pytorch环境安装流程注意事项pytorch自身是带了cuda环境的,所以不需要强制要求和之前tensorflow那个环境一致torch1.13.0不支持cuda10.2和11.3版本了显卡配置查看nvidia-smi+-----

【人工智能概论】PyTorch可视化工具Tensorboard安装与简单使用文章目录【人工智能概论】PyTorch可视化工具Tensorboard安装与简单使用一.安装Tensorboard1.1安装Tensorboard1.2验证安装二.Tensorboard功能简介一.安装Tensorboard1.1安装TensorboardTensorboard原本是Tensorflow的可视化工具,但自PyTorch1.2.0版本开始,PyTorch正式内置Tensorboard的支持,尽管如此仍需手动安装Tensorboard。否则会报错。ModuleNotFoundError:Nomodulena

Pytorch是目前最火的深度学习框架之一,另一个是TensorFlow。不过我之前一直用到是CPU版本,几个月前买了一台3070Ti的笔记本(是的,我在40系显卡出来的时候,买了30系,这确实一言难尽),同时我也有一台M1芯片MacbookPro,目前也支持了pytorch的GPU加速,所以我就想着,在这两个电脑上装个Pytorch,浅度学习深度学习。Applesilicon首先是M1芯片,这个就特别简单了。先装一个conda,只不过是内置mamba包管理器,添加conda-forge频道,arm64版本。#下载wgethttps://github.com/conda-forge/minif

PyTorch官方安装方法下载太慢,直接用pip和conda命令安装,因为网络速度太慢,导致下载失败的解决的办法。 最近在新的电脑上安装pytorch环境,由于网速太慢,你懂的,外网速度就是慢。 即使是更科学的上网以后,速度仍然感人,多次失败。 想要离线安装pytorch,于是在网上搜索了很多方法,都不太好用,刚觉有点复杂。不过有些方法的某些操作有参考价值。 最后,结合别人的方法,我自己总结了一个简便解决的办法。第一步: 打开pytorch的官方网站,找到官方安装方法的位置,找出官方包所在的网址。 图上画绿色线条的位置就是安装包的下载地址。第二步: