AudioRecord类优点是能录制到缓冲区,能够实现边录边播(AudioRecord + AudioTrack)以及对音频的实时处理(如QQ电话)。缺点是输出是PCM格式的原始采集数据,如果直接保存成音频文件,不能够被播放器播放,所以必须用代码实现数据编码以及压缩。

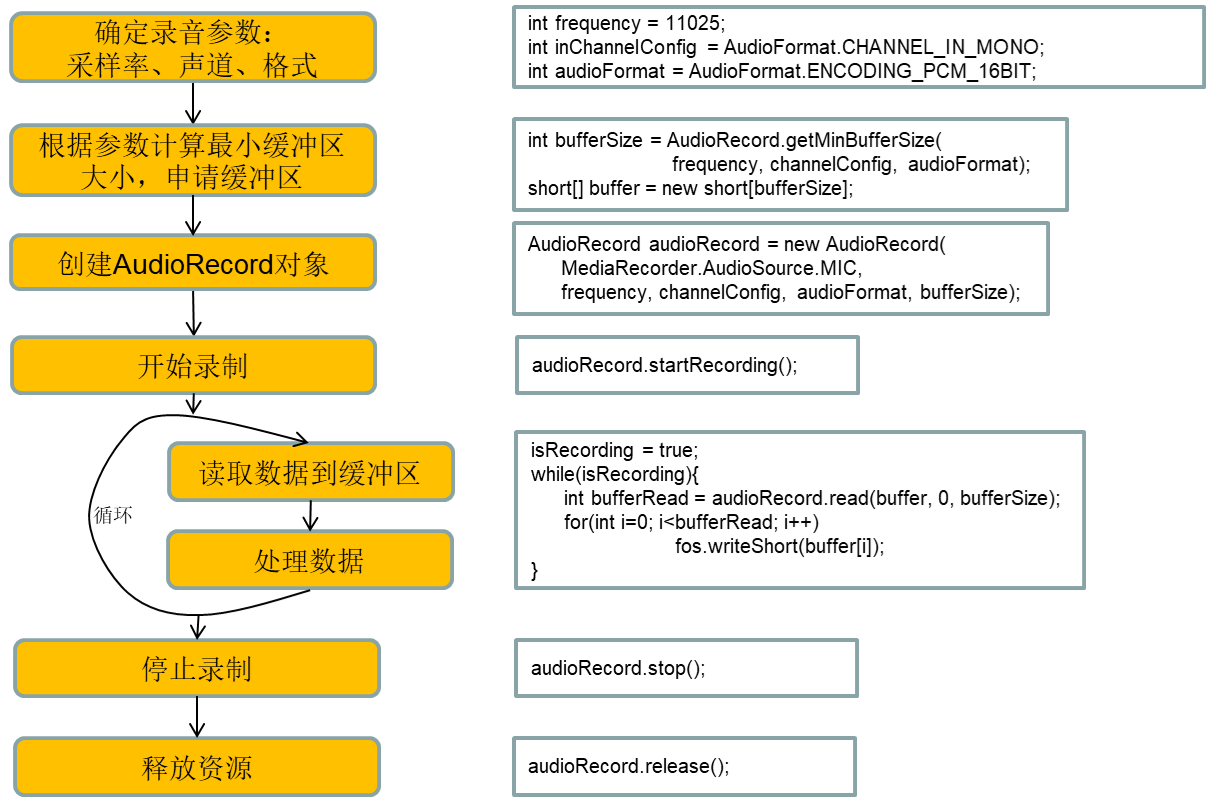

使用AudioRecord录音的基本步骤是:确定录音参数、申请缓冲区、创建AudioRecord对象、开始录制、循环读取数据到缓冲区并处理数据、停止录制、释放资源。

需要确定的录音参数包括:采样率、声道、格式。申请缓冲区时需要根据录音参数计算最小缓冲区大小。有了缓冲区以后才能创建AudioRecord对象。录制过程中,需要不停地读取采样到的音频数据,并进行处理。流程和对应的代码如下图:

下面编写一个例子,用AudioRecord采集音频数据,并以原始PCM格式存入文件。读取数据和处理数据是需要循环进行的操作,所以放入单独线程执行。例子运行在Android8.0以上。

例子界面和主要代码如下:

因为要录音,所以在配置文件里需要声明录音权限。同时,Android将文件写入应用在外部存储上的私有目录不需要再申请读写存储的权限。

<uses-permission android:name="android.permission.RECORD_AUDIO" />

同时,使用AudioRecord录音需要动态申请权限,即在实际录音时需要检查用户是否允许应用使用录音权限。如果没有允许,就弹出一个对话框询问用户。代码如下:

if (ActivityCompat.checkSelfPermission(this, Manifest.permission.RECORD_AUDIO) != PackageManager.PERMISSION_GRANTED) {

ActivityCompat.requestPermissions(this, new String[]{Manifest.permission.RECORD_AUDIO}, 1);

return;

}这里用到的AudioRecord类的主要方法有:

1)构造函数:AudioRecord(int audioSource, int sampleRateInHz, int channelConfig, int audioFormat, int bufferSizeInBytes)

2)static int getMinBufferSize(int sampleRateInHz, int channelConfig, int audioFormat):计算最小缓冲区大小,参数同构造函数中三个参数。

3)从硬件读取音频数据保存到缓冲区有三个方法,都返回读取的数据个数

4)void startRecording():开始录制

5)void stop():停止录制

6)void release():释放资源

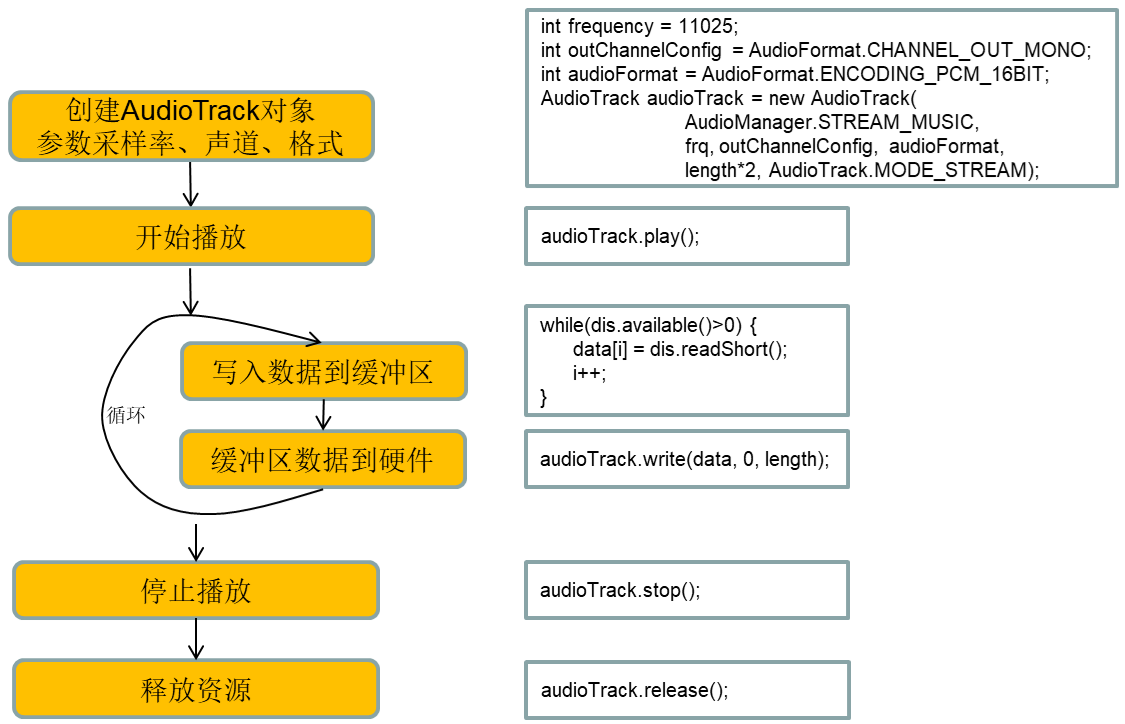

从AudioRecord读取的数据是PCM格式,可以用AudioTrack类播放。用AudioTrack类播放音频的基本流程是:创建AudioTrack对象、开始播放、循环写入数据到缓冲区、停止播放、释放资源。创建AudioTrack对象时需给出参数:采样率、声道、格式。流程和对应的代码如下图:

下面就为前面的例子加上播放音频的功能。用AudioTrack播放AudioRecord录制的PCM音频文件时需要注意:写入数据后不能马上release,因为播放是异步的,此时还刚开始播放,一旦release就不播放了。用AudioTrack还可以实现变音效果:以采样率a录制,以采样率b播放。主要代码如下:

AudioTrack类的主要方法有:

1)构造函数:AudioTrack(int streamType, int sampleRateInHz, int channelConfig, int audioFormat, int bufferSizeInBytes, int mode)

2)void play() :开始播放

3)写入音频数据到硬件有两个方法,返回成功写入的数据个数

4)void stop() :停止播放

5)void pause():暂停播放

6)void release():释放资源

例子的完整代码如下:

import androidx.appcompat.app.AppCompatActivity;

import androidx.core.app.ActivityCompat;

import android.Manifest;

import android.content.pm.PackageManager;

import android.media.AudioFormat;

import android.media.AudioManager;

import android.media.AudioRecord;

import android.media.AudioTrack;

import android.media.MediaRecorder;

import android.os.Bundle;

import android.view.MotionEvent;

import android.view.View;

import android.widget.*;

import java.io.*;

public class MainActivity extends AppCompatActivity {

File soundFile; // 存放录音的文件

boolean isRecording;

int frequency = 11025;

int inChannelConfig = AudioFormat.CHANNEL_IN_MONO;

int outChannelConfig = AudioFormat.CHANNEL_OUT_MONO;

int audioFormat = AudioFormat.ENCODING_PCM_16BIT;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

LinearLayout ll = new LinearLayout(this);

ll.setOrientation(LinearLayout.VERTICAL);

setContentView(ll);

// 录制到文件:Android/data/<package-name>/files/audioRecord.pcm

soundFile = new File(getExternalFilesDir(null), "audioRecord.pcm");

Button btnRecord = new Button(this);

btnRecord.setText("Record");

ll.addView(btnRecord);

btnRecord.setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View arg0) {

Thread t = new Thread() {

public void run() {

try {

record();

} catch (IOException e) {

e.printStackTrace();

}

}

};

t.start();

}

});

Button btnStop = new Button(this);

btnStop.setText("Stop");

ll.addView(btnStop);

btnStop.setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View arg0) {

isRecording = false;

}

});

Button btnPlay = new Button(this);

btnPlay.setText("Play");

ll.addView(btnPlay);

btnPlay.setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View arg0) {

if (soundFile.exists()) {

try {

play(frequency);

} catch (IOException e) {

e.printStackTrace();

}

}

}

});

Button btnPlayFast = new Button(this);

btnPlayFast.setText("Play Fast");

ll.addView(btnPlayFast);

btnPlayFast.setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View arg0) {

if (soundFile.exists()) {

try {

play(frequency * 4 / 3);

} catch (IOException e) {

e.printStackTrace();

}

}

}

});

Button btnPlaySlow = new Button(this);

btnPlaySlow.setText("Play Slow");

ll.addView(btnPlaySlow);

btnPlaySlow.setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View arg0) {

if (soundFile.exists()) {

try {

play(frequency * 3 / 4);

} catch (IOException e) {

e.printStackTrace();

}

}

}

});

Button btnSpeak = new Button(this);

btnSpeak.setText("Press to Speak");

ll.addView(btnSpeak);

btnSpeak.setOnTouchListener(new View.OnTouchListener() {

@Override

public boolean onTouch(View arg0, MotionEvent arg1) {

switch (arg1.getAction()) {

case MotionEvent.ACTION_DOWN:

Thread t = new Thread() {

public void run() {

try {

record();

} catch (IOException e) {

e.printStackTrace();

}

}

};

t.start();

break;

case MotionEvent.ACTION_UP:

isRecording = false;

break;

}

return false;

}

});

}

void record() throws IOException {

// 动态权限申请

if (ActivityCompat.checkSelfPermission(this, Manifest.permission.RECORD_AUDIO) != PackageManager.PERMISSION_GRANTED) {

ActivityCompat.requestPermissions(this, new String[]{Manifest.permission.RECORD_AUDIO}, 1);

return;

}

if (soundFile.exists()) soundFile.delete();

soundFile.createNewFile();

FileOutputStream fos = new FileOutputStream(soundFile);

BufferedOutputStream bos = new BufferedOutputStream(fos);

DataOutputStream dos = new DataOutputStream(bos);

int bufferSize = AudioRecord.getMinBufferSize(frequency, inChannelConfig, audioFormat);

short[] buffer = new short[bufferSize];

AudioRecord audioRecord = new AudioRecord(MediaRecorder.AudioSource.MIC, frequency, inChannelConfig, audioFormat, bufferSize);

audioRecord.startRecording();

isRecording = true;

while(isRecording){

int bufferRead = audioRecord.read(buffer, 0, bufferSize);

for(int i=0; i<bufferRead; i++){

dos.writeShort(buffer[i]);

}

}

audioRecord.stop();

audioRecord.release();

dos.close();

bos.close();

fos.close();

}

void play(int frq) throws IOException{

int length = (int)soundFile.length()/2;

if(!soundFile.exists() || length==0) {

Toast.makeText(getBaseContext(), "音频文件不存在或为空", Toast.LENGTH_SHORT).show();

return;

}

short[] data = new short[length];

FileInputStream fis = new FileInputStream(soundFile);

BufferedInputStream bis = new BufferedInputStream(fis);

DataInputStream dis = new DataInputStream(bis);

int i=0;

while(dis.available()>0) {

data[i] = dis.readShort();

i++;

}

dis.close();

bis.close();

fis.close();

AudioTrack audioTrack = new AudioTrack(AudioManager.STREAM_MUSIC, frq, outChannelConfig, audioFormat, length*2, AudioTrack.MODE_STREAM);

audioTrack.play();

audioTrack.write(data, 0, length);

audioTrack.stop();

//audioTrack.release(); // 不能马上release,因为write后是异步播放,此时还刚开始播放,release就不播放了

}

}我正在学习如何使用Nokogiri,根据这段代码我遇到了一些问题:require'rubygems'require'mechanize'post_agent=WWW::Mechanize.newpost_page=post_agent.get('http://www.vbulletin.org/forum/showthread.php?t=230708')puts"\nabsolutepathwithtbodygivesnil"putspost_page.parser.xpath('/html/body/div/div/div/div/div/table/tbody/tr/td/div

我有一个Ruby程序,它使用rubyzip压缩XML文件的目录树。gem。我的问题是文件开始变得很重,我想提高压缩级别,因为压缩时间不是问题。我在rubyzipdocumentation中找不到一种为创建的ZIP文件指定压缩级别的方法。有人知道如何更改此设置吗?是否有另一个允许指定压缩级别的Ruby库? 最佳答案 这是我通过查看rubyzip内部创建的代码。level=Zlib::BEST_COMPRESSIONZip::ZipOutputStream.open(zip_file)do|zip|Dir.glob("**/*")d

类classAprivatedeffooputs:fooendpublicdefbarputs:barendprivatedefzimputs:zimendprotecteddefdibputs:dibendendA的实例a=A.new测试a.foorescueputs:faila.barrescueputs:faila.zimrescueputs:faila.dibrescueputs:faila.gazrescueputs:fail测试输出failbarfailfailfail.发送测试[:foo,:bar,:zim,:dib,:gaz].each{|m|a.send(m)resc

很好奇,就使用rubyonrails自动化单元测试而言,你们正在做什么?您是否创建了一个脚本来在cron中运行rake作业并将结果邮寄给您?git中的预提交Hook?只是手动调用?我完全理解测试,但想知道在错误发生之前捕获错误的最佳实践是什么。让我们理所当然地认为测试本身是完美无缺的,并且可以正常工作。下一步是什么以确保他们在正确的时间将可能有害的结果传达给您? 最佳答案 不确定您到底想听什么,但是有几个级别的自动代码库控制:在处理某项功能时,您可以使用类似autotest的内容获得关于哪些有效,哪些无效的即时反馈。要确保您的提

假设我做了一个模块如下:m=Module.newdoclassCendend三个问题:除了对m的引用之外,还有什么方法可以访问C和m中的其他内容?我可以在创建匿名模块后为其命名吗(就像我输入“module...”一样)?如何在使用完匿名模块后将其删除,使其定义的常量不再存在? 最佳答案 三个答案:是的,使用ObjectSpace.此代码使c引用你的类(class)C不引用m:c=nilObjectSpace.each_object{|obj|c=objif(Class===objandobj.name=~/::C$/)}当然这取决于

我正在尝试使用ruby和Savon来使用网络服务。测试服务为http://www.webservicex.net/WS/WSDetails.aspx?WSID=9&CATID=2require'rubygems'require'savon'client=Savon::Client.new"http://www.webservicex.net/stockquote.asmx?WSDL"client.get_quotedo|soap|soap.body={:symbol=>"AAPL"}end返回SOAP异常。检查soap信封,在我看来soap请求没有正确的命名空间。任何人都可以建议我

关闭。这个问题是opinion-based.它目前不接受答案。想要改进这个问题?更新问题,以便editingthispost可以用事实和引用来回答它.关闭4年前。Improvethisquestion我想在固定时间创建一系列低音和高音调的哔哔声。例如:在150毫秒时发出高音调的蜂鸣声在151毫秒时发出低音调的蜂鸣声200毫秒时发出低音调的蜂鸣声250毫秒的高音调蜂鸣声有没有办法在Ruby或Python中做到这一点?我真的不在乎输出编码是什么(.wav、.mp3、.ogg等等),但我确实想创建一个输出文件。

我在我的项目目录中完成了compasscreate.和compassinitrails。几个问题:我已将我的.sass文件放在public/stylesheets中。这是放置它们的正确位置吗?当我运行compasswatch时,它不会自动编译这些.sass文件。我必须手动指定文件:compasswatchpublic/stylesheets/myfile.sass等。如何让它自动运行?文件ie.css、print.css和screen.css已放在stylesheets/compiled。如何在编译后不让它们重新出现的情况下删除它们?我自己编译的.sass文件编译成compiled/t

我想将html转换为纯文本。不过,我不想只删除标签,我想智能地保留尽可能多的格式。为插入换行符标签,检测段落并格式化它们等。输入非常简单,通常是格式良好的html(不是整个文档,只是一堆内容,通常没有anchor或图像)。我可以将几个正则表达式放在一起,让我达到80%,但我认为可能有一些现有的解决方案更智能。 最佳答案 首先,不要尝试为此使用正则表达式。很有可能你会想出一个脆弱/脆弱的解决方案,它会随着HTML的变化而崩溃,或者很难管理和维护。您可以使用Nokogiri快速解析HTML并提取文本:require'nokogiri'h

我想为Heroku构建一个Rails3应用程序。他们使用Postgres作为他们的数据库,所以我通过MacPorts安装了postgres9.0。现在我需要一个postgresgem并且共识是出于性能原因你想要pggem。但是我对我得到的错误感到非常困惑当我尝试在rvm下通过geminstall安装pg时。我已经非常明确地指定了所有postgres目录的位置可以找到但仍然无法完成安装:$envARCHFLAGS='-archx86_64'geminstallpg--\--with-pg-config=/opt/local/var/db/postgresql90/defaultdb/po