<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-elasticsearch</artifactId>

<exclusions>

<exclusion>

<artifactId>jakarta.json-api</artifactId>

<groupId>jakarta.json</groupId>

</exclusion>

</exclusions>

</dependency># es 配置

spring.data.elasticsearch.cluster-name=es-cluster

spring.data.elasticsearch.cluster-nodes=192.xx.xx.xx:9200

spring.data.elasticsearch.username=xx

spring.data.elasticsearch.password=xx1、ElasticsearchTemplete配置,在es 7.x后被替换

@Configuration

public class ElasticsearchClientConfig extends ElasticsearchConfiguration {

@Value("${spring.data.elasticsearch.cluster-name}")

private String clusterName;

@Value("${spring.data.elasticsearch.cluster-nodes}")

private String clusterNodes;

@Value("${spring.data.elasticsearch.username}")

private String username;

@Value("${spring.data.elasticsearch.password}")

private String password;

@Override

public ClientConfiguration clientConfiguration() {

return ClientConfiguration.builder().connectedTo(clusterNodes).withBasicAuth(username, password).build();

}

}

2、ElasticsearchRestTemplete

@Configuration

public class ElasticsearchRestClientConfig extends AbstractElasticsearchConfiguration {

@Value("${spring.data.elasticsearch.cluster-name}")

private String clusterName;

@Value("${spring.data.elasticsearch.cluster-nodes}")

private String clusterNodes;

@Value("${spring.data.elasticsearch.username}")

private String username;

@Value("${spring.data.elasticsearch.password}")

private String password;

@Override

public RestHighLevelClient elasticsearchClient() {

ClientConfiguration build = ClientConfiguration

.builder()

.connectedTo(clusterNodes)

.withBasicAuth(username, password)

.build();

return RestClients.create(build).rest();

}

}

@Document(indexName = "docker_log")

@Data

public class DockerLogEs extends EsBaseEntity{

/**

* 应用APPID

*/

private String appId;

/**

* 请求的密码服务接口名称

*/

private String api;

/**

* 请求的结果日志

*/

@Field(type = FieldType.Text)

private String result;

/**

* docker实例id

*/

private String dockerInstanceId;

}

@Data

public class EsBaseEntity {

@Id

@GeneratedValue(generator = "uuid")

@GenericGenerator(name = "uuid", strategy = "uuid")

private String id;

/**

* analyzer: 用来指定使用哪种分词器

*/

@Field(type = FieldType.Date, format = DateFormat.custom, pattern = "yyyy-MM-dd HH:mm:ss || yyyy-MM-dd'T'HH:mm:ss.000'z' || yyyy-MM-dd || yyyy/MM/dd HH:mm:ss|| yyyy/MM/dd ||epoch_millis")

private Date createTime = new Date();

@Field(type = FieldType.Date, format = DateFormat.custom, pattern = "yyyy-MM-dd HH:mm:ss || yyyy-MM-dd'T'HH:mm:ss.000'z' || yyyy-MM-dd || yyyy/MM/dd HH:mm:ss|| yyyy/MM/dd ||epoch_millis")

private Date modifyTime = new Date();

@Field(type = FieldType.Date, format = DateFormat.custom, pattern = "yyyy-MM-dd HH:mm:ss || yyyy-MM-dd'T'HH:mm:ss.000'z' || yyyy-MM-dd || yyyy/MM/dd HH:mm:ss|| yyyy/MM/dd ||epoch_millis")

private Date delTime;

private int isEnabled = 1;

}@Repository("dockerLogEsDao")

public interface DockerLogEsDao extends ElasticsearchRepository<DockerLogEs, String> {

@Query("{\"match\": {\"dockerInstanceId\": {\"query\": \"?0\"}}}")

Page<DockerLogEs> findPageBydockerInstanceId(String dockerInstanceId, Pageable pageRequest);

Page<DockerLogEs> findByAppId(String appId, Pageable pageRequest);

}和正常的SpringData一样,简单查询和使用JpaRepository一样,以上中的2个方法仅做示例,下面未使用该方法

public interface DockerLogEsService {

/**

* 获取日志分页

*

* @param map

* @return

*/

Page<DockerLogEs> findDockerLogByPage(Map<String, Object> map) throws AppException;

/**

* 根据id获取docker日志

*

* @param map

* @return

*/

DockerLogDto findDockerLogById(Map<String, Object> map) throws AppException;

/**

* 批量删除日志

*

* @param map

* @param adminId

*/

void delDockerLogByIds(Map<String, Object> map, String adminId) throws AppException;

/**

* 情况日志

*

* @param adminId

*/

void emptyDockerLog(String adminId) throws AppException;

}在service实现类中,根据前面配置的es客户端,选择不同的 ElasticsearchRestTemplate 还是

ElasticsearchTemplate使用。

以下展示ElasticsearchRestTemplate的使用

@Service

public class DockerLogEsServiceImpl implements DockerLogEsService {

@Autowired

private DockerLogEsDao dockerLogEsDao;

@Autowired

private UserRolePowerCheck userRolePowerCheck;

@Autowired

private ElasticsearchRestTemplate elasticsearchRestTemplate;

/**

* 分页条件查询

*

* @param map

* @return

* @throws AppException

*/

@Override

public Page<DockerLogEs> findDockerLogByPage(Map<String, Object> map) throws AppException {

createIndex();

Integer pageSize = (Integer) map.get("pageSize");

Integer pageNo = (Integer) map.get("pageNo");

String dockerInstanceId = (String) map.get("dockerInstanceId");

String appid = (String) map.get("appid");

String api = (String) map.get("api");

String beginTime = (String) map.get("beginTime");

String endTime = (String) map.get("endTime");

//注入分页参数

Pageable pageRequest = PageableTools.basicPage(pageNo, pageSize, "createTime");

// ElasticsearchTemplate

IndexCoordinates index = elasticsearchRestTemplate.getIndexCoordinatesFor(DockerLogEs.class);

Criteria criteria = new Criteria();

Sort sort = Sort.by(Sort.Direction.DESC, "createTime");

if (StringUtils.isNotBlank(api)) {

criteria.and((new Criteria("api").is(api)));

}

if (StringUtils.isNotBlank(dockerInstanceId)) {

criteria.and(new Criteria("dockerInstanceId").is(dockerInstanceId));

}

if (StringUtils.isNotBlank(appid)) {

//like 查询

criteria.and(new Criteria("appId").contains(appid));

}

//时间

if (org.apache.commons.lang3.StringUtils.isNotBlank(beginTime) && org.apache.commons.lang3.StringUtils.isNotBlank(endTime)) {

Date beginDate = DateUtil.dateAddHour(DateUtil.stringToDate(beginTime), 8);

Date endTimeDate = DateUtil.dateAddHour(DateUtil.stringToDate(endTime), 8);

criteria.and(new Criteria("createTime").between(beginDate, endTimeDate));

}

CriteriaQuery criteriaQuery = new CriteriaQueryBuilder(criteria).withSort(sort).build();

criteriaQuery.setTrackTotalHits(true);

long begin = pageNo * pageSize;

if (begin >= 10000) {

//滚动查询

return searchForStream(pageSize, pageRequest, index, criteriaQuery, begin);

} else {

//正常查询

criteriaQuery.setPageable(pageRequest);

SearchHits<DockerLogEs> search = elasticsearchRestTemplate.search(criteriaQuery, DockerLogEs.class);

List<DockerLogEs> collect = search.stream().map(SearchHit::getContent).collect(Collectors.toList());

return new PageImpl<>(collect, pageRequest, search.getTotalHits());

}

}

private Page<DockerLogEs> searchForStream(Integer pageSize, Pageable pageRequest, IndexCoordinates index, CriteriaQuery criteriaQuery, long begin) {

SearchHitsIterator<DockerLogEs> stream = elasticsearchRestTemplate.searchForStream(criteriaQuery, DockerLogEs.class, index);

List<DockerLogEs> collect = new ArrayList<>();

stream.stream().skip(begin).limit(pageSize).forEach(item -> collect.add(item.getContent()));

stream.close();

return new PageImpl<>(collect, pageRequest, stream.getTotalHits());

}

private void createIndex() {

boolean exists = elasticsearchRestTemplate.indexOps(DockerLogEs.class).exists();

if (!exists) {

elasticsearchRestTemplate.indexOps(DockerLogEs.class).create();

elasticsearchRestTemplate.indexOps(DockerLogEs.class).putMapping();

}

}

/**

* 根据id获取日志

*

* @param map

* @return

* @throws AppException

*/

@Override

public DockerLogDto findDockerLogById(Map<String, Object> map) throws AppException {

String id = (String) map.get("id");

if (StringUtil.isEmpty(id)) {

throw new AppException("id is null");

}

Optional<DockerLogEs> optional = dockerLogEsDao.findById(id);

if (!optional.isPresent()) {

throw new AppException("日志不存在");

}

DockerLogDto dto = new DockerLogDto(optional.get());

return dto;

}

/**

* 批量删除日志

*

* @param map

* @param adminId

* @throws AppException

*/

@Override

public void delDockerLogByIds(Map<String, Object> map, String adminId) throws AppException {

//校验操作者是否为管理员

userRolePowerCheck.getAndCheckRole(adminId, SystemAdmin.TYPE_ADMIN);

List<String> ids = (List<String>) map.get("ids");

if (ids == null || ids.size() == 0) {

throw new AppException("请选择需要删除的日志信息");

}

dockerLogEsDao.deleteAllById(ids);

}

/**

* 清空日志

*

* @param adminId

* @throws AppException

*/

@Override

public void emptyDockerLog(String adminId) throws AppException {

//校验操作者是否为管理员

userRolePowerCheck.getAndCheckRole(adminId, SystemAdmin.TYPE_ADMIN);

dockerLogEsDao.deleteAll();

}

}

在 CriteriaQuery使用中也可使用 NativeSearchQuery 和 BoolQueryBuilder 构建多条件参数查询

如:

BoolQueryBuilder boolQueryBuilder = new BoolQueryBuilder();

boolQueryBuilder.must(QueryBuilders.matchQuery("ip","192.168.3.116"));

NativeSearchQuery searchQuery = new NativeSearchQueryBuilder()

.withQuery(boolQueryBuilder

.build();

SearchHits<DockerInstanceMonitorDataEs> search = elasticsearchRestTemplate.search(searchQuery, XX.class);

......1、在es7.x之后的查询中,分页查询最多查询到第1w条,当pageNo*pageSize > 1w时会报错

2、当数据量大于1w时,需要使用滚动查询。

3、普通查询时返回的命中数量最多是1w条,为了返回真正的数据总量,需要设置

criteriaQuery.setTrackTotalHits(true)这个属性。

4、在进行时间断检索的时候,es需要将时间转为时间戳进行查询

统计指定时间段内每分/每小时的平均cpu和内存情况

private HashMap<Date, InstanceMonitorParams> getInstanceMonitorDateByGroupAndTime(String dockerInstanceId, Date beginDate, Date endDate, int type) {

//查询条件

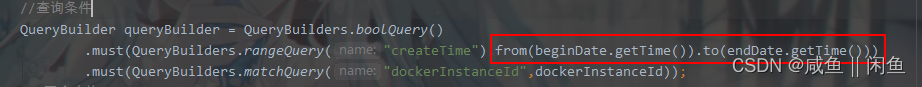

QueryBuilder queryBuilder = QueryBuilders.boolQuery()

.must(QueryBuilders.rangeQuery("createTime").from(beginDate.getTime()).to(endDate.getTime()))

.must(QueryBuilders.matchQuery("dockerInstanceId",dockerInstanceId));

// 聚合查询。createTime,time

DateHistogramAggregationBuilder sumBuilder;

if (type == 1){

sumBuilder = AggregationBuilders.dateHistogram("time").field("createTime").

calendarInterval(DateHistogramInterval.minutes(1)).format("yyyy-MM-dd HH:mm:ss").minDocCount(0);

}else {

sumBuilder = AggregationBuilders.dateHistogram("time").field("createTime").

calendarInterval(DateHistogramInterval.hours(1)).format("yyyy-MM-dd HH:mm:ss").minDocCount(0);

}

AvgAggregationBuilder c= AggregationBuilders.avg("avg_cpu").field("cpu");

AvgAggregationBuilder m= AggregationBuilders.avg("avg_memory").field("memory");

//聚合条件整合

DateHistogramAggregationBuilder builder = sumBuilder.subAggregation(c).subAggregation(m);

NativeSearchQuery searchQuery = new NativeSearchQueryBuilder()

.withQuery(queryBuilder)

.withAggregations(builder)

.build();

SearchHits<DockerInstanceMonitorDataEs> search = elasticsearchRestTemplate.search(searchQuery, DockerInstanceMonitorDataEs.class);

HashMap<Date, InstanceMonitorParams> esDateMap = new HashMap<>();

Aggregations aggregations1 = (Aggregations) search.getAggregations().aggregations();

Map<String, Aggregation> asMap = aggregations1.getAsMap();

ParsedDateHistogram time = (ParsedDateHistogram) asMap.get("time");

List<? extends Histogram.Bucket> buckets = time.getBuckets();

for (Histogram.Bucket bucket : buckets) {

Date key = Date.from(Instant.from((ZonedDateTime)bucket.getKey())) ;

Map<String, Aggregation> avgMap = bucket.getAggregations().getAsMap();

ParsedAvg memory = (ParsedAvg) avgMap.get("avg_memory");

ParsedAvg cpu = (ParsedAvg) avgMap.get("avg_cpu");

InstanceMonitorParams instanceMonitorParams = new InstanceMonitorParams( cpu.getValue(), memory.getValue());

esDateMap.put(key,instanceMonitorParams);

}

return esDateMap;

}

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复

在ruby中,你可以这样做:classThingpublicdeff1puts"f1"endprivatedeff2puts"f2"endpublicdeff3puts"f3"endprivatedeff4puts"f4"endend现在f1和f3是公共(public)的,f2和f4是私有(private)的。内部发生了什么,允许您调用一个类方法,然后更改方法定义?我怎样才能实现相同的功能(表面上是创建我自己的java之类的注释)例如...classThingfundeff1puts"hey"endnotfundeff2puts"hey"endendfun和notfun将更改以下函数定

据我们所知,Jekyll默认分页仅支持index.html,我想创建blog.html并在那里包含分页。有什么解决办法吗? 最佳答案 如果您创建一个名为/blog的目录并在其中放置一个index.html文件,那么您可以向_config.yml表示paginate_path:"blog/page:num"。不是使用根文件夹中的默认index.html作为分页器模板,而是使用/blog/index.html。分页器将根据需要生成类似/blog/page2/和/blog/page3/的页面。这将使您到达yourwebsite.com/b

我目前有一个reddit克隆类型的网站。我正在尝试根据我的用户之前喜欢的帖子推荐帖子。看起来K最近邻或k均值是执行此操作的最佳方法。我似乎无法理解如何实际实现它。我看过一些数学公式(例如k表示维基百科页面),但它们对我来说并没有真正意义。有人可以推荐一些伪代码,或者可以查看的地方,以便我更好地了解如何执行此操作吗? 最佳答案 K最近邻(又名KNN)是一种分类算法。基本上,您采用包含N个项目的训练组并对它们进行分类。如何对它们进行分类完全取决于您的数据,以及您认为该数据的重要分类特征是什么。在您的示例中,这可能是帖子类别、谁发布了该项

我查看了Stripedocumentationonerrors,但我仍然无法正确处理/重定向这些错误。基本上无论发生什么,我都希望他们返回到edit操作(通过edit_profile_path)并向他们显示一条消息(无论成功与否)。我在edit操作上有一个表单,它可以POST到update操作。使用有效的信用卡可以正常工作(费用在Stripe仪表板中)。我正在使用Stripe.js。classExtrasController5000,#amountincents:currency=>"usd",:card=>token,:description=>current_user.email)