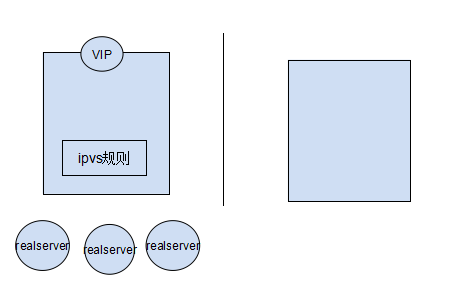

最初的诞生是为ipvs提供高可用的,在后端的realserver接收不到主节点的信息之后,keepalived能够自己调用ipvsadm命令生成规则,能够自动实现,将主节点的VIP以及ipvs规则“拿过来”,应用在从节点上,继续为用户服务。还可以实现对后端realserver的健康状况做检测。 keepalived在一个节点上启动之后,会生成一个Master主进程,这个主进程又会生成两个子进程,分别是VRRP Stack(实现vrrp协议的) Checkers(检测ipvs后端realserver的健康状况检测)二、VRRP的有限状态机

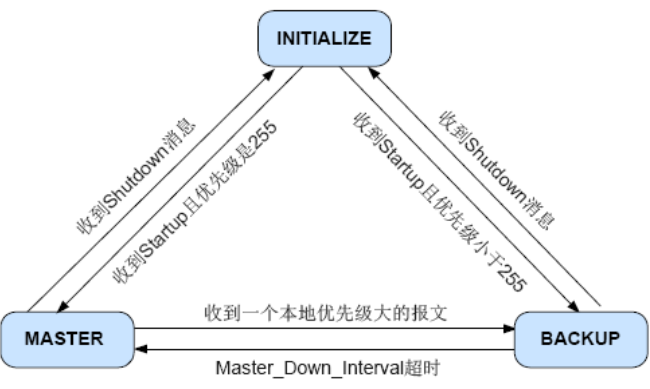

最初的诞生是为ipvs提供高可用的,在后端的realserver接收不到主节点的信息之后,keepalived能够自己调用ipvsadm命令生成规则,能够自动实现,将主节点的VIP以及ipvs规则“拿过来”,应用在从节点上,继续为用户服务。还可以实现对后端realserver的健康状况做检测。 keepalived在一个节点上启动之后,会生成一个Master主进程,这个主进程又会生成两个子进程,分别是VRRP Stack(实现vrrp协议的) Checkers(检测ipvs后端realserver的健康状况检测)二、VRRP的有限状态机 VRRP双方节点都启动以后,要实现状态转换的,刚开始启动的时候,初始状态都是BACKUP,而后向其它节点发送通告,以及自己的优先级信息,谁的优先级高,就转换为MASTER,否则就还是BACKUP,这时候服务就在状态为MASTER的节点上启动,为用户提供服务,如果,该节点挂掉了,则转换为BACKUP,优先级降低,另一个节点转换为MASTER,优先级上升,服务就在此节点启动,VIP,VMAC都会被转移到这个节点上,为用户提供服务,实验环境: 虚拟主机版本: CentOS6.4-i686 两个节点: node1.limian.com 172.16.6.1 node2.limian.com 172.16.6.10准备 1、节点一: 同步时间:[root@node1 ~]# ntpdate 172.16.0.1 安装keepalived[root@node1 ~]# yum -y install keepalived 2、节点二做同样的工作三、利用keepalived 实现主从VIP的切换3.1我们修改下keepalived的配置文件:

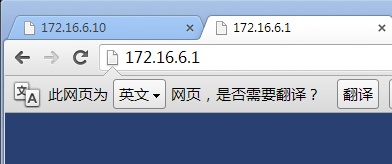

VRRP双方节点都启动以后,要实现状态转换的,刚开始启动的时候,初始状态都是BACKUP,而后向其它节点发送通告,以及自己的优先级信息,谁的优先级高,就转换为MASTER,否则就还是BACKUP,这时候服务就在状态为MASTER的节点上启动,为用户提供服务,如果,该节点挂掉了,则转换为BACKUP,优先级降低,另一个节点转换为MASTER,优先级上升,服务就在此节点启动,VIP,VMAC都会被转移到这个节点上,为用户提供服务,实验环境: 虚拟主机版本: CentOS6.4-i686 两个节点: node1.limian.com 172.16.6.1 node2.limian.com 172.16.6.10准备 1、节点一: 同步时间:[root@node1 ~]# ntpdate 172.16.0.1 安装keepalived[root@node1 ~]# yum -y install keepalived 2、节点二做同样的工作三、利用keepalived 实现主从VIP的切换3.1我们修改下keepalived的配置文件:[root@node1 ~]# cd /etc/keepalived/

[root@node1 keepalived]# cp keepalived.conf keepalived.conf.back //先给配置文件备份一下

[root@node1 keepalived]# vim keepalived.conf3.2全局阶段global_defs {

notification_email { //定义邮件服务的

root@localhost //定义收件人,这里改为本机,只是测试使用

}

notification_email_from kaadmin@localhost //定义发件人,

smtp_server 127.0.0.1 //定义邮件服务器,一定不能使用外部地址

smtp_connect_timeout 30 //超时时间

router_id LVS_DEVEL

}3.3定义vrrp阶段vrrp_instance VI_1 { //定义虚拟路由,VI_1 为虚拟路由的标示符,自己定义名称

state MASTER //开启后,该节点的优先级比另一节点的优先级高,所以转化为MASTER状态

interface eth0 //所有的通告等信息都从eth0这个接口出去

virtual_router_id 7 //虚拟路由的ID,而且这个ID也是虚拟MAC最后一段的来源,这个ID号一般不能大于255,且这个ID一定不能有冲突

priority 100 //初始优先级

advert_int 1 //通告的个数

authentication { //认证机制

auth_type PASS //认证类型

auth_pass 1111 //密码,应该为随机的字符串

}

virtual_ipaddress { //虚拟地址,即VIP

172.16.6.100

}

}这样我们主节点的配置文件就修改好了,需要复制到从节点上,再做适当的修改就可以使用了[root@node1 keepalived]# scp keepalived.conf 172.16.6.1:/etc/keepalived/3.4登录到从节点;[root@node2 ~]# cd /etc/keepalived/

[root@node2 keepalived]# vim keepalived.conf

vrrp_instance VI_1 {

state BACKUP //修改从节点的状态,主节点为MASTER,从节点就为BACKUP

interface eth0

virtual_router_id 7

priority 99 //修改优先级,注意从节点的优先级一定要小于主节点

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.16.6.100

}

}3.5然后在主节点启动服务[root@node1 keepalived]# service keepalived start

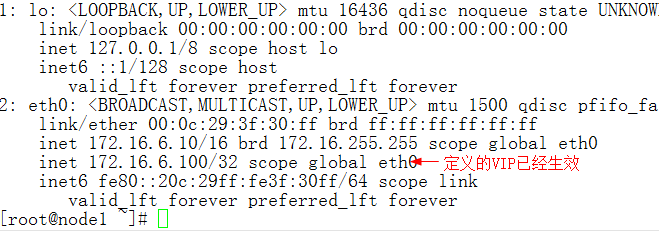

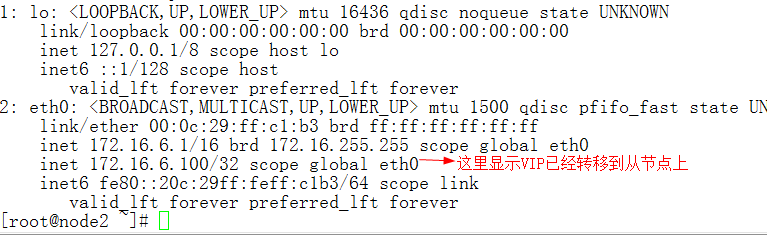

[root@node1 ~]# ip addr show //查看我们定义的VIP 3.6在从节点启动服务[root@node2 keepalived]# service keepalived start把主节点上的服务停掉,看VIP会不会到从节点上[root@node2 ~]# ip addr show

3.6在从节点启动服务[root@node2 keepalived]# service keepalived start把主节点上的服务停掉,看VIP会不会到从节点上[root@node2 ~]# ip addr show

[root@node1 ~]# service keepalived start

[root@node1 ~]# ip addr show //检测结果发现VIP转移到了主节点注: 默认情况下ARRP工作在“抢占模式”下,如果发现一个节点的服务停止了,另一个节点会立即把VIP和VMAC“抢过来”,如果在“非抢占模式”下,无论你的优先级过高,一个节点服务停止,另一个节点也不会“抢”VIP和VMAC,除非这个节点挂了,两一个节点才会“抢”。四、实现在状态转变的时候自定义进行通知,4.1这需要依赖于脚本来完成主节点[root@node1 ~]# cd /etc/keepalived/

[root@node1 keepalived]# vim notify.sh //编写脚本

#!/bin/bash

vip=172.16.6.100

contact='root@localhost'

thisip=`ifconfig eth0 | awk '/inet addr:/{print $2}' | awk -F: '{print $2}'`

Notify() {

mailsubject="$thisip is to bi $vip master"

mailbody="vrrp transaction, $vip floated to $thisip"

echo $mailbody | mail -s "$mailsubject" $contact

}

case "$1" in

master)

notify master

exit 0

;;

backup)

notify backup

exit 0

;;

fault)

notify fault

exit 0

;;

*)

echo 'Usage: `basename $0` {master|backup|fault}'

exit 1

;;

esac

[root@node1 keepalived]# chmod +x notify.sh

[root@node1 keepalived]# ./notify.sh master

[root@node1 keepalived]# mail //查看有没有收到通知

Heirloom Mail version 12.4 7/29/08. Type ? for help.

"/var/spool/mail/root": 1 message 1 new

>N 1 root Wed Sep 25 14:54 18/668 "172.16.6.10 is to bi 172.16.6.100 mas"

&转换状态查看是否会收到通知[root@node1 keepalived]# ./notify.sh backup

[root@node1 keepalived]# ./notify.sh fault

[root@node1 keepalived]# mail

Heirloom Mail version 12.4 7/29/08. Type ? for help.

"/var/spool/mail/root": 3 messages 2 new

1 root Wed Sep 25 14:54 19/679 "172.16.6.10 is to bi 172.16.6.100 mas"

>N 2 root Wed Sep 25 14:57 18/668 "172.16.6.10 is to bi 172.16.6.100 mas"

N 3 root Wed Sep 25 14:57 18/668 "172.16.6.10 is to bi 172.16.6.100 mas"

&说明脚本正常工作,那么去编辑配置文件[root@node1 keepalived]# vim keepalived.conf在全局阶段添加vrrp_script chk_mantaince_down{ //定义可以手动控制状态的脚本

script "[[ -f /etc/keepalived/down ]] && exit 1 || exit 0"

interval 1 //检查时间间隔

weight -2 //如果检测失败,优先级-2

}在vrrp阶段添加如下几行 track_script { //引用定义的脚本

chk_mantaince_down

}

notify_master"/etc/keepalived/notify.sh master"

notify_backup"/etc/keepalived/notify.sh backup"

notify_fault"/etc/keepalived/notify.sh fault"[root@node1 keepalived]# scp notify.sh 172.16.6.1:/etc/keepalived/并在配置文件中相应的位置添加相同内容两个节点都重启服务4.3让主节点变成从节点root@node1 keepalived]# touch down通过监控,发现主节点立即变成从节点,并收到一封邮件[root@node1 keepalived]# tail -f /var/log/messages

You have new mail in /var/spool/mail/root五、实现负载均衡5.1编辑配置文件[root@node1 keepalived]# vim keepalived.conf

#####负载均衡阶段#################

virtual_server 172.16.6.100 80 { //指定VIP和端口

delay_loop 6 //延迟多少个周期再启动服务,做服务检测

lb_algo rr loadbalance 负载均衡调度算法

lb_kind DR 类型

nat_mask 255.255.0.0 掩码

persistence_timeout 0 持久连接时间

protocol TCP //协议

real_server 172.16.6.11 80 { //定义后端realserver的属性

weight 1

HTTP_GET { //定义检测的方法

url { //检测的URL

path /

status_code 200 //获取结果的状态码

}

connect_timeout 3 //连接超时时间

nb_get_retry 3 //尝试次数

delay_before_retry 3 //每次尝试连接的等待时间

}

}

real_server 172.16.6.12 80 { //定义后端realserver的属性

weight 1

HTTP_GET { //定义检测的方法

url { //检测的URL

path /

status_code 200 //获取结果的状态码

}

connect_timeout 3 //连接超时时间

nb_get_retry 3 //尝试次数

delay_before_retry 3 //每次尝试连接的等待时间

}

}

}5.2、在从节点上做同样的修改5.3重启服务并用ipvsadm命令检测是否会生成规则[root@node1 keepalived]# service keepalived restart

[root@node1 keepalived]# ipvsadm -L -n

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 172.16.6.100:80 rr

[root@node1 keepalived]#但是为什么没有我们定义的两个realserver呢?那是因为没启动虚拟机呢,健康状况检测没通过,就不会显示了,我们去启动一个虚拟机,并启动服务即可。并执行如下命令,做lvs负载均衡的DR模型#ifconfig lo:0 172.16.6.11 broadcast 172.16.6.11 netmask 255.255.255.255 up

#route add -host 172.16.6.11 dev lo:0

#echo 1 > /proc/sys/net/ipv4/conf/lo/arp_ignore

#echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore

#echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce

#echo 2 > /proc/sys/net/ipv4/conf/lo/arp_announce注: 1、后端的realserver的数量可以添加多台,但是需要在主节点的配置文件中给出相应的配置,并在添加的realserver上执行相关命令即可 2、尽管keepalived可以自行添加ipvs规则,实现负载均衡,但是无法实现动静分离,在生产环境中我们要根据场景选择最佳的方案。六:实现nginx的高可用6.1前提 两个节点上都装上nginx服务,并确保httpd没启用# netstat -tunlp //确保80端口没占用# service nginx start6.2为每个节点的nginx编辑一个页面,以便于效果更直观一些[root@node1 ~]# vim /usr/share/nginx/html/index.html //节点1

172.16.6.10

[root@node2 ~]# vim /usr/share/nginx/html/index.html //节点2

172.16.6.16.3确保nginx可以正常访问 6.4然后停掉服务,

6.4然后停掉服务,[root@node1 keepalived]# vim notify.sh //修改脚本,让它可以监测nginx服务,并可以启动或关闭服务

##################

case "$1" in

master)

notify master

/etc/rc.d/init.d/nginx start

exit 0

;;

backup)

notify backup

/etc/rc.d/init.d/nginx stop

exit 0

;;

fault)

notify fault

/etc/rc.d/init.d/nginx stop

exit 0

;;

######################################6.5同步脚本到节点2[root@node1 keepalived]# scp notify.sh 172.16.6.1:/etc/keepalived/6.6在主节点上[root@node1 keepalived]# touch down

[root@node1 keepalived]#ss -tunl //发现80端口未被监听

[root@node1 keepalived]# rm -f down

[root@node1 keepalived]#ss -tunl //发现80端口已经被监听我的瘦服务器配置了nginx,我的ROR应用程序正在它们上运行。在我发布代码更新时运行thinrestart会给我的应用程序带来一些停机时间。我试图弄清楚如何优雅地重启正在运行的Thin实例,但找不到好的解决方案。有没有人能做到这一点? 最佳答案 #Restartjustthethinserverdescribedbythatconfigsudothin-C/etc/thin/mysite.ymlrestartNginx将继续运行并代理请求。如果您将Nginx设置为使用多个上游服务器,例如server{listen80;server

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

我在app/helpers/sessions_helper.rb中有一个帮助程序文件,其中包含一个方法my_preference,它返回当前登录用户的首选项。我想在集成测试中访问该方法。例如,这样我就可以在测试中使用getuser_path(my_preference)。在其他帖子中,我读到这可以通过在测试文件中包含requiresessions_helper来实现,但我仍然收到错误NameError:undefinedlocalvariableormethod'my_preference'.我做错了什么?require'test_helper'require'sessions_hel

导读:随着叮咚买菜业务的发展,不同的业务场景对数据分析提出了不同的需求,他们希望引入一款实时OLAP数据库,构建一个灵活的多维实时查询和分析的平台,统一数据的接入和查询方案,解决各业务线对数据高效实时查询和精细化运营的需求。经过调研选型,最终引入ApacheDoris作为最终的OLAP分析引擎,Doris作为核心的OLAP引擎支持复杂地分析操作、提供多维的数据视图,在叮咚买菜数十个业务场景中广泛应用。作者|叮咚买菜资深数据工程师韩青叮咚买菜创立于2017年5月,是一家专注美好食物的创业公司。叮咚买菜专注吃的事业,为满足更多人“想吃什么”而努力,通过美好食材的供应、美好滋味的开发以及美食品牌的孵

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

需求:要创建虚拟机,就需要给他提供一个虚拟的磁盘,我们就在/opt目录下创建一个10G大小的raw格式的虚拟磁盘CentOS-7-x86_64.raw命令格式:qemu-imgcreate-f磁盘格式磁盘名称磁盘大小qemu-imgcreate-f磁盘格式-o?1.创建磁盘qemu-imgcreate-fraw/opt/CentOS-7-x86_64.raw10G执行效果#ls/opt/CentOS-7-x86_64.raw2.安装虚拟机使用virt-install命令,基于我们提供的系统镜像和虚拟磁盘来创建一个虚拟机,另外在创建虚拟机之前,提前打开vnc客户端,在创建虚拟机的时候,通过vnc

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复