🙋♂️作者简介:生鱼同学,大数据科学与技术专业硕士在读👨🎓,曾获得华为杯数学建模国家二等奖🏆,MathorCup 数学建模竞赛国家二等奖🏅,亚太数学建模国家二等奖🏅。

✍️研究方向:复杂网络科学

🏆兴趣方向:利用python进行数据分析与机器学习,数学建模竞赛经验交流,网络爬虫等。

自2008年以来,客人和房东利用Airbnb扩大了旅行的可能性,并提出了一种更独特、个性化的体验世界的方式。

通过Airbnb提供的数百万个房源的数据分析是该公司的一个关键因素。这些数以百万计的房源产生了大量的数据其可以被分析并用于安全、商业决策、了解客户和供应商(房东)在平台上的行为和表现、指导营销举措、实施创新的附加服务等等。

基于上述背景和数据,我们本次主要解决下面几个问题:

本项目中的数据来源于Kaggle开放数据New York City Airbnb Open Data链接如下:

Kaggle-New York City Airbnb Open Data

需要的小伙伴可以自行下载获取。

在进行数据加载之前,我们首先对数据的各个列进行解释,具体情况如下表所示:

| 列名 | 表达含义 |

|---|---|

| id | 挂牌编号 |

| name | 挂牌名字 |

| host_id | 主人编号 |

| host_name | 主人名字 |

| neighbourhood_group | 房屋所在区域 |

| neighbourhood | 房屋具体地区 |

| latitude | 经纬度 |

| longitude | 经纬度 |

| room_type | 房间类型 |

| price | 价格 |

| minimum_nights | 最少的预定夜数 |

| number_of_reviews | 评论数 |

| last_review | 最新评论 |

| reviews_per_month | 每月评论数 |

| calculated_host_listings_count | 主人拥有房屋的数量 |

| availability_365 | 可供预订的天数 |

在开始编码之前,请先确保你已经安装了对应的包,本文所用的包如下:

import pandas as pd

import missingno as msno

import seaborn as sns

在这一步中,我们将加载数据并且调用pandas中的基本函数对数据进行初步的观察。加载数据代码如下:

data = pd.read_csv('AB_NYC_2019.csv')

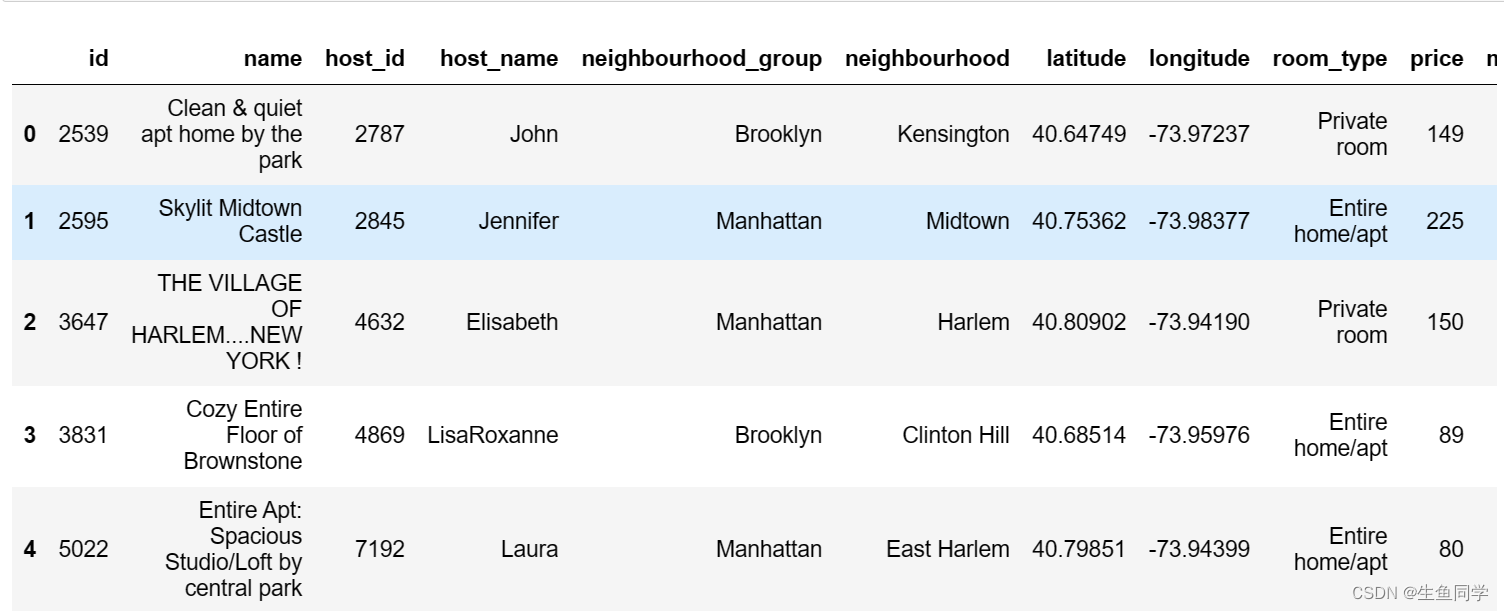

data.head()

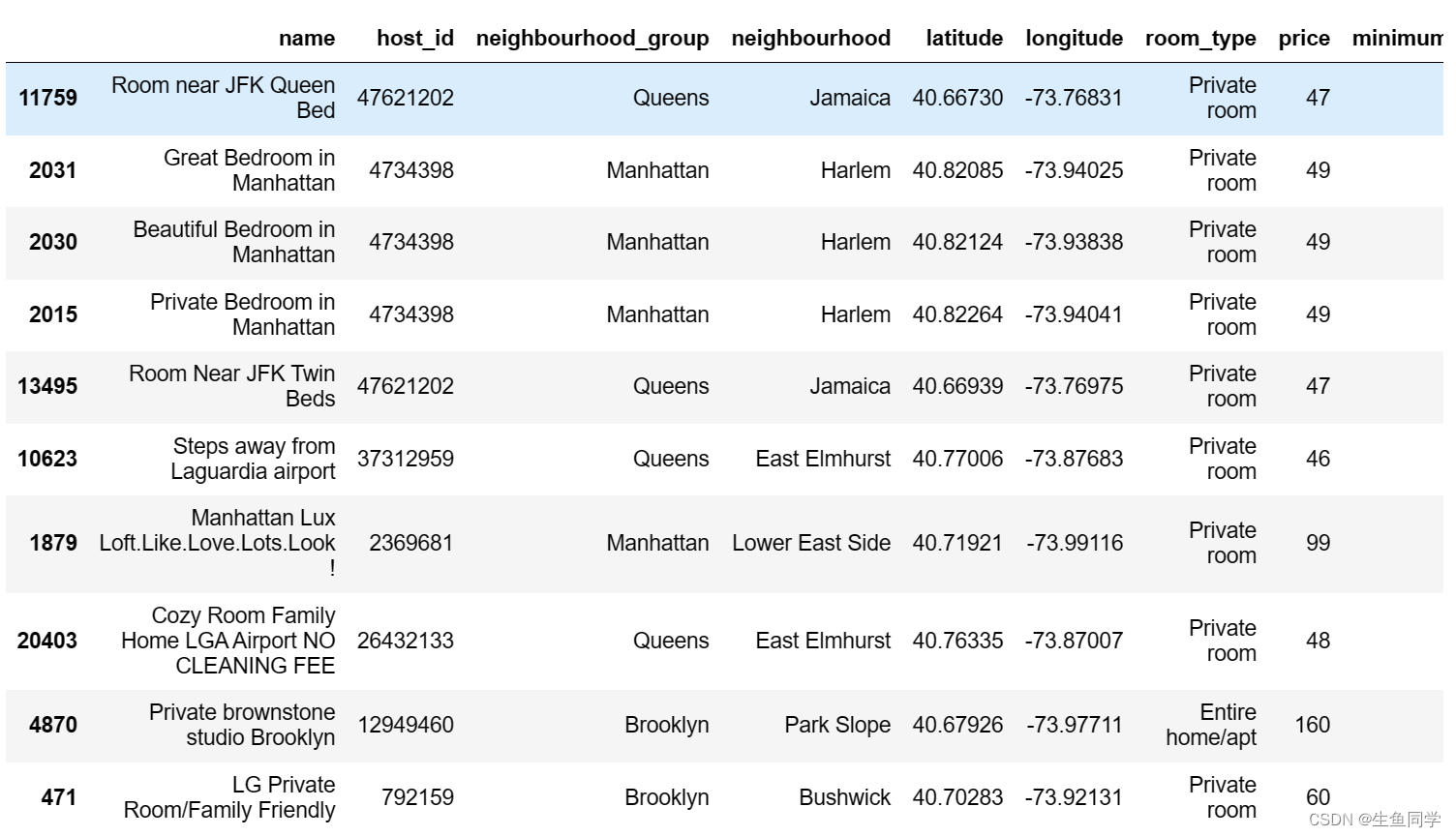

结果如下:

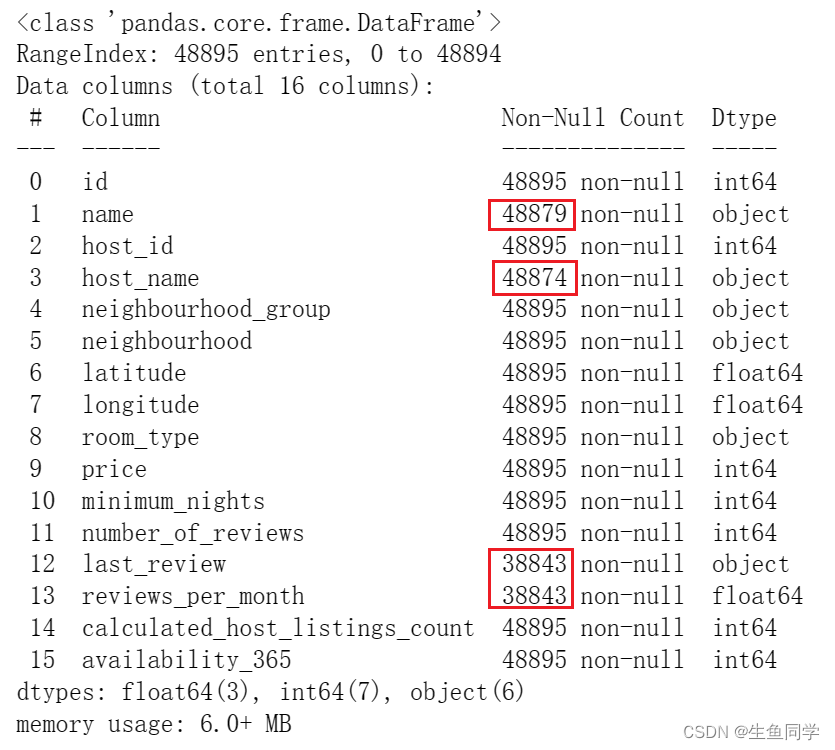

在加载数据过后,我们需要对数据进行初步的认识与观察,这里我们调用**info()和describe()**函数来对数据进行初步的观察。代码和结果如下:

data.info()

结果如下:

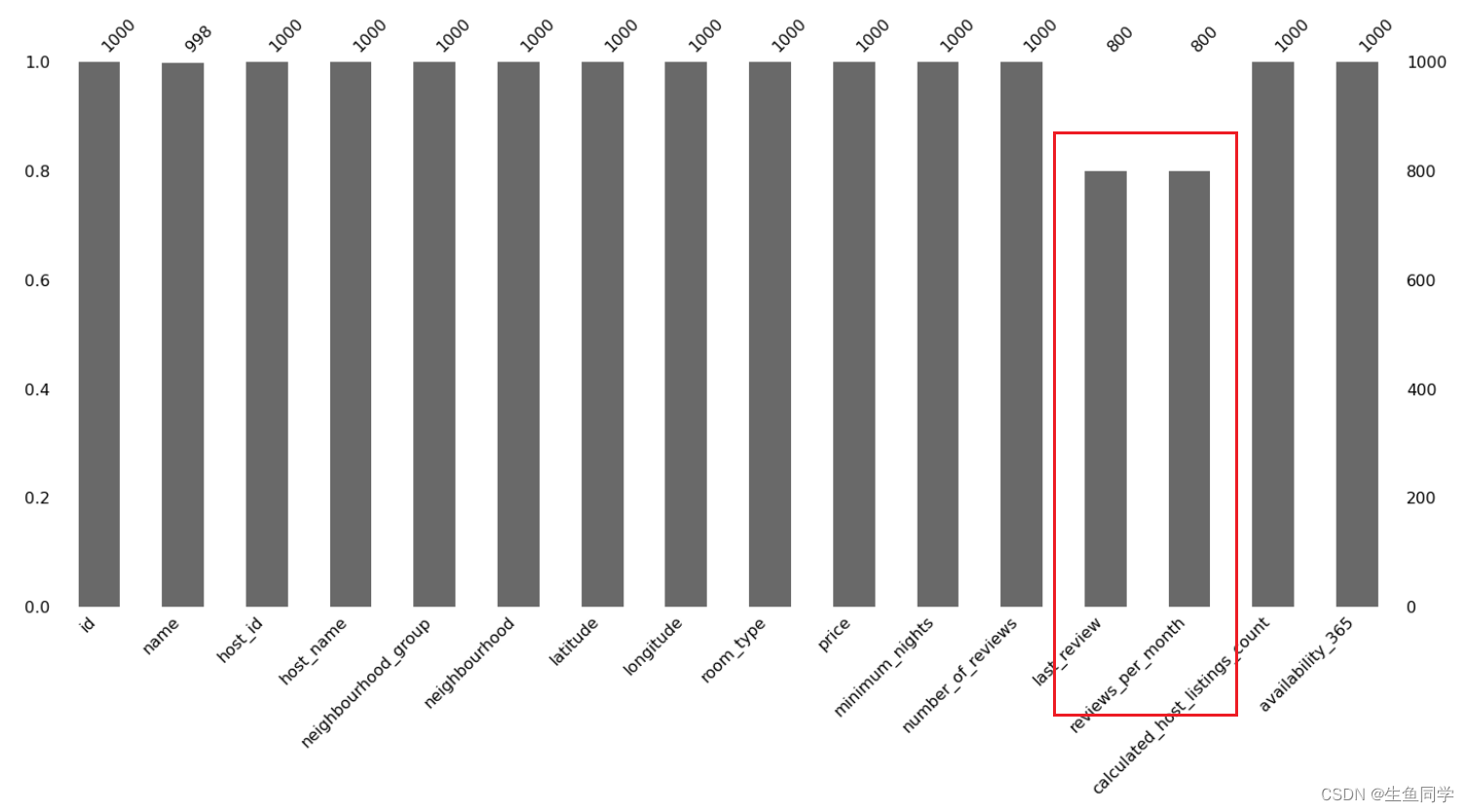

注意:在这一步中,我们观察到图中红圈标记的数据存在一定的缺失情况,这在后续的操作中需要进行处理。

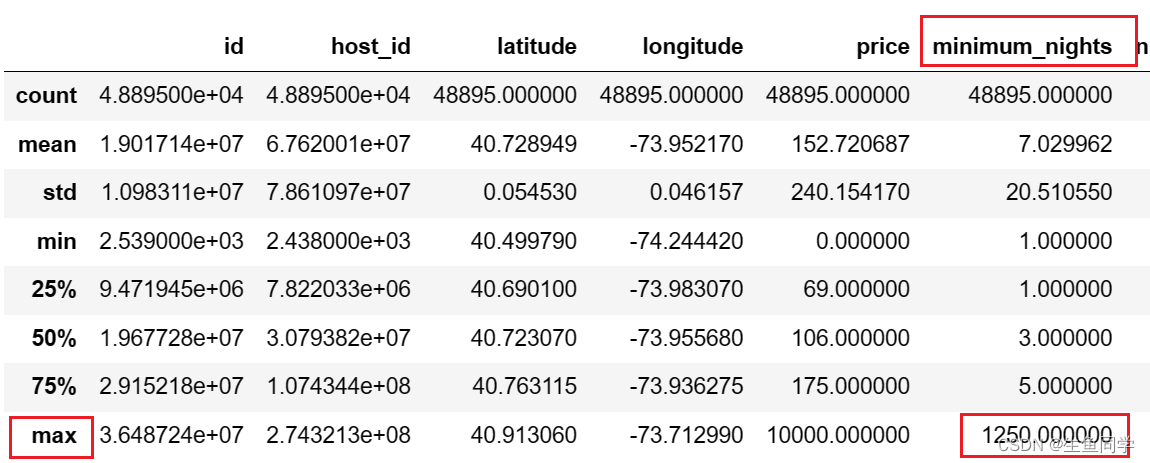

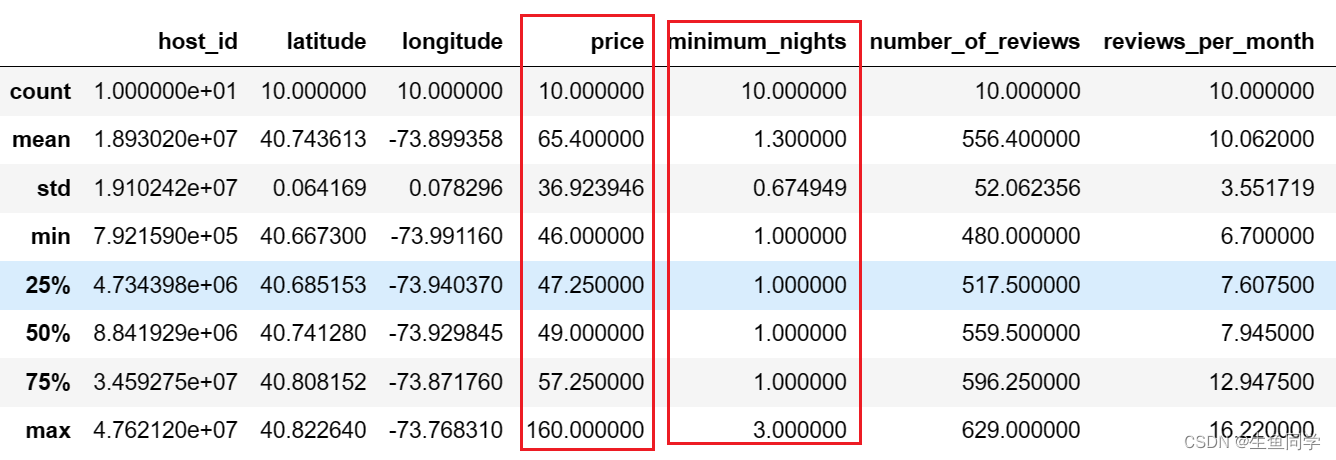

接着,我们调用**describe()**进行数据的进一步观察,代码如下:

data.describe()

结果如下:

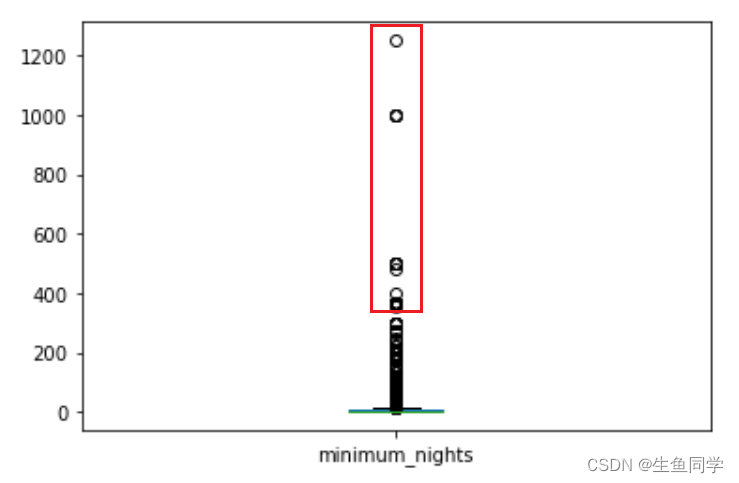

注意:在这里,我们已经发现了一个异常,这里的minimum_nights表示的是最短租赁时长。然而,它的最大值已经超过了365,我们后续需要留意。

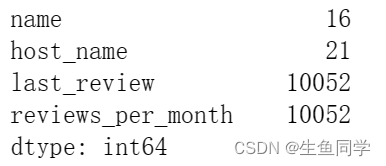

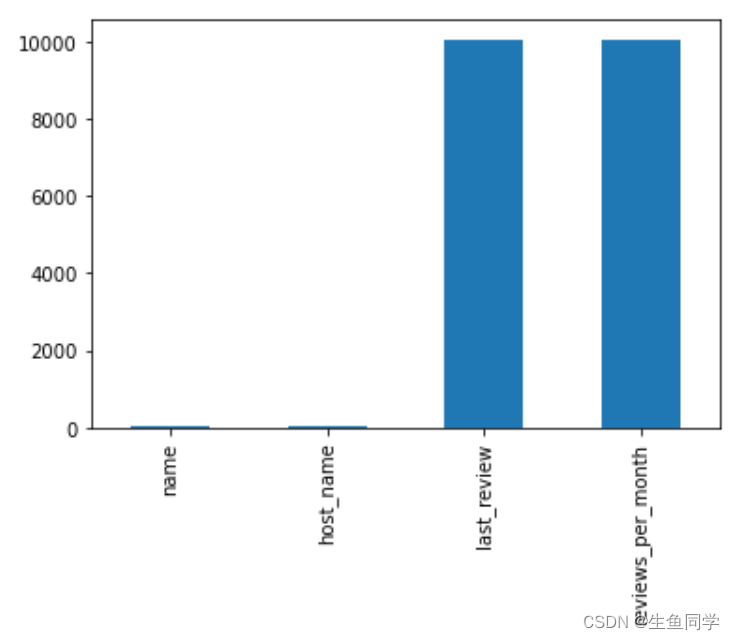

在发现缺失值后,我们需要对缺失值进行有针对性的观察和处理,我们首先对其进行提取以及可视化的操作。首先提取所有缺失的列以及它们缺失的个数情况,代码如下:

missing_data = data.isnull().sum()

missing_data = missing_data[missing_data > 0]

missing_data

结果如下:

可以看到,在名字以及主人名字方面存在一定的缺失,关于评论的缺失情况比较明显且多,我们后面会进行有针对性地处理。

接下来我们对其进行可视化,在这里我们会使用缺失值可视化库以及柱状图来进行可视化,代码如下:

# 对数据进行采样

sample_data = data.sample(1000)

# 可视化

msno.bar(sample_data)

结果如下:

另外,我们也可以用柱状图来进行可视化,代码如下:

missing_data.plot.bar()

结果如下:

在处理缺失值之前,我们首先要进行分析。

主要缺失的值有上述四列,我们对其的分析以及处理方案如下:

上述操作的代码如下:

# 删除了['id','host_name','last_review']三列

data.drop(['id','host_name','last_review'], axis=1, inplace=True)

# 用0填充'reviews_per_month'为Nan的数据

data.fillna({'reviews_per_month':0}, inplace=True)

在上面的分析中,我们观察到了minimum_nights的异常情况,在这里我们使用箱线图对其进行可视化观察,代码如下:

data['minimum_nights'].plot.box()

结果如下:

我们可以观察到,红色标记的部分即是可能的异常值,我们对其进行处理。代码如下:

# 将该列大于365的数据改为365

data.loc[data['minimum_nights'] > 365, 'minimum_nights'] = 365

在本节中,我们将从数据出发进行合理的探索,得出一些结论。

在这个问题的探索中,我们将从两个角度考虑问题,即评论越多证明房屋的欢迎程度越高,与此同时可用天数越少证明房屋越火爆。我们首先来看看数据中有几个不同的地区,代码如下:

# 探究有几个不同的地区

data.neighbourhood_group.unique()

结果如下;

然后我们分别对针对评论数以及年度可用天数进行分组组成新的数据,代码如下:

# 根据评价对区域房源进行分析

# 评论越多越受欢迎

neighbourhood_group_reviews = data['number_of_reviews'].groupby(data['neighbourhood_group'])

neighbourhood_group_reviews_data = pd.DataFrame(neighbourhood_group_reviews.sum().sort_values(ascending = False))

neighbourhood_group_reviews_data

# 根据可用天数对区域房源进行分析

# 可用天数越小越受欢迎

neighbourhood_group_availability_365 = data['availability_365'].groupby(data['neighbourhood_group'])

neighbourhood_group_availability_365_data = pd.DataFrame(neighbourhood_group_availability_365.mean().sort_values())

neighbourhood_group_availability_365_data

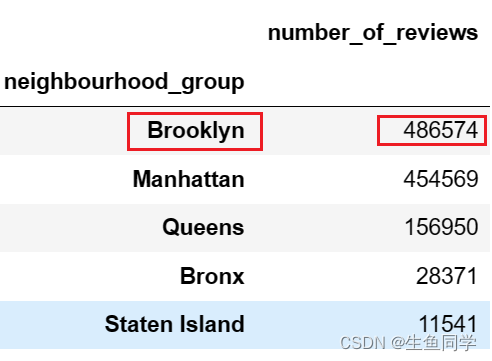

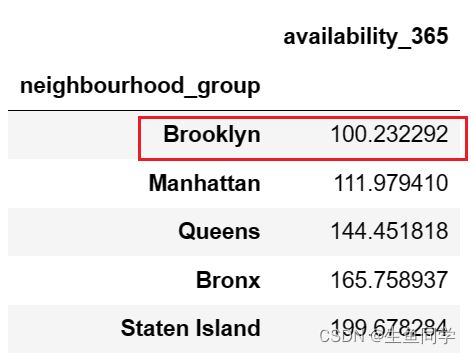

两个数据所组成的新表如下:

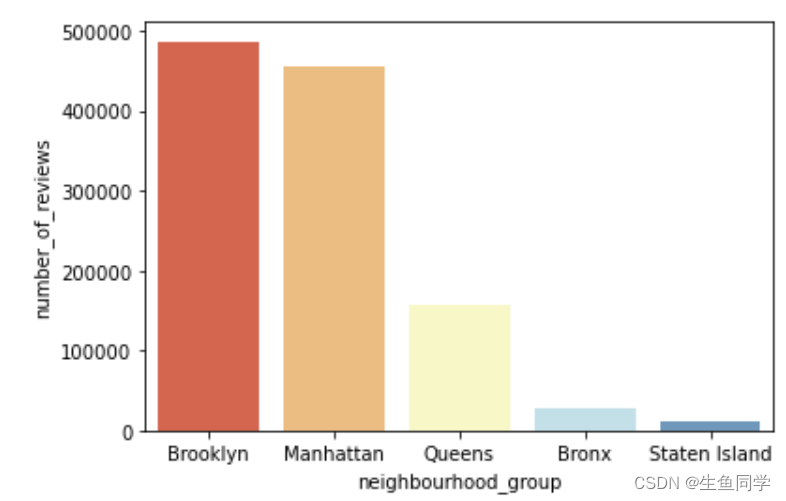

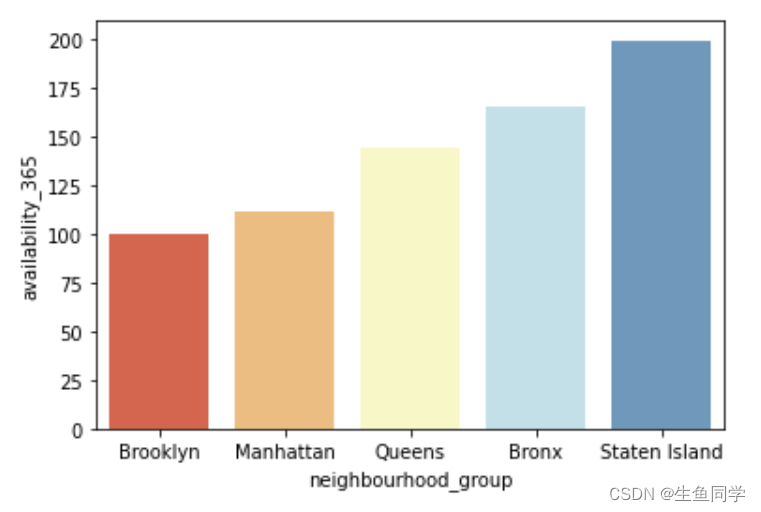

我们可以看到,不论是从年度可用天数还是评论数目来说,Brooklyn的房屋都是最受欢迎的,接下来我们利用可视化来进行更直观的观察,代码如下:

sns.barplot(x="neighbourhood_group", y="number_of_reviews", data=popular_neighbourhood_group_data, palette="RdYlBu")

sns.barplot(x="neighbourhood_group", y="availability_365", data=popular_neighbourhood_group_data, palette="RdYlBu")

结果如下:

这样来看,结果就比较容易观察到了。基于上述分析,我们得出以下结论:

在本节中,我们将要探索那种房子的类型最受欢迎,以及他们的价格特点。

首先,我们从全部地区的角度来观察不同房型的受欢迎程度以及其平均的价格如何。我们将要建立房型与价格、评论数目、可用天数的表格并进行可视化,代码如下:

# 建立房型与价格的表

price_room_type = data['price'].groupby(data['room_type'])

price_room_type_data = pd.DataFrame(price_room_type.mean())

# 建立房型与评论数的表

reviews_room_type = data['number_of_reviews'].groupby(data['room_type'])

reviews_room_type_data = pd.DataFrame(reviews_room_type.sum())

# 建立房型与可用天数的表

availability_365_room_type = data['availability_365'].groupby(data['room_type'])

availability_365_room_type_data = pd.DataFrame(availability_365_room_type.mean())

# 将上述表合并

popular_type_value = pd.concat([availability_365_room_type_data,reviews_room_type_data,price_room_type_data], axis=1)

popular_type_value['room_type'] = popular_type_value.index

popular_type_value.reset_index(inplace=True,drop=True)

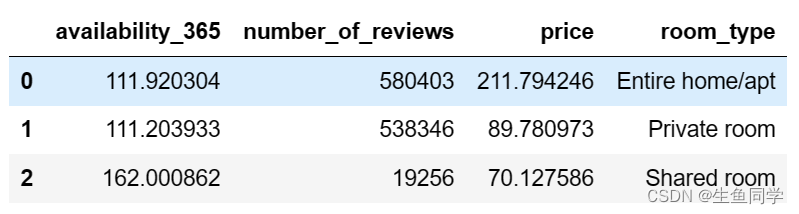

popular_type_value

结果如下:

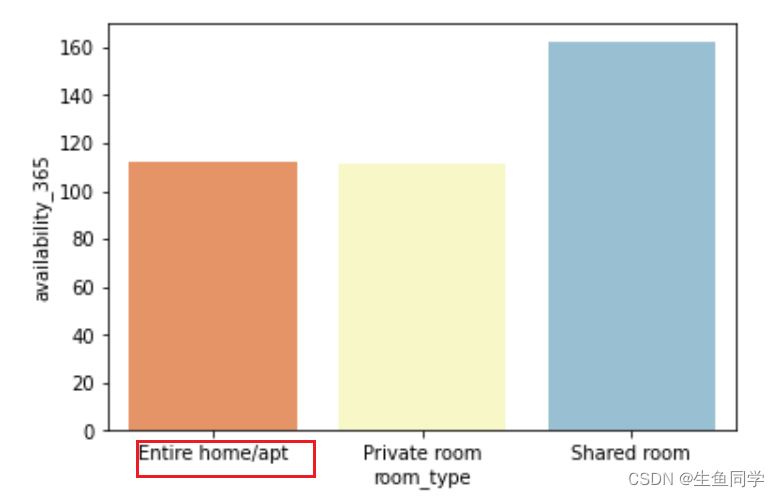

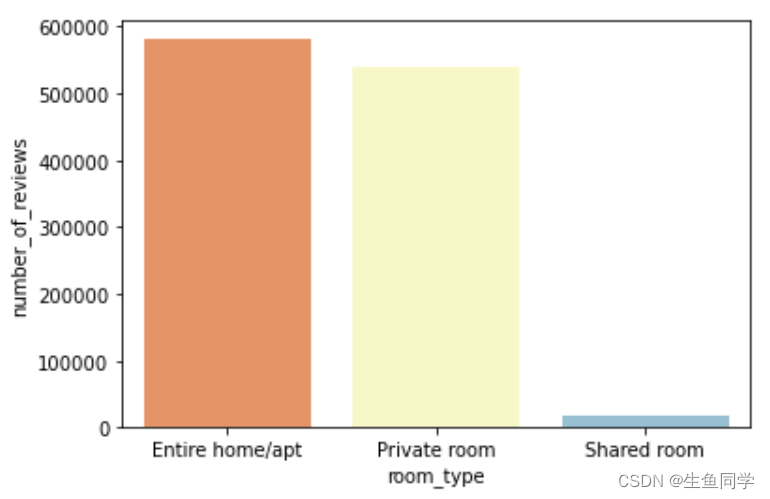

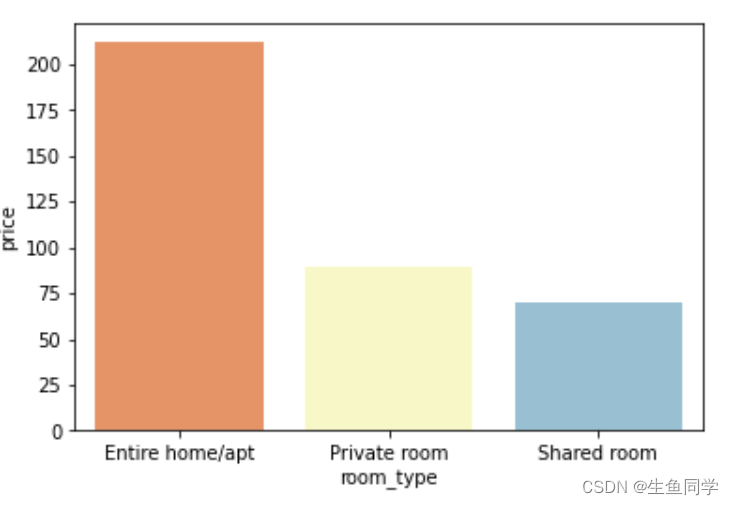

为了更直观的进行分析,我们对其进行可视化。代码如下:

sns.barplot(x="room_type", y="availability_365", data=popular_type_value, palette="RdYlBu")

sns.barplot(x="room_type", y="number_of_reviews", data=popular_type_value, palette="RdYlBu")

sns.barplot(x="room_type", y="price", data=popular_type_value, palette="RdYlBu")

结果如下:

可以看出,Entire home/apt在所有的房屋类型中,所有的方面来说都是最火爆的。

接下来,我们将从不同的地区分别建立透视表进行进一步的分析与探索。

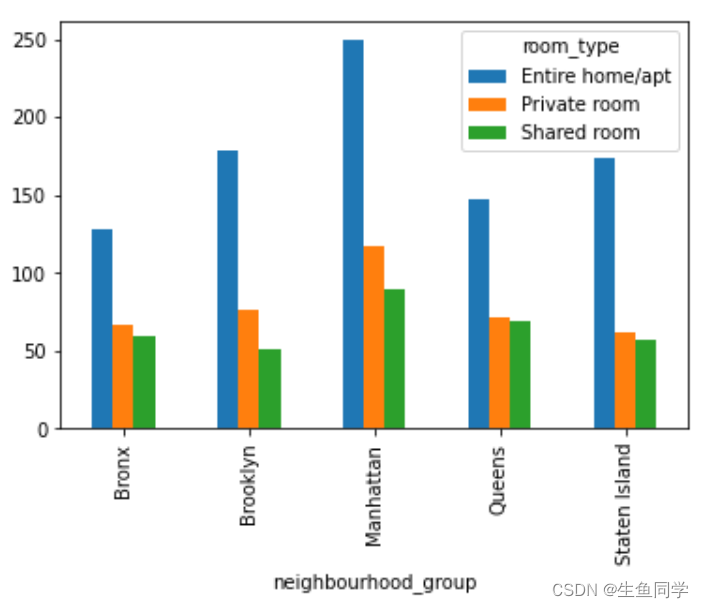

我们分别构建评论数目,地区,房间类型的透视表、年度可用天数与房间类型,地区的联系表、价格与房间类型,地区的联系表。

具体代码如下:

# 构建评论数目,地区,房间类型的透视表

sum_reviews_pivot = data.pivot_table('number_of_reviews', index='neighbourhood_group', columns='room_type', aggfunc='sum')

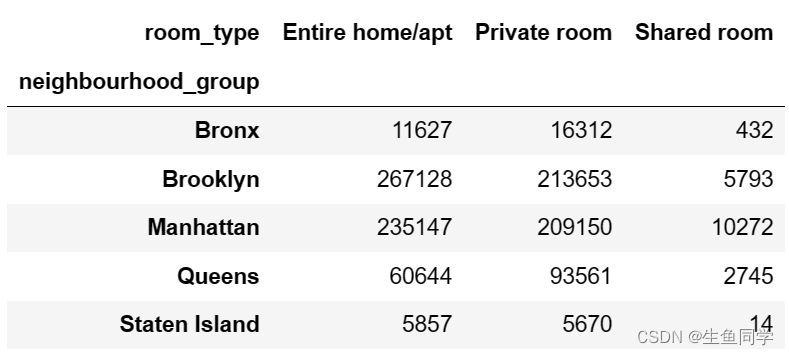

结果如下:

然后我们对其进行可视化,代码如下:

sum_reviews_pivot.plot.bar()

结果如下:

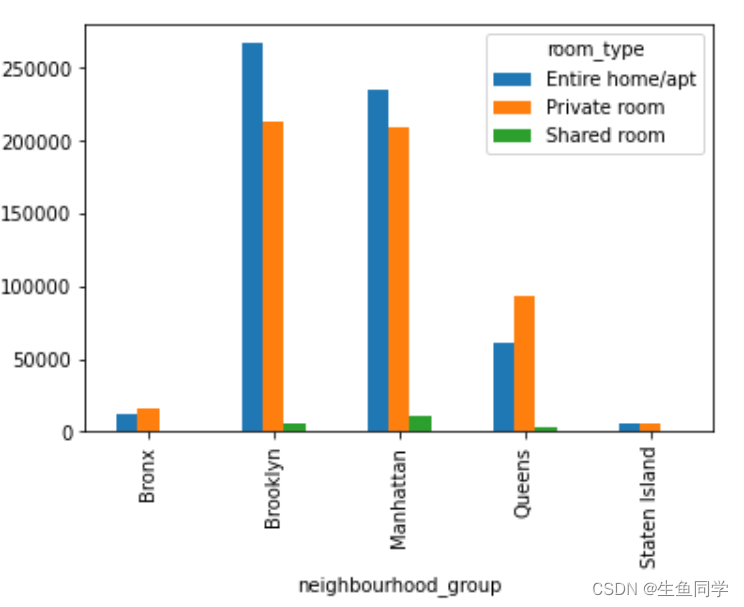

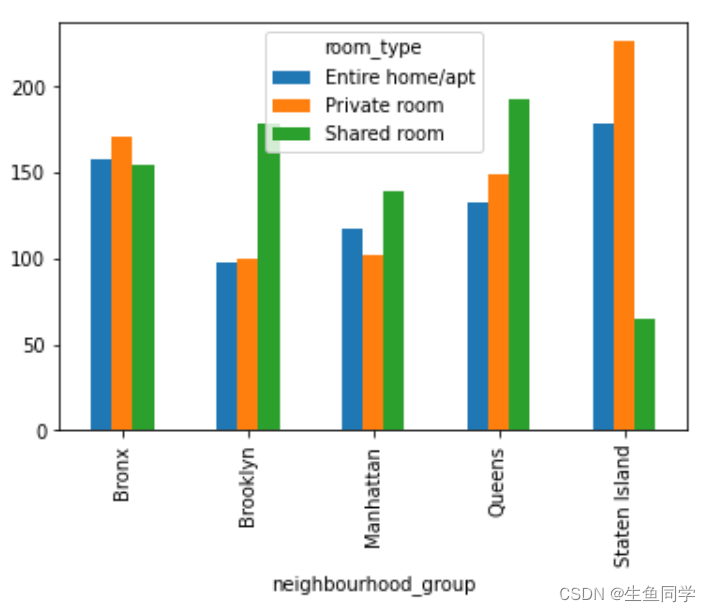

我们同样将其与年度可用天数,和价格构建透视表,然后进行可视化,代码和结果如下:

# 构建年度可用天数与房间类型,地区的联系表

mean_availability_365_pivot = data.pivot_table('availability_365', index='neighbourhood_group', columns='room_type', aggfunc='mean')

mean_availability_365_pivot.plot.bar()

# 构建价格与房间类型,地区的联系表

mean_price_pivot = data.pivot_table('price', index='neighbourhood_group', columns='room_type', aggfunc='mean')

mean_price_pivot.plot.bar()

结果如下:

根据上述分析,我们可以得出以下结论:

为了解决本节的问题,我们首先要把最受欢迎的房子和最不受欢迎的房子提取出来并且利用**describe()**查看我们所关心的信息,代码如下:

top_10 = data.sort_values(by='number_of_reviews', ascending=False).head(10)

结果如下:

通过**describe()**进行初步观察的结果如下:

我们发现,价格数据以及最短居住时间的数据仿佛和平均值有一定的差异,我们从完整的数据取出其值并进一步对照观察。

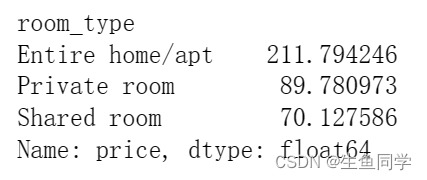

我们先来看全局的价格平均值与最欢迎的平均值的对比,代码和结果如下:

# 全局数据各房型价格的平均值

data['price'].groupby(data['room_type']).mean()

# 最受欢迎的数据各房型价格的平均值

top_10['price'].groupby(top_10['room_type']).mean()

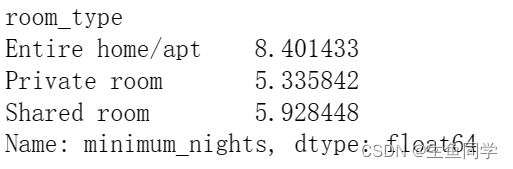

全局数据各房型价格平均值如下,结果如下:

最受欢迎的10个房型价格平均值如下:

我们发现最受欢迎的10个房型价格比平均值偏低。

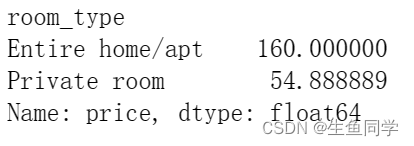

进一步的,我们对照其最小居住时长。代码和结果如下:

data['minimum_nights'].groupby(data['room_type']).mean()

top_10['minimum_nights'].groupby(top_10['room_type']).mean()

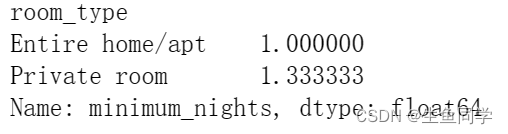

全局数据各房型价格平均值如下,结果如下:

最受欢迎的10个房型价格平均值如下:

我们发现最受欢迎的10个房型最小居住时长比平均值偏低。

类似的,我们在最不受欢迎的十个房间中也发现了相反的情况,由于篇幅限制本文不再展示过程,感兴趣的朋友可以自己试试看。

基于上述数据,我们得出结论:

在本文中,我们基于Airbnb房源进行了数据分析,并从多种角度对其展开了探索性的工作。这对于养成数据分析习惯有很大的帮助,在实际工作或者学习中还需要不断练习。

感兴趣的朋友们可以自己按照上述步骤进行操作,或在评论区与我讨论。

需要源码的朋友可以私信我进行索取,我们下次再见。

很好奇,就使用rubyonrails自动化单元测试而言,你们正在做什么?您是否创建了一个脚本来在cron中运行rake作业并将结果邮寄给您?git中的预提交Hook?只是手动调用?我完全理解测试,但想知道在错误发生之前捕获错误的最佳实践是什么。让我们理所当然地认为测试本身是完美无缺的,并且可以正常工作。下一步是什么以确保他们在正确的时间将可能有害的结果传达给您? 最佳答案 不确定您到底想听什么,但是有几个级别的自动代码库控制:在处理某项功能时,您可以使用类似autotest的内容获得关于哪些有效,哪些无效的即时反馈。要确保您的提

关闭。这个问题是opinion-based.它目前不接受答案。想要改进这个问题?更新问题,以便editingthispost可以用事实和引用来回答它.关闭4年前。Improvethisquestion我想在固定时间创建一系列低音和高音调的哔哔声。例如:在150毫秒时发出高音调的蜂鸣声在151毫秒时发出低音调的蜂鸣声200毫秒时发出低音调的蜂鸣声250毫秒的高音调蜂鸣声有没有办法在Ruby或Python中做到这一点?我真的不在乎输出编码是什么(.wav、.mp3、.ogg等等),但我确实想创建一个输出文件。

在控制台中反复尝试之后,我想到了这种方法,可以按发生日期对类似activerecord的(Mongoid)对象进行分组。我不确定这是完成此任务的最佳方法,但它确实有效。有没有人有更好的建议,或者这是一个很好的方法?#eventsisanarrayofactiverecord-likeobjectsthatincludeatimeattributeevents.map{|event|#converteventsarrayintoanarrayofhasheswiththedayofthemonthandtheevent{:number=>event.time.day,:event=>ev

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

我正在编写一个包含C扩展的gem。通常当我写一个gem时,我会遵循TDD的过程,我会写一个失败的规范,然后处理代码直到它通过,等等......在“ext/mygem/mygem.c”中我的C扩展和在gemspec的“扩展”中配置的有效extconf.rb,如何运行我的规范并仍然加载我的C扩展?当我更改C代码时,我需要采取哪些步骤来重新编译代码?这可能是个愚蠢的问题,但是从我的gem的开发源代码树中输入“bundleinstall”不会构建任何native扩展。当我手动运行rubyext/mygem/extconf.rb时,我确实得到了一个Makefile(在整个项目的根目录中),然后当

这是一道面试题,我没有答对,但还是很好奇怎么解。你有N个人的大家庭,分别是1,2,3,...,N岁。你想给你的大家庭拍张照片。所有的家庭成员都排成一排。“我是家里的friend,建议家庭成员安排如下:”1岁的家庭成员坐在这一排的最左边。每两个坐在一起的家庭成员的年龄相差不得超过2岁。输入:整数N,1≤N≤55。输出:摄影师可以拍摄的照片数量。示例->输入:4,输出:4符合条件的数组:[1,2,3,4][1,2,4,3][1,3,2,4][1,3,4,2]另一个例子:输入:5输出:6符合条件的数组:[1,2,3,4,5][1,2,3,5,4][1,2,4,3,5][1,2,4,5,3][

我已经构建了一些serverspec代码来在多个主机上运行一组测试。问题是当任何测试失败时,测试会在当前主机停止。即使测试失败,我也希望它继续在所有主机上运行。Rakefile:namespace:specdotask:all=>hosts.map{|h|'spec:'+h.split('.')[0]}hosts.eachdo|host|begindesc"Runserverspecto#{host}"RSpec::Core::RakeTask.new(host)do|t|ENV['TARGET_HOST']=hostt.pattern="spec/cfengine3/*_spec.r

有时我需要处理键/值数据。我不喜欢使用数组,因为它们在大小上没有限制(很容易不小心添加超过2个项目,而且您最终需要稍后验证大小)。此外,0和1的索引变成了魔数(MagicNumber),并且在传达含义方面做得很差(“当我说0时,我的意思是head...”)。散列也不合适,因为可能会不小心添加额外的条目。我写了下面的类来解决这个问题:classPairattr_accessor:head,:taildefinitialize(h,t)@head,@tail=h,tendend它工作得很好并且解决了问题,但我很想知道:Ruby标准库是否已经带有这样一个类? 最佳

我们的git存储库中目前有一个Gemfile。但是,有一个gem我只在我的环境中本地使用(我的团队不使用它)。为了使用它,我必须将它添加到我们的Gemfile中,但每次我checkout到我们的master/dev主分支时,由于与跟踪的gemfile冲突,我必须删除它。我想要的是类似Gemfile.local的东西,它将继承从Gemfile导入的gems,但也允许在那里导入新的gems以供使用只有我的机器。此文件将在.gitignore中被忽略。这可能吗? 最佳答案 设置BUNDLE_GEMFILE环境变量:BUNDLE_GEMFI

这似乎非常适得其反,因为太多的gem会在window上破裂。我一直在处理很多mysql和ruby-mysqlgem问题(gem本身发生段错误,一个名为UnixSocket的类显然在Windows机器上不能正常工作,等等)。我只是在浪费时间吗?我应该转向不同的脚本语言吗? 最佳答案 我在Windows上使用Ruby的经验很少,但是当我开始使用Ruby时,我是在Windows上,我的总体印象是它不是Windows原生系统。因此,在主要使用Windows多年之后,开始使用Ruby促使我切换回原来的系统Unix,这次是Linux。Rub