基于M3D-RPN实现单目3D检测 - 飞桨AI Studio

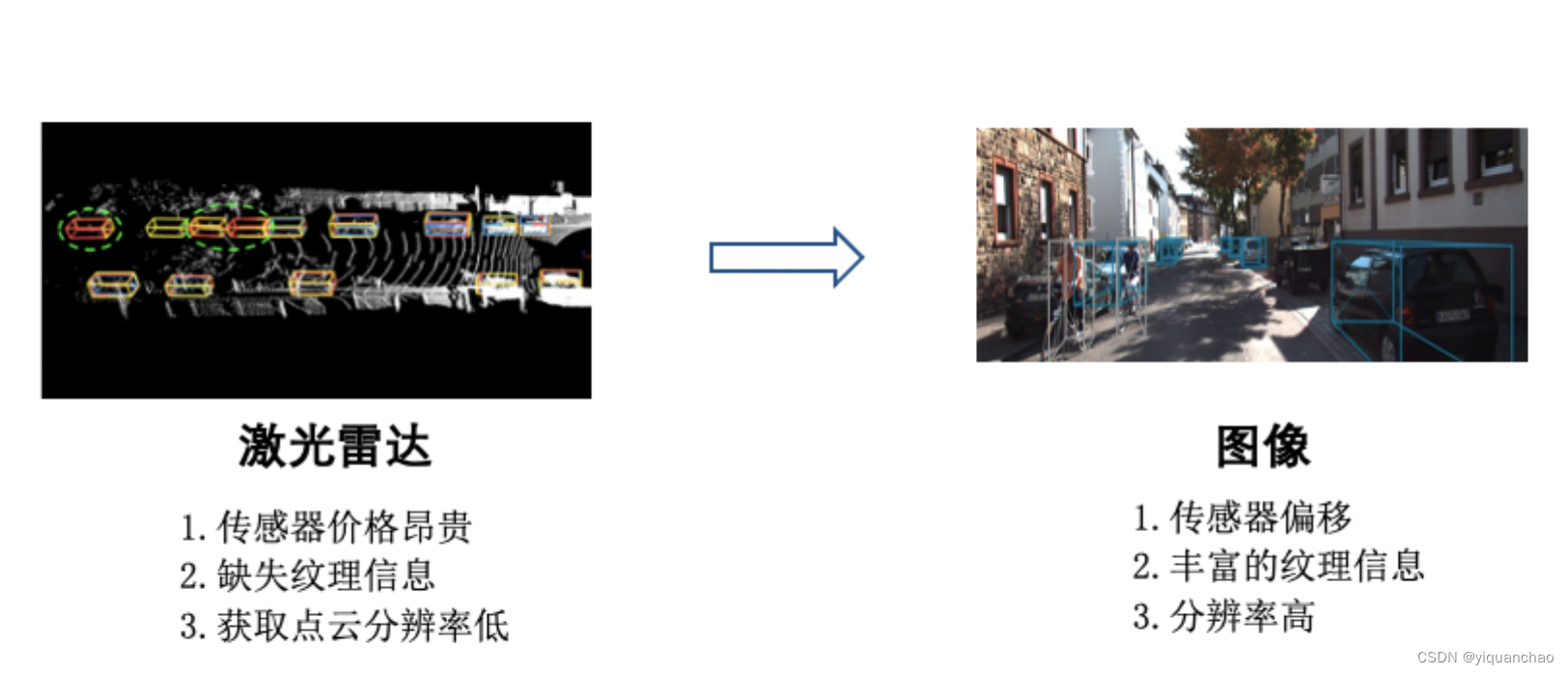

当前,3D 检测作为核心技术点,在机器人、增强现实等场景下应用广泛,发挥着至关重要的作用。传统依赖激光雷达的 3D 检测方法存在传感器昂贵难以部署,点云缺失纹理信息,分辨率低等诸多问题。

针对于此,开发单目 3D 检测模型,有效的利用图像相对于点云的种种优势,可以降低产业落地门槛,更广泛简单的部署到实际应用场景中。

单目的 3D 目标检测近几年一直是研究的热点,虽然往算法中添加先验知识,能够一定程度的提升准确率,但是也增加了获取标签的难度和算法设计的复杂性。

图 1 - 单目 3D 检测示例

欢迎扫码获取视频课程讲解,加入单目3D检测技术交流群,欢迎志同道合的同学:

方案难点:

In [ ]

# 安装库

! pip install shapely项目代码在 M3D-RPN-2.0.tar 文件中,数据集在 kitti.tar 文件中,解压到合适路径即可使用。

In [ ]

# 如果希望解压到其他目录

# 可选择其他路径(默认 /home/aistudio )

! tar xf ~/data/data141443/kitti.tar

! unzip -qo ~/data/data141443/M3D-RPN-2.0.zip

! rm -rf __MACOSXIn [ ]

# 删除已有软连接

! rm -rf ~/M3D-RPN-2.0/dataset/kitti_split1/training

! rm -rf ~/M3D-RPN-2.0/dataset/kitti_split1/validationIn [ ]

%cd ~/M3D-RPN-2.0/

! python dataset/kitti_split1/setup_split.py

! sh dataset/kitti_split1/devkit/cpp/build.sh

! cd lib/nms && makeKITTI 数据集是一个用于自动驾驶场景下的计算机视觉算法测评数据集,由德国卡尔斯鲁厄理工学院(KIT)和丰田工业大学芝加哥分校(TTIC)共同创立。包含场景有市区、乡村和高速公路。本案例使用公开的 KITTI 数据集用于训练测试,共有 14999 张图片,分为训练集 3712 张,验证集 3769 张,测试集 7518 张。示例图片如下图所示:

图 2 - KITTI 数据集示例图片

整个数据集包含图片 images,标签 labels 和相机参数 calib,每个标签文件种包含以下字段:

type---物体类别

truncated---是否截断

occluded---是否遮挡

alpha---观测角

bbox---障碍物2D框

dimension---障碍物的3D大小

location---障碍物的3D底面中心点位置

rotation_y---障碍物的朝向角

最终数据集文件组织结构为:

kitti

└── training

├── calib

├── image_2

└── label_2

单目 3D 检测提供两种选择:基于 anchor 的方案和 anchor-free 的方案

基于anchor:从图像中估计出 3D 检测框,也无需预测中间的 3D 场景表示,可以直接利用一个区域提案网络,生成给点图像的 3D 锚点。不同于以往与类别无关的 2D 锚点,3D 锚点的形状通常与其语义标签有很强的相关性。

Anchor-free:将 2D 检测方法 CenterNet 扩展到基于图像的 3D 检测器,该框架将对象编码为单个点(对象的中心点)并使用关键点估计来找到它。此外,几个平行的头被用来估计物体的其他属性,包括深度、尺寸、位置和方向。

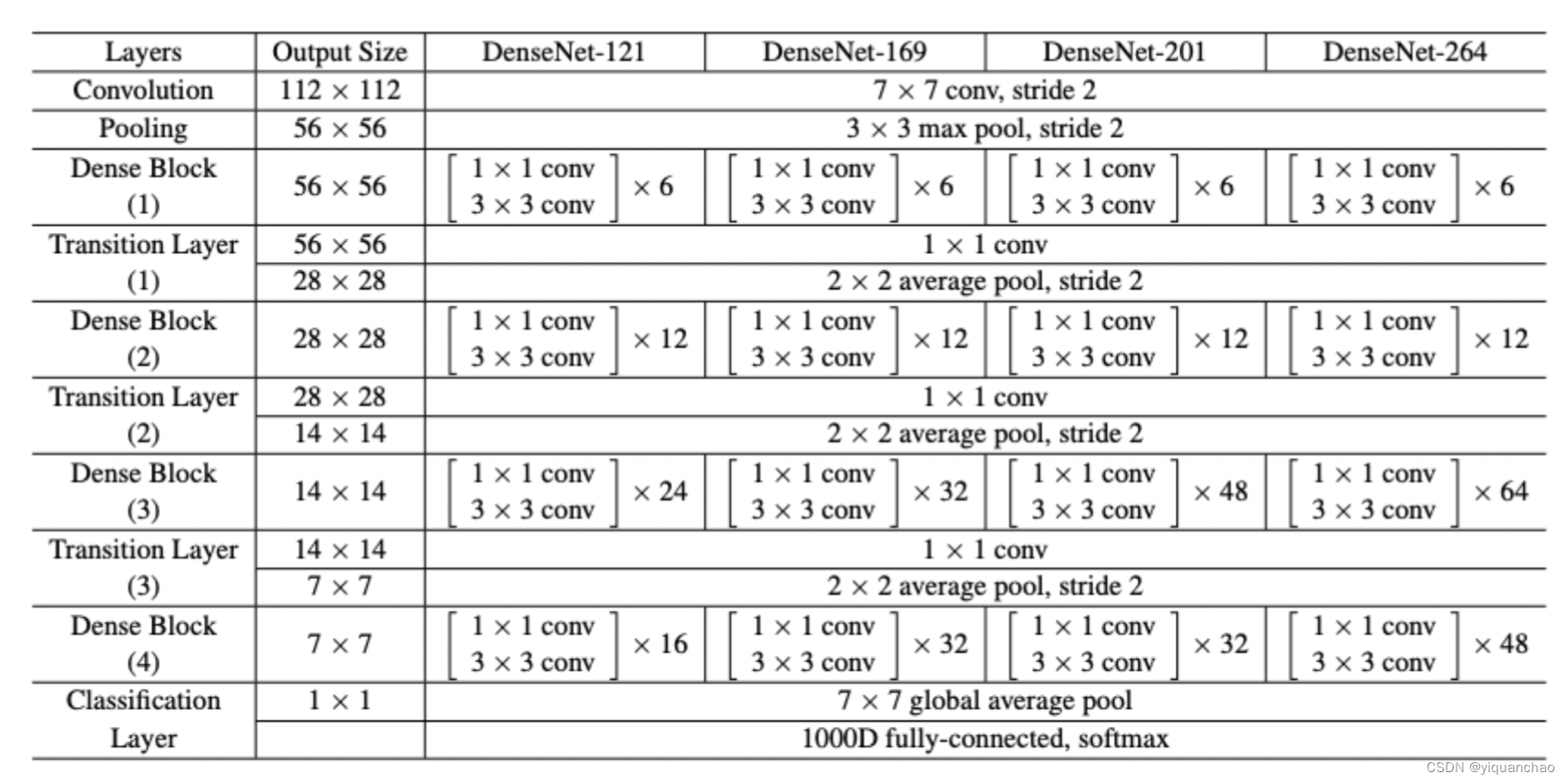

采用 anchor 的方法使用了 3D 障碍物的平均信息作为先验知识,3D 检测效果实际落地更好,所以我们采用经典的基于 anchor 的方法。在骨干网络部分,我们选择的是 DenseNet,这种网络建立的是前面所有层与后面层的密集连接,实现特征重用,有着省参数,扛过拟合等优点。我们提供了如下不同版本

图 3 - 不同版本 DenseNet

根据单目 3D 检测实时性的要求,这里我们选择了 DenseNet121 作为我们的骨干网络。

训练被拆分成了热身配置和主要配置。详细信息可查看 config 中的配置。

首先,在启动模型训练之前,可以修改配置文件中相关内容, 主要包括数据集的地址以及类别数量。对应到配置文件中的位置如下所示:

基础配置

solver_type: 'sgd'

lr: 0.004

momentum: 0.9

weight_decay: 0.0005

max_iter: 50000

snapshot_iter: 10000

display: 20

do_test: True

数据集路径

dataset_test: 'kitti_split1'

datasets_train:

name: 'kitti_split1'

anno_fmt: 'kitti_det'

im_ext: '.png'

scale: 1

还有一些其他的配置诸如优化器配置、标签信息、检测器样本等,可以在 config 目录下查看。

In [ ]

! python train.py --conf=kitti_3d_multi_warmup评估默认配置:output/kitti_3d_multi_warmup/conf.pkl

pkl配置

model: "model_3d_dilate"

solver_type: "sgd"

lr: 0.004

momentum: 0.9

max_iter: 50000

snapshot_iter: 10000

do_test: "True"

test_scale: 512

crop_size: [512, 1760]

mirror_prob: 0.5

distort_prob: -1

dataset_test: "kitti_split1"

datasets_train:

name: "kitti_split1"

anno_fmt: "kitti_det"

im_ext: ".png"

scale: 1

可视化 pkl 配置文件方法

In [ ]

import pickle

import numpy as np

PKL_PATH = 'output/kitti_3d_multi_warmup/conf.pkl'

f = open(PKL_PATH,'rb')

data = pickle.load(f)

print(data)In [1]

%cd ~/M3D-RPN-2.0

! python test.py \

--conf_path output/kitti_3d_multi_warmup/conf.pkl \

--weights_path output/kitti_3d_multi_warmup/weights/iter50000.0_params.pdparams预模型 output/kitti_3d_multi_warmup/weights/iter50000.0_params.pdparams 效果

Car

| Easy | Mod | Hard | |

|---|---|---|---|

| 2D detection | 87.27 | 81.74 | 66.60 |

| 3D BEV | 24.93 | 18.58 | 16.69 |

| 3D detection | 19.10 | 15.69 | 13.15 |

Ped

| Easy | Mod | Hard | |

|---|---|---|---|

| 2D detection | 72.47 | 58.28 | 50.07 |

| 3D BEV | 4.12 | 4.55 | 3.44 |

| 3D detection | 3.77 | 3.45 | 3.07 |

Cyclist

| Easy | Mod | Hard | |

|---|---|---|---|

| 2D detection | 63.97 | 45.97 | 39.73 |

| 3D BEV | 11.72 | 10.16 | 10.16 |

| 3D detection | 10.56 | 10.07 | 10.07 |

本小节侧重展示在模型迭代过程中优化精度的思路

数据过滤:根据 bbox 可见程度、大小来过滤每个 bbox 标签,根据有无保留 bbox 过滤每张图片,整体平衡前后背景,保证训练的稳定性。

数据增强:主要使用 RandomFlip、Resize 两种数据增强策略

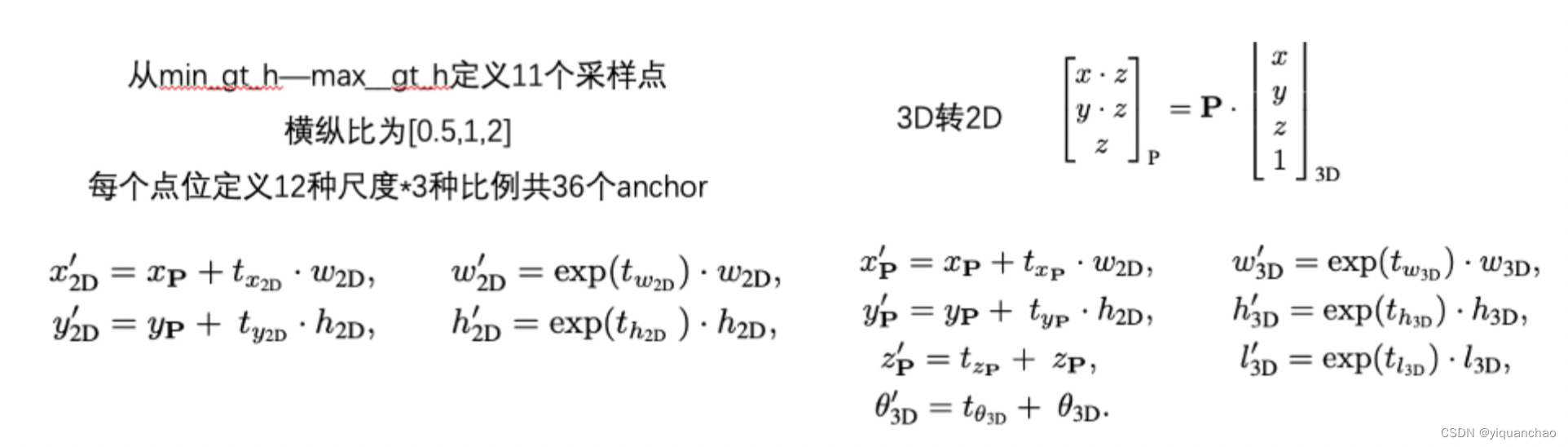

Anchor定义:模型输出

2D anchor定义3D anchor定义

后处理优化: 根据将 3D 相关信息组成 3D 框,投影到图像上得到投影的八点框,取八点最小外接包围框与 2D 预测结果算 IOU,通过不断的调整旋转角 ry 或深度 z,来使得 IOU 最大。此算法利用了 2D 检测的结果要比 3D 检测的结果准确的先验知识,用 2D 框来纠正预测的 3D 属性,来达到优化 3D 定位精度的目的。整体框架如下图所示:

经过调整后,在 car 类前后效果对比如下:

| 3D detection | Easy | Mod | Hard |

|---|---|---|---|

| 优化前 | 16.57 | 13.82 | 12.30 |

| 优化后 | 19.09 | 15.70 | 13.15 |

| 增量 | +2.52 | +1.88 | +0.85 |

推理过程包括两个步骤:1)导出推理模型 2)执行推理代码

导出推理模型

PaddlePaddle 框架保存的权重文件分为两种:支持前向推理和反向梯度的训练模型和只支持前向推理的推理模型。二者的区别是推理模型针对推理速度和显存做了优化,裁剪了一些只在训练过程中才需要的 tensor,降低显存占用,并进行了一些类似层融合,kernel 选择的速度优化。因此可执行如下命令导出推理模型。

In [2]

! python export_model.py \

--conf_path output/kitti_3d_multi_warmup/conf.pkl \

--weights_path output/kitti_3d_multi_warmup/weights/iter50000.0_params.pdparams生成的推理模型位于 inference 目录,里面包含三个文件,分别为

其中 inference.pdmodel 用来存储推理模型的结构, inference.pdiparams 和 inference.pdiparams.info 用来存储推理模型相关的参数信息。

结果保存在 inference_result 目录下。

In [4]

! python infer.py \

--conf_path output/kitti_3d_multi_warmup/conf.pklIn [ ]

! python vis.py使用飞桨原生推理库 paddle-inference,用于服务端模型部署

总体上分为三步:

#include "paddle_inference_api.h"

// 创建一个 config,并修改相关设置

paddle::NativeConfig config;

config.model_dir = "xxx";

config.use_gpu = false;

// 创建一个原生的 PaddlePredictor

auto predictor =

paddle::CreatePaddlePredictor<paddle::NativeConfig>(config);

// 创建输入 tensor

int64_t data[4] = {1, 2, 3, 4};

paddle::PaddleTensor tensor;

tensor.shape = std::vector<int>({4, 1});

tensor.data.Reset(data, sizeof(data));

tensor.dtype = paddle::PaddleDType::INT64;

// 创建输出 tensor,输出 tensor 的内存可以复用

std::vector<paddle::PaddleTensor> outputs;

// 执行预测

CHECK(predictor->Run(slots, &outputs));

// 获取 outputs ...

更多内容详见 > C++ 预测 API介绍

如何在buildr项目中使用Ruby?我在很多不同的项目中使用过Ruby、JRuby、Java和Clojure。我目前正在使用我的标准Ruby开发一个模拟应用程序,我想尝试使用Clojure后端(我确实喜欢功能代码)以及JRubygui和测试套件。我还可以看到在未来的不同项目中使用Scala作为后端。我想我要为我的项目尝试一下buildr(http://buildr.apache.org/),但我注意到buildr似乎没有设置为在项目中使用JRuby代码本身!这看起来有点傻,因为该工具旨在统一通用的JVM语言并且是在ruby中构建的。除了将输出的jar包含在一个独特的、仅限ruby

在rails源中:https://github.com/rails/rails/blob/master/activesupport/lib/active_support/lazy_load_hooks.rb可以看到以下内容@load_hooks=Hash.new{|h,k|h[k]=[]}在IRB中,它只是初始化一个空哈希。和做有什么区别@load_hooks=Hash.new 最佳答案 查看rubydocumentationforHashnew→new_hashclicktotogglesourcenew(obj)→new_has

我收到这个错误:RuntimeError(自动加载常量Apps时检测到循环依赖当我使用多线程时。下面是我的代码。为什么会这样?我尝试多线程的原因是因为我正在编写一个HTML抓取应用程序。对Nokogiri::HTML(open())的调用是一个同步阻塞调用,需要1秒才能返回,我有100,000多个页面要访问,所以我试图运行多个线程来解决这个问题。有更好的方法吗?classToolsController0)app.website=array.join(',')putsapp.websiteelseapp.website="NONE"endapp.saveapps=Apps.order("

我的主要目标是能够完全理解我正在使用的库/gem。我尝试在Github上从头到尾阅读源代码,但这真的很难。我认为更有趣、更温和的踏脚石就是在使用时阅读每个库/gem方法的源代码。例如,我想知道RubyonRails中的redirect_to方法是如何工作的:如何查找redirect_to方法的源代码?我知道在pry中我可以执行类似show-methodmethod的操作,但我如何才能对Rails框架中的方法执行此操作?您对我如何更好地理解Gem及其API有什么建议吗?仅仅阅读源代码似乎真的很难,尤其是对于框架。谢谢! 最佳答案 Ru

我的假设是moduleAmoduleBendend和moduleA::Bend是一样的。我能够从thisblog找到解决方案,thisSOthread和andthisSOthread.为什么以及什么时候应该更喜欢紧凑语法A::B而不是另一个,因为它显然有一个缺点?我有一种直觉,它可能与性能有关,因为在更多命名空间中查找常量需要更多计算。但是我无法通过对普通类进行基准测试来验证这一点。 最佳答案 这两种写作方法经常被混淆。首先要说的是,据我所知,没有可衡量的性能差异。(在下面的书面示例中不断查找)最明显的区别,可能也是最著名的,是你的

几个月前,我读了一篇关于rubygem的博客文章,它可以通过阅读代码本身来确定编程语言。对于我的生活,我不记得博客或gem的名称。谷歌搜索“ruby编程语言猜测”及其变体也无济于事。有人碰巧知道相关gem的名称吗? 最佳答案 是这个吗:http://github.com/chrislo/sourceclassifier/tree/master 关于ruby-寻找通过阅读代码确定编程语言的rubygem?,我们在StackOverflow上找到一个类似的问题:

我目前正在使用以下方法获取页面的源代码:Net::HTTP.get(URI.parse(page.url))我还想获取HTTP状态,而无需发出第二个请求。有没有办法用另一种方法做到这一点?我一直在查看文档,但似乎找不到我要找的东西。 最佳答案 在我看来,除非您需要一些真正的低级访问或控制,否则最好使用Ruby的内置Open::URI模块:require'open-uri'io=open('http://www.example.org/')#=>#body=io.read[0,50]#=>"["200","OK"]io.base_ur

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

前言作为一名程序员,自己的本质工作就是做程序开发,那么程序开发的时候最直接的体现就是代码,检验一个程序员技术水平的一个核心环节就是开发时候的代码能力。众所周知,程序开发的水平提升是一个循序渐进的过程,每一位程序员都是从“菜鸟”变成“大神”的,所以程序员在程序开发过程中的代码能力也是根据平时开发中的业务实践来积累和提升的。提高代码能力核心要素程序员要想提高自身代码能力,尤其是新晋程序员的代码能力有很大的提升空间的时候,需要针对性的去提高自己的代码能力。提高代码能力其实有几个比较关键的点,只要把握住这些方面,就能很好的、快速的提高自己的一部分代码能力。1、多去阅读开源项目,如有机会可以亲自参与开源

本教程将在Unity3D中混合Optitrack与数据手套的数据流,在人体运动的基础上,添加双手手指部分的运动。双手手背的角度仍由Optitrack提供,数据手套提供双手手指的角度。 01 客户端软件分别安装MotiveBody与MotionVenus并校准人体与数据手套。MotiveBodyMotionVenus数据手套使用、校准流程参照:https://gitee.com/foheart_1/foheart-h1-data-summary.git02 数据转发打开MotiveBody软件的Streaming,开始向Unity3D广播数据;MotionVenus中设置->选项选择Unit