SpringCloud微服务技术栈.黑马跟学一

首先明白 SpringCloud != 微服务

应用场景:

• 找工作

面试必问微服务

企业开发也都使用微服务

• 降低成本

互联网发展迅速,业务更新迭代快

微服务符合敏捷开发需求

• 激发程序员

架构师和操作人员受性能驱动,使用最好的工具来解决他们遇到的技术和业务问题

• 快速迭代

互联网发展迅速,业务更新迭代快

微服务符合敏捷开发需求

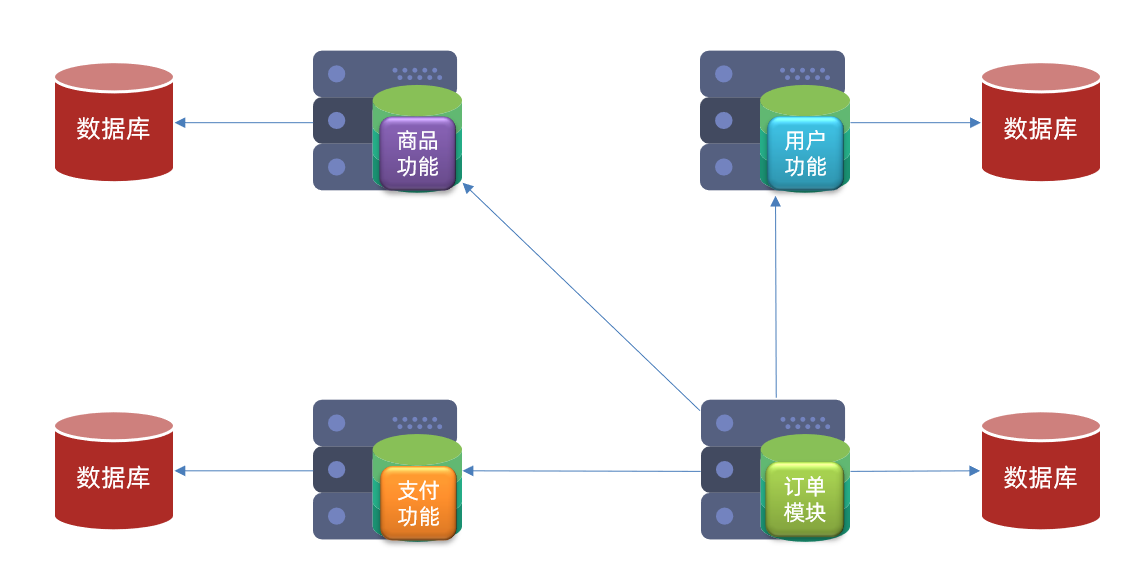

核心思想是拆分,把大的业务模块划分成多个小的模块,每个模块叫服务。多个服务形成了服务集群。

服务集群多了之后,各个服务之间的调用关系会很复杂,需要靠注册中心管理。

同理,随着服务集群的增多,配置文件也不断增长需要配置中心来管理(实现配置的热更新)。

用户访问组件需要经过网关,其作用主要是:身份验证、路由规则、负载均衡。

把数据库数据放入内存中,为了应对高并发,不能是单体缓存而是集群,称为分布式缓存。

进行搜索的时候用上分布式搜索。

最后还需要异步通信的消息队列,为了减少服务通知的链路,缩短响应时间,增加吞吐量。

最后这么多组件,一旦出了问题,不好定位,引入分布式日志服务。

实时监控系统中各个服务的状态和内存占用,可以定位到某个方法栈信息,便于找到异常所在称为系统监控链路追踪。

微笑服务的部署,只靠人工比较麻烦,我们引入Jenkins对微服务项目进行自动化编译,用Docker进行打包和镜像再基于kubernets或者RANCHER实现自动化的部署。这些就叫做持续集成。

分层次教学

学习路径:

每天任务

今日学习目标:

随着互联网行业的发展,对服务的要求也越来越高,服务架构也从单体架构逐渐演变为现在流行的微服务架构。这些架构之间有怎样的差别呢?

了解微服务架构的优缺点

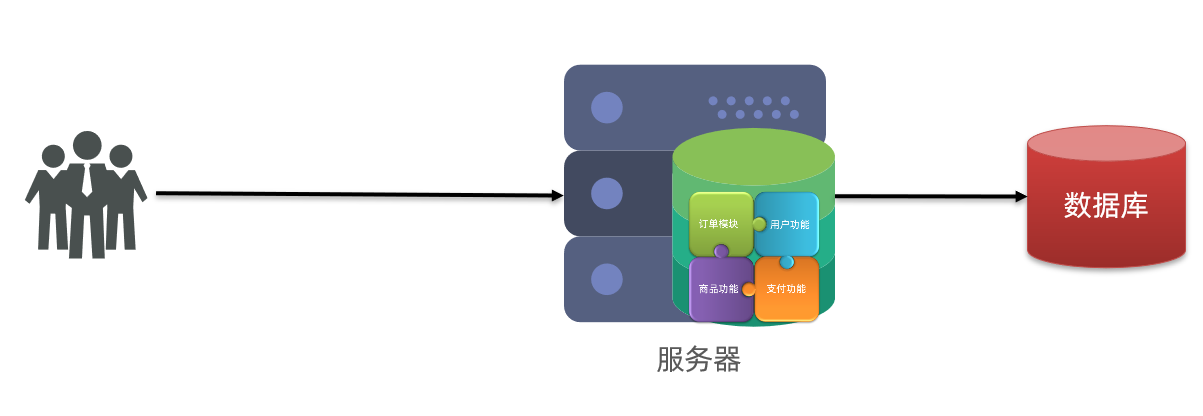

单体架构:将业务的所有功能集中在一个项目中开发,打成一个包部署。

单体架构的优缺点如下:

优点:

缺点:

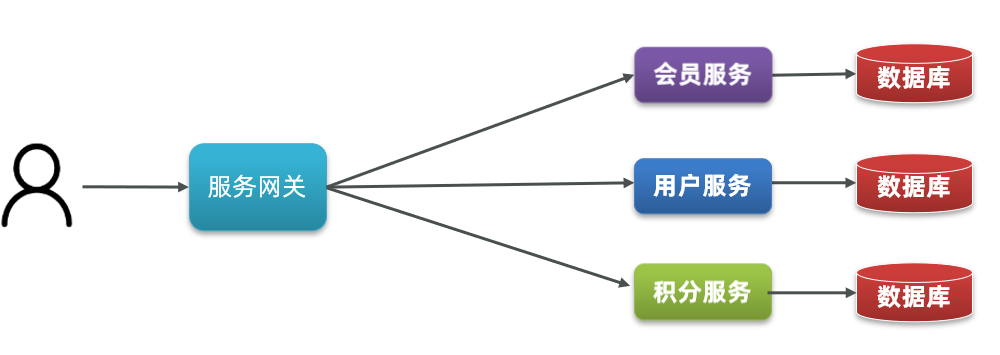

分布式架构:根据业务功能对系统做拆分,每个业务功能模块作为独立项目开发,称为一个服务。

分布式架构的优缺点:

优点:

缺点:

分布式架构虽然降低了服务耦合,但是服务拆分时也有很多问题需要思考:

人们需要制定一套行之有效的标准来约束分布式架构。

微服务的架构特征:

因此,可以认为微服务是一种经过良好架构设计的分布式架构方案 。

但方案该怎么落地?选用什么样的技术栈?全球的互联网公司都在积极尝试自己的微服务落地方案。

其中在Java领域最引人注目的就是SpringCloud提供的方案了。

微服务技术对比

企业需求:以下4种技术选型

SpringCloud是目前国内使用最广泛的微服务框架。官网地址:SpringCloud官网。

SpringCloud集成了各种微服务功能组件,并基于SpringBoot实现了这些组件的自动装配,从而提供了良好的开箱即用体验。

其中常见的组件包括:

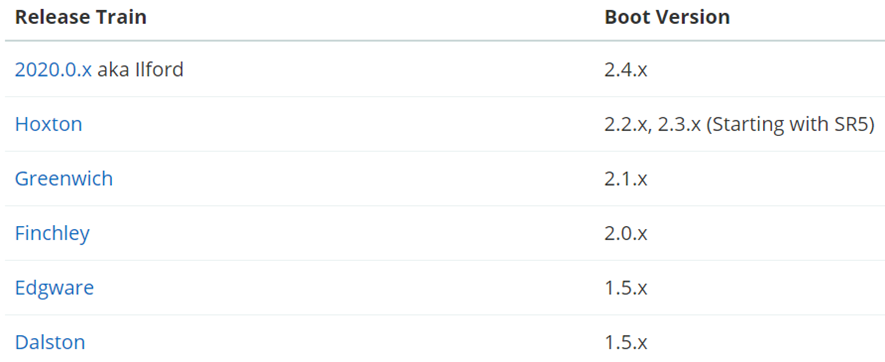

另外,SpringCloud底层是依赖于SpringBoot的,并且有版本的兼容关系,如下:

我们课堂学习的版本是 Hoxton.SR10,因此对应的SpringBoot版本是2.3.x版本。

单体架构:简单方便,高度耦合,扩展性差,适合小型项目。例如:学生管理系统

分布式架构:松耦合,扩展性好,但架构复杂,难度大。适合大型互联网项目,例如:京东、淘宝

微服务:一种良好的分布式架构方案

①优点:拆分粒度更小、服务更独立、耦合度更低

②缺点:架构非常复杂,运维、监控、部署难度提高

SpringCloud是微服务架构的一站式解决方案,集成了各种优秀微服务功能组件

任何分布式架构都离不开服务的拆分,微服务也是一样。

这里我总结了微服务拆分时的几个原则:

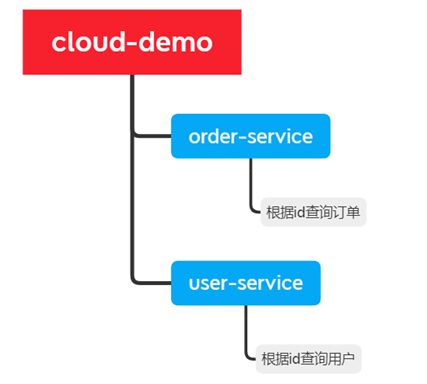

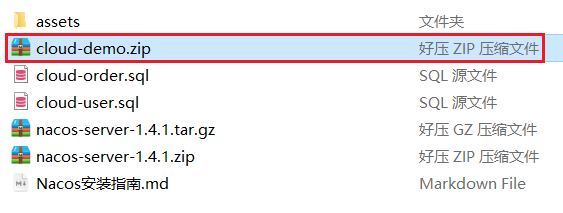

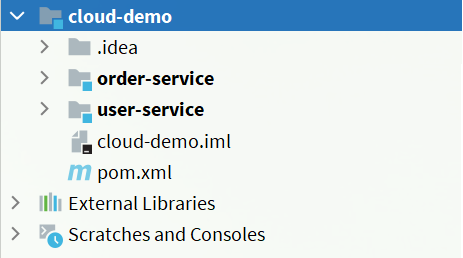

以课前资料中的微服务cloud-demo为例,其结构如下:

cloud-demo:父工程,管理依赖

要求:

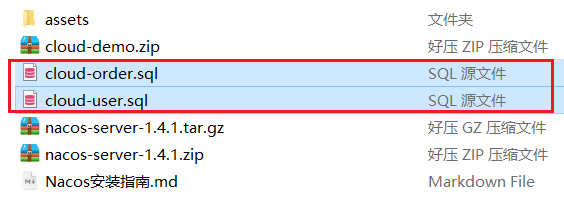

首先,将课前资料提供的cloud-order.sql和cloud-user.sql导入到mysql中:

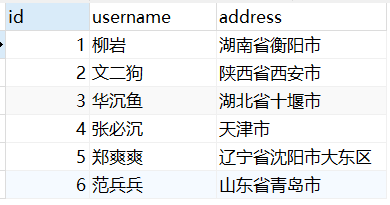

cloud-user表中初始数据如下:

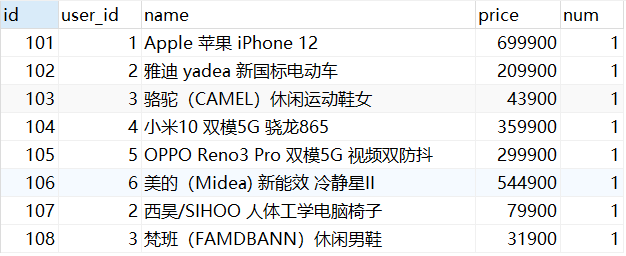

cloud-order表中初始数据如下:

cloud-order表中持有cloud-user表中的id字段。

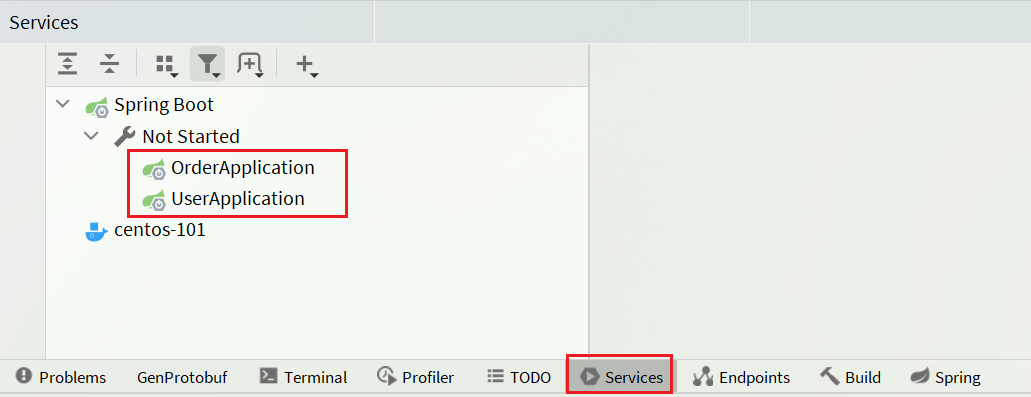

用IDEA导入课前资料提供的Demo:

项目结构如下:

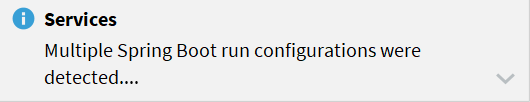

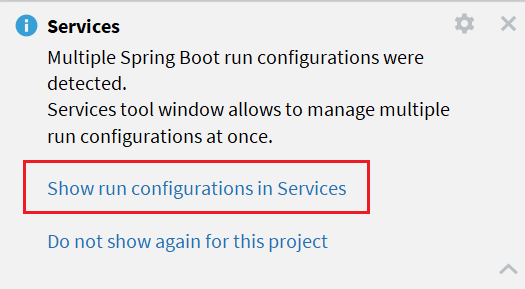

导入后,会在IDEA右下角出现弹窗:

点击弹窗,然后按下图选择:

会出现这样的菜单:

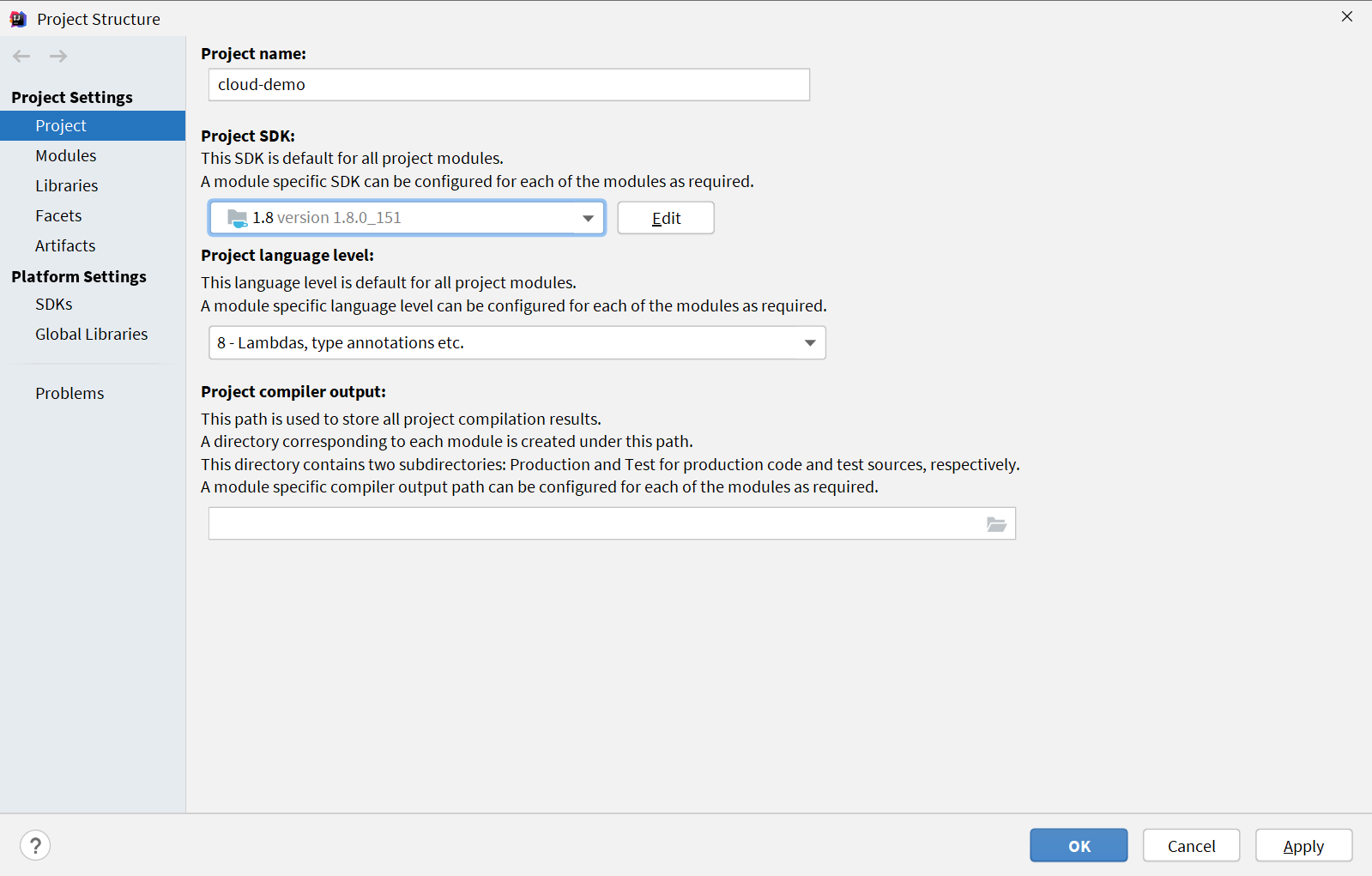

配置下项目使用的JDK:

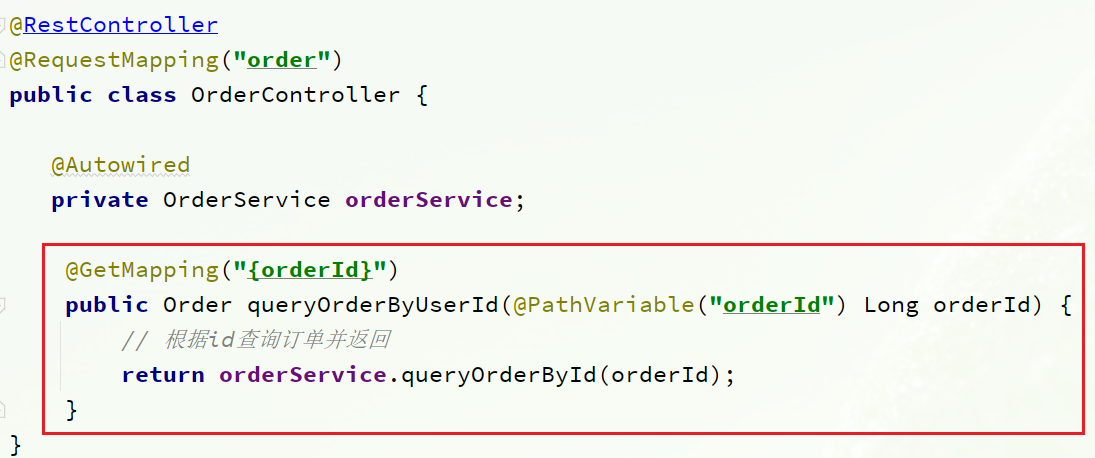

在order-service服务中,有一个根据id查询订单的接口:

根据id查询订单,返回值是Order对象,如图:

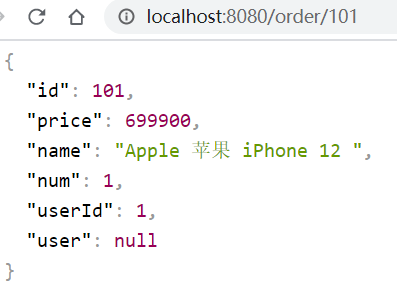

http://localhost:8080/order/101

其中的user为null

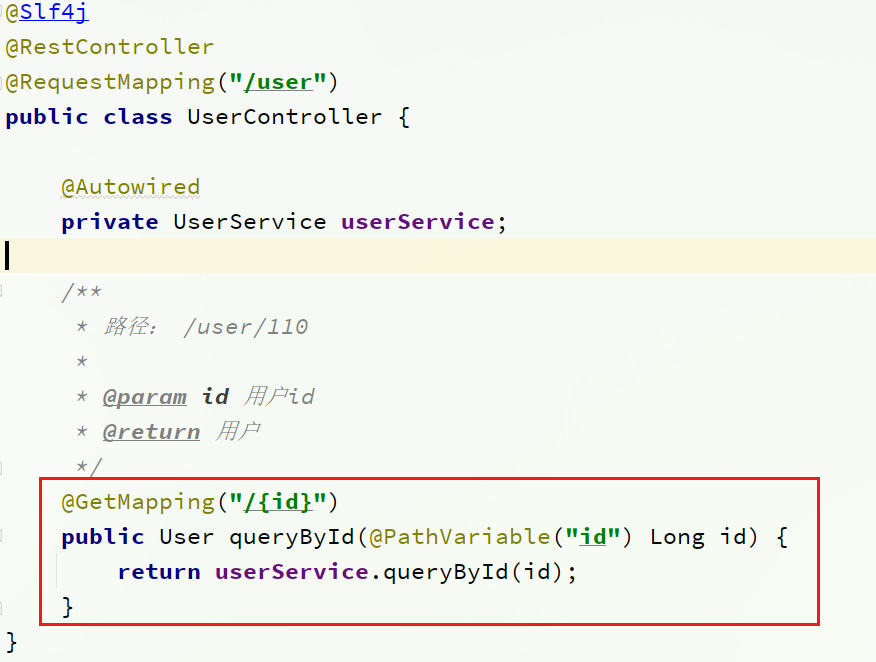

在user-service中有一个根据id查询用户的接口:

查询的结果如图:

http://localhost:8081/user/1

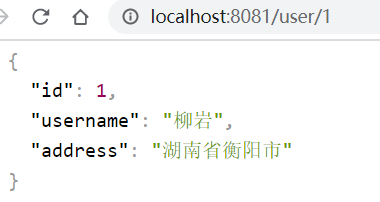

修改order-service中的根据id查询订单业务,要求在查询订单的同时,根据订单中包含的userId查询出用户信息,一起返回。可以看到目前是这样的:

需求设计图:

因此,我们需要在order-service中 向user-service发起一个http的请求,调用http://localhost:8081/user/{userId}这个接口。

大概的步骤是这样的:

首先,我们在order-service服务中的OrderApplication启动类中,注册RestTemplate实例:

package cn.itcast.order;

import org.mybatis.spring.annotation.MapperScan;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.context.annotation.Bean;

import org.springframework.web.client.RestTemplate;

@MapperScan("cn.itcast.order.mapper")

@SpringBootApplication

public class OrderApplication {

public static void main(String[] args) {

SpringApplication.run(OrderApplication.class, args);

}

@Bean

public RestTemplate restTemplate() {

return new RestTemplate();

}

}

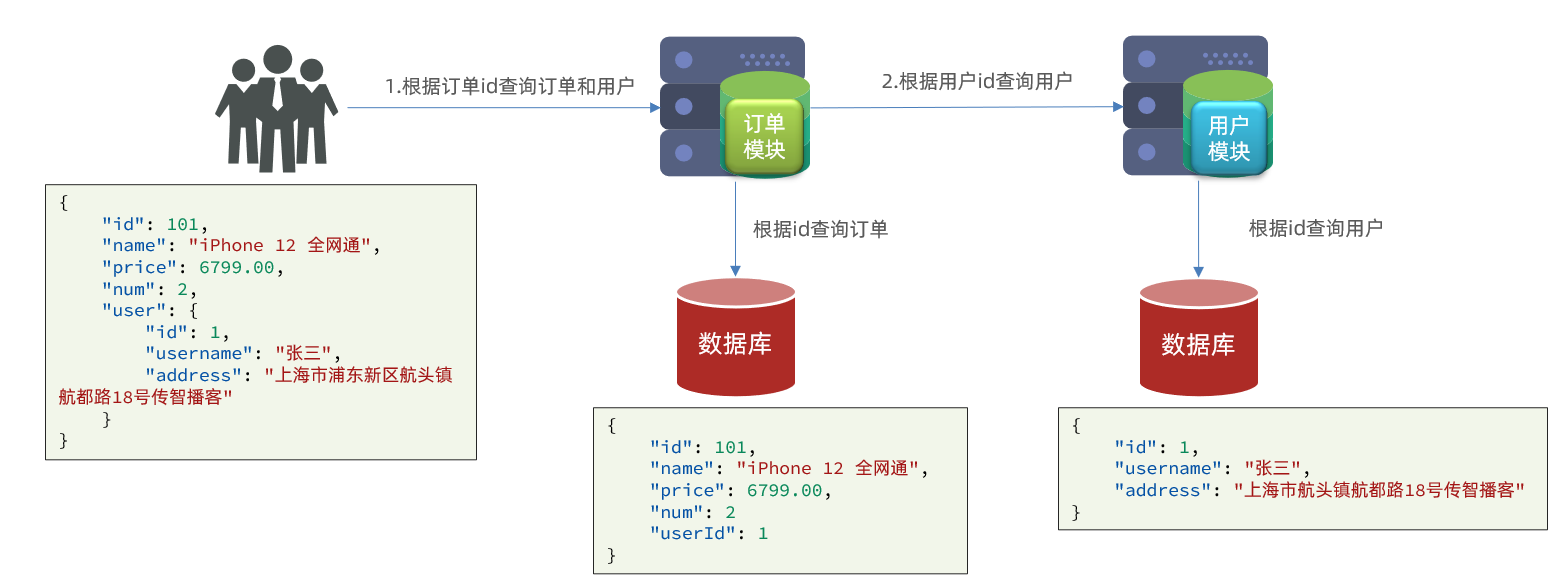

修改order-service服务中的cn.itcast.order.service包下的OrderService类中的queryOrderById方法:

在服务调用关系中,会有两个不同的角色:

服务提供者:一次业务中,被其它微服务调用的服务。(提供接口给其它微服务)

服务消费者:一次业务中,调用其它微服务的服务。(调用其它微服务提供的接口)

但是,服务提供者与服务消费者的角色并不是绝对的,而是相对于业务而言。

如果服务A调用了服务B,而服务B又调用了服务C,服务B的角色是什么?

因此,服务B既可以是服务提供者,也可以是服务消费者。

需要删除

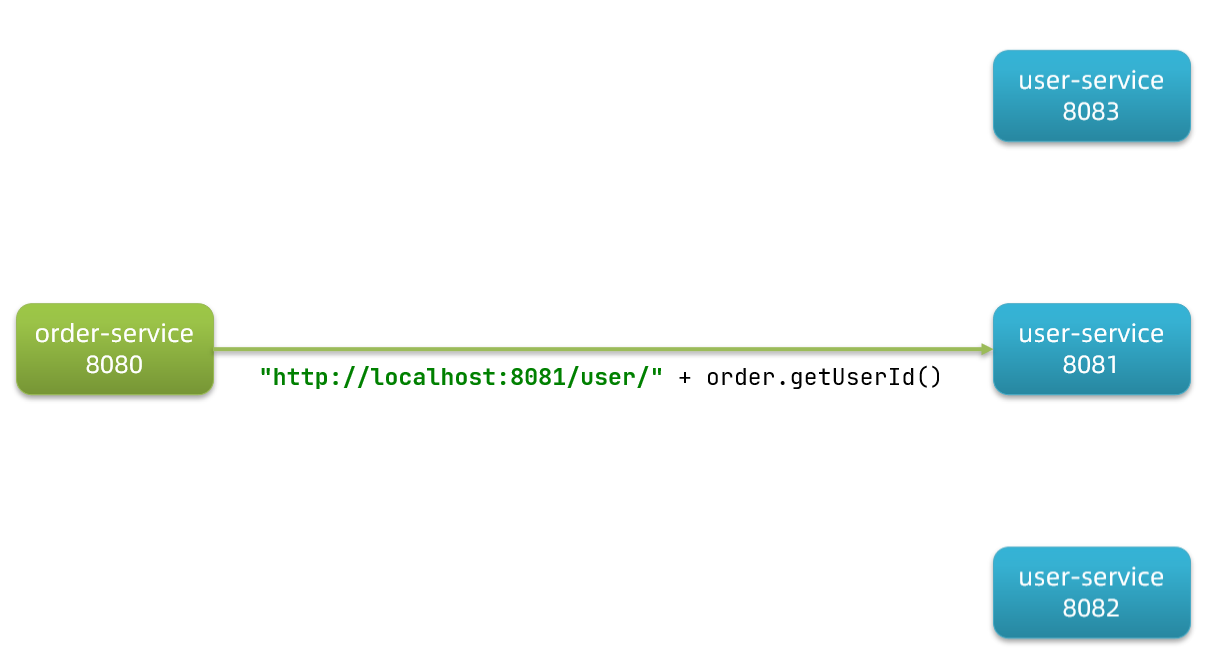

假如我们的服务提供者user-service部署了多个实例,如图:

大家思考几个问题:

这些问题都需要利用SpringCloud中的注册中心来解决,其中最广为人知的注册中心就是Eureka,其结构如下:

回答之前的各个问题。

问题1:order-service如何得知user-service实例地址?

获取地址信息的流程如下:

问题2:order-service如何从多个user-service实例中选择具体的实例?

问题3:order-service如何得知某个user-service实例是否依然健康,是不是已经宕机?

注意:一个微服务,既可以是服务提供者,又可以是服务消费者,因此eureka将服务注册、服务发现等功能统一封装到了eureka-client端

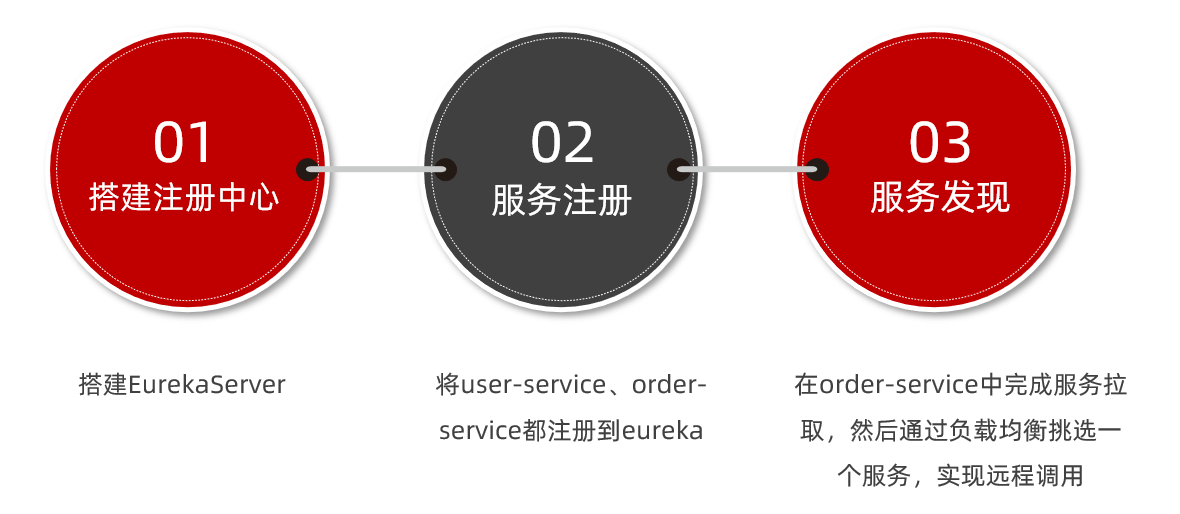

因此,接下来我们动手实践的步骤包括:

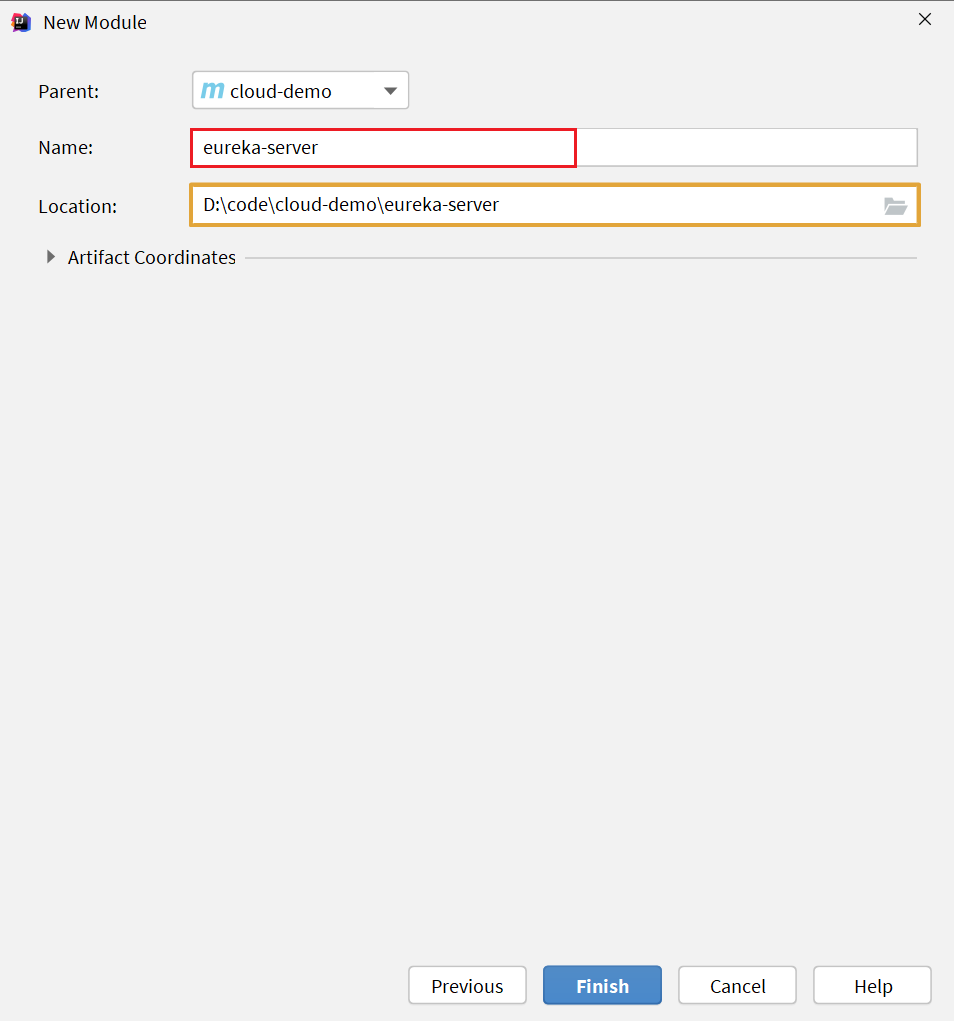

首先大家注册中心服务端:eureka-server,这必须是一个独立的微服务

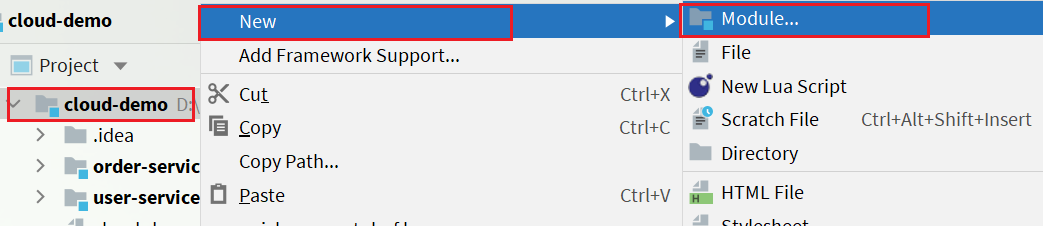

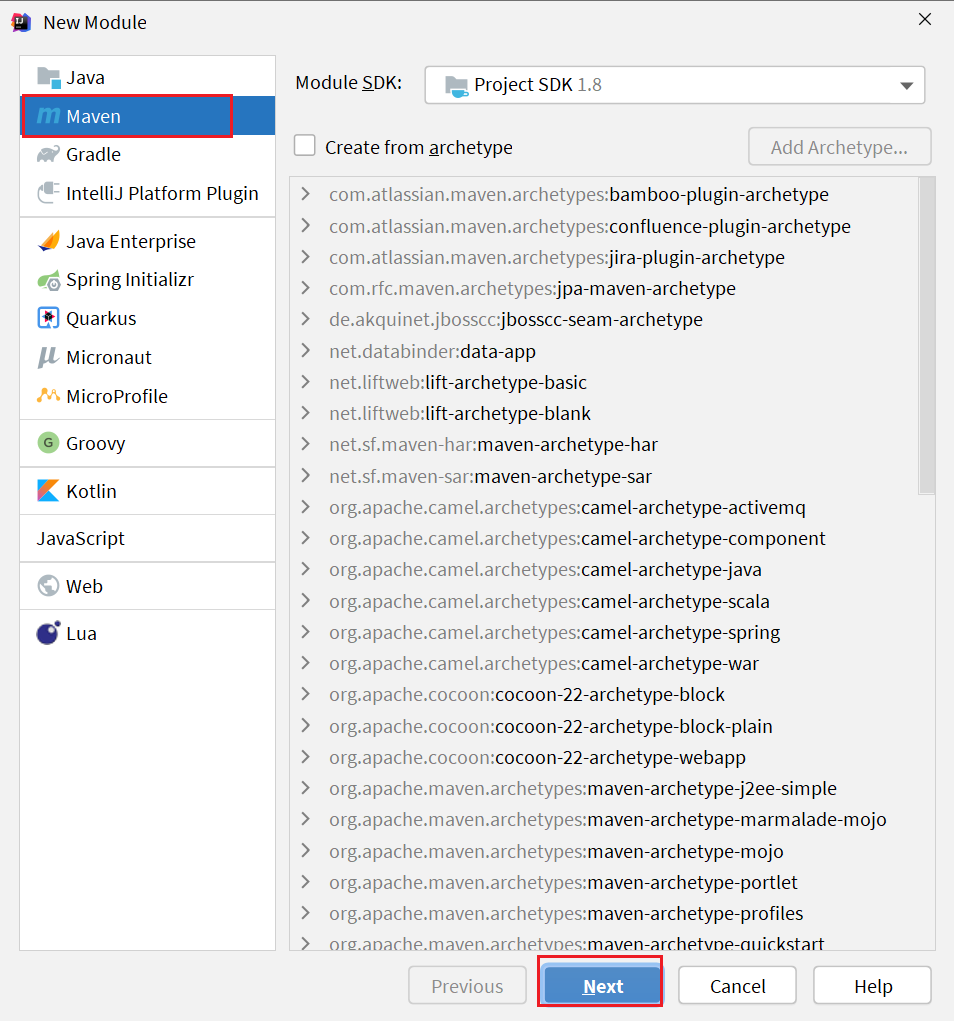

在cloud-demo父工程下,创建一个子模块:

填写模块信息:

然后填写服务信息:

name:eureka-server

引入SpringCloud为eureka提供的starter依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-server</artifactId>

</dependency>

给eureka-server服务编写一个启动类,一定要添加一个@EnableEurekaServer注解,开启eureka的注册中心功能:

package cn.itcast.eureka;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.cloud.netflix.eureka.server.EnableEurekaServer;

@SpringBootApplication

@EnableEurekaServer

public class EurekaApplication {

public static void main(String[] args) {

SpringApplication.run(EurekaApplication.class, args);

}

}

编写一个application.yml文件,内容如下:

server:

port: 10086

spring:

application:

name: eureka-server

eureka:

client:

service-url:

defaultZone: http://127.0.0.1:10086/eureka

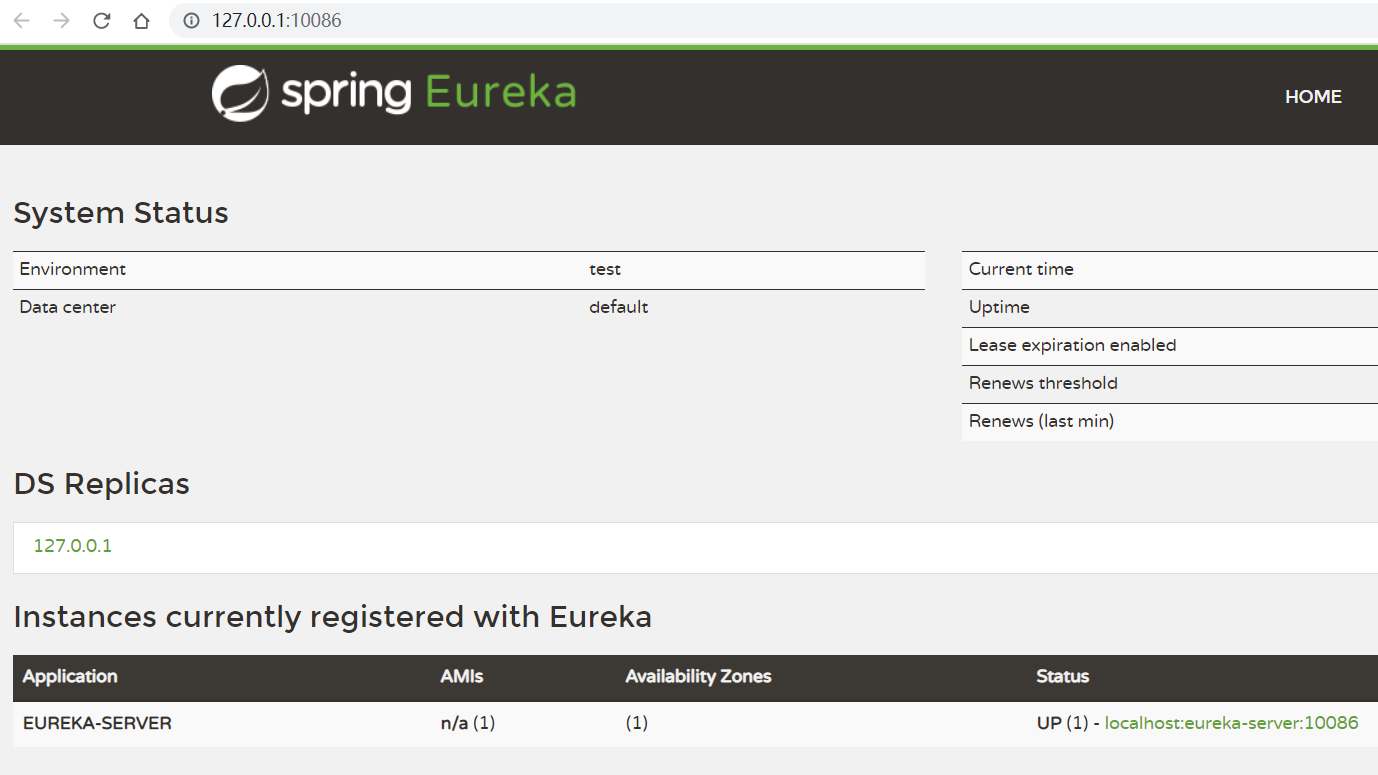

启动微服务,然后在浏览器访问:http://127.0.0.1:10086

看到下面结果应该是成功了:

Status一栏,UP表示正常,DOWN表示宕机

下面,我们将user-service注册到eureka-server中去。

在user-service的pom文件中,引入下面的eureka-client依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

在user-service中,修改application.yml文件,添加服务名称、eureka地址:

spring:

application:

name: userservice

eureka:

client:

service-url:

defaultZone: http://127.0.0.1:10086/eureka

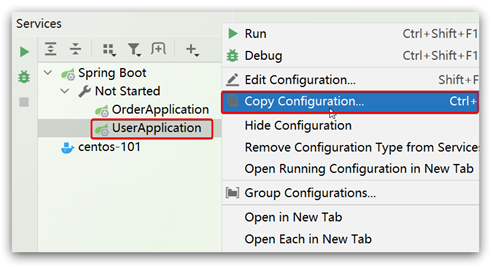

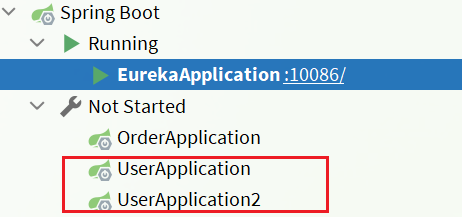

为了演示一个服务有多个实例的场景,我们添加一个SpringBoot的启动配置,再启动一个user-service。

• 首先,复制原来的user-service启动配置:

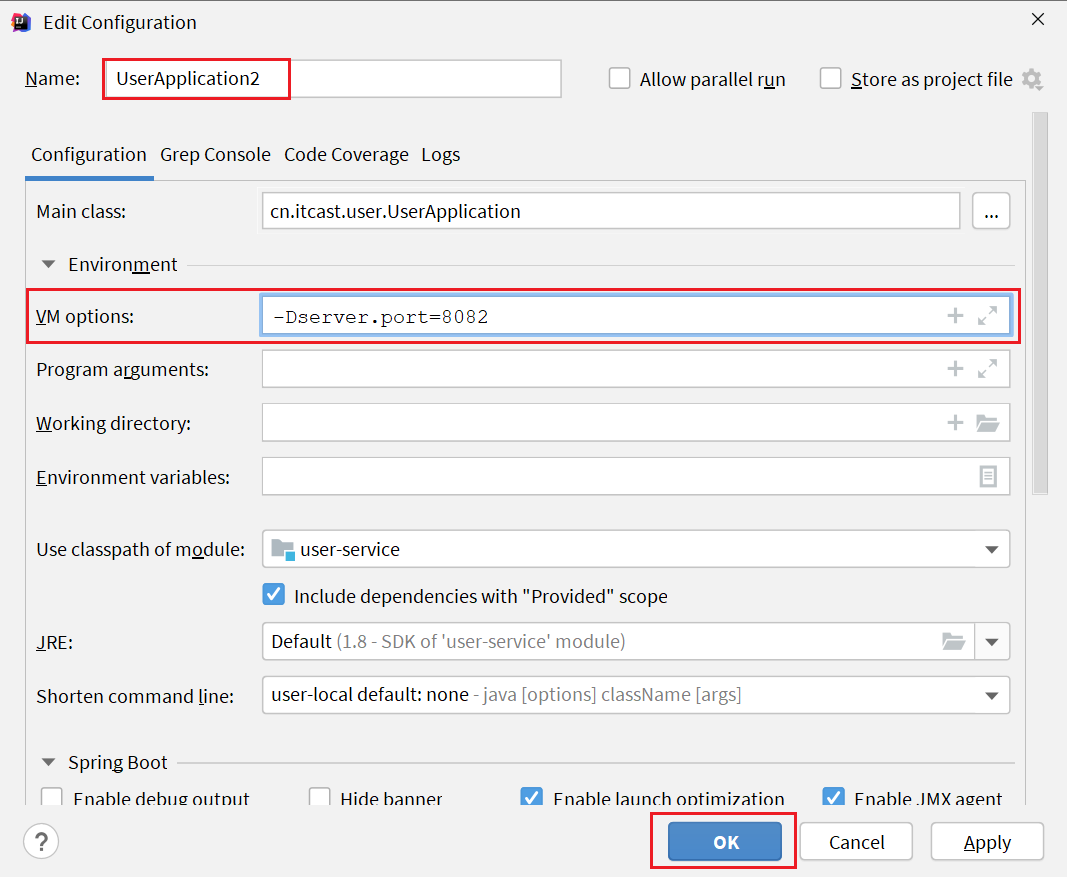

• 然后,在弹出的窗口中,填写信息:

-Dserver.port=8082

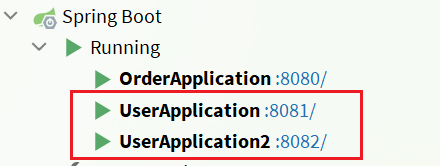

现在,SpringBoot窗口会出现两个user-service启动配置:

不过,第一个是8081端口,第二个是8082端口。

启动两个user-service实例:

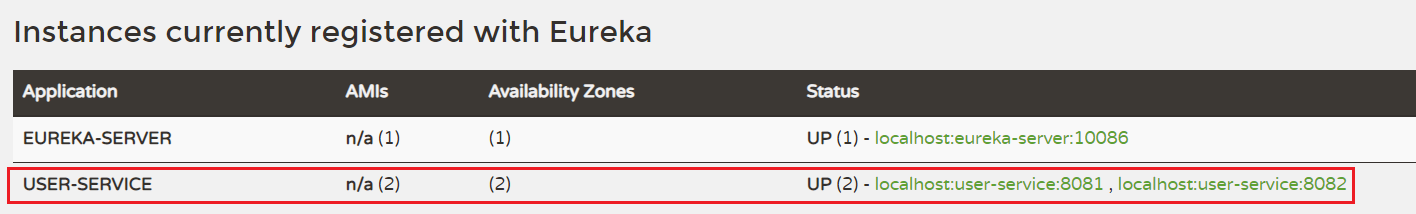

查看eureka-server管理页面:

下面,我们将order-service的逻辑修改:向eureka-server拉取user-service的信息,实现服务发现。

之前说过,服务发现、服务注册统一都封装在eureka-client依赖,因此这一步与服务注册时一致。

在order-service的pom文件中,引入下面的eureka-client依赖:

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-netflix-eureka-client</artifactId>

</dependency>

服务发现也需要知道eureka地址,因此第二步与服务注册一致,都是配置eureka信息:

在order-service中,修改application.yml文件,添加服务名称、eureka地址:

spring:

application:

name: orderservice

eureka:

client:

service-url:

defaultZone: http://127.0.0.1:10086/eureka

登录后看到4个服务都注册了,并且能监控到

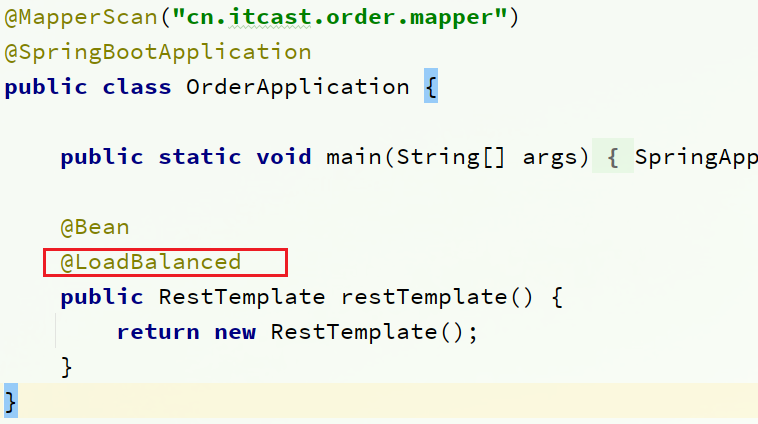

最后,我们要去eureka-server中拉取user-service服务的实例列表,并且实现负载均衡。

不过这些动作不用我们去做,只需要添加一些注解即可。

在order-service的OrderApplication中,给RestTemplate这个Bean添加一个@LoadBalanced注解:

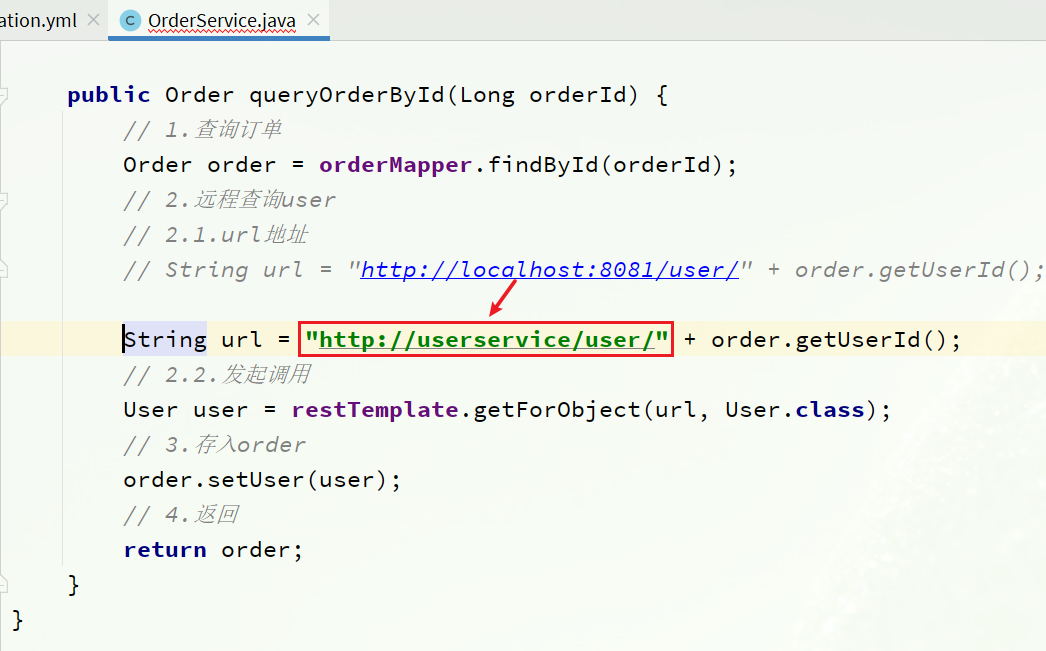

修改order-service服务中的cn.itcast.order.service包下的OrderService类中的queryOrderById方法。修改访问的url路径,用服务名代替ip、端口:

spring会自动帮助我们从eureka-server端,根据userservice这个服务名称,获取实例列表,而后完成负载均衡。

最后我们连续2次访问order

http://localhost:8080/order/102

和

http://localhost:8080/order/101

发现经过负载均衡,user的2个服务器都进行了调用,有日志信息输出。

上一节中,我们添加了@LoadBalanced注解,即可实现负载均衡功能,这是什么原理呢?

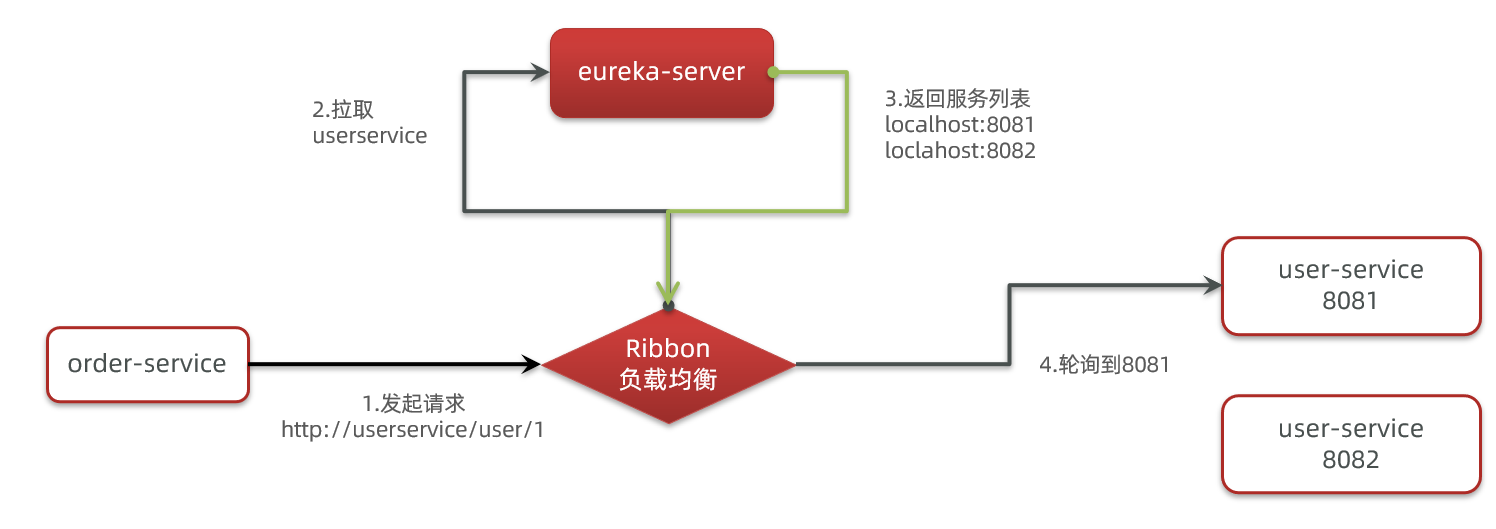

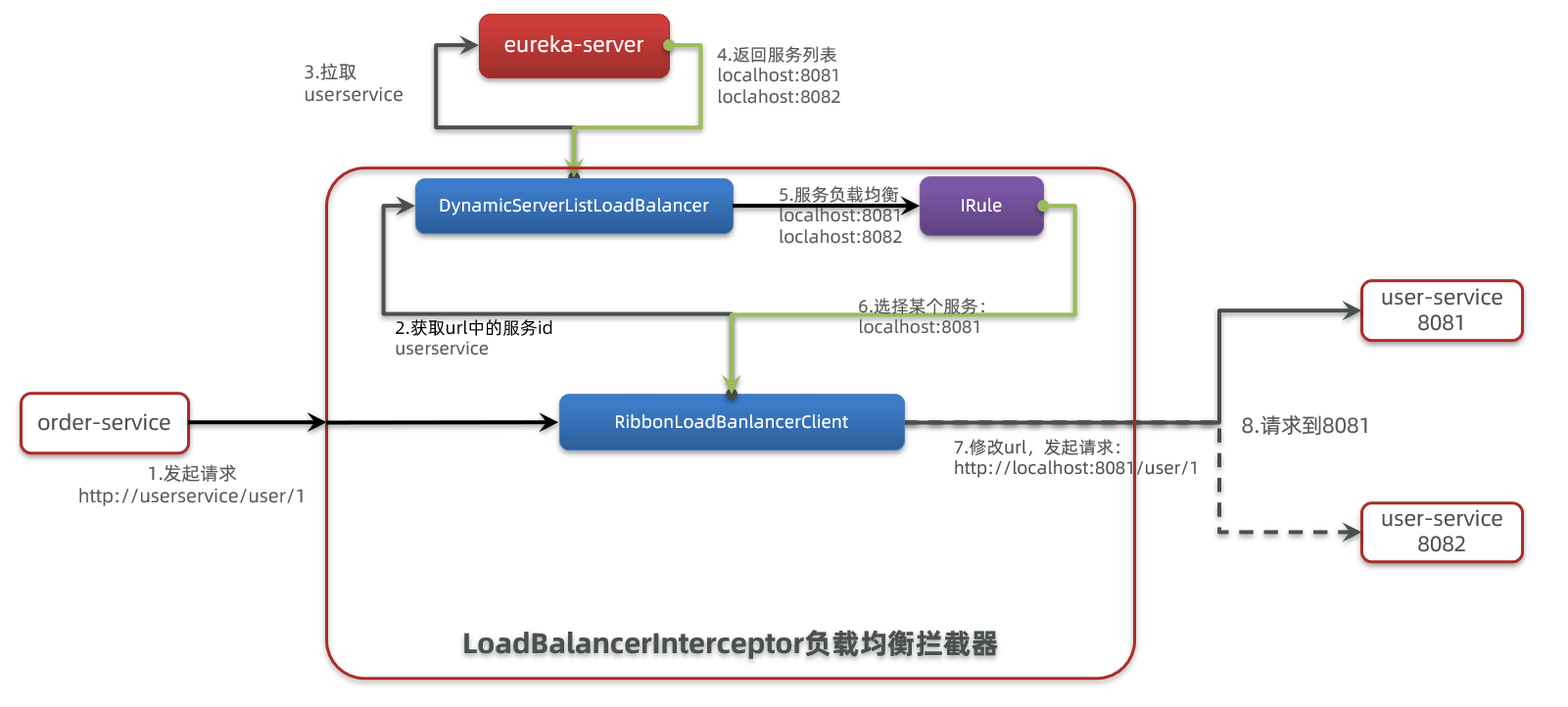

SpringCloud底层其实是利用了一个名为Ribbon的组件,来实现负载均衡功能的。

那么我们发出的请求明明是http://userservice/user/1,怎么变成了http://localhost:8081的呢?

为什么我们只输入了service名称就可以访问了呢?之前还要获取ip和端口。

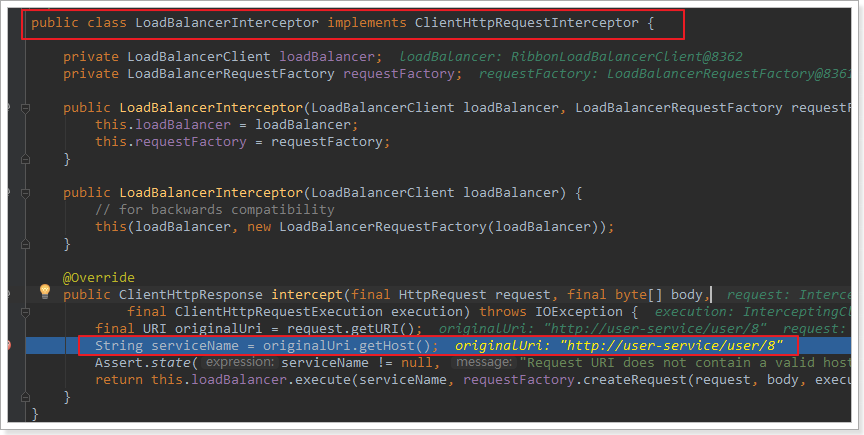

显然有人帮我们根据service名称,获取到了服务实例的ip和端口。它就是LoadBalancerInterceptor,这个类会在对RestTemplate的请求进行拦截,然后从Eureka根据服务id获取服务列表,随后利用负载均衡算法得到真实的服务地址信息,替换服务id。

我们进行源码跟踪:

可以看到这里的intercept方法,拦截了用户的HttpRequest请求,然后做了几件事:

request.getURI():获取请求uri,本例中就是 http://user-service/user/8originalUri.getHost():获取uri路径的主机名,其实就是服务id,user-servicethis.loadBalancer.execute():处理服务id,和用户请求。这里的this.loadBalancer是LoadBalancerClient类型,我们继续跟入。

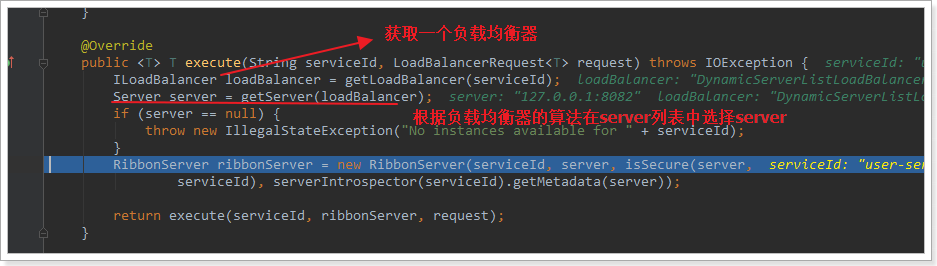

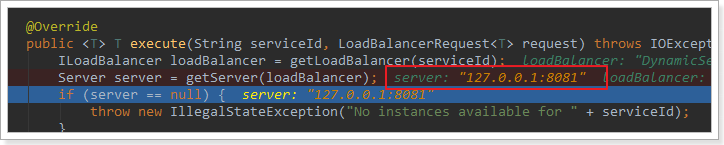

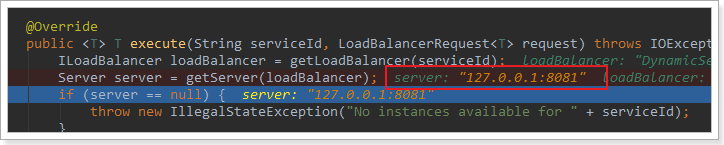

继续跟入execute方法:

代码是这样的:

• getLoadBalancer(serviceId):根据服务id获取ILoadBalancer,而ILoadBalancer会拿着服务id去eureka中获取服务列表并保存起来。

• getServer(loadBalancer):利用内置的负载均衡算法,从服务列表中选择一个。本例中,可以看到获取了8082端口的服务

放行后,再次访问并跟踪,发现获取的是8081:

果然实现了负载均衡。

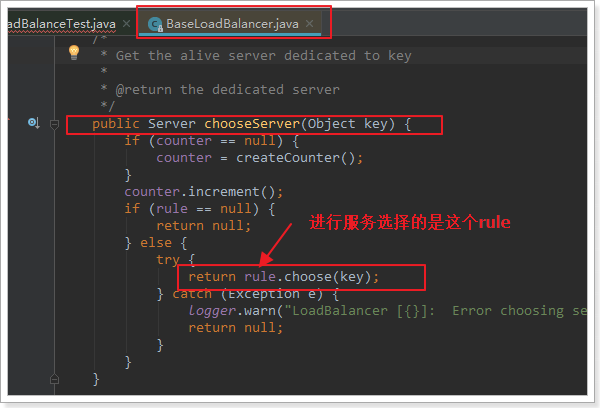

在刚才的代码中,可以看到获取服务使通过一个getServer方法来做负载均衡:

我们继续跟入:

继续跟踪源码chooseServer方法,发现这么一段代码:

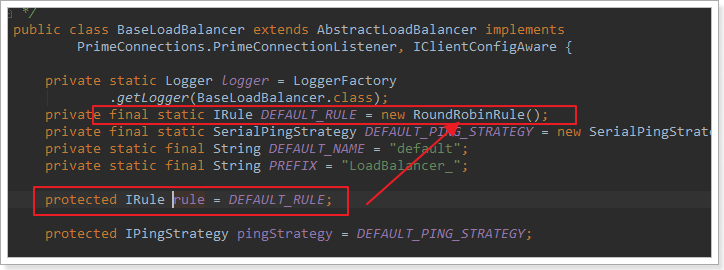

我们看看这个rule是谁:

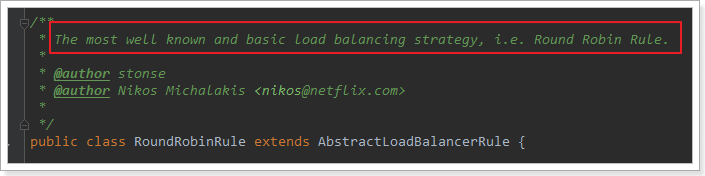

这里的rule默认值是一个RoundRobinRule,看类的介绍:

这不就是轮询的意思嘛。

到这里,整个负载均衡的流程我们就清楚了。

SpringCloudRibbon的底层采用了一个拦截器,拦截了RestTemplate发出的请求,对地址做了修改。用一幅图来总结一下:

基本流程如下:

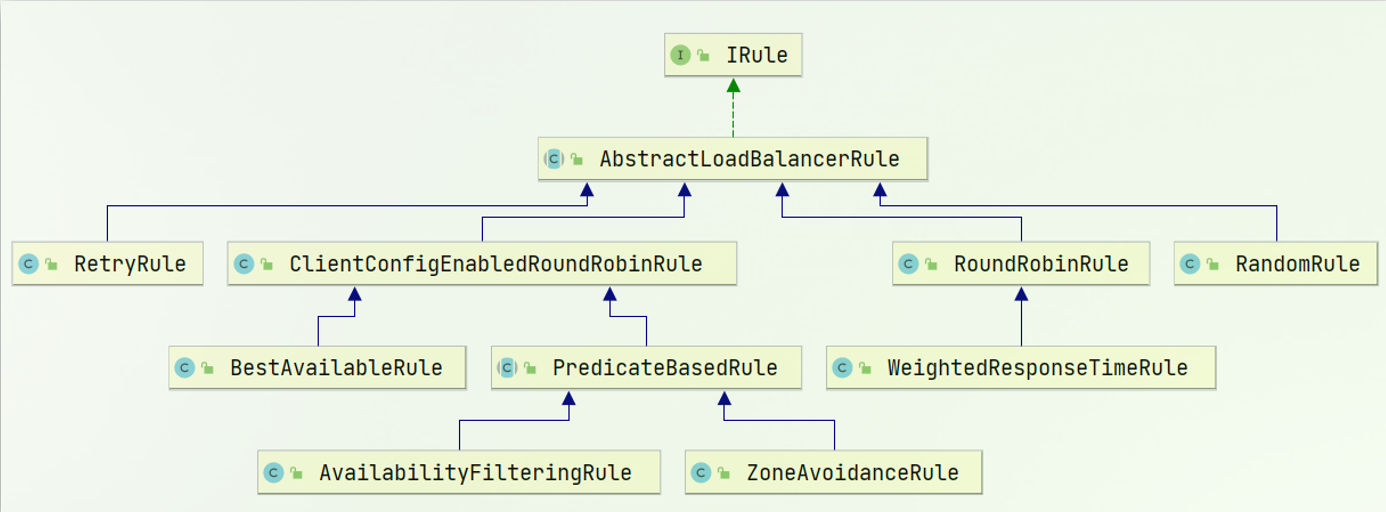

负载均衡的规则都定义在IRule接口中,而IRule有很多不同的实现类:

不同规则的含义如下:

| 内置负载均衡规则类 | 规则描述 |

|---|---|

| RoundRobinRule | 简单轮询服务列表来选择服务器。它是Ribbon默认的负载均衡规则。 |

| AvailabilityFilteringRule | 对以下两种服务器进行忽略: (1)在默认情况下,这台服务器如果3次连接失败,这台服务器就会被设置为“短路”状态。短路状态将持续30秒,如果再次连接失败,短路的持续时间就会几何级地增加。 (2)并发数过高的服务器。如果一个服务器的并发连接数过高,配置了AvailabilityFilteringRule规则的客户端也会将其忽略。并发连接数的上限,可以由客户端的< clientName >.< clientConfigNameSpace >.ActiveConnectionsLimit属性进行配置。 |

| WeightedResponseTimeRule | 为每一个服务器赋予一个权重值。服务器响应时间越长,这个服务器的权重就越小。这个规则会随机选择服务器,这个权重值会影响服务器的选择。 |

ZoneAvoidanceRule | 以区域可用的服务器为基础进行服务器的选择。使用Zone对服务器进行分类,这个Zone可以理解为一个机房、一个机架等。而后再对Zone内的多个服务做轮询。 |

| BestAvailableRule | 忽略那些短路的服务器,并选择并发数较低的服务器。 |

| RandomRule | 随机选择一个可用的服务器。 |

| RetryRule | 重试机制的选择逻辑 |

默认的实现就是ZoneAvoidanceRule,是一种轮询方案

通过定义IRule实现可以修改负载均衡规则,有两种方式:

@Bean

public IRule randomRule(){

return new RandomRule();

}

userservice: # 给某个微服务配置负载均衡规则,这里是userservice服务

ribbon:

NFLoadBalancerRuleClassName: com.netflix.loadbalancer.RandomRule # 负载均衡规则

注意,一般用默认的负载均衡规则,不做修改。

我们重启order-service,访问

http://localhost:8080/order/101

发现耗时700多ms

我们刷新一下发现耗时明显减少了

为什么第一次耗时这么长,之后就明显减少了呢?

Ribbon默认是采用懒加载,即第一次访问时才会去创建LoadBalanceClient,请求时间会很长。

那我们想降低第一次访问的耗时该怎么办呢?

而饥饿加载则会在项目启动时创建,降低第一次访问的耗时,通过下面配置开启饥饿加载:

ribbon:

eager-load:

enabled: true

clients: userservice

# 多个需要用-分割、换行

# -userservice1

# -userservice2

我们重启OrderApplication然后看一下首次加载的速度

控制台明显看到加载的时候,就把8081和8082端口进行了创建

访问时间相比700多ms也减少了,没减很多是还有dispatcherservlet的加载

国内公司一般都推崇阿里巴巴的技术,比如注册中心,SpringCloudAlibaba也推出了一个名为Nacos的注册中心。

Nacos是阿里巴巴的产品,现在是SpringCloud中的一个组件。相比Eureka功能更加丰富,在国内受欢迎程度较高。

安装方式如下:

开发阶段采用单机安装即可。

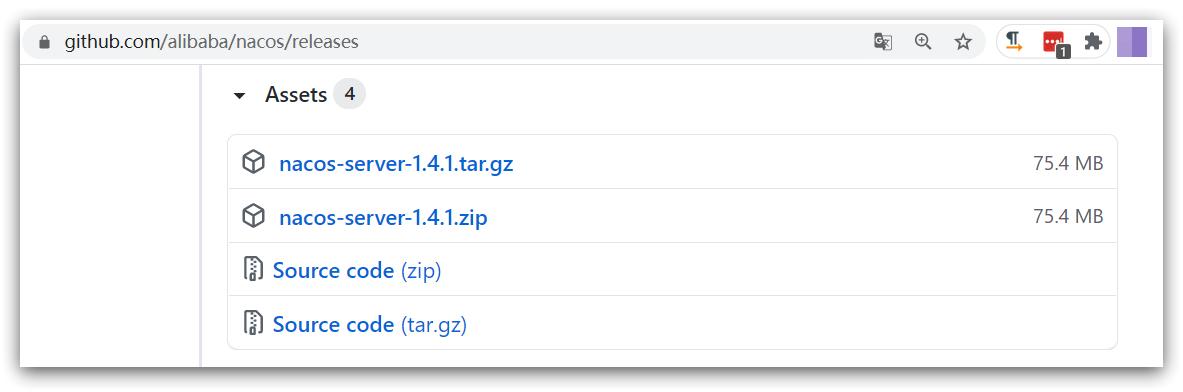

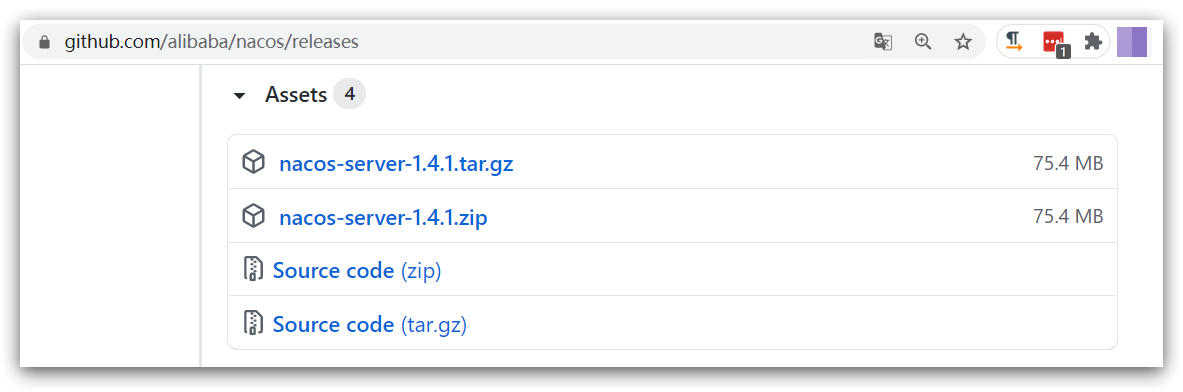

在Nacos的GitHub页面,提供有下载链接,可以下载编译好的Nacos服务端或者源代码:

GitHub主页:Nacos官网

GitHub的Release下载页:Nacos下载页

如图:

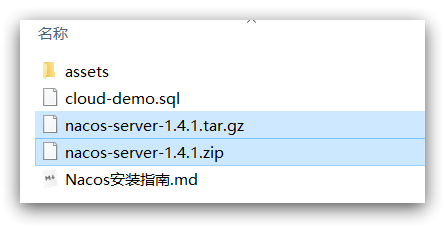

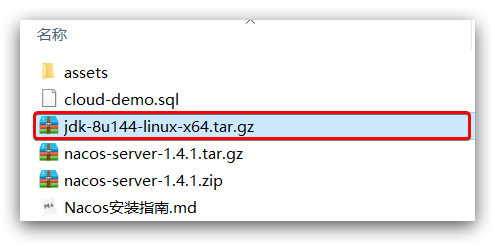

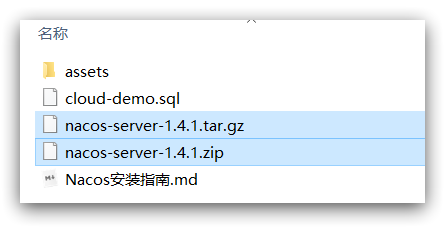

本课程采用1.4.1.版本的Nacos,课前资料已经准备了安装包:

windows版本使用nacos-server-1.4.1.zip包即可。

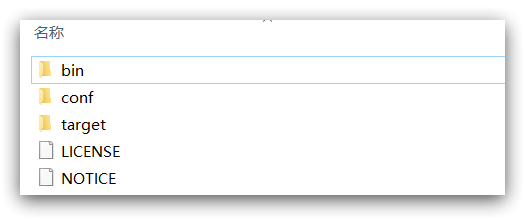

将这个包解压到任意非中文目录下,如图:

目录说明:

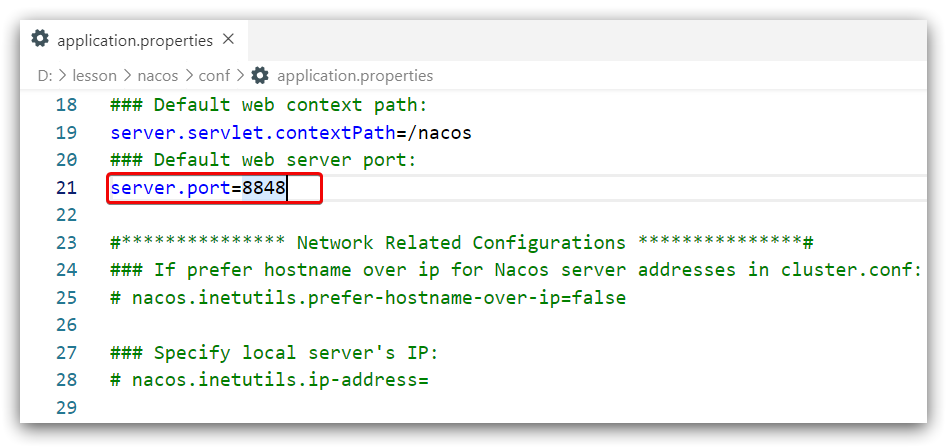

Nacos的默认端口是8848,如果你电脑上的其它进程占用了8848端口,请先尝试关闭该进程。

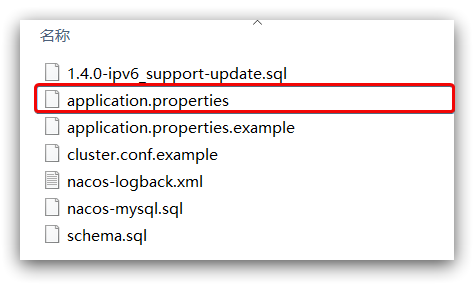

如果无法关闭占用8848端口的进程,也可以进入nacos的conf目录,修改配置文件中的端口:

修改其中的内容:

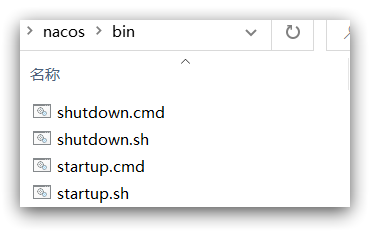

启动非常简单,进入bin目录,结构如下:

然后执行命令即可:

./startup.cmd -m standalone

执行后的效果如图:

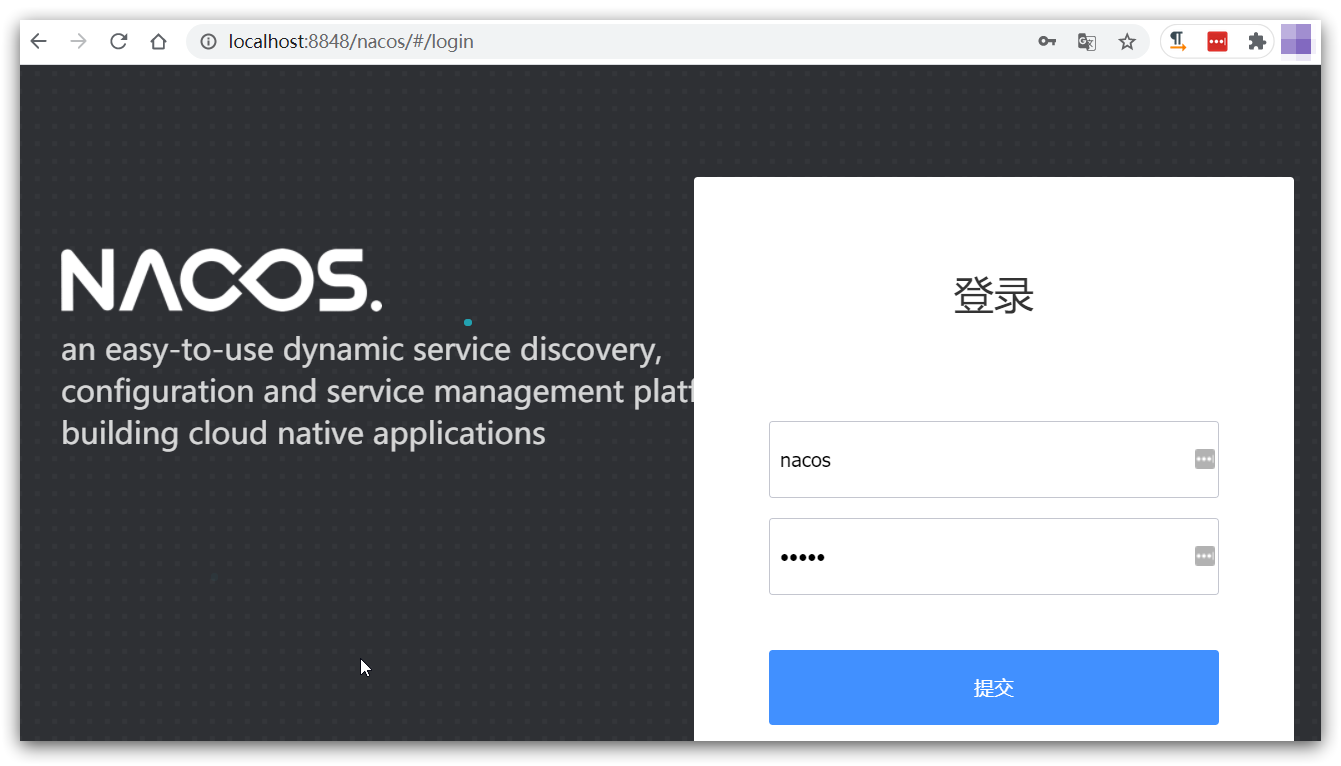

在浏览器输入地址:http://127.0.0.1:8848/nacos即可:

默认的账号和密码都是nacos,进入后:

Linux或者Mac安装方式与Windows类似。

Nacos依赖于JDK运行,所以Linux上也需要安装JDK才行。

上传jdk安装包:

上传到某个目录,例如:/usr/local/

然后解压缩:

tar -xvf jdk-8u144-linux-x64.tar.gz

然后重命名为java

配置环境变量:

export JAVA_HOME=/usr/local/java

export PATH=$PATH:$JAVA_HOME/bin

设置环境变量:

source /etc/profile

如图:

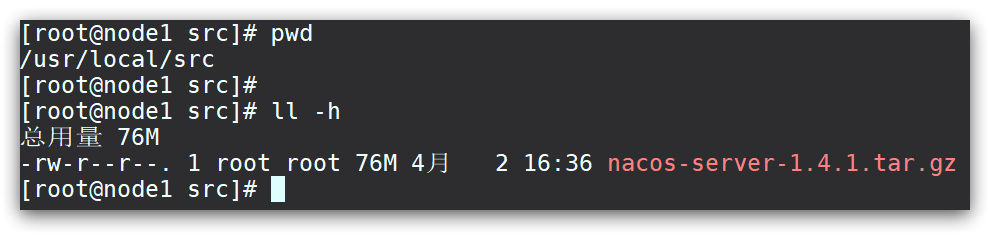

也可以直接使用课前资料中的tar.gz:

上传到Linux服务器的某个目录,例如/usr/local/src目录下:

命令解压缩安装包:

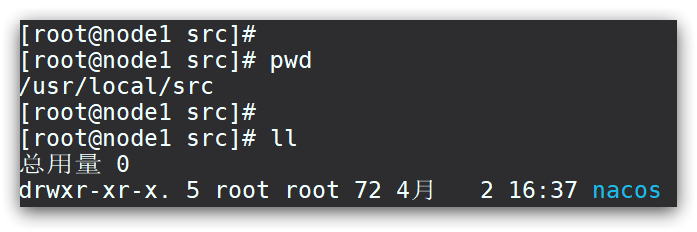

tar -zxvf nacos-server-1.4.1.tar.gz

然后删除安装包:

rm -rf nacos-server-1.4.1.tar.gz

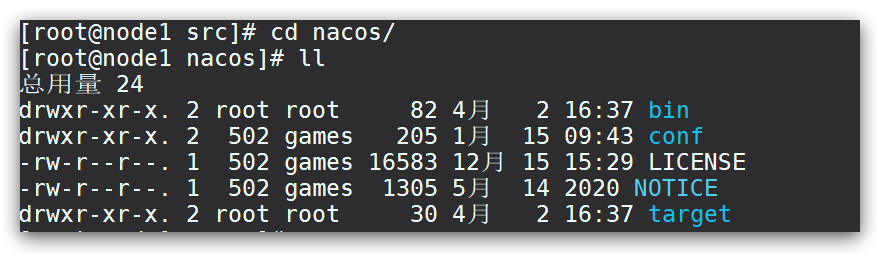

目录中最终样式:

目录内部:

与windows中类似

在nacos/bin目录中,输入命令启动Nacos:

sh startup.sh -m standalone

父工程:

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>2.2.5.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

客户端:

<!-- nacos客户端依赖包 -->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

Nacos是SpringCloudAlibaba的组件,而SpringCloudAlibaba也遵循SpringCloud中定义的服务注册、服务发现规范。因此使用Nacos和使用Eureka对于微服务来说,并没有太大区别。

主要差异在于:

在cloud-demo父工程的pom文件中的<dependencyManagement>中引入SpringCloudAlibaba的依赖:

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>2.2.6.RELEASE</version>

<type>pom</type>

<scope>import</scope>

</dependency>

然后在user-service和order-service中的pom文件中引入nacos-discovery依赖:

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

注意:不要忘了注释掉eureka的依赖。

在user-service和order-service的application.yml中添加nacos地址:

spring:

cloud:

nacos:

server-addr: localhost:8848

注意:不要忘了注释掉eureka的地址

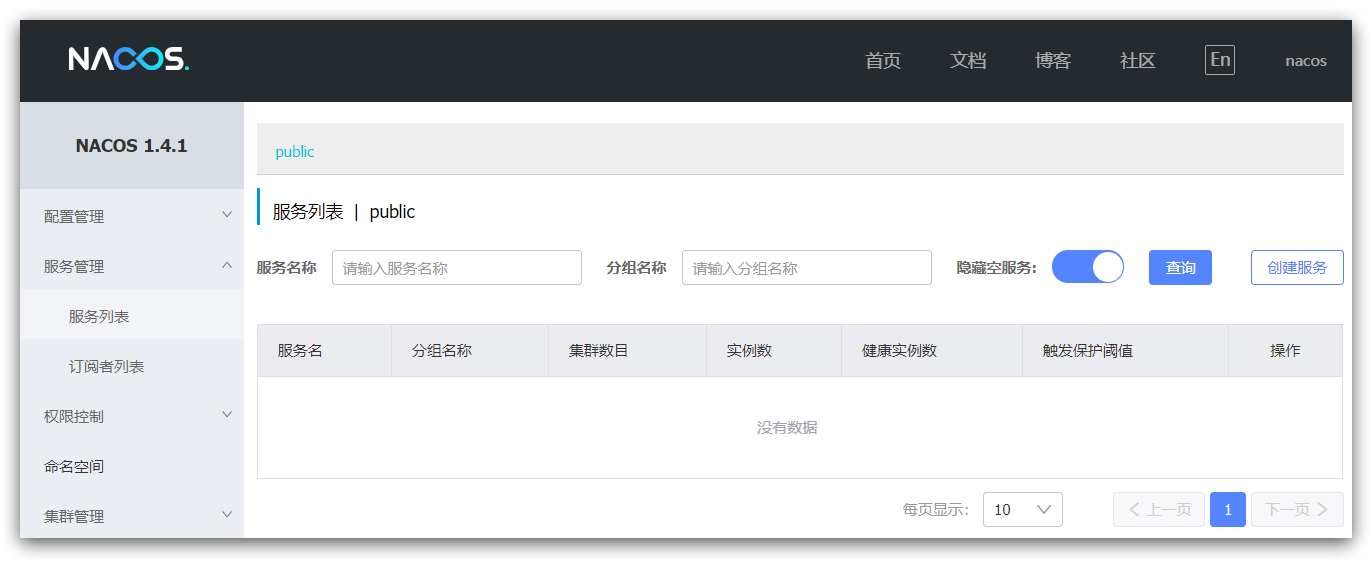

重启微服务后,登录nacos管理页面,可以看到微服务信息:

一个服务可以有多个实例,例如我们的user-service,可以有:

假如这些实例分布于全国各地的不同机房,例如:

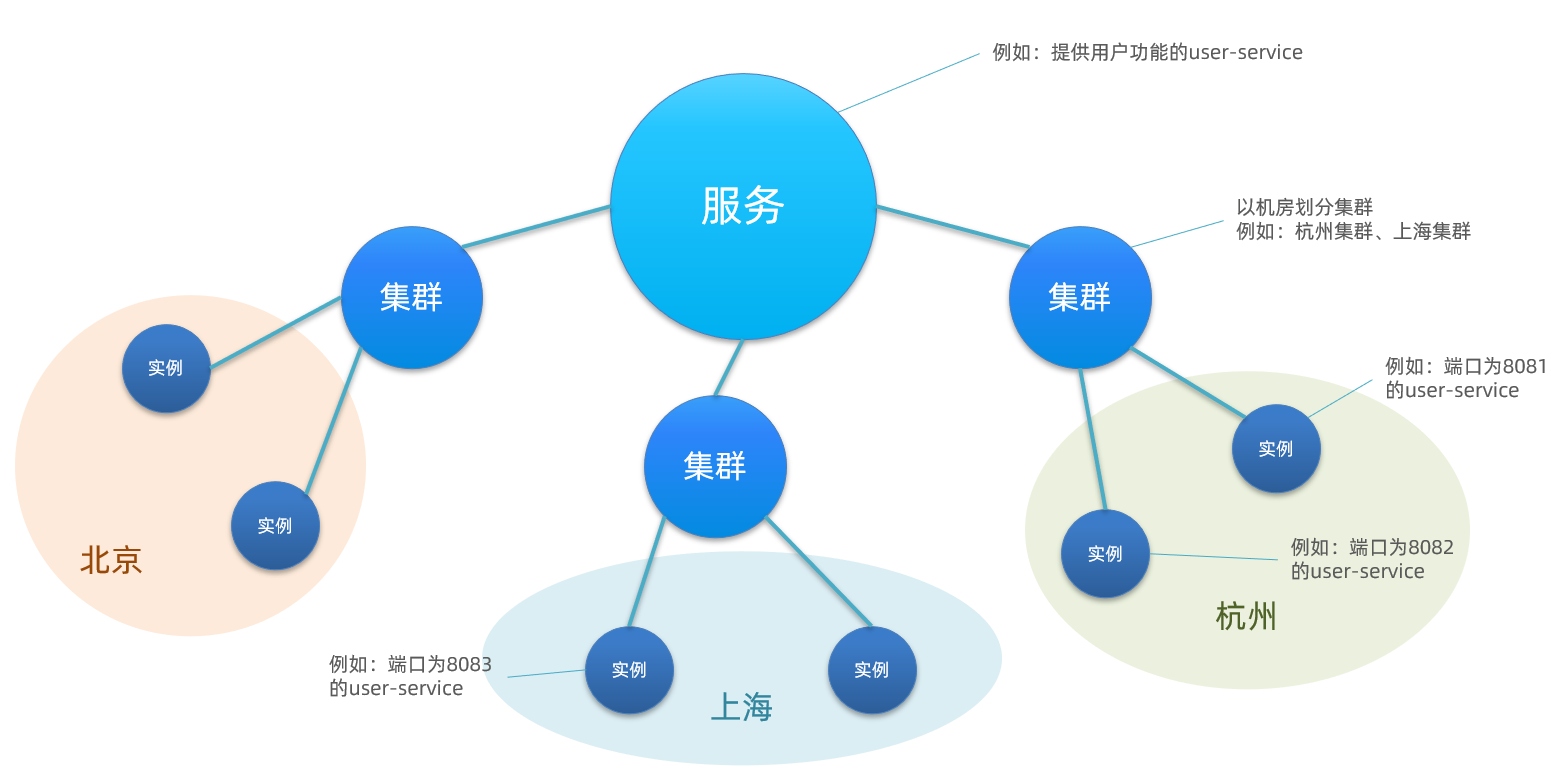

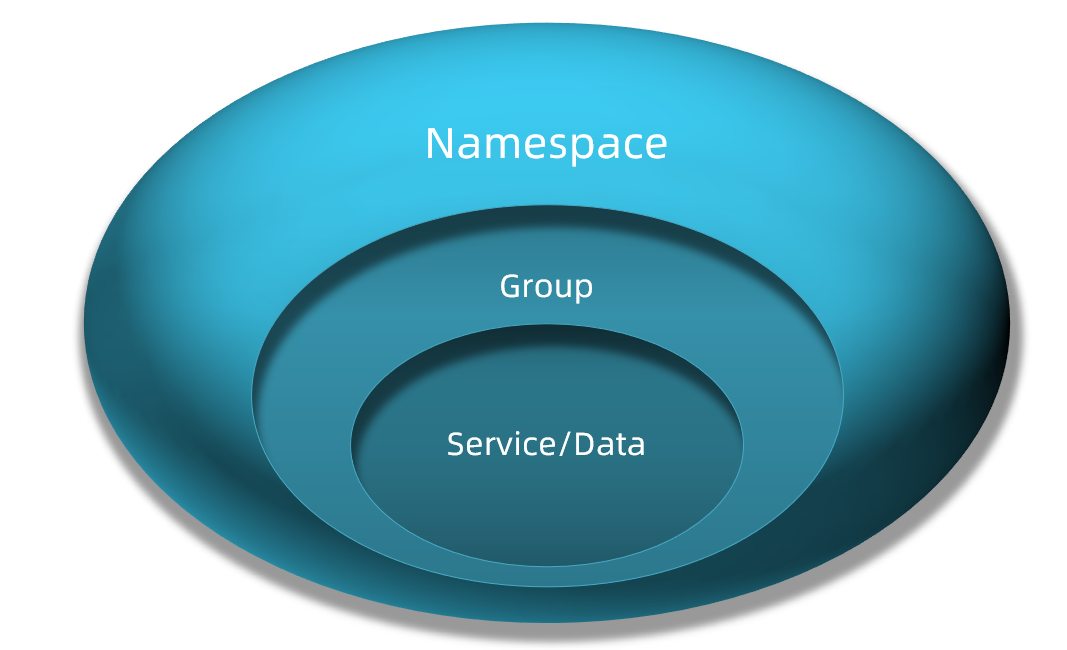

Nacos就将同一机房内的实例 划分为一个集群。

也就是说,user-service是服务,一个服务可以包含多个集群,如杭州、上海,每个集群下可以有多个实例,形成分级模型,如图:

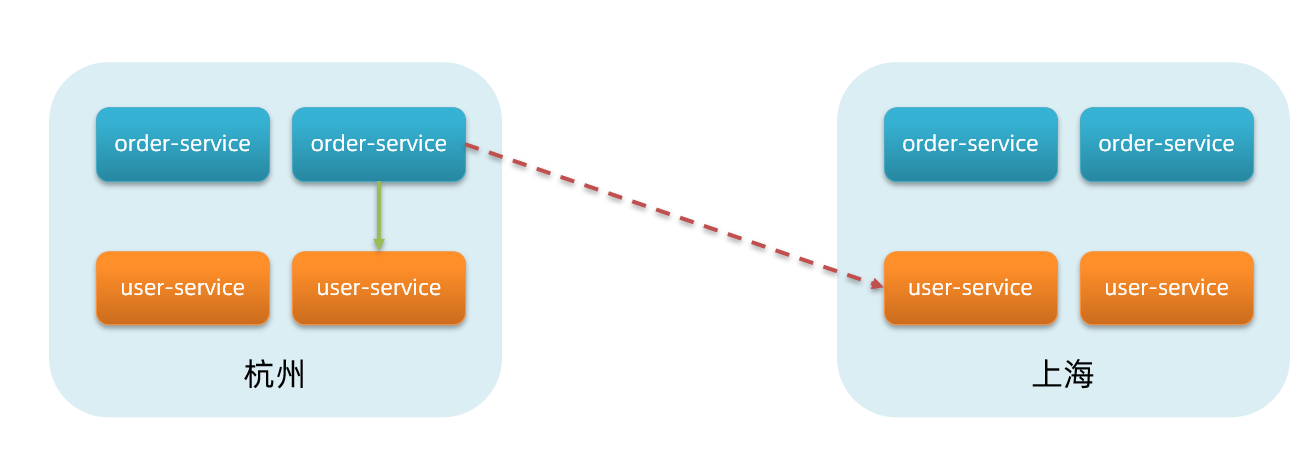

微服务互相访问时,应该尽可能访问同集群实例,因为本地访问速度更快。当本集群内不可用时,才访问其它集群。例如:

杭州机房内的order-service应该优先访问同机房的user-service。

目前看我们的项目中是没有集群的

修改user-service的application.yml文件,添加集群配置:

spring:

cloud:

nacos:

server-addr: localhost:8848

discovery:

cluster-name: HZ # 集群名称

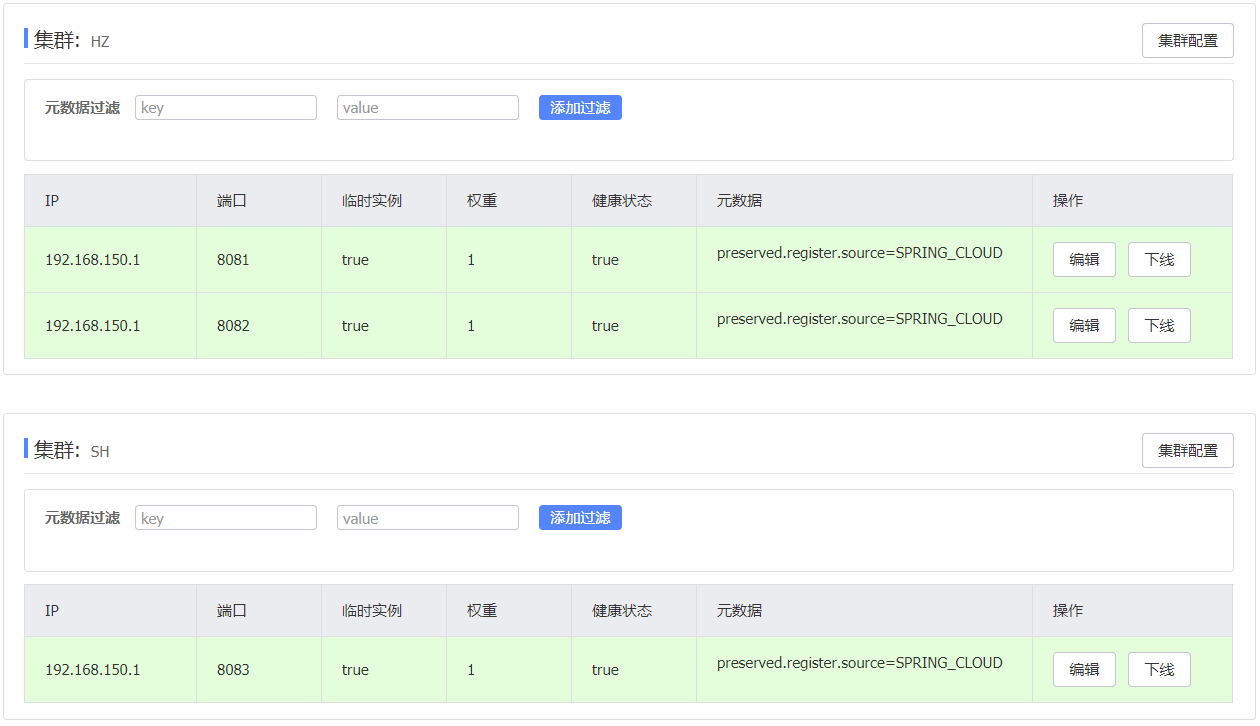

重启两个user-service实例后,我们可以在nacos控制台看到下面结果:

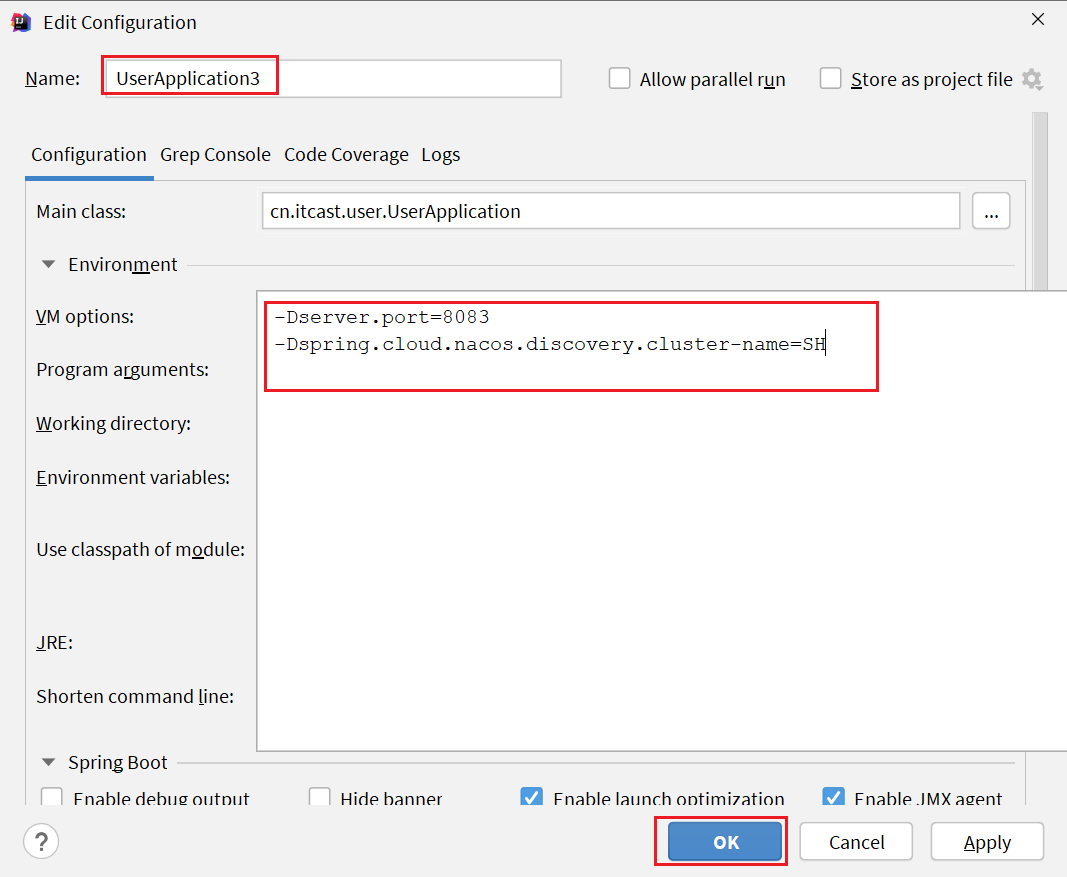

我们再次复制一个user-service启动配置,添加属性:

-Dserver.port=8083 -Dspring.cloud.nacos.discovery.cluster-name=SH

配置如图所示:

这一步也可以更改user-service中的application.yml文件

cloud:

nacos:

server-addr: localhost:8848 # nacos服务地址

discovery:

cluster-name: SH #上海 名字可以自定义,集群名称

启动UserApplication3后再次查看nacos控制台:

默认的ZoneAvoidanceRule并不能实现根据同集群优先来实现负载均衡。

因此Nacos中提供了一个NacosRule的实现,可以优先从同集群中挑选实例。

1)给order-service配置集群信息

修改order-service的application.yml文件,添加集群配置:

spring:

cloud:

nacos:

server-addr: localhost:8848

discovery:

cluster-name: HZ # 集群名称

这个时候看到order-service在nacos中是HZ集群

现在我们多次访问,发现还是轮询调用

8081

8082

8083

2)修改负载均衡规则

修改order-service的application.yml文件,修改负载均衡规则:

userservice:

ribbon:

NFLoadBalancerRuleClassName: com.alibaba.cloud.nacos.ribbon.NacosRule # 负载均衡规则

修改后我们访问

http://localhost:8080/order/101

http://localhost:8080/order/102

http://localhost:8080/order/103

http://localhost:8080/order/104

http://localhost:8080/order/105

发现8083也就是SH集群里什么日志信息都没有

而8081和8082HZ集群中是随机负载均衡,这说明会优先调用本地集群,在本地集群的多个实例中,使用随机。

那我们把8081和8082 HZ集群都停了,再调用会发生什么呢?

访问

http://localhost:8080/order/101

可以发现访问成功

userservice日志

orderservice日志:警告有跨集群的访问出现

实际部署中会出现这样的场景:

• 服务器设备性能有差异,部分实例所在机器性能较好,另一些较差,我们希望性能好的机器承担更多的用户请求。

但默认情况下NacosRule是同集群内随机挑选,不会考虑机器的性能问题。

因此,Nacos提供了权重配置来控制访问频率,权重越大则访问频率越高。

在nacos控制台,找到user-service的实例列表,点击编辑,即可修改权重:

在弹出的编辑窗口,修改权重:注意权重的值是0 ~ 1之间,性能好的机器配的权重高,性能差的机器配置的权重低。

多次访问

http://localhost:8080/order/105

可以明显看到后台日志中userApplication中。寥寥无几

userApplication2中,非常多

注意:如果权重修改为0,则该实例永远不会被访问

权重为0通常用于系统升级。

先将某个服务器的权重设置为0,然后做升级,升级完后,把权重调小,放一部分用户进来,无问题,再把权重扩大。(平滑升级)

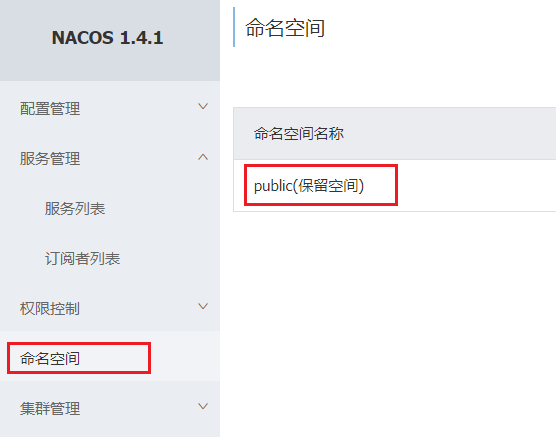

Nacos提供了namespace来实现环境隔离功能。

上面已经按照服务、集群、实例进行划分了,这里为什么还要提出环境隔离的概念呢?

答:上面的划分是按照地域或者业务所在区域划分推出的,这里namespace针对开发人员解决开发环境、测试环境、生产环境切换等。

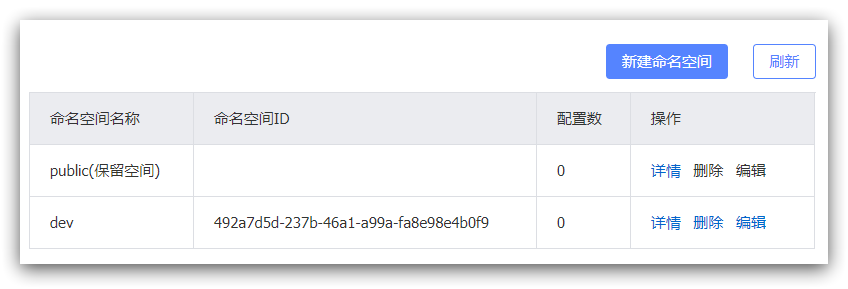

默认情况下,所有service、data、group都在同一个namespace,名为public:

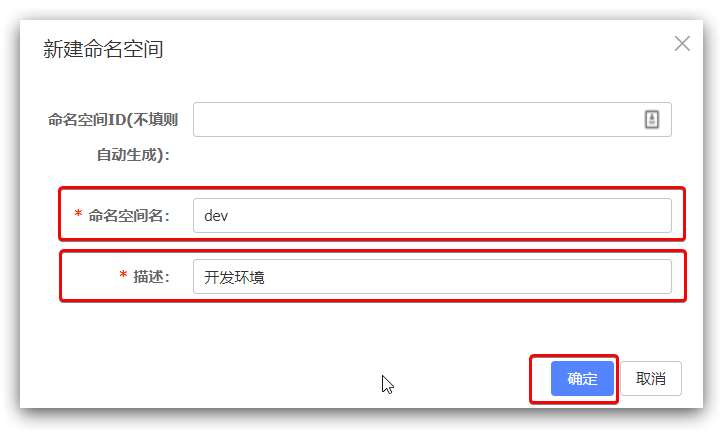

我们可以点击页面新增按钮,添加一个namespace:

然后,填写表单:

就能在页面看到一个新的namespace:

给微服务配置namespace只能通过修改配置来实现。

例如,修改order-service的application.yml文件:

spring:

cloud:

nacos:

server-addr: localhost:8848

discovery:

cluster-name: HZ

namespace: 492a7d5d-237b-46a1-a99a-fa8e98e4b0f9 # 命名空间,填ID

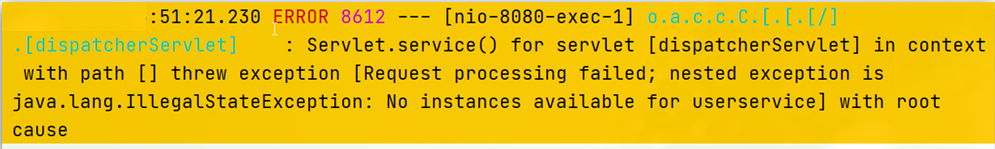

重启order-service后,访问控制台,可以看到下面的结果:

此时访问order-service,因为namespace不同,会导致找不到userservice,控制台会报错:

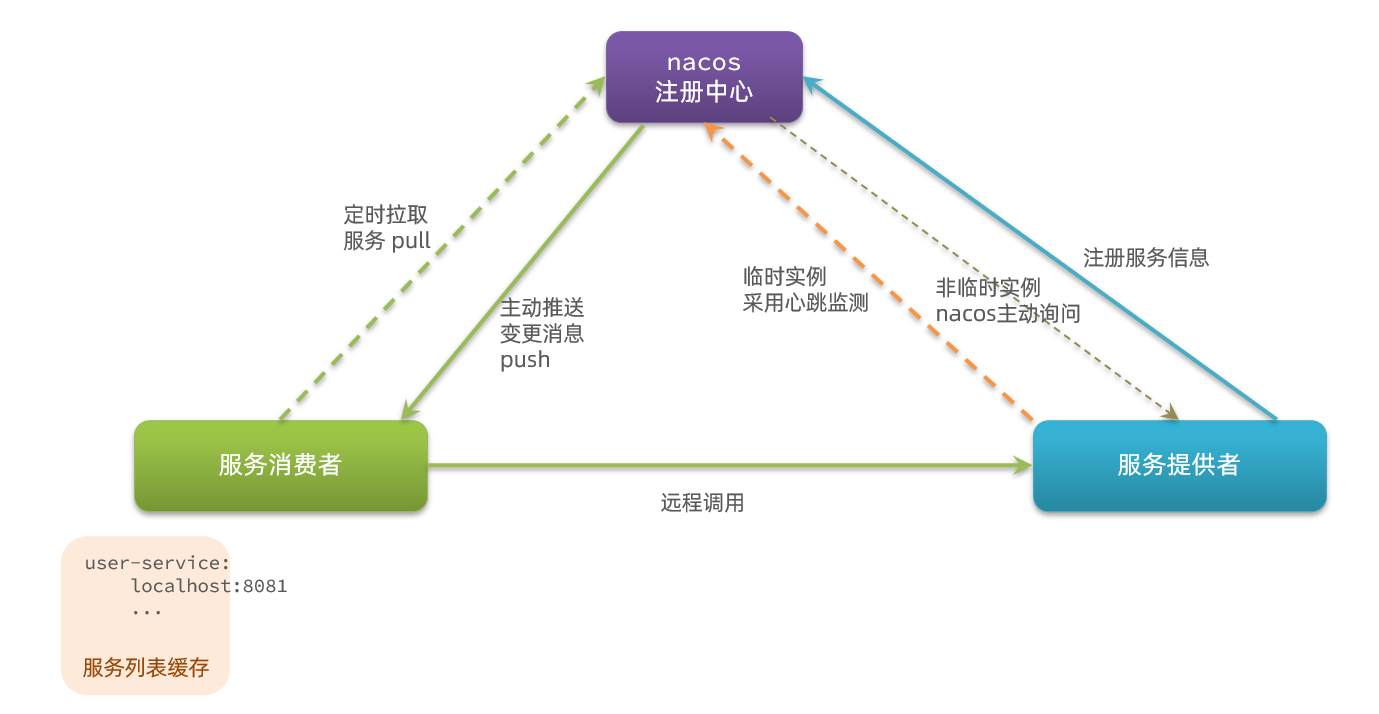

Nacos的服务实例分为两种l类型:

临时实例:如果实例宕机超过一定时间,会从服务列表剔除,默认的类型。

非临时实例:如果实例宕机,不会从服务列表剔除,也可以叫永久实例。

默认情况下,所有实例都是临时实例

临时实例,每隔30秒会向Nacos发送心跳,靠Nacos进行监控,一旦发现超时未发送心跳,就会被Nacos从服务列表中移除。

非临时实例,不会发送心跳,是Nacos主动向provider进行询问。如果询问超时也不会剔除服务列表,而是仅仅标记为不健康,等待其恢复健康即可。

配置一个服务实例为永久实例:

spring:

cloud:

nacos:

discovery:

ephemeral: false # 设置为非临时实例

配置完后,我们看Nacos

我们把oderservice服务停掉,看到Nacos控制台,只是把它标记为了不健康

Nacos和Eureka整体结构类似,服务注册、服务拉取、心跳等待,但是也存在一些差异:

Nacos与eureka的共同点

Nacos与Eureka的区别

?博客主页:https://xiaoy.blog.csdn.net?本文由呆呆敲代码的小Y原创,首发于CSDN??学习专栏推荐:Unity系统学习专栏?游戏制作专栏推荐:游戏制作?Unity实战100例专栏推荐:Unity实战100例教程?欢迎点赞?收藏⭐留言?如有错误敬请指正!?未来很长,值得我们全力奔赴更美好的生活✨------------------❤️分割线❤️-------------------------

这篇文章是继上一篇文章“Observability:从零开始创建Java微服务并监控它(一)”的续篇。在上一篇文章中,我们讲述了如何创建一个Javaweb应用,并使用Filebeat来收集应用所生成的日志。在今天的文章中,我来详述如何收集应用的指标,使用APM来监控应用并监督web服务的在线情况。源码可以在地址 https://github.com/liu-xiao-guo/java_observability 进行下载。摄入指标指标被视为可以随时更改的时间点值。当前请求的数量可以改变任何毫秒。你可能有1000个请求的峰值,然后一切都回到一个请求。这也意味着这些指标可能不准确,你还想提取最小/

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

我刚刚看到whitehouse.gov正在使用drupal作为CMS和门户技术。drupal的优点之一似乎是很容易添加插件,而且编程最少,即重新发明轮子最少。这实际上正是Ruby-on-Rails的DRY理念。所以:drupal的缺点是什么?Rails或其他基于Ruby的技术有哪些不符合whitehouse.org(或其他CMS门户)门户技术的资格? 最佳答案 Whatarethedrawbacksofdrupal?对于Ruby和Rails,这确实是一个相当主观的问题。Drupal是一个可靠的内容管理选项,非常适合面向社区的站点。它

当音乐碰上区块链技术,会擦出怎样的火花?或许周杰伦已经给了我们答案。8月29日下午,B站独家首发周杰伦限定珍藏Demo独家访谈VCR,周杰伦在VCR里分享了《晴天》《青花瓷》《搁浅》《爱在西元前》四首经典歌曲Demo背后的创作故事,并首次公布18年前未发布的神秘作品《纽约地铁》的Demo。在VCR中,方文山和杰威尔音乐提及到“多亏了区块链技术,现在我们可以将这些Demos,变成独一无二具有收藏价值的艺术品,这些Demos可以在薄盒(国内数藏平台)上听到。”如何将音乐与区块链技术相结合,薄盒方面称:“薄盒作为区块链技术服务方,打破传统对于区块链技术只能作为数字收藏的理解。聚焦于区块链技术赋能,在

目录SpringBootStarter是什么?以前传统的做法使用SpringBootStarter之后starter的理念:starter的实现: 创建SpringBootStarter步骤在idea新建一个starter项目、直接执行下一步即可生成项目。 在xml中加入如下配置文件:创建proterties类来保存配置信息创建业务类:创建AutoConfiguration测试如下:SpringBootStarter是什么? SpringBootStarter是在SpringBoot组件中被提出来的一种概念、简化了很多烦琐的配置、通过引入各种SpringBootStarter包可以快速搭建出一

我感到有点困惑——大约24小时以来,我一直在考虑在我的项目中使用哪种组播技术。基本上,我需要的是:创建组(通过一些后端进程)任意客户端广播消息(1:N,N:N)(可能)直接消息(1:1)(重要)使用我自己的后端(例如,通过某种HTTPAPI)对客户端进行身份验证/授权能够通过后端进程(或服务器插件)踢出特定的客户端这是我要的:Ruby或Haxe中的后端相关流程JS+Haxe(Flash9)中的前端—在浏览器中,因此理想情况下通过80/443进行通信,但不一定。因此,这项技术必须能够在HaxeforFlash中轻松访问,最好是Ruby。我一直在考虑:RabbitMQ(或OpenAMQ)、

文章目录概述背景为何要存算分离优势**应用场景**存算分离产品技术流派华为JuiceFSHashDataXSKY概述背景Hadoop一出生就是奔存算一体设计,当时设计思想就是存储不动而计算(code也即是代码程序)动,负责调度Yarn会把计算任务尽量发到要处理数据所在的实例上,这也是与传统集中式存储最大的不同。为何当时Hadoop设计存算一体的耦合?要知道2006年服务器带宽只有100Mb/s~1Gb/s,但是HDD也即是磁盘吞吐量有50MB/s,这样带宽远远不够传输数据,网络瓶颈尤为明显,无奈之举只好把计算任务发到数据所在的位置。众观历史常言道天下分久必合合久必分,随着云计算技术的发展,数据

文章目录华为OD面试流程1.mysql数据库建了两个字段,且设置了联合索引,如果其中有一个字段为空会出现什么问题?2.谈谈springIOC的理解,有什么好处,解决了什么问题3.谈谈springAOP的理解,切面编程有没有实际应用,有哪些注解,作用是什么,有那些应用场景?4.Erika和zookeeper有了解过吗,作用是什么,主要解决了什么问题5.谈谈JDK、JRE、JVM的理解,区别是什么6.谈谈对泛型的理解7.JVM的组成华为OD面试流程机试:三道算法题,关于机试,橡皮擦已经准备好了各语言专栏,可以直接订阅。性格测试:机试技术一面(本专栏核心)技术二面(本专栏核心)主管面试定级定薪发of

解开谜团:深入探索ChatGPT的技术奇迹。ChatGpt无处不在,无论是在播客、博客、YouTube还是社交媒体上。当我注意到这项新技术如此受欢迎时,我决定试一试,我被震惊了!有很多关于ChatGpt及其魔力的博客,但在这篇博客中,我将深入探讨其内部技术及其工作原理!ChatGpt简介根据OpenAI,ChatGpt被描述为:“我们训练了一个名为ChatGpt的模型,它以对话方式进行交互。对话格式使ChatGpt可以回答后续问题、承认错误、挑战不正确的前提并拒绝不适当的请求。ChatGPT是InstructGPT的兄弟模型,它经过训练可以按照提示中的说明进行操作并提供详细的响应。”OpenA