作者:张坚,科大讯飞开发工程师,云原生爱好者。

大家好,我是张坚。今天来聊聊如何在 KubeSphere 中集成外置的 ES 组件。

KubeSphere 在安装完成时候可以启用日志组件,这样会安装 ES 组件并可以收集所有部署组件的日志,也可以收集审计日志,然后可以很方便的在 KubeSphere 平台上进行日志查询。

但是在实际使用过程中发现使用 KubeSphere 自身的 ES 会很重,而且官方也建议我们将日志接入到外部的 ES 中减轻 Kubernetes 的压力。

以下为操作实战。

ES 集群需支持 http 协议

1️⃣ 搭建好外部 ES 集群,使用 http 协议(非本文重点)。

测试环境 IP: 172.30.10.226,172.30.10.191,172.30.10.184

port: 9200

username: elastic

password: changeme

2️⃣ 对 ES 做负载均衡。

有三种常见的做法:

本文档基于第三种负载均衡方案(通过 endpoints 负载)做对接。

管理员账号登录 KubeSphere,在平台管理 - 集群管理 - CRD 中搜索 clusterconfiguration,在自定义资源中,点击 ks-installer 选择编辑 YAML ,复制备份。

集群开启了内部 Elasticsearch,会存在如下系统组件和日志接收器

1️⃣ 系统组件:

2️⃣ 日志接收器:

容器日志、资源事件、审计日志(不开启不会有日志接收器)

接收器地址为内部 Elasticsearch 地址:elasticsearch-logging-data.kubesphere-logging-system.svc:9200

执行命令编辑 ks-installer:

$ kubectl edit cc ks-installer -n kubesphere-system

1️⃣ 卸载日志系统,将 ks-installer 参数的 logging.enabled 字段的值从 true 改为 false。

2️⃣ 卸载事件日志系统,将 ks-installer 参数的 events.enabled 字段的值从 true 改为 false。

3️⃣ 卸载审计日志系统,将 ks-installer 参数的 auditing.enabled 字段的值从 true 改为 false。

4️⃣ 配置文件的最后,删除如下内容:

es:

enabledTime: 2022-08-16T10:33:18CST

status: enabled

events:

enabledTime: 2022-04-15T16:22:59CST

status: enabled

fluentbit:

enabledTime: 2022-04-15T16:19:46CST

status: enabled

logging:

enabledTime: 2022-04-15T16:22:59CST

status: enabled

执行命令检查安装过程:

$ kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

#日志出现以下内容说明重启成功

Collecting installation results ...

#####################################################

### Welcome to KubeSphere! ###

#####################################################

Console: http://172.30.9.xxx:30880

Account: admin

Password: P@88w0rd

NOTES:

1. After you log into the console, please check the

monitoring status of service components in

"Cluster Management". If any service is not

ready, please wait patiently until all components

are up and running.

2. Please change the default password after login.

#####################################################

https://kubesphere.io 2022-08-04 15:53:14

#####################################################

执行命令卸载相关可插拔组件:

###### 卸载 KubeSphere 日志系统

$ kubectl delete inputs.logging.kubesphere.io -n kubesphere-logging-system tail

###### 卸载 KubeSphere 事件系统

$ helm delete ks-events -n kubesphere-logging-system

###### 卸载 KubeSphere 审计

$ helm uninstall kube-auditing -n kubesphere-logging-system

$ kubectl delete crd rules.auditing.kubesphere.io

$ kubectl delete crd webhooks.auditing.kubesphere.io

###### 卸载包括 Elasticsearch 的日志系统

$ kubectl delete crd fluentbitconfigs.logging.kubesphere.io

$ kubectl delete crd fluentbits.logging.kubesphere.io

$ kubectl delete crd inputs.logging.kubesphere.io

$ kubectl delete crd outputs.logging.kubesphere.io

$ kubectl delete crd parsers.logging.kubesphere.io

$ kubectl delete deployments.apps -n kubesphere-logging-system fluentbit-operator

$ helm uninstall elasticsearch-logging --namespace kubesphere-logging-system

$ kubectl delete deployment logsidecar-injector-deploy -n kubesphere-logging-system

$ kubectl delete ns kubesphere-logging-system

卸载过程中可能出现如下异常:

crd 资源删除时出现问题,尝试使用如下命令

$ kubectl patch crd/crd名称 -p '{"metadata":{"finalizers":[]}}' --type=merge

$ kubectl create ns kubesphere-logging-system

es-service.yaml

apiVersion: v1

kind: Service

metadata:

labels:

app: es-service

name: es-service

namespace: kubesphere-logging-system

spec:

ports:

- port: 9200

name: es

protocol: TCP

targetPort: 9200

es-endpoints.yaml

ip 地址修改为真实要对接的 ES 集群节点的 IP 地址。

apiVersion: v1

kind: Endpoints

metadata:

labels:

app: es-service

name: es-service

namespace: kubesphere-logging-system

subsets:

- addresses:

- ip: 172.30.10.***

- ip: 172.30.10.***

- ip: 172.30.10.***

ports:

- port: 9200

name: es

protocol: TCP

执行命令创建自定义 SVC:

$ kubectl apply -f es-service.yaml -n kubesphere-logging-system

$ kubectl apply -f es-endpoints.yaml -n kubesphere-logging-system

#查看svc

$ kubectl get svc -n kubesphere-logging-system

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

es-service ClusterIP 109.233.8.178 <none> 9200/TCP 10d

#查看endpoints

$ kubectl get ep -n kubesphere-logging-system

NAME ENDPOINTS AGE es-service 172.30.10.***:9200,172.30.10.***:9200,172.30.10.***:9200 10d

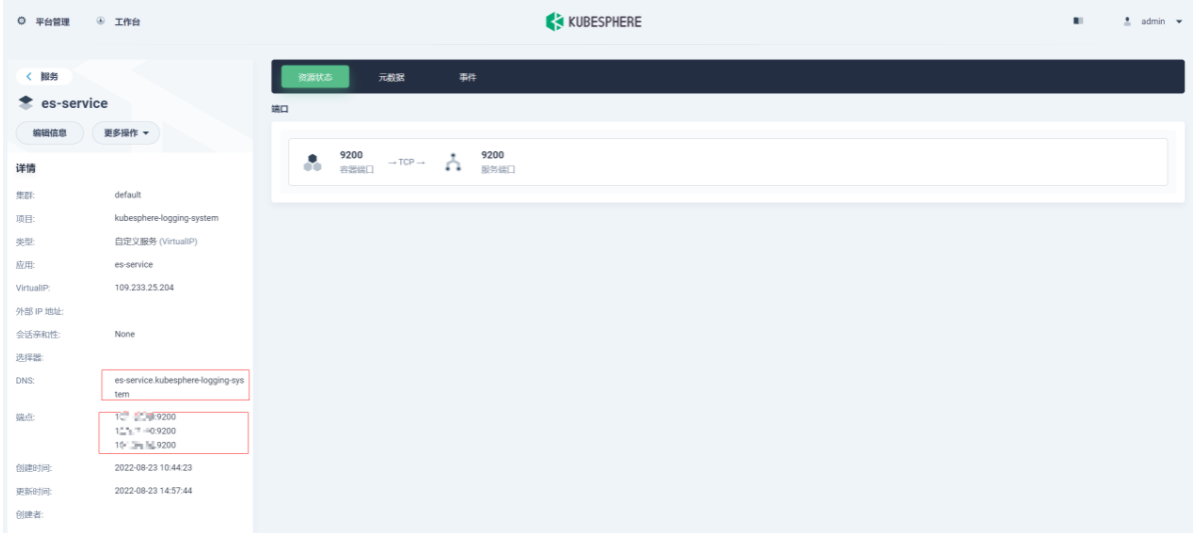

“平台管理-集群管理-应用负载-服务”搜索 es-service。

es-service 服务地址:es-service.kubesphere-logging-system.svc。

在平台管理 - 集群管理 - CRD 中搜索 clusterconfiguration,在自定义资源中,点击 ks-installer,修改配置:

开启容器日志、审计日志分别修改

logging.enabled: true

auditing.enabled: true

修改外部 ES 配置

es.basicAuth.enabled: true

es.basicAuth.password

es.basicAuth.username

es.externalElasticsearchUrl

es.externalElasticsearchPort

修改日志保存日期(默认 7 天)

logMaxAge

修改日志索引前缀(默认 logstash)

elkPrefix(开发:dev,测试:sit,生产:prod)

apiVersion: installer.kubesphere.io/v1alpha1

kind: ClusterConfiguration

metadata:

labels:

version: v3.2.1

name: ks-installer

namespace: kubesphere-system

spec:

alerting:

enabled: false

auditing:

enabled: true # false改为true

...

es:

basicAuth:

enabled: true # false改为true

password: '****' # 密码

username: '****' # 用户名

data:

volumeSize: 20Gi

elkPrefix: sit #开发:dev 测试:sit 生产:prod

externalElasticsearchPort: '9200' # 端口

externalElasticsearchUrl: es-service.kubesphere-logging-system.svc # 修改es-service

logMaxAge: 7 #默认7天即可

master:

volumeSize: 4Gi

...

执行命令检查安装过程

$ kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

#日志出现以下内容说明重启成功

Collecting installation results ...

#####################################################

### Welcome to KubeSphere! ###

#####################################################

Console: http://172.30.9.xxx:30880

Account: admin

Password: P@88w0rd

NOTES:

1. After you log into the console, please check the

monitoring status of service components in

"Cluster Management". If any service is not

ready, please wait patiently until all components

are up and running.

2. Please change the default password after login.

#####################################################

https://kubesphere.io 2022-08-04 15:53:14

#####################################################

执行命令,查看对应的 ConfigMap 配置:

$ kubectl get configmap kubesphere-config -n kubesphere-system -o yaml

#重点如下,看es的配置是否已经生效,host是否为自定义SVC,以及用户名密码索引是否正确

logging:

host: http://es-service.kubesphere-logging-system.svc:9200

basicAuth: True

username: "****" #此处为你填写的正确用户名

password: "****" #此处为你填写的正确密码

indexPrefix: ks-sit-log #不同环境对应dev\sit\prod

auditing:

enable: true

webhookURL: https://kube-auditing-webhook-svc.kubesphere-logging-system.svc:6443/audit/webhook/event

host: http://es-service.kubesphere-logging-system.svc:9200

basicAuth: True

username: "****" #此处为你填写的正确用户名

password: "****" #此处为你填写的正确密码

indexPrefix: ks-sit-auditing #不同环境对应dev\sit\prod

执行命令编辑对应 output(如果已自动修改则不需要手动修改):

修改 host

修改索引 (开发、测试、生产前缀分别对应 ks-dev-、ks-sit-、ks-prod-)

#修改es的output

$ kubectl edit output es -n kubesphere-logging-system

#修改host 和 logstashPrefix

# host: es-service.kubesphere-logging-system.svc

# logstashPrefix: ks-对应环境-log

#如下:

spec:

es:

generateID: true

host: es-service.kubesphere-logging-system.svc # host地址

httpPassword:

valueFrom:

secretKeyRef:

key: password

name: elasticsearch-credentials

httpUser:

valueFrom:

secretKeyRef:

key: username

name: elasticsearch-credentials

logstashFormat: true

logstashPrefix: ks-sit-log # 修改此处为对应环境的日志索引

port: 9200

timeKey: '@timestamp'

matchRegex: '(?:kube|service)\.(.*)'

#修改es-auditing的output

$ kubectl edit output es-auditing -n kubesphere-logging-system

#修改host 和 logstashPrefix

# host: es-service.kubesphere-logging-system.svc

# logstashPrefix: ks-对应环境-auditing

#如下

spec:

es:

generateID: true

host: es-service.kubesphere-logging-system.svc # host地址

httpPassword:

valueFrom:

secretKeyRef:

key: password

name: elasticsearch-credentials

httpUser:

valueFrom:

secretKeyRef:

key: username

name: elasticsearch-credentials

logstashFormat: true

logstashPrefix: ks-sit-auditing # 修改此处为对应环境的日志索引

port: 9200

match: kube_auditing

重启 ks-apiserver

$ kubectl rollout restart deployment ks-apiserver -n kubesphere-system

$ kubectl get po -n kubesphere-logging-system

NAME READY STATUS RESTARTS AGE

elasticsearch-logging-curator-elasticsearch-curator-276864h2xt2 0/1 Error 0 38h

elasticsearch-logging-curator-elasticsearch-curator-276864wc6bs 0/1 Completed 0 38h

elasticsearch-logging-curator-elasticsearch-curator-276879865wl 0/1 Completed 0 14h

elasticsearch-logging-curator-elasticsearch-curator-276879l7xpf 0/1 Error 0 14h

fluent-bit-4vzq5 1/1 Running 0 47h

fluent-bit-6ckvm 1/1 Running 0 25h

fluent-bit-6jt8d 1/1 Running 0 47h

fluent-bit-88crg 1/1 Running 0 47h

fluent-bit-9ps6z 1/1 Running 0 47h

fluent-bit-djhtx 1/1 Running 0 47h

fluent-bit-dmpfv 1/1 Running 0 47h

fluent-bit-dtr7z 1/1 Running 0 47h

fluent-bit-flxbt 1/1 Running 0 47h

fluent-bit-fnxdk 1/1 Running 0 47h

fluent-bit-gqbrl 1/1 Running 0 47h

fluent-bit-kbzsj 1/1 Running 0 47h

fluent-bit-lbnnh 1/1 Running 0 47h

fluent-bit-nq4g8 1/1 Running 0 47h

fluent-bit-q5shz 1/1 Running 0 47h

fluent-bit-qrb7v 1/1 Running 0 47h

fluent-bit-r26fk 1/1 Running 0 47h

fluent-bit-rfrpd 1/1 Running 0 47h

fluent-bit-s8869 1/1 Running 0 47h

fluent-bit-sp5k4 1/1 Running 0 47h

fluent-bit-vjvhl 1/1 Running 0 47h

fluent-bit-xkksv 1/1 Running 0 47h

fluent-bit-xrlz4 1/1 Running 0 47h

fluentbit-operator-745bf5559f-vnz8w 1/1 Running 0 47h

kube-auditing-operator-84857bf967-ftbjr 1/1 Running 0 47h

kube-auditing-webhook-deploy-64cfb8c9f8-hf8g8 1/1 Running 0 47h

kube-auditing-webhook-deploy-64cfb8c9f8-zf4rd 1/1 Running 0 47h

logsidecar-injector-deploy-5fb6fdc6dd-fj5vm 2/2 Running 0 47h

logsidecar-injector-deploy-5fb6fdc6dd-qbhdg 2/2 Running 0 47h

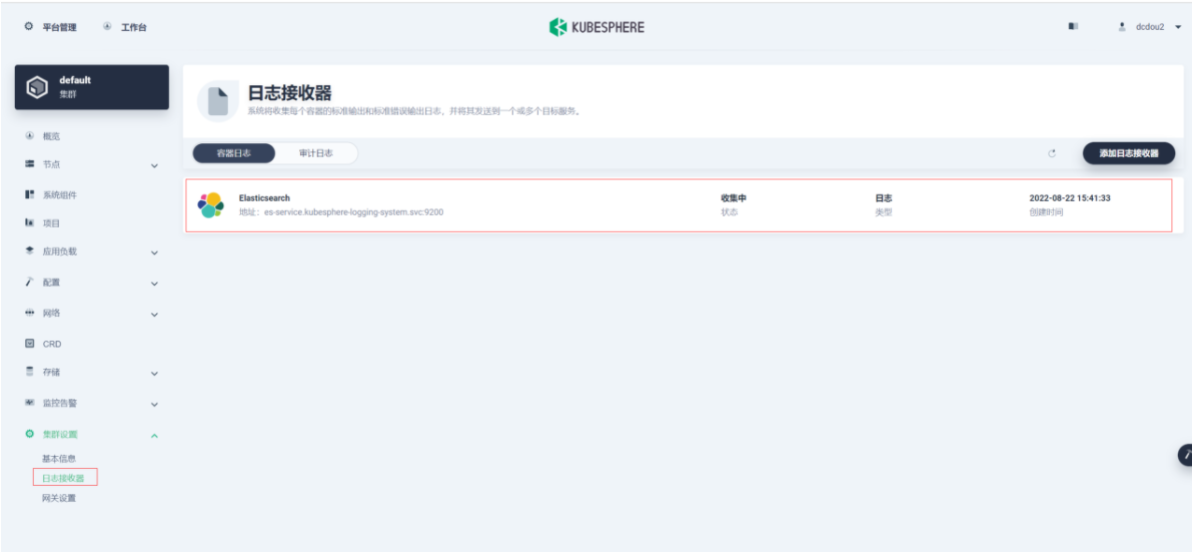

日志接收器:

查询审计日志:

本文由博客一文多发平台 OpenWrite 发布!

很好奇,就使用rubyonrails自动化单元测试而言,你们正在做什么?您是否创建了一个脚本来在cron中运行rake作业并将结果邮寄给您?git中的预提交Hook?只是手动调用?我完全理解测试,但想知道在错误发生之前捕获错误的最佳实践是什么。让我们理所当然地认为测试本身是完美无缺的,并且可以正常工作。下一步是什么以确保他们在正确的时间将可能有害的结果传达给您? 最佳答案 不确定您到底想听什么,但是有几个级别的自动代码库控制:在处理某项功能时,您可以使用类似autotest的内容获得关于哪些有效,哪些无效的即时反馈。要确保您的提

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

导读:随着叮咚买菜业务的发展,不同的业务场景对数据分析提出了不同的需求,他们希望引入一款实时OLAP数据库,构建一个灵活的多维实时查询和分析的平台,统一数据的接入和查询方案,解决各业务线对数据高效实时查询和精细化运营的需求。经过调研选型,最终引入ApacheDoris作为最终的OLAP分析引擎,Doris作为核心的OLAP引擎支持复杂地分析操作、提供多维的数据视图,在叮咚买菜数十个业务场景中广泛应用。作者|叮咚买菜资深数据工程师韩青叮咚买菜创立于2017年5月,是一家专注美好食物的创业公司。叮咚买菜专注吃的事业,为满足更多人“想吃什么”而努力,通过美好食材的供应、美好滋味的开发以及美食品牌的孵

目录1.AdmobSDK下载地址2.将下载好的unityPackagesdk导入到unity里编辑 3.解析依赖到项目中

我认为我的问题最好用一个例子来描述。假设我有一个名为“Thing”的简单模型,它有一些简单数据类型的属性。像...Thing-foo:string-goo:string-bar:int这并不难。数据库表将包含具有这三个属性的三列,我可以使用@thing.foo或@thing.bar之类的东西访问它们。但我要解决的问题是当“foo”或“goo”不再包含在简单数据类型中时会发生什么?假设foo和goo代表相同类型的对象。也就是说,它们都是“Whazit”的实例,只是数据不同。所以现在事情可能看起来像这样......Thing-bar:int但是现在有一个新的模型叫做“Whazit”,看起来

我有一个要在我的Rails3项目中使用的数组扩展方法。它应该住在哪里?我有一个应用程序/类,我最初把它放在(array_extensions.rb)中,在我的config/application.rb中我加载路径:config.autoload_paths+=%W(#{Rails.root}/应用程序/类)。但是,当我转到railsconsole时,未加载扩展。是否有一个预定义的位置可以放置我的Rails3扩展方法?或者,一种预先定义的方式来添加它们?我知道Rails有自己的数组扩展方法。我应该将我的添加到active_support/core_ext/array/conversion

我理解(我认为)Ruby中类变量和类的实例变量之间的区别。我想知道如何从该类外部访问该类的实例变量。从内部(即在类方法中而不是实例方法中),它可以直接访问,但是从外部,有没有办法做MyClass.class.[@$#]variablename?我没有任何具体原因要这样做,只是学习Ruby并想知道是否可行。 最佳答案 classMyClass@my_class_instance_var="foo"class上述yield:>>foo我相信Arkku演示了如何从类外部访问类变量(@@),而不是类实例变量(@)。我从这篇文章中提取了上述内

我似乎经常遇到一些设计问题,但我不知道是什么是真的很合适。一方面我经常听到我应该限制耦合和坚持单一职责,但当我这样做时,我常常发现它很困难到在需要时将信息获取到程序的一部分。为了例如,classSingerdefinitialize(name)@name=nameendattr:nameend那么Song应该是:classSongdefnew(singer)@singer=singerendend或classSongdefnew(singer_name)@singer_name=singer_nameendend后者耦合性小,按道理应该用。但如果我以后发现宋有什么需要了解更多歌手,我的

我需要使用ActiveMerchant库在我们的一个Rails应用程序中设置支付解决方案。尽管这个问题非常主观,但人们对主要网关(BrainTree、Authorize.net等)的体验如何?它必须:处理定期付款。有能力记入个人帐户。能够取消付款。有办法存储用户的付款详细信息(例如Authotize.netsCIM)。干杯 最佳答案 ActiveMerchant很棒,但在过去一年左右的时间里,我在使用它时发现了一些问题。首先,虽然某些网关可能会得到“支持”——但并非所有功能都包含在内。查看功能矩阵以确保完全支持您选择的网关-http

我想在Windows7上安装带有ruby1.9.3的rspec-railsgem。我收到一些错误消息,提示无法安装某些json库。所以,我使用下面的说明来解决它。来源=The'json'nativegemrequiresinstalledbuildtools从[rubyinstaller.org][3]下载[Ruby1.9.3][2]从[rubyinstaller.org][3]下载DevKit文件对于Ruby1.9.3,使用[DevKit-tdm-32-4.5.2-20110712-1620-sfx.exe][4]将DevKit解压到路径C:\Ruby193\DevKit运行cd