本文总计 1500 字,预计阅读需要 6 分钟

今天我们来围绕着AUTOMATIC1111的stable-diffusion-webui介绍如何将stable diffusion 2.0 部署到本地,还有在哪里下载基本模型和微调。

这里我们以windows为例,linux也类似

首先,clone项目:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

然后,我们需要一个插件stable-diffusion-webui-images-browser ,把他clone到相应目录即可

git clone https://github.com/yfszzx/stable-diffusion-webui-images-browser stable-diffusion-webui/extensions/stable-diffusion-webui-images-browser

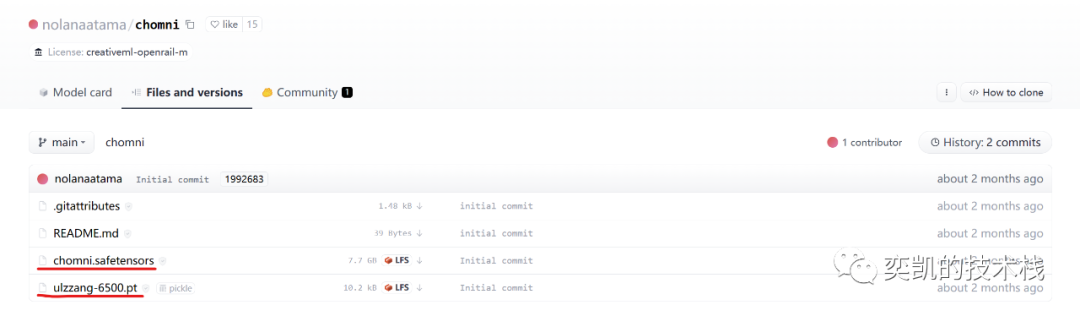

全部完成后我们进入这个网站:

https://huggingface.co/nolanaatama/chomni/tree/main

然后下载这两个文件:

chilloutmixni.safetensors是我们的基本模型文件,复制到 stable-diffusion-webui/models/Stable-diffusion,这个模型很大,但是可以用迅雷等下载工具下,速度还可以。

ulzzang-6500.pt是embedding,复制到stable-diffusion-webui/embeddings

然后我们用conda创建一个虚拟环境,这个环境无所谓,因为webui在启动时会自动的将python复制到它的stable-diffusion-webui\venv目录,所以只要有基本的python包就可以了,这里我们根据官网要求,使用Python 3.10.6:

conda env create -n sd2 python=3.10.6

安装完成后激活

conda activate sd2

然后进入stable-diffusion-webui目录,我这里是放在了D:\git\stable-diffusion-webui,所以后面都已这个目录为例。

然后执行:

cd D:\git\stable-diffusion-webui

webui.bat

执行这步肯定会报错,如果没报错就跳过下面的内容:

我们先执行这步是为了让脚本把环境复制到venv,这样我们就可以跳过conda虚拟环境了,我们的python运行环境已经在

D:\git\stable-diffusion-webui\venv\Scripts\Python.exe

了

下面开始安装依赖:

找到:

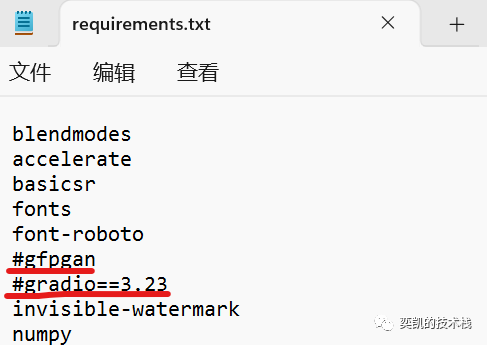

requirements.txt

把这两行注释掉:

执行

D:\git\stable-diffusion-webui\venv\Scripts\Python.exe -m pip install -r requirements.txt

执行完后手动执行:

D:\git\stable-diffusion-webui\venv\Scripts\Python.exe -m pip install gradio

安装最新版的gradio,安装完成后打开

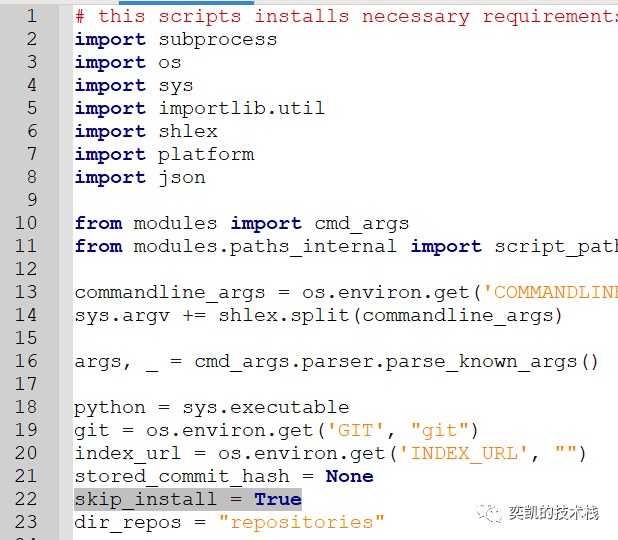

launch.py

22行改为True

然后在221行:

手动执行上面的每一步

比如:

D:\git\stable-diffusion-webui\venv\Scripts\Python.exe -m pip install git+https://github.com/TencentARC/GFPGAN.git@8d2447a2d918f8eba5a4a01463fd48e45126a379

一般情况下这一句就行了,因为我们的requirements注释掉了这句。

以上都完成后,执行:

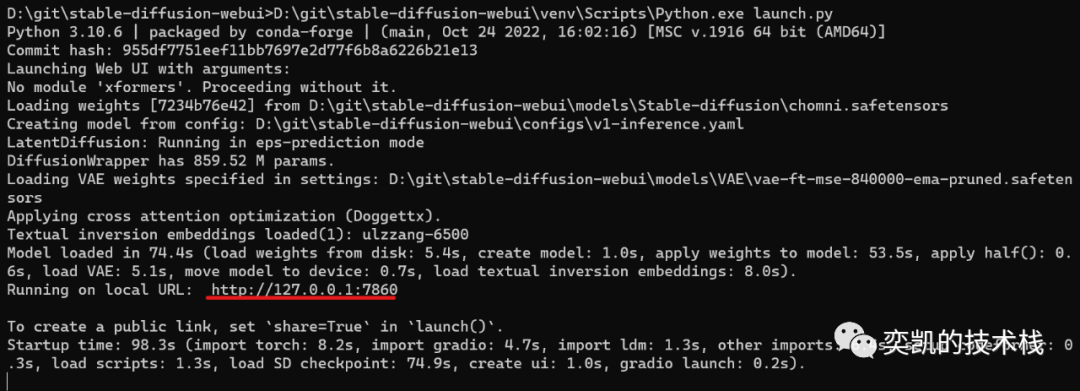

D:\git\stable-diffusion-webui\venv\Scripts\Python.exe launch.py

就可以启动了,这时不需要任何的python环境了,启动时间很长,因为有一个8G的模型要放到显卡上,如果你看到下面的消息就是成功了:

访问上面标红的地址就能看到webui了,如果报错请按照提示安装缺失的python包,一般都是在221行的那几个,手动install就可以了。

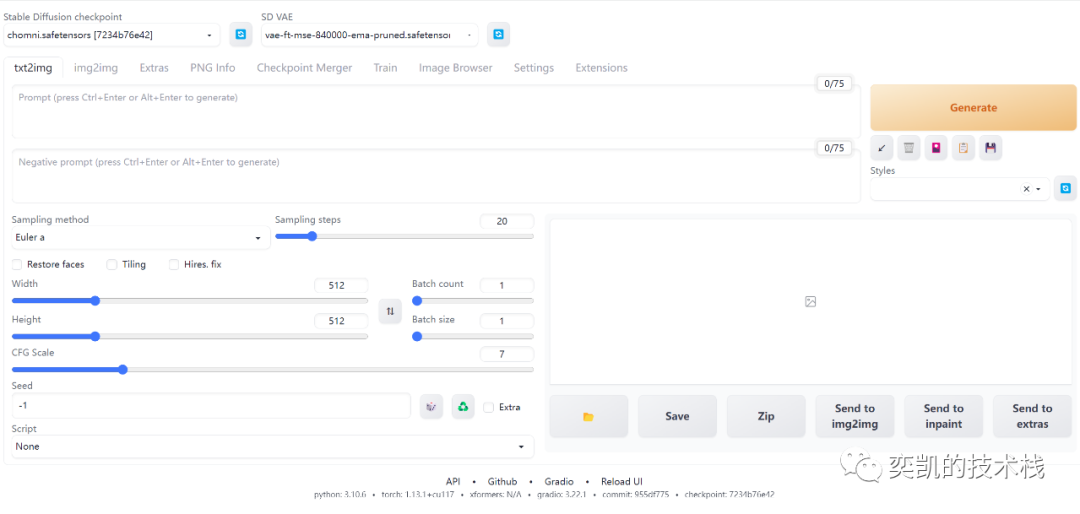

打开页面应该是这样的

这样安装就完成了。

我们安装的仅仅是基本模型,为了我们不同的需求可以使用不同的lora来进行微调,比如这个:

https://huggingface.co/amornlnw7/koreanDollLikeness_v15/tree/main

下载

koreanDollLikeness_v15.safetensors

复制到 models\Lora 目录,这样我们可以生成漂亮小姐姐了

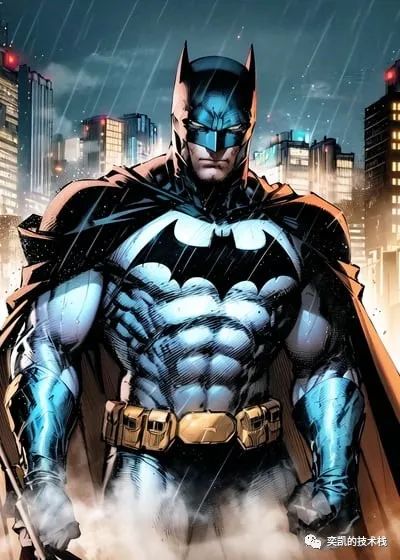

使用下面的配置可以生成跟我一样的图片:

prompt

<lora:koreanDollLikeness_v15:0.66>, ((Blink))),best quality, ultra high res, (photorealistic:1.4), 1girl, loose and oversized black jacket, white sports bra, (green yoga pants:1), (Kpop idol), (aegyo sal:1), (Medium-sized chest), (Medium-sized breasts),(light brown short ponytail:1.2), ((puffy eyes)), looking at viewer, full body, streets, outdoors

negative:

paintings,sketches,(worst quality:2),(lowquality:2),(normal quality:2),lowres, normalquality,((monochrome)),((grayscale)),skin spots,acnes, skin blemishes,age spot,glans

Seed: 4019082821

可能你生成的效果没我的好,这是为什么呢?

因为我还加了vae,把这个文件vae-ft-mse-840000-ema-pruned.safetensors放在 \models\VAE目录下

下载地址:https://huggingface.co/stabilityai/sd-vae-ft-mse-original/tree/main ,这样就自动使用了

SD VAE的作用主要就是优化眼睛和嘴的细节:

Low-Rank Adaptation (LoRA) 是一种有效的自适应策略,它不会引入额外的推理延迟,并在保持模型质量的同时显着减少下游任务的可训练参数数量,也就是说它的模型特别小,看看 koreanDollLikeness_v15.safetensors 就知道了。

我们可以自己训练也可以使用别人的LORA,与koreanDollLikeness_v15一样,直接把他们复制到 lora目录就可以了

在 civitai上有各种各样的LORA可以选择,这里介绍几个我觉得不错的:

墨心 MoXin:

Jim Lee (DC Comics / Marvel) Style LoRA

光头强/huaqiang lora模型

我正在编写一个包含C扩展的gem。通常当我写一个gem时,我会遵循TDD的过程,我会写一个失败的规范,然后处理代码直到它通过,等等......在“ext/mygem/mygem.c”中我的C扩展和在gemspec的“扩展”中配置的有效extconf.rb,如何运行我的规范并仍然加载我的C扩展?当我更改C代码时,我需要采取哪些步骤来重新编译代码?这可能是个愚蠢的问题,但是从我的gem的开发源代码树中输入“bundleinstall”不会构建任何native扩展。当我手动运行rubyext/mygem/extconf.rb时,我确实得到了一个Makefile(在整个项目的根目录中),然后当

我是Google云的新手,我正在尝试对其进行首次部署。我的第一个部署是RubyonRails项目。我基本上是在关注thisguideinthegoogleclouddocumentation.唯一的区别是我使用的是我自己的项目,而不是他们提供的“helloworld”项目。这是我的app.yaml文件runtime:customvm:trueentrypoint:bundleexecrackup-p8080-Eproductionconfig.ruresources:cpu:0.5memory_gb:1.3disk_size_gb:10当我转到我的项目目录并运行gcloudprevie

我们的git存储库中目前有一个Gemfile。但是,有一个gem我只在我的环境中本地使用(我的团队不使用它)。为了使用它,我必须将它添加到我们的Gemfile中,但每次我checkout到我们的master/dev主分支时,由于与跟踪的gemfile冲突,我必须删除它。我想要的是类似Gemfile.local的东西,它将继承从Gemfile导入的gems,但也允许在那里导入新的gems以供使用只有我的机器。此文件将在.gitignore中被忽略。这可能吗? 最佳答案 设置BUNDLE_GEMFILE环境变量:BUNDLE_GEMFI

我可以在Azure网站上部署RubyonRails吗? 最佳答案 还没有。目前仅支持.NET和PHP。 关于ruby-on-rails-RubyonRails可以部署在Azure网站上吗?,我们在StackOverflow上找到一个类似的问题: https://stackoverflow.com/questions/12964010/

前置步骤我们都操作完了,这篇开始介绍jenkins的集成。话不多说,看操作1、登录进入jenkins后会让你选择安装插件,选择第一个默认的就行。安装完成后设置账号密码,重新登录。2、配置JDK和Git都需要执行路径,所以需要先把执行路径找到,先进入服务器的docker容器,2.1JDK的路径root@69eef9ee86cf:/usr/bin#echo$JAVA_HOME/usr/local/openjdk-82.2Git的路径root@69eef9ee86cf:/#whichgit/usr/bin/git3、先配置JDK和Git。点击:ManageJenkins>>GlobalToolCon

深度学习部署:Windows安装pycocotools报错解决方法1.pycocotools库的简介2.pycocotools安装的坑3.解决办法更多Ai资讯:公主号AiCharm本系列是作者在跑一些深度学习实例时,遇到的各种各样的问题及解决办法,希望能够帮助到大家。ERROR:Commanderroredoutwithexitstatus1:'D:\Anaconda3\python.exe'-u-c'importsys,setuptools,tokenize;sys.argv[0]='"'"'C:\\Users\\46653\\AppData\\Local\\Temp\\pip-instal

Ocra无法处理需要“tk”的应用程序require'tk'puts'nope'用奥克拉http://github.com/larsch/ocra不起作用(如链接中的一个问题所述)问题:https://github.com/larsch/ocra/issues/29(Ocra是1.9的"new"rubyscript2exe,本质上它用于将rb脚本部署为可执行文件)唯一的问题似乎是缺少tcl的DLL文件我不认为这是一个问题据我所知,问题是缺少tk的DLL文件如果它们是已知的,则可以在执行ocra时将它们包括在内有没有办法知道tk工作所需的DLL依赖项? 最佳答

我的Rails站点使用了一个确实不是很好的gem。每次我需要做一些新的事情时,我最终不得不花费与向实际Rails项目添加代码一样多的时间来为gem添加功能。但我不介意,我将我的Gemfile设置为指向我的gem的GitHub分支(我尝试提交PR,但维护者似乎已经下台)。问题是我真的没有找到一种合理的方法来测试我添加到gem的新东西。在railsc中测试它会特别好,但我能想到的唯一方法是a)更改~/.rvm/gems/.../foo。rb,这看起来不对或者b)升级版本,推送到Github,然后运行bundleup,这除了耗时之外显然是一场灾难,因为我不确定我所做的promise是否正

我有一个类unzipper.rb,它使用Rubyzip解压文件。在我的本地环境中,我可以成功解压缩文件,而无需使用require'zip'明确包含依赖项但是在Heroku上,我得到一个NameError(uninitializedconstantUnzipper::Zip)我只能通过使用明确的require来解决问题:为什么这在Heroku环境中是必需的,但在本地主机上却不是?我的印象是Rails自动需要所有gem。app/services/unzipper.rbrequire'zip'#OnlyrequiredforHeroku.Workslocallywithout!class

我希望访问我机器上的所有HTTP流量(我的Windows机器-不是服务器)。据我了解,拥有一个本地代理是所有流量路线的必经之路。我一直在谷歌搜索但未能找到任何资源(关于Ruby)来帮助我。非常感谢任何提示或链接。 最佳答案 WEBrick中有一个HTTP代理(Rubystdlib的一部分)和here's一个实现示例。如果你喜欢生活在边缘,还有em-proxy伊利亚·格里戈里克。这postIlya暗示它似乎确实需要一些调整来解决您的问题。 关于ruby-如何捕获所有HTTP流量(本地代理)