文章目录

当前是在学习kafka3.0的教程,基于需求就进行搭建了kafka集群,kafka在2.8.0之前是需要zookeeper的,之后可以不需要依赖了,目前的部署方案是基于zookeeper集群的情况下进行的,若是你还没有搭建zookeeper集群,可见:docker-compose快速搭建Zookeeper集群。

我自己搭建录制了个视频见:docker-compose快速搭建zookeeper集群以及kafka集群

所有博客文件目录索引:博客目录索引(持续更新)

详细步骤如下:

1、拉取kafka3.0.0的镜像

docker pull bitnami/kafka:3.0.0

2、编写docker compose的yaml配置文件

需要说明一下,当前的网络使用的是之前已经创建的网络【zk-net】,所以在下面的配置文件中只需要进行网络声明一下,之后的服务即可指定net-work了(若是不声明就会报错)。

在/home/dockerfiles目录中创建docker-compose-kafkas.yml文件:

version: '3.1'

# 外部网络声明(否则无法使用之前已经定义好的网络)

networks:

zk-net:

external: true

services:

kafka1:

image: 'bitnami/kafka:3.0.0'

container_name: kafka1

hostname: kafka1

networks:

- zk-net

ports:

- '9093:9092'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=1

- KAFKA_INTER_BROKER_LISTENER_NAME=CLIENT

- KAFKA_CFG_LISTENER_SECURITY_PROTOCOL_MAP=CLIENT:PLAINTEXT,EXTERNAL:PLAINTEXT

- KAFKA_CFG_ADVERTISED_LISTENERS=CLIENT://kafka1:9092,EXTERNAL://kafka1:9093

- KAFKA_CFG_LISTENERS=CLIENT://:9092,EXTERNAL://:9093

- ALLOW_PLAINTEXT_LISTENER=yes

kafka2:

image: 'bitnami/kafka:3.0.0'

container_name: kafka2

hostname: kafka2

networks:

- zk-net

ports:

- '9094:9092'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=2

- KAFKA_INTER_BROKER_LISTENER_NAME=CLIENT

- KAFKA_CFG_LISTENER_SECURITY_PROTOCOL_MAP=CLIENT:PLAINTEXT,EXTERNAL:PLAINTEXT

- KAFKA_CFG_ADVERTISED_LISTENERS=CLIENT://kafka2:9092,EXTERNAL://kafka2:9094

- KAFKA_CFG_LISTENERS=CLIENT://:9092,EXTERNAL://:9094

- ALLOW_PLAINTEXT_LISTENER=yes

kafka3:

image: 'bitnami/kafka:3.0.0'

container_name: kafka3

hostname: kafka3

networks:

- zk-net

ports:

- '9095:9092'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=3

- KAFKA_INTER_BROKER_LISTENER_NAME=CLIENT

- KAFKA_CFG_LISTENER_SECURITY_PROTOCOL_MAP=CLIENT:PLAINTEXT,EXTERNAL:PLAINTEXT

- KAFKA_CFG_ADVERTISED_LISTENERS=CLIENT://kafka3:9092,EXTERNAL://kafka3:9095

- KAFKA_CFG_LISTENERS=CLIENT://:9092,EXTERNAL://:9095

- ALLOW_PLAINTEXT_LISTENER=yes

注意点:①在KAFKA_CFG_ADVERTISED_LISTENERS配置多个监听者的时候端口是不能一样的。

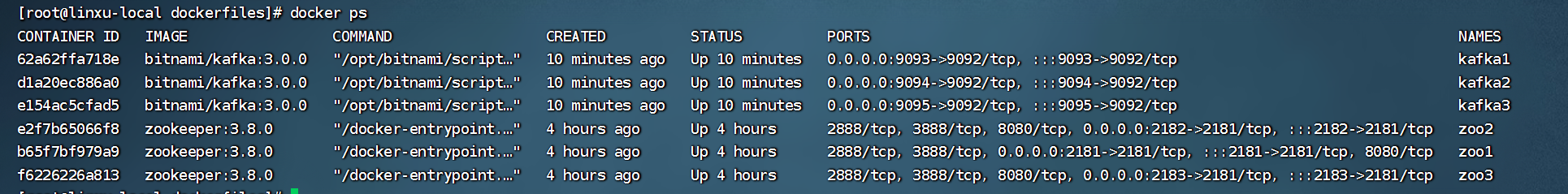

3、启动kafka集群服务

# -f表示指定某个配置文件名 -d:表示后台启动

docker-compose -f docker-compose-kafkas.yml up -d

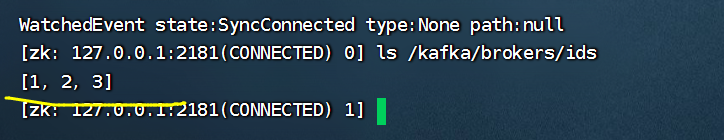

如何测试是否已经连接zookeeper呢?

# 进入zookeeper集群中的某一个服务

docker exec -it zoo2 /bin/bash

# 进入bin目录

cd bin

# 客户端工具连接到服务

./zkCli.sh -server 127.0.0.1:2181

# 查看对应的kafka结点信息

ls /kafka/brokers/ids

搭建成功如下信息所示:

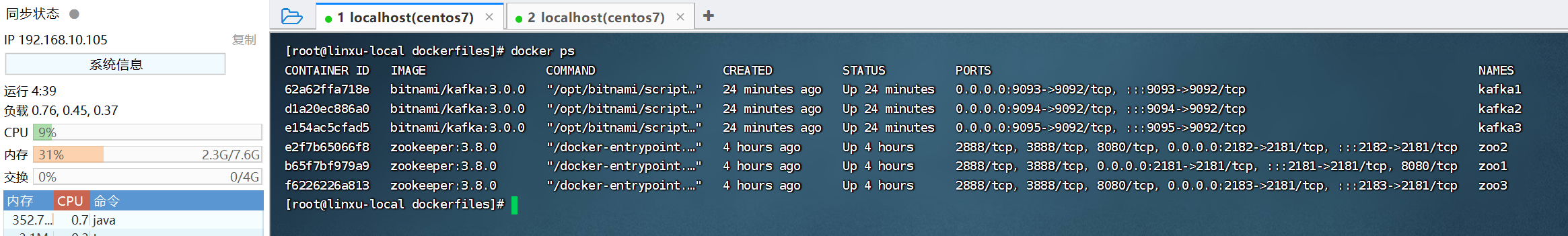

搭建zookeeper集群以及kafka集群所需内存如下:

若是你的集群中某个服务没有启动起来,可以使用如下查看指定服务日志:

docker logs 服务名

**注意:**停止 Kafka 集群时,一定要等 Kafka 所有节点进程全部停止后再停止 Zookeeper集群。因为 Zookeeper 集群当中记录着 Kafka 集群相关信息,Zookeeper 集群一旦先停止,Kafka 集群就没有办法再获取停止进程的信息,只能手动杀死 Kafka 进程了。

创建文件:docker-compose-zookeepers-kafkas.yml

注意:为了能够Java连接到容器中的kafka,在每个kafka服务中我没有设置其他协议别名,就是单独使用了一个PLAINTEXT,并且每个服务都各自映射自己端口,而不是之前的8083:8082,8084:8082。

准备操作:查看你的公网ip地址或者你的虚拟机ip地址。

拿到这个ip地址后去修改下面配置中对应的ip地址,只有这样你的java程序才能够发送消息成功并接收!

version: '3.1'

networks:

zk-net: # 网络名

name: zk-net

driver: bridge

services:

# zookeeper集群

zoo1:

image: zookeeper:3.8.0

container_name: zoo1 # 容器名称

restart: always # 开机自启

hostname: zoo1 # 主机名

ports:

- 2181:2181 # 端口号

environment:

ZOO_MY_ID: 1

ZOO_SERVERS: server.1=zoo1:2888:3888;2181 server.2=zoo2:2888:3888;2181 server.3=zoo3:2888:3888;2181

networks:

- zk-net

zoo2:

image: zookeeper:3.8.0

container_name: zoo2

restart: always

hostname: zoo2

ports:

- 2182:2181

environment:

ZOO_MY_ID: 2

ZOO_SERVERS: server.1=zoo1:2888:3888;2181 server.2=zoo2:2888:3888;2181 server.3=zoo3:2888:3888;2181

networks:

- zk-net

zoo3:

image: zookeeper:3.8.0

container_name: zoo3

restart: always

hostname: zoo3

ports:

- 2183:2181

environment:

ZOO_MY_ID: 3

ZOO_SERVERS: server.1=zoo1:2888:3888;2181 server.2=zoo2:2888:3888;2181 server.3=zoo3:2888:3888;2181

networks:

- zk-net

# kafka集群

kafka1:

image: 'bitnami/kafka:3.0.0'

container_name: kafka1

hostname: kafka1

networks:

- zk-net

ports:

- '9092:9092'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=1

- KAFKA_CFG_LISTENERS=PLAINTEXT://:9092

- KAFKA_CFG_ADVERTISED_LISTENERS=PLAINTEXT://192.168.10.105:9092

- ALLOW_PLAINTEXT_LISTENER=yes

depends_on:

- zoo1

- zoo2

- zoo3

kafka2:

image: 'bitnami/kafka:3.0.0'

container_name: kafka2

hostname: kafka2

networks:

- zk-net

ports:

- '9093:9093'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=2

- KAFKA_CFG_LISTENERS=PLAINTEXT://:9093

- KAFKA_CFG_ADVERTISED_LISTENERS=PLAINTEXT://192.168.10.105:9093

- ALLOW_PLAINTEXT_LISTENER=yes

depends_on:

- zoo1

- zoo2

- zoo3

kafka3:

image: 'bitnami/kafka:3.0.0'

container_name: kafka3

hostname: kafka3

networks:

- zk-net

ports:

- '9094:9094'

environment:

- KAFKA_CFG_ZOOKEEPER_CONNECT=zoo1:2181,zoo2:2182,zoo3:2183/kafka

- KAFKA_BROKER_ID=3

- KAFKA_CFG_LISTENERS=PLAINTEXT://:9094

- KAFKA_CFG_ADVERTISED_LISTENERS=PLAINTEXT://192.168.10.105:9094

- ALLOW_PLAINTEXT_LISTENER=yes

depends_on:

- zoo1

- zoo2

- zoo3

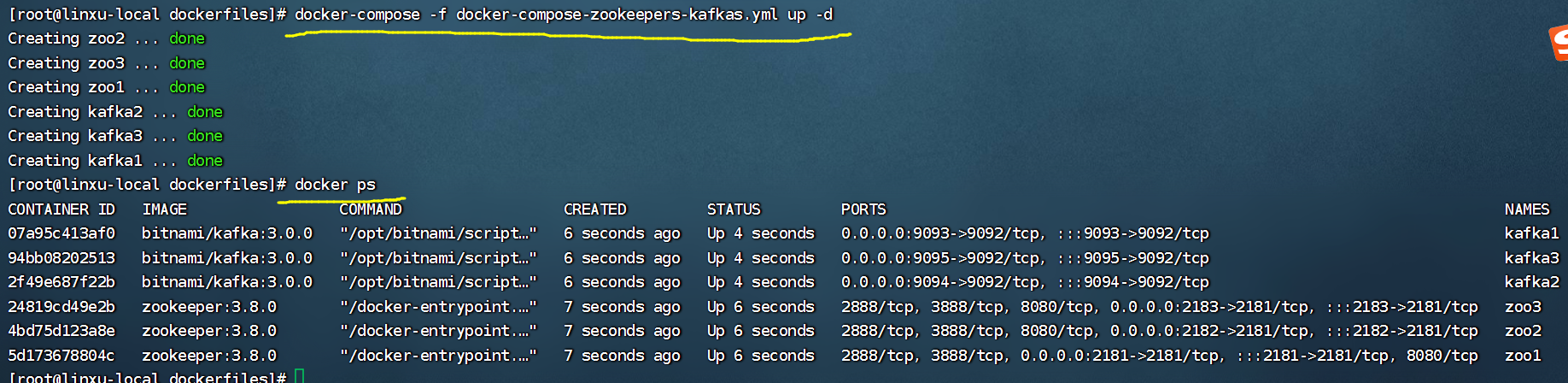

启动服务命令:

# -f表示指定某个配置文件名 -d:表示后台启动

docker-compose -f docker-compose-zookeepers-kafkas.yml up -d

# 查看当前服务

docker ps

[1]. ERROR: SERVICE “CEREBRO“ USES AN UNDEFINED NETWORK

[2]. kafka报No security protocol defined for listener INTERNAL

[3]. kafka 外部无法连接进行生产消费(服务器docker搭建)

[4]. docker-compose 搭建 kafka 集群

1.错误信息:Errorresponsefromdaemon:Gethttps://registry-1.docker.io/v2/:net/http:requestcanceledwhilewaitingforconnection(Client.Timeoutexceededwhileawaitingheaders)或者:Errorresponsefromdaemon:Gethttps://registry-1.docker.io/v2/:net/http:TLShandshaketimeout2.报错原因:docker使用的镜像网址默认为国外,下载容易超时,需要修改成国内镜像地址(首先阿里

有没有办法快速将表格格式的ruby哈希打印到文件中?如:keyAkeyBkeyC...1232343451253474456...其中散列的值是不同大小的数组。还是使用双循环是唯一的方法?谢谢 最佳答案 试试我写的这个gem(在表中打印散列、ruby对象、ActiveRecord对象):http://github.com/arches/table_print 关于ruby-如何以表格格式快速打印Ruby哈希值?,我们在StackOverflow上找到一个类似的问题:

电脑启动出现显示器黑屏是一个相当常见的问题。如果您遇到了这个问题,不要惊慌,因为它有很多可能的原因,可以采取一些简单的措施来解决它。在本文中,小编将介绍下面4种常见的电脑启动后显示器黑屏的原因,排查这些原因,快速解决! 演示机型:联想Ideapad700-15ISK-ISE系统版本:Windows10一、显示器问题如果出现电脑启动后显示器黑屏的情况。那么首先您需要检查一下显示器是否正常工作。您可以通过更换另一个显示器或将当前显示器连接到另一台计算机来检查显示器是否存在问题。如果问题仍然存在,那么您可以排除显示器故障的可能性。 二、显卡问题如果您的电脑配备了独立显卡,那么显卡故障也可能是导致电脑

我正在尝试使用docker运行一个Rails应用程序。通过github的sshurl安装的gem很少,如下所示:Gemfilegem'swagger-docs',:git=>'git@github.com:xyz/swagger-docs.git',:branch=>'my_branch'我在docker中添加了keys,它能够克隆所需的repo并从git安装gem。DockerfileRUNmkdir-p/root/.sshCOPY./id_rsa/root/.ssh/id_rsaRUNchmod700/root/.ssh/id_rsaRUNssh-keygen-f/root/.ss

我在Heroku上构建了一个必须在Docker容器内运行的RoR应用程序。为此,我使用officialDockerfile.因为它在Heroku中很常见,所以我需要一些附加组件才能使这个应用程序完全运行。在生产中,变量DATABASE_URL在我的应用程序中可用。但是,如果我尝试其他一些使用环境变量(在我的例子中是Mailtrap)的加载项,变量不会在运行时复制到实例中。所以我的问题很简单:如何让docker实例在Heroku上执行时知道环境变量?您可能会问,我已经知道我们可以在docker-compose.yml中指定一个environment指令。我想避免这种情况,以便能够通过项目

mutationtesting遇到一个问题是它很慢,因为默认情况下您会为每个生成的突变执行完整的测试运行(测试文件或一组测试文件)。加快突变测试的一种方法是,一旦遇到单一故障(但仅在突变测试期间),就停止对给定突变体的测试运行。更好的做法是让变异测试者记住杀死最后一个变异体的第一个测试是什么,并将其首先交给下一个变异体。ruby中是否有任何东西可以做这些事情,或者我最好的选择是开始猴子修补?(是的,我知道单元测试应该很快。显示所有失败的测试在突变测试之外很有用,因为它不仅可以帮助您识别出问题,还可以查明哪里出了问题)编辑:我目前正在对测试/单元使用heckle。如果测试/单元不可能记住

我在开发和生产中都使用docker,真正困扰我的一件事是docker缓存的简单性。我的ruby应用程序需要bundleinstall来安装依赖项,因此我从以下Dockerfile开始:添加GemfileGemfile添加Gemfile.lockGemfile.lock运行bundleinstall--path/root/bundle所有依赖项都被缓存,并且在我添加新gem之前效果很好。即使我添加的gem只有0.5MB,从头开始安装所有应用程序gem仍然需要10-15分钟。由于依赖项文件夹的大小(大约300MB),然后再花10分钟来部署它。我在node_modules和npm上遇到了

开门见山|拉取镜像dockerpullelasticsearch:7.16.1|配置存放的目录#存放配置文件的文件夹mkdir-p/opt/docker/elasticsearch/node-1/config#存放数据的文件夹mkdir-p/opt/docker/elasticsearch/node-1/data#存放运行日志的文件夹mkdir-p/opt/docker/elasticsearch/node-1/log#存放IK分词插件的文件夹mkdir-p/opt/docker/elasticsearch/node-1/plugins若你使用了moba,直接右键新建即可如上图所示依次类推创建

我有两个类:1.Sale是ActiveRecord的子类;它的工作是将销售数据持久保存到数据库中。classSale2.SalesReport是一个标准的Ruby类;它的工作是生成和绘制有关销售的信息。classSalesReportdefinitialize(start_date,end_date)@start_date=start_date@end_date=end_dateenddefsales_in_durationSale.total_for_duration(@start_date,@end_date)end#...end因为我想使用TDD并且我希望我的测试运行得非常快,所

测试环境对于任何一个软件公司来讲,都是核心基础组件之一。转转的测试环境伴随着转转的发展也从单一的几套环境发展成现在的任意的docker动态环境+docker稳定环境环境体系。期间环境系统不断的演进,去适应转转集群扩张、新业务的扩展,走了一些弯路,但最终我们将系统升级到了我们认为的终极方案。下面我们介绍一下转转环境的演进和最终的解决方案。1测试环境演进1.1单体环境 转转在2017年成立之初,5台64G内存的机器,搭建5个完整的测试环境。就满足了转转的日常所需。一台分给开发,几台分给测试。通过沟通协调就能解决多分支并行开发下冲突问题。1.2动态环境+稳定环境 随着微服务化的进