夜莺监控( Nightingale )是一款国产、开源云原生监控分析系统,采用 All-In-One 的设计,集数据采集、可视化、监控告警、数据分析于一体。于 2020 年 3 月 20 日,在 github 上发布 v1 版本,已累计迭代 60 多个版本。从 v5 版本开始与 Prometheus、VictoriaMetrics、Grafana、Telegraf、Datadog 等生态紧密协同集成,提供开箱即用的企业级监控分析和告警能力,已有众多企业选择将 Prometheus + AlertManager + Grafana 的组合方案升级为使用夜莺监控。

夜莺监控,由滴滴开发和开源,并于 2022 年 5 月 11 日,捐赠予中国计算机学会开源发展委员会(CCF ODC),为 CCF ODC 成立后接受捐赠的第一个开源项目。夜莺监控的核心开发团队,也是Open-Falcon项目原核心研发人员

官网链接:快猫星云Flashcat | 云原生监控 | 混合云监控 | 稳定性保障体系

现在夜莺的版本已经更新迭代到V6版本

Ninghtingale下载地址:Nightingale - 快猫星云 (flashcat.cloud)

Categraf下载地址:Categraf - 快猫星云 (flashcat.cloud)

Categraf官方github地址:https://github.com/flashcatcloud/categraf

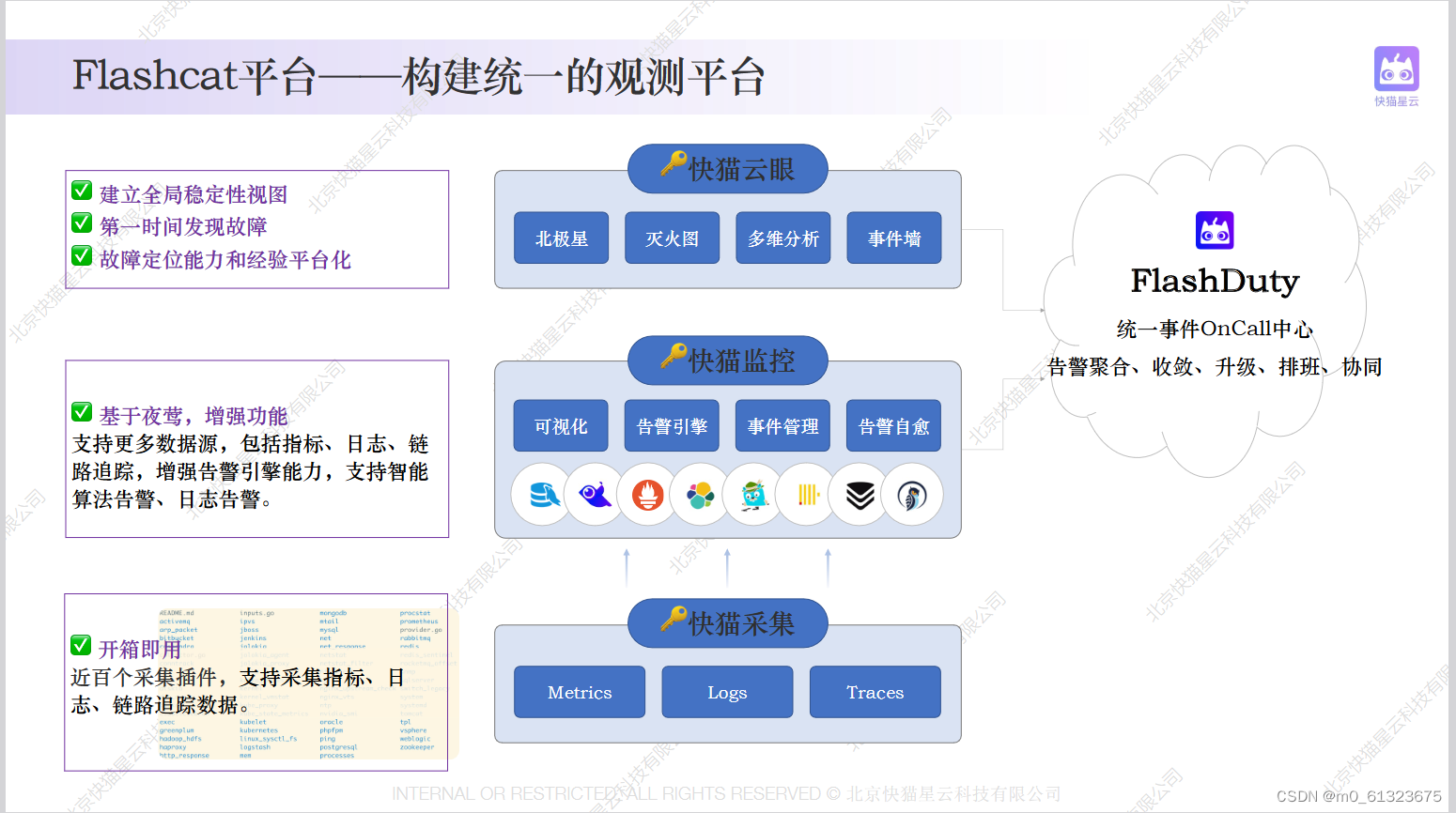

最新版本V6架构图:

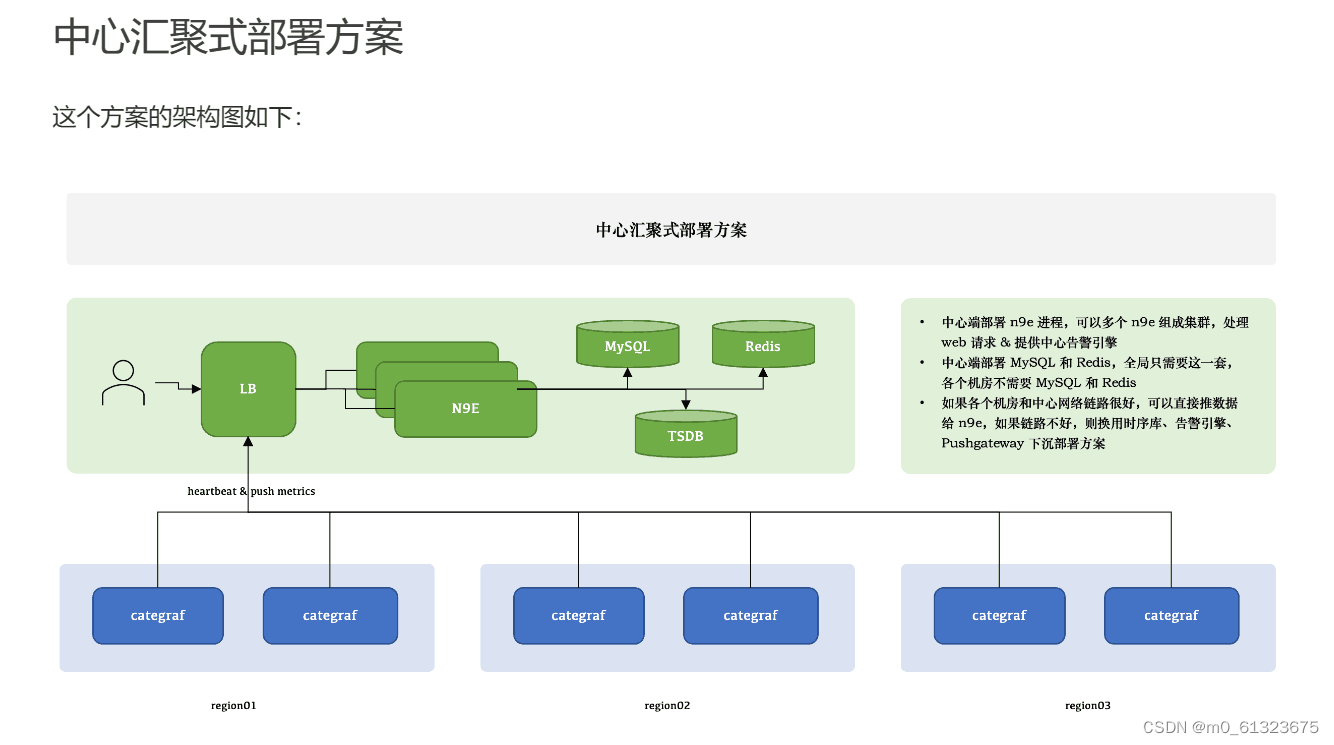

这个中心汇聚式是最常用的

还有一种是针对如果网络链路不好,则要使用下面的部署方式:

还有一种是针对如果网络链路不好,则要使用下面的部署方式:

Mysql:所有的告警信息,配置信息(比如普罗米修斯的),告警规则等等都存储在mysql里面;

Redis: 存储一些验证信息,JWT的token,metadata元信息,元数据,心跳信息等

TSDB:时序数据库(可以支持Prometheus、M3DB、VictoriaMetrics、Thanos等)

N9e:Nightingale | 夜莺监控,一款先进的开源云原生监控分析系统,采用 All-In-One 的设计,集数据采集、可视化、监控告警、数据分析于一体,与云原生生态紧密集成,提供开箱即用的企业级监控分析和告警能力。于 2022 年 5 月 11 日,捐赠予中国计算机学会开源发展委员会(CCF ODC),为 CCF ODC 成立后接受捐赠的首个开源项目,Nightingale 可以接收各种采集器上报的监控数据,转存到时序库(可以支持Prometheus、M3DB、VictoriaMetrics、Thanos等),并提供告警规则、屏蔽规则、订阅规则的配置能力,提供监控数据的查看能力,提供告警自愈机制(告警触发之后自动回调某个webhook地址或者执行某个脚本),提供历史告警事件的存储管理、分组查看的能力,n9e可以做集群,多个n9e分担告警规则的处理和压力,n9e也分为无状态和有状态服务。

LB:nginx做7层代理

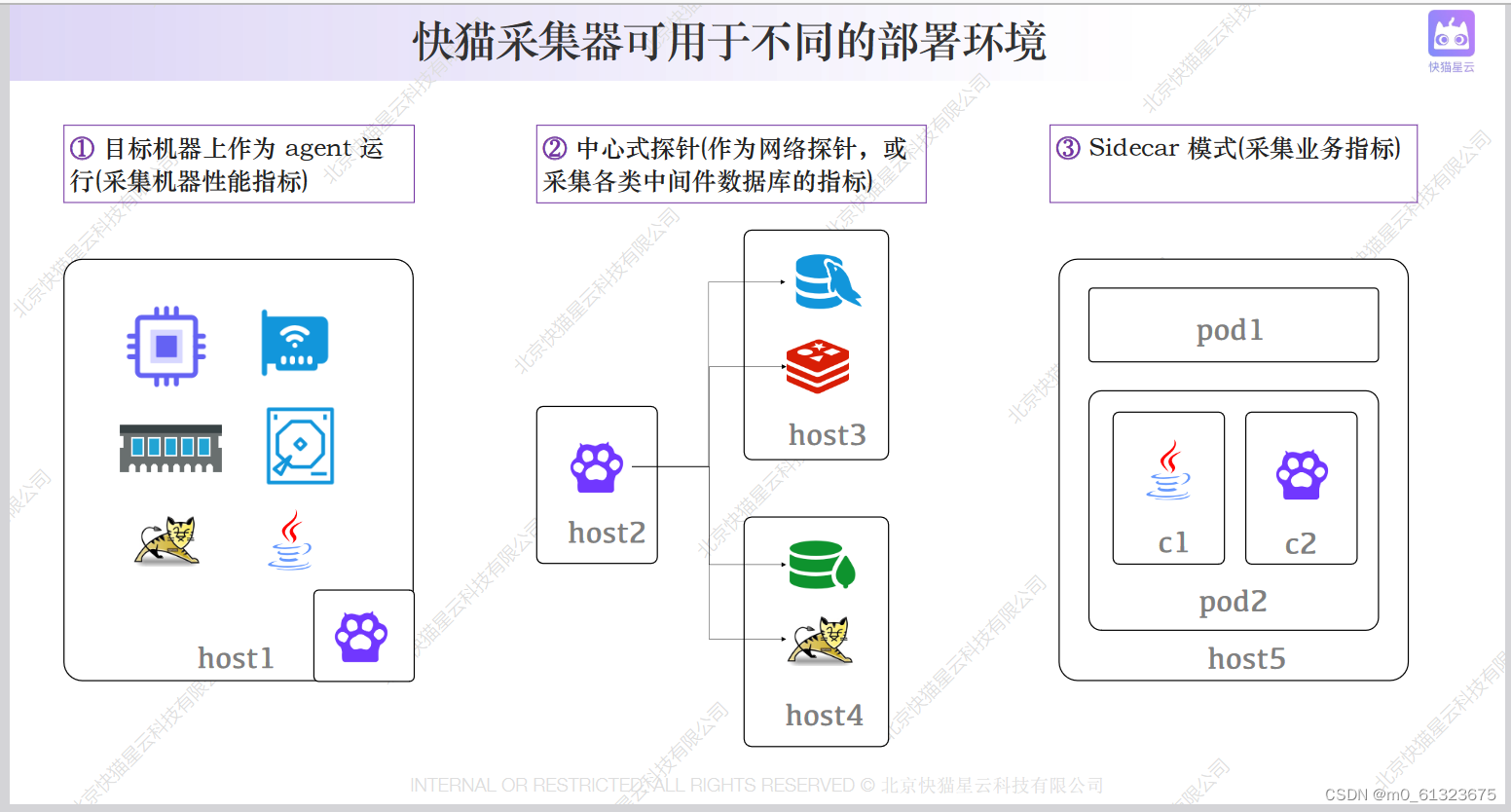

categraf: 是夜莺监控的默认的自制的数据采集器

| name | 系统 | 配置 |

| flashcat | Centos7.9 | 2核4G 磁盘100G |

Ninghtingale下载地址:Nightingale - 快猫星云 (flashcat.cloud)

下载安装部署配置mysql和redis :

# install mysql

yum -y install mariadb*

systemctl enable mariadb

systemctl restart mariadb

mysql -e "SET PASSWORD FOR 'root'@'localhost' = PASSWORD('1234');"

# install redis

yum install -y redis

systemctl enable redis

systemctl restart redis

下载n9e包并且导入sql表

mkdir -p /opt/n9e && cd /opt/n9e

wget wget https://download.flashcat.cloud/n9e-v6.0.0-ga.3-linux-amd64.tar.gz

tar zxvf n9e-v6.0.0-ga.3-linux-amd64.tar.gz

mysql -uroot -p1234 < n9e.sql

启动n9e,并且查看是否启动,n9e启动的默认端口是17000

nohup ./n9e &> n9e.log &

ss -ntpl | grep 17000

如果启动成功,n9e 默认会监听在 17000 端口。上面使用 nohup 简单演示,生产环境建议用 systemd 托管。

配置文件在当前目录 etc/config.toml 中含有 mysql 的连接地址配置,如果连接数据库报错,可以检查一下用户名和密码

夜莺服务端部署好之后,浏览器访问 17000 就可以体验相关功能了,默认用户是 root,密码是 root.2020

Categraf官方github地址:https://github.com/flashcatcloud/categraf

解压categraf

tar xf categraf-v0.2.38-linux-amd64.tar.gz -C /opt

cd /opt

解压完毕后会发现有一个可执行文件categraf和一个文件夹conf,conf文件下面有很多input的文件夹,里面都是每一个插件的配置文件(xxx.toml)config.toml是主配置文件

打开config.toml进行配置

......

...... ##第一步 找到[[writers]]字段

[writer_opt]

batch = 1000

chan_size = 1000000

[[writers]]

url = "http://127.0.0.1:17000/prometheus/v1/write" ##这里的端口要改成你n9e启动的端口,默认的就是17000,其实就是你n9e的地址

# Basic auth username

......

...... ##第二步 找到[heartbeat]字段

[ibex]

enable = false

## ibex flush interval

interval = "1000ms"

## n9e ibex server rpc address

servers = ["127.0.0.1:20090"]

## temp script dir

meta_dir = "./meta"

[heartbeat]

enable = true ##这里的false改为ture 启动heartbeat功能来收集本台主机的信息

# report os version cpu.util mem.util metadata

url = "http://127.0.0.1:17000/v1/n9e/heartbeat"

然后直接启动categraf

nohup ./categraf &>stdout.log &然后可以查看本台主机状态在n9e的web页面查看

VictoriaMetrics官方文档:VictoriaMetrics: Simple & Reliable Monitoring for Everyone

Github下载地址:Releases · VictoriaMetrics/VictoriaMetrics (github.com)

VictoriaMetrics 架构简单,可靠性高,在性能,成本,可扩展性方面表现出色,社区活跃,且和 Prometheus 生态绑定紧密。如果单机版本的 Prometheus 无法在容量上满足贵司的需求,可以使用 VictoriaMetrics 作为时序数据库。

VictoriaMetrics 提供单机版和集群版。如果您的每秒写入数据点数小于100万(这个数量是个什么概念呢,如果只是做机器设备的监控,每个机器差不多采集200个指标,采集频率是10秒的话每台机器每秒采集20个指标左右,100万/20=5万台机器),VictoriaMetrics 官方默认推荐您使用单机版,单机版可以通过增加服务器的CPU核心数,增加内存,增加IOPS来获得线性的性能提升。且单机版易于配置和运维,

可以说VictoriaMetrics是企业版的普罗米修斯。

部署安装解压

cd /opt

mkdir vm && cd vm

tar xf victoria-metrics-linux-amd64-v1.90.0.tar.gz

## 我们这里因为是单机点所以用的victoriaMetrics是单机版,解压过后只有一个文件victoria-metrics-prod直接启动VictoriaMetrics

nohup ./victoria-metrics-prod &> stdout.log &

他的默认端口是8428 启动后 可以使用命令ss -ntpl查看是否启动,启动成功后如果不指定存储目录他会在当前目录默认创建一个victoria-metrics-data的文件夹来存储数据 如果需要更改存储目录加参数-storageDataPath 即可

修改n9e的配置文件,配置VictoriaMetrics的地址来查看数据

vim /opt/n9e/etc/config.toml

.....

.....

..... ##在最后找到 [[Pushgw.Writers]]字段

[[Pushgw.Writers]]

# Url = "http://127.0.0.1:8480/insert/0/prometheus/api/v1/write"

#Url = "http://127.0.0.1:9090/api/v1/write" ##这里注释掉 这个是普罗米修斯的默认的remote-wirte协议的接口,因为我们安装的是vm所以这里注释掉

Url = "http://127.0.0.1:8428/api/v1/write" ##这里添加为VictoriaMetrics的地址8428的端口

# Basic auth username

BasicAuthUser = ""

# Basic auth password

BasicAuthPass = ""

# timeout settings, unit: ms

Headers = ["X-From", "n9e"]

Timeout = 10000

DialTimeout = 3000

TLSHandshakeTimeout = 30000

ExpectContinueTimeout = 1000

IdleConnTimeout = 90000

# time duration, unit: ms

KeepAlive = 30000

MaxConnsPerHost = 0

MaxIdleConns = 100

MaxIdleConnsPerHost = 100

## Optional TLS Config

# UseTLS = false

# TLSCA = "/etc/n9e/ca.pem"

# TLSCert = "/etc/n9e/cert.pem"

# TLSKey = "/etc/n9e/key.pem"

# InsecureSkipVerify = false

# [[Writers.WriteRelabels]]

# Action = "replace"

# SourceLabels = ["__address__"]

# Regex = "([^:]+)(?::\\d+)?"

# Replacement = "$1:80"

# TargetLabel = "__address__"

重启n9e

pkill n9e

nohup ./n9e &> n9e.log &

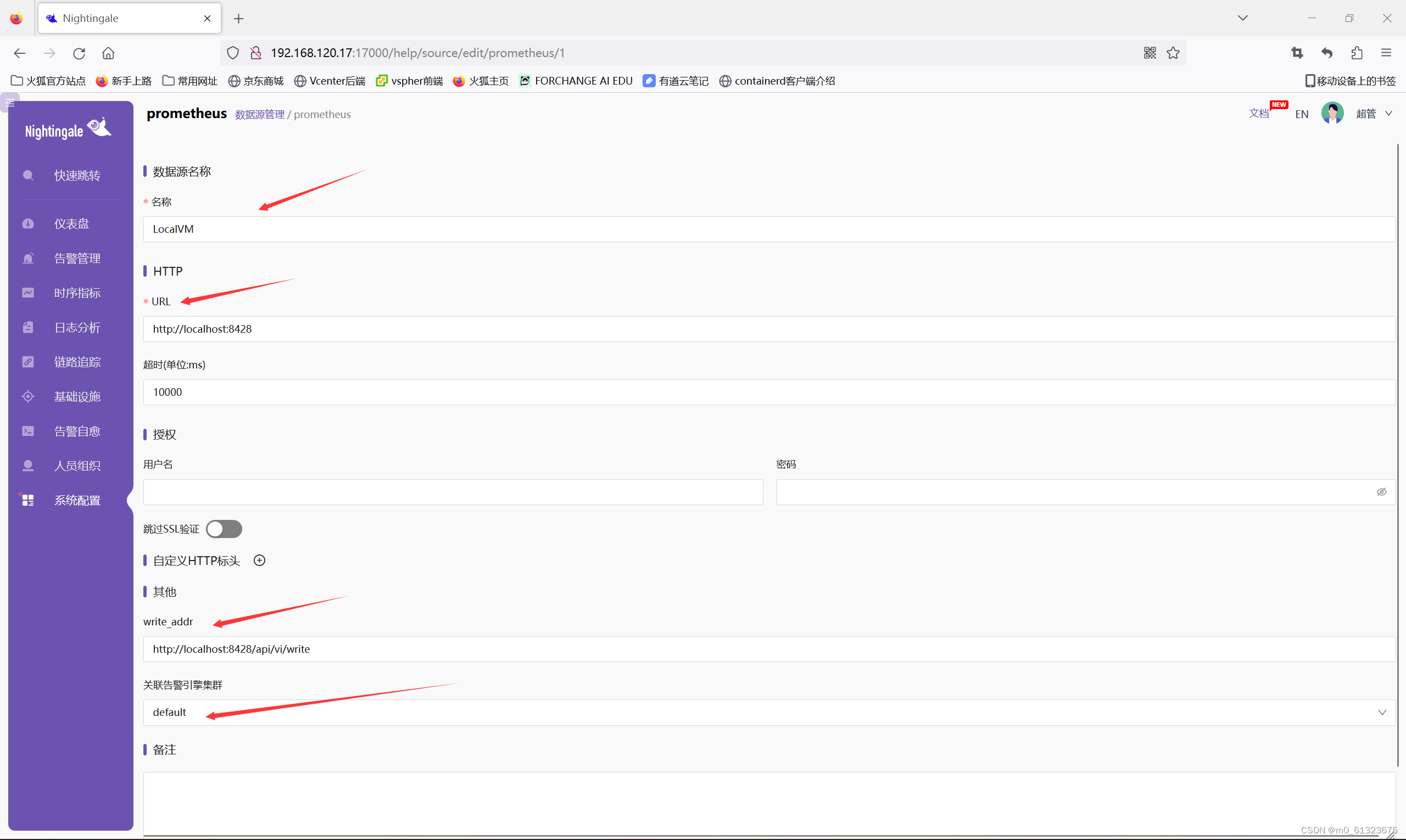

进入n9e的web页面17000端口添加数据源

然后保存 验证是否配置数据源成功

这样就可以通过sql语句查询本机的一些数据信息

这样就可以通过sql语句查询本机的一些数据信息

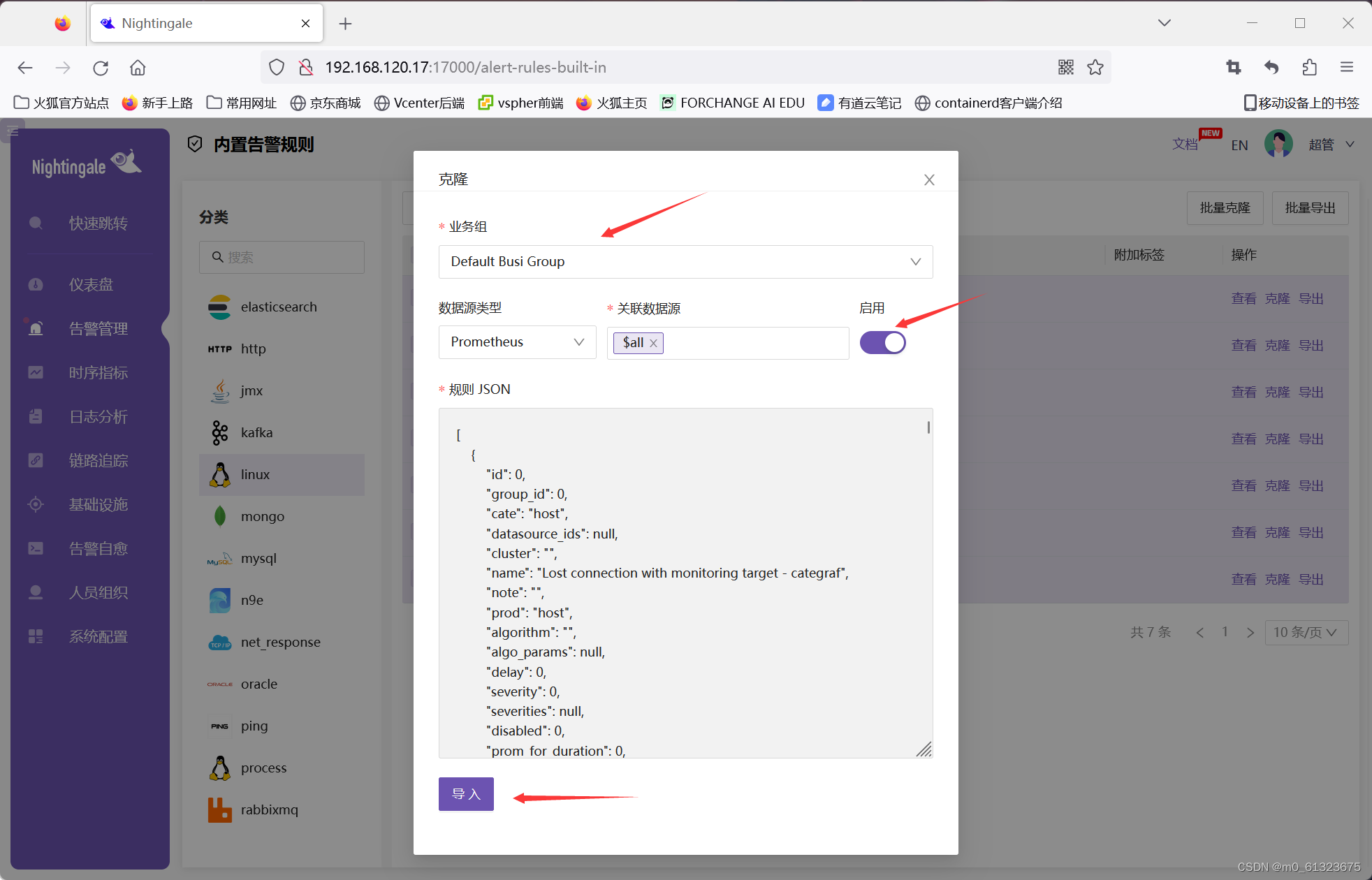

还可以创建一些内置的告警规则来告警判断

点击批量克隆

在这里也可以自己新增加告警规则来判断告警

至此部署完成

这里再补充一下n9e配置文件存储日志的字段,切片,类似于ELK里的E做切片存储

vim /opt/n9e/etc/config.toml

.....

.....

..... 找到log字段

[Log]

# log write dir

Dir = "logs" ##这里的意思是日志写到当前目录的logs目录下

# log level: DEBUG INFO WARNING ERROR

Level = "DEBUG"

# stdout, stderr, file

Output = "stdout"

# # rotate by time

# KeepHours: 4 ##这里的意思是我要保存4个小时的n9e日志

# # rotate by size

# RotateNum = 3 ##这里是按大小来存储日志 存储3个文件,每个文件有256MB大小这么大来存储日志,对应下面的RotateSize字段来配置启动

# # unit: MB

# RotateSize = 256

如果需要实现日志的存储其他功能 把前面的注释取消掉就可以连通

后面还会每周更新这个夜莺系列 还有很多用法,告警,还有一些案列来做,后面的详细的页面功能也会一一介绍,可以多看一下n9e的config.toml的配置文件来了解更多夜莺的功能。

我是Google云的新手,我正在尝试对其进行首次部署。我的第一个部署是RubyonRails项目。我基本上是在关注thisguideinthegoogleclouddocumentation.唯一的区别是我使用的是我自己的项目,而不是他们提供的“helloworld”项目。这是我的app.yaml文件runtime:customvm:trueentrypoint:bundleexecrackup-p8080-Eproductionconfig.ruresources:cpu:0.5memory_gb:1.3disk_size_gb:10当我转到我的项目目录并运行gcloudprevie

我可以在Azure网站上部署RubyonRails吗? 最佳答案 还没有。目前仅支持.NET和PHP。 关于ruby-on-rails-RubyonRails可以部署在Azure网站上吗?,我们在StackOverflow上找到一个类似的问题: https://stackoverflow.com/questions/12964010/

?博客主页:https://xiaoy.blog.csdn.net?本文由呆呆敲代码的小Y原创,首发于CSDN??学习专栏推荐:Unity系统学习专栏?游戏制作专栏推荐:游戏制作?Unity实战100例专栏推荐:Unity实战100例教程?欢迎点赞?收藏⭐留言?如有错误敬请指正!?未来很长,值得我们全力奔赴更美好的生活✨------------------❤️分割线❤️-------------------------

这篇文章是继上一篇文章“Observability:从零开始创建Java微服务并监控它(一)”的续篇。在上一篇文章中,我们讲述了如何创建一个Javaweb应用,并使用Filebeat来收集应用所生成的日志。在今天的文章中,我来详述如何收集应用的指标,使用APM来监控应用并监督web服务的在线情况。源码可以在地址 https://github.com/liu-xiao-guo/java_observability 进行下载。摄入指标指标被视为可以随时更改的时间点值。当前请求的数量可以改变任何毫秒。你可能有1000个请求的峰值,然后一切都回到一个请求。这也意味着这些指标可能不准确,你还想提取最小/

前置步骤我们都操作完了,这篇开始介绍jenkins的集成。话不多说,看操作1、登录进入jenkins后会让你选择安装插件,选择第一个默认的就行。安装完成后设置账号密码,重新登录。2、配置JDK和Git都需要执行路径,所以需要先把执行路径找到,先进入服务器的docker容器,2.1JDK的路径root@69eef9ee86cf:/usr/bin#echo$JAVA_HOME/usr/local/openjdk-82.2Git的路径root@69eef9ee86cf:/#whichgit/usr/bin/git3、先配置JDK和Git。点击:ManageJenkins>>GlobalToolCon

深度学习部署:Windows安装pycocotools报错解决方法1.pycocotools库的简介2.pycocotools安装的坑3.解决办法更多Ai资讯:公主号AiCharm本系列是作者在跑一些深度学习实例时,遇到的各种各样的问题及解决办法,希望能够帮助到大家。ERROR:Commanderroredoutwithexitstatus1:'D:\Anaconda3\python.exe'-u-c'importsys,setuptools,tokenize;sys.argv[0]='"'"'C:\\Users\\46653\\AppData\\Local\\Temp\\pip-instal

Ocra无法处理需要“tk”的应用程序require'tk'puts'nope'用奥克拉http://github.com/larsch/ocra不起作用(如链接中的一个问题所述)问题:https://github.com/larsch/ocra/issues/29(Ocra是1.9的"new"rubyscript2exe,本质上它用于将rb脚本部署为可执行文件)唯一的问题似乎是缺少tcl的DLL文件我不认为这是一个问题据我所知,问题是缺少tk的DLL文件如果它们是已知的,则可以在执行ocra时将它们包括在内有没有办法知道tk工作所需的DLL依赖项? 最佳答

我有一个类unzipper.rb,它使用Rubyzip解压文件。在我的本地环境中,我可以成功解压缩文件,而无需使用require'zip'明确包含依赖项但是在Heroku上,我得到一个NameError(uninitializedconstantUnzipper::Zip)我只能通过使用明确的require来解决问题:为什么这在Heroku环境中是必需的,但在本地主机上却不是?我的印象是Rails自动需要所有gem。app/services/unzipper.rbrequire'zip'#OnlyrequiredforHeroku.Workslocallywithout!class

出于某种原因,heroku尝试要求dm-sqlite-adapter,即使它应该在这里使用Postgres。请注意,这发生在我打开任何URL时-而不是在gitpush本身期间。我构建了一个默认的Facebook应用程序。gem文件:source:gemcuttergem"foreman"gem"sinatra"gem"mogli"gem"json"gem"httparty"gem"thin"gem"data_mapper"gem"heroku"group:productiondogem"pg"gem"dm-postgres-adapter"endgroup:development,:t

目录H2数据库入门以及实际开发时的使用1.H2数据库的初识1.1H2数据库介绍1.2为什么要使用嵌入式数据库?1.3嵌入式数据库对比1.3.1性能对比1.4技术选型思考2.H2数据库实战2.1H2数据库下载搭建以及部署2.1.1H2数据库的下载2.1.2数据库启动2.1.2.1windows系统可以在bin目录下执行h2.bat2.1.2.2同理可以通过cmd直接使用命令进行启动:2.1.2.3启动后控制台页面:2.1.3spring整合H2数据库2.1.3.1引入依赖文件2.1.4数据库通过file模式实际保存数据的位置2.2H2数据库操作2.2.1Mysql兼容模式2.2.2Mysql模式