边缘检测是描边效果的一种实现方法,关于描边效果其实还有更好的基于深度+法线纹理实现的方法,这里就先以边缘检测为主进行学习。

哪位高手能解释一下卷积神经网络的卷积核? - 知乎 (zhihu.com)

卷积(Convolution),是图像处理中很常见的方法,平常也能在课程学习中(例如我《机器学习》这门课)看到它的身影(CNN,Convolutional neural network,即卷积神经网络)。但要注意,数学中的卷积和卷积神经网络中的卷积严格意义上是两种不同的运算方式。

数学中的卷积分为连续、离散两种卷积操作,但由于一般CNN都是离散卷积,所以数学卷积就拿二维离散卷积处理为例,我们可以拿数字图像处理为例,图像处理(Image Processing)是通过计算机技术将图像信号转化为数字信号,并利用数字信号对该图像进行处理的过程。

而图像处理中的卷积操作实际上是指使用一个卷积核对图像中的每个像素进行处理。卷积核(kernel)就是一个四方形网格结构(2X2、3X3的矩阵),网格的每个方格都有一个权重值,是一组权重的集合。

如何进行——当我们开始对一张图像的某个像素进行操作时,会把卷积核的中心放在该像素上,先翻转,再依次计算卷积核中每个权重值与覆盖像素值的乘积并求和,得到最终的新像素值。如果要对图像上多个像素处理,卷积核就先翻转,之后在进行平移、计算。

卷积神经网络中的卷积,本质上是是信号处理中的互相关函数(Correlation)计算,或者说是相当于图像处理中的spatial filter。

跟数学上的卷积(Convolution)不同,CNN中的卷积更多的是为了提取图像的特征,仅仅借鉴了一个”加权求和“的概念。而且CNN本身就是一个寻求卷积核的过程,这个卷积核压根不像接下来的XX算子一样是给定的,而是未知、需要训练得出的,因此无需翻转。

边缘检测是图像处理和计算机视觉中一个常见的问题,目的是标出数字图像中亮度变化明显的点。参考高通滤波法、微分算子法、神经网络方法实现图像边缘检测,我们能够发现实际上实现边缘检测,有很多方法:高通滤波、微分算子法、神经网络方法。

其中,

(上述叙述参考了 计算机视觉(二):边缘检测)

前面介绍微分算子法时就提到了图像的边缘是如何被检测出来的,换个思路还可以反过来想边缘是如何形成的?——边缘(edge)是指一个图像上局部特性的不连续性,图像上如果相邻像素之间存在显著的颜色、亮度、纹理等等属性的差别(突变),我们就会认为这里存在一条边界。从卷积角度理解就是:核经过亮像素点时,中间像素值和周围像素值会有一个突变,我们就用梯度(gradient)去描述这一个数值的突变。

不错!也就是说,边缘处的梯度总会是比较大的,那么现在目光聚焦到了:

于是,为了获得这样一个梯度,几种不同的边缘检测算子(卷积核)相继被提出。详细一点可以直接参考这篇文章:常见边缘检测对比(Roberts算子、Prewitt算子、Sobel算子、Laplacian算子、Canny算子),这篇文章对几种常见的算子进行了公式上和优缺点的对比,同时给出了每种算子常用的场景,值得一看。

参考了边缘检测算子(Roberts算子、Prewitt算子、Sobel算子 和 Laplacian算子)

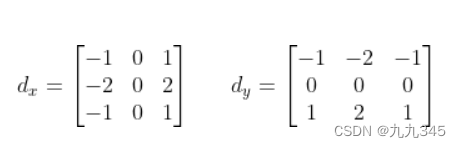

由于后面实现边缘检测用到了Sobel算子,这之前必须要做一个简单的了解。

Sobel算子结合了高斯平滑和微分求导,充分考虑了位置对边缘影响——相邻点的距离远近对当前像素点的影响程度,距离越近的影响程度越大,从而可以实现图像锐化并突出边缘轮廓的效果。Sobel算子对噪声较多的图片进行边缘检测的效果更好!对灰度变化不敏感。

学着学着我发现用于边缘检测的卷积核,无论是简单的Roberts、Prewitt还是Sobel算子,核里的权重值和都为0,而且这几个卷积核是180°对称的(上下翻转是对称的),这是为啥?

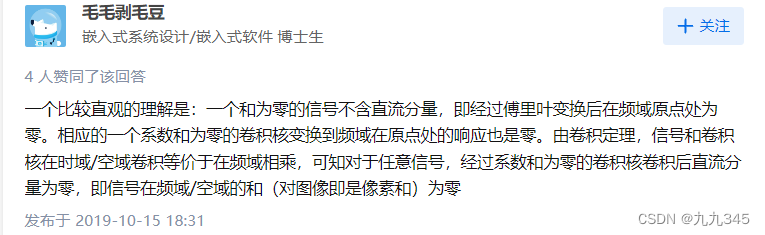

找到了有人跟我有一样的疑问:为什么卷积核的系数和为零,卷积后的图像像素。也为零?有什么好处?

从数学角度,个人认为解释的较为贴切的回答:

如果理解的更浅显、通俗一点,还是拿Sobel算子为例,可以假设中间像素周围的像素值都十分相近(该像素并不在边缘位置),那么得到的梯度值一定是趋近于0的。

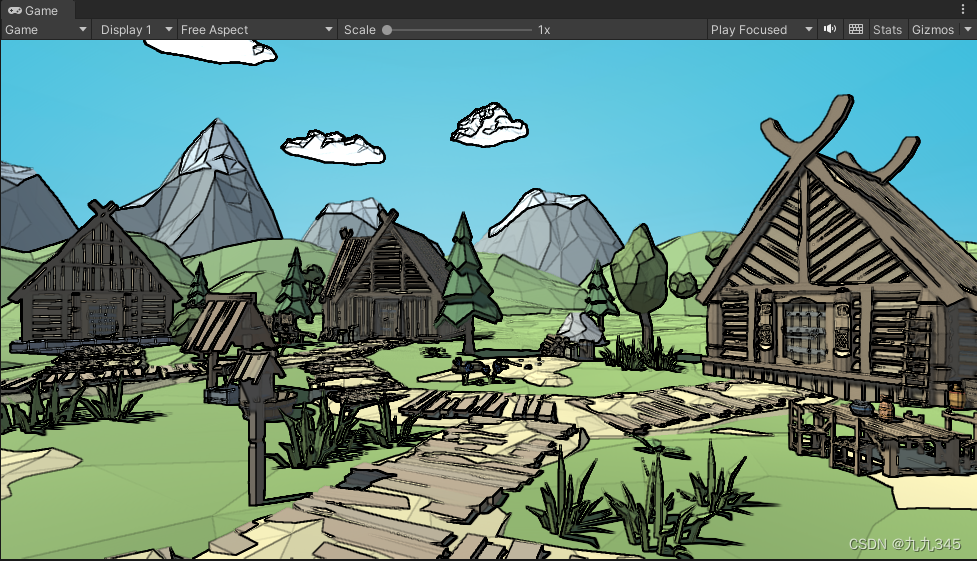

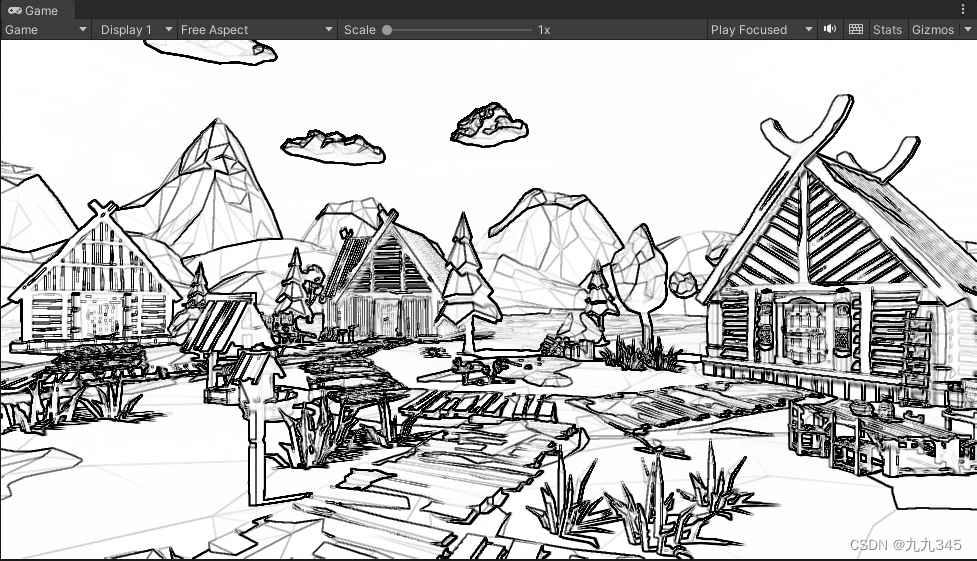

好了,上面一直介绍卷积、边缘检测,这里终于可以进行具体的实现了。与之前实现画面亮度、饱和度和对比度调整的过程类似,实现边缘检测也需要给Main Camera挂上一个特定的脚本,并给它相应的Material和Unity Shader。

using System.Collections;

using System.Collections.Generic;

using UnityEngine;

[ExecuteInEditMode]

public class edgeDetect : MonoBehaviour

{

public Material edgeDetectMaterial;

public Shader edgeDetectShader;

[Range(0.0f, 1.0f)]

public float edgesOnly = 0.0f;

public Color edgeColor = Color.black;

public Color backgroundColor = Color.white;

private void OnRenderImage(RenderTexture source, RenderTexture destination)

{

if(edgeDetectMaterial!=null)

{

edgeDetectMaterial.SetFloat("_EdgeOnly", edgesOnly);

edgeDetectMaterial.SetColor("_EdgeColor", edgeColor);

edgeDetectMaterial.SetColor("_BackgroundColor", backgroundColor);

Graphics.Blit(source, destination, edgeDetectMaterial);

}

else

{

Debug.LogWarning("Please input your Material");

Graphics.Blit(source, destination);

}

}

}

先放上完整代码:

Shader "Unity Shaders Book/Chapter 12/edgeDetectShader"

{

Properties

{

_MainTex ("Texture", 2D) = "white" {}

_EdgeOnly ("EdgeOnly", float) = 1.0

_EdgeColor ("EdgeColor", Color) = (0, 0, 0, 1)

_BackgroudColor ("BackgroundColor", Color) = (1, 1, 1, 1)

}

SubShader

{

Pass

{

ZTest Always Cull Off ZWrite Off

CGPROGRAM

#pragma vertex vert

#pragma fragment fragSobel

#include "UnityCG.cginc"

//properties

sampler2D _MainTex;

half4 _MainTex_TexelSize;

fixed _EdgeOnly;

fixed4 _EdgeColor;

fixed4 _BackgroudColor;

struct v2f {

float4 pos : SV_POSITION;

half2 uv[9] : TEXCOORD0;

};

v2f vert(appdata_img v) {

v2f o;

o.pos = UnityObjectToClipPos(v.vertex);

half2 uv = v.texcoord;

o.uv[0] = uv + _MainTex_TexelSize.xy * half2(-1, -1);

o.uv[1] = uv + _MainTex_TexelSize.xy * half2(0, -1);

o.uv[2] = uv + _MainTex_TexelSize.xy * half2(1, -1);

o.uv[3] = uv + _MainTex_TexelSize.xy * half2(-1, 0);

o.uv[4] = uv + _MainTex_TexelSize.xy * half2(0, 0);

o.uv[5] = uv + _MainTex_TexelSize.xy * half2(1, 0);

o.uv[6] = uv + _MainTex_TexelSize.xy * half2(-1, 1);

o.uv[7] = uv + _MainTex_TexelSize.xy * half2(0, 1);

o.uv[8] = uv + _MainTex_TexelSize.xy * half2(1, 1);

return o;

}

fixed luminance(fixed4 color) {

return 0.2125 * color.r + 0.7154 * color.g + 0.0721 * color.b;

}

//自定义一个Sobel算子

half Sobel(v2f i) {

//定义卷积核:

const half Gx[9] =

{

-1, 0, 1,

-2, 0, 2,

-1, 0, 1

};

const half Gy[9] =

{

-1, -2, -1,

0, 0, 0,

1, 2, 1

};

half texColor;

half edgeX = 0;

half edgeY = 0;

for(int j=0;j<9;j++) {

texColor = luminance(tex2D(_MainTex, i.uv[j])); //依次对9个像素采样,计算明度值

edgeX += texColor * Gx[j];

edgeY += texColor * Gy[j];

}

half edge = 1 - abs(edgeX) - abs(edgeY); //绝对值代替开根号求模,节省开销

//half edge = 1 - pow(edgeX*edgeX + edgeY*edgeY, 0.5);

return edge;

}

fixed4 fragSobel(v2f i) : SV_Target {

half edge = Sobel(i);

fixed4 withEdgeColor = lerp(_EdgeColor, tex2D(_MainTex, i.uv[4]), edge); //4是原始像素位置

fixed4 onlyEdgeColor = lerp(_EdgeColor, _BackgroudColor, edge);

return lerp(withEdgeColor, onlyEdgeColor, _EdgeOnly);

}

ENDCG

}

}

FallBack Off

}

接下来挑我认为的重点细说一下。

代码中依次计算9个方格覆盖的像素(包括当前中心像素)的明度值,分别与自己x和y方向的权重值相乘,叠加后,得到最终中心像素Gx和Gy的梯度值,接着计算edge值(绝对值代替了开根号,为了节省开销),edge越小(梯度越大),越有可能是边缘点。

fixed4 withEdgeColor = lerp(_EdgeColor, tex2D(_MainTex, i.uv[4]), edge); //4是原始像素位置

fixed4 onlyEdgeColor = lerp(_EdgeColor, _BackgroudColor, edge);

return lerp(withEdgeColor, onlyEdgeColor, _EdgeOnly);我认为给一个edge值是为了实现用户通过调整_EdgeOnly的值控制边缘呈现样式的目的,我们知道:

从结果的lerp角度说:

通过结果图我们可以发现,通过Sobel算子进行的边缘检测操作,实现的描边效果其实不是很好,因为他把一些纹理、阴影等边界也给包括进去了。为了实现更好的描边效果,后面的博客将会介绍进阶版的结合深度和法线纹理的边缘检测实现描边效果的方案。

Rackup通过Rack的默认处理程序成功运行任何Rack应用程序。例如:classRackAppdefcall(environment)['200',{'Content-Type'=>'text/html'},["Helloworld"]]endendrunRackApp.new但是当最后一行更改为使用Rack的内置CGI处理程序时,rackup给出“NoMethodErrorat/undefinedmethod`call'fornil:NilClass”:Rack::Handler::CGI.runRackApp.newRack的其他内置处理程序也提出了同样的反对意见。例如Rack

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

按照目前的情况,这个问题不适合我们的问答形式。我们希望答案得到事实、引用或专业知识的支持,但这个问题可能会引发辩论、争论、投票或扩展讨论。如果您觉得这个问题可以改进并可能重新打开,visitthehelpcenter指导。关闭10年前。问题1)我想知道rubyonrails是否有功能类似于primefaces的gem。我问的原因是如果您使用primefaces(http://www.primefaces.org/showcase-labs/ui/home.jsf),开发人员无需担心javascript或jquery的东西。据我所知,JSF是一个规范,基于规范的各种可用实现,prim

相信很多人在录制视频的时候都会遇到各种各样的问题,比如录制的视频没有声音。屏幕录制为什么没声音?今天小编就和大家分享一下如何录制音画同步视频的具体操作方法。如果你有录制的视频没有声音,你可以试试这个方法。 一、检查是否打开电脑系统声音相信很多小伙伴在录制视频后会发现录制的视频没有声音,屏幕录制为什么没声音?如果当时没有打开音频录制,则录制好的视频是没有声音的。因此,建议在录制前进行检查。屏幕上没有声音,很可能是因为你的电脑系统的声音被禁止了。您只需打开电脑系统的声音,即可录制音频和图画同步视频。操作方法:步骤1:点击电脑屏幕右下侧的“小喇叭”图案,在上方的选项中,选择“声音”。 步骤2:在“声

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复

在ruby中,你可以这样做:classThingpublicdeff1puts"f1"endprivatedeff2puts"f2"endpublicdeff3puts"f3"endprivatedeff4puts"f4"endend现在f1和f3是公共(public)的,f2和f4是私有(private)的。内部发生了什么,允许您调用一个类方法,然后更改方法定义?我怎样才能实现相同的功能(表面上是创建我自己的java之类的注释)例如...classThingfundeff1puts"hey"endnotfundeff2puts"hey"endendfun和notfun将更改以下函数定