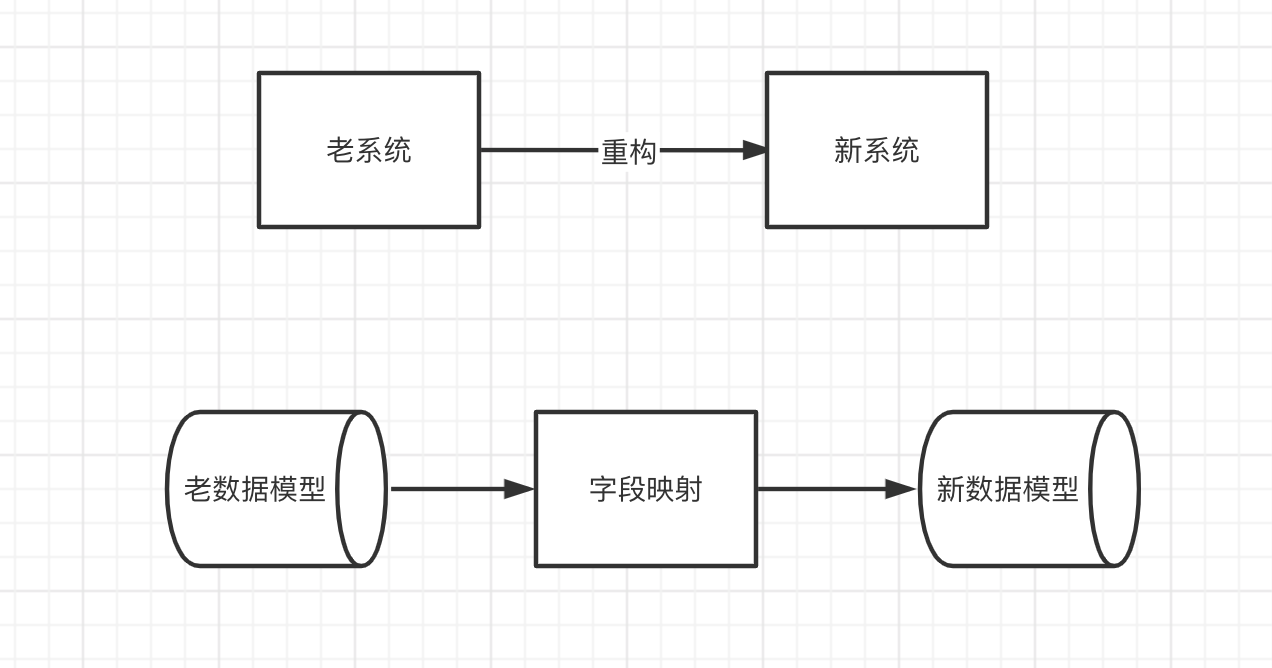

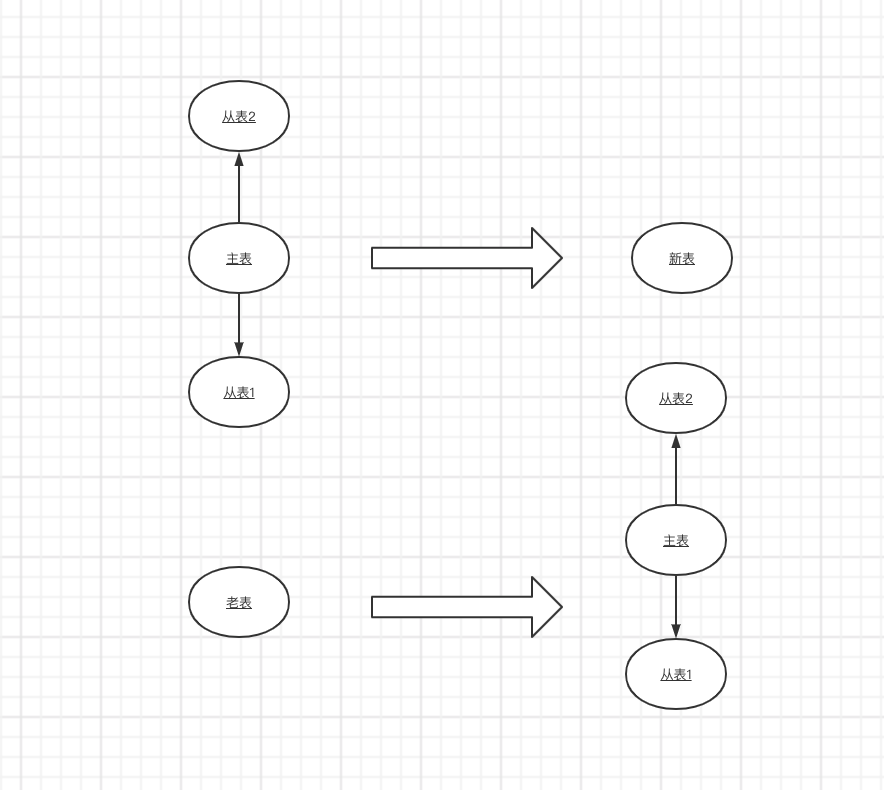

随着业务发展,我们的系统可能面临着改造升级。改造过程中往往避免不了数据模型的变动,这时候需要将老表老模型迁移到新表新模型,并且还要保证历史数据的迁移以及映射。

这就带来了一个问题,老表老模型如何迁移到新表新模型,以下是常用的两种方案

| 方案 | 是否支持回切 | 优点 | 缺点 |

|---|---|---|---|

| 双写 | 是 | 1.简单易操作2.无需中间件支持3.无延迟 | 1.对业务侵入大,需要在新老系统维护对应的数据同步逻辑 |

| 监听binlog,数据双向同步 | 是 | 1.对业务0侵入2.方便定制化逻辑 | 1.需要中间件支持2.具有一定延迟性 |

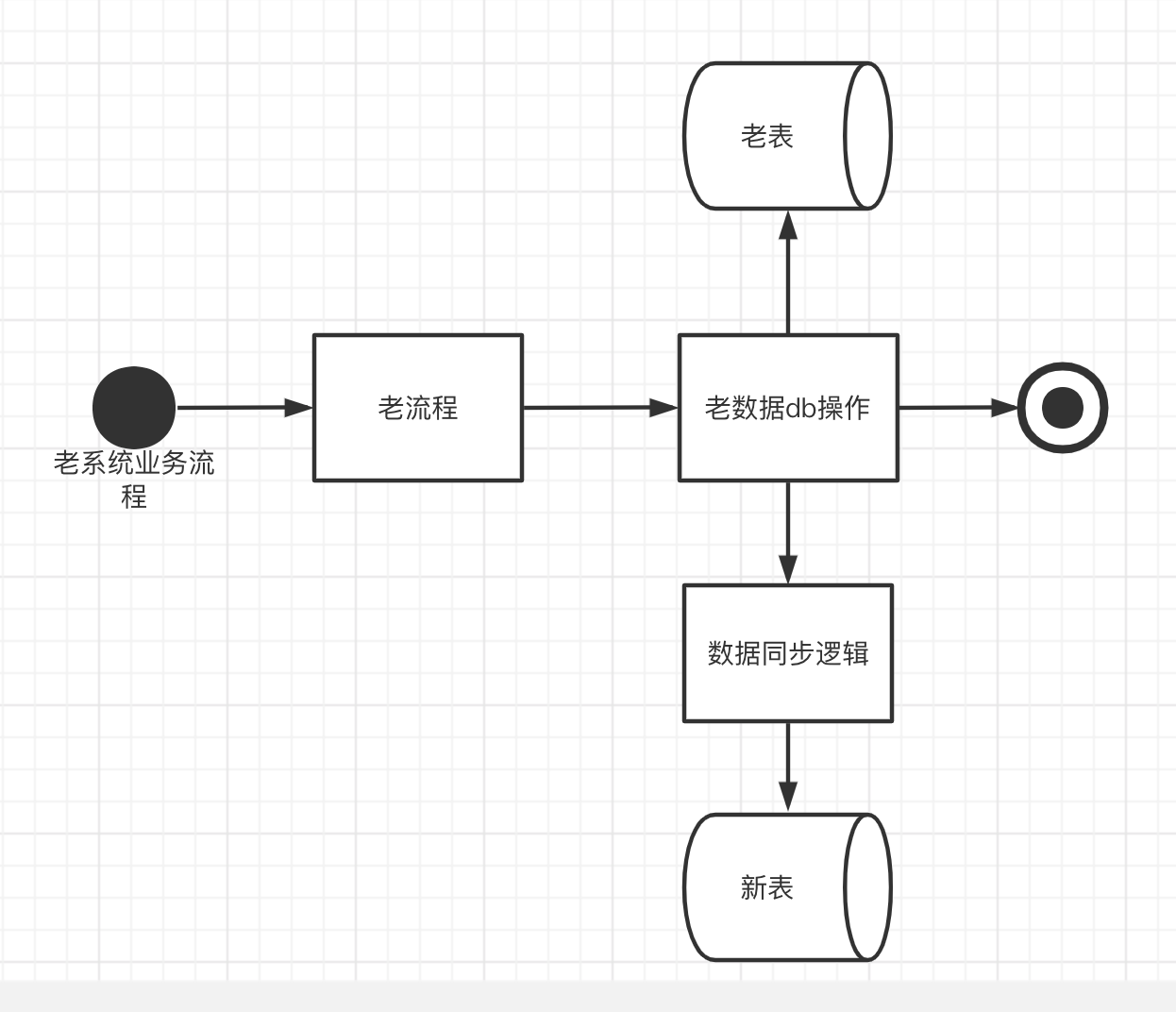

数据同步很少有只同步单向的。除非是数据库的压力大了要将表拆分出,这时候存在表模型一样的情况。更常见的是在灰度阶段,新老系统同时都在运行,这时候就需要同时维护新老数据,因此需要采取双向同步的策略。

数据同步又分为增量数据同步、存量数据同步。一般来说我们会在老系统中所有更新表的地方将数据同步逻辑开发好,先上线,同步几天存量数据,然后选择某上线后的一天作为存量数据的截止时间,这是为了防止存量数据和增量数据中间有数据空洞,造成数据丢失的情况

同步增量数据有几个步骤

存量数据一般就是取数,取数有两种比较常见的方式

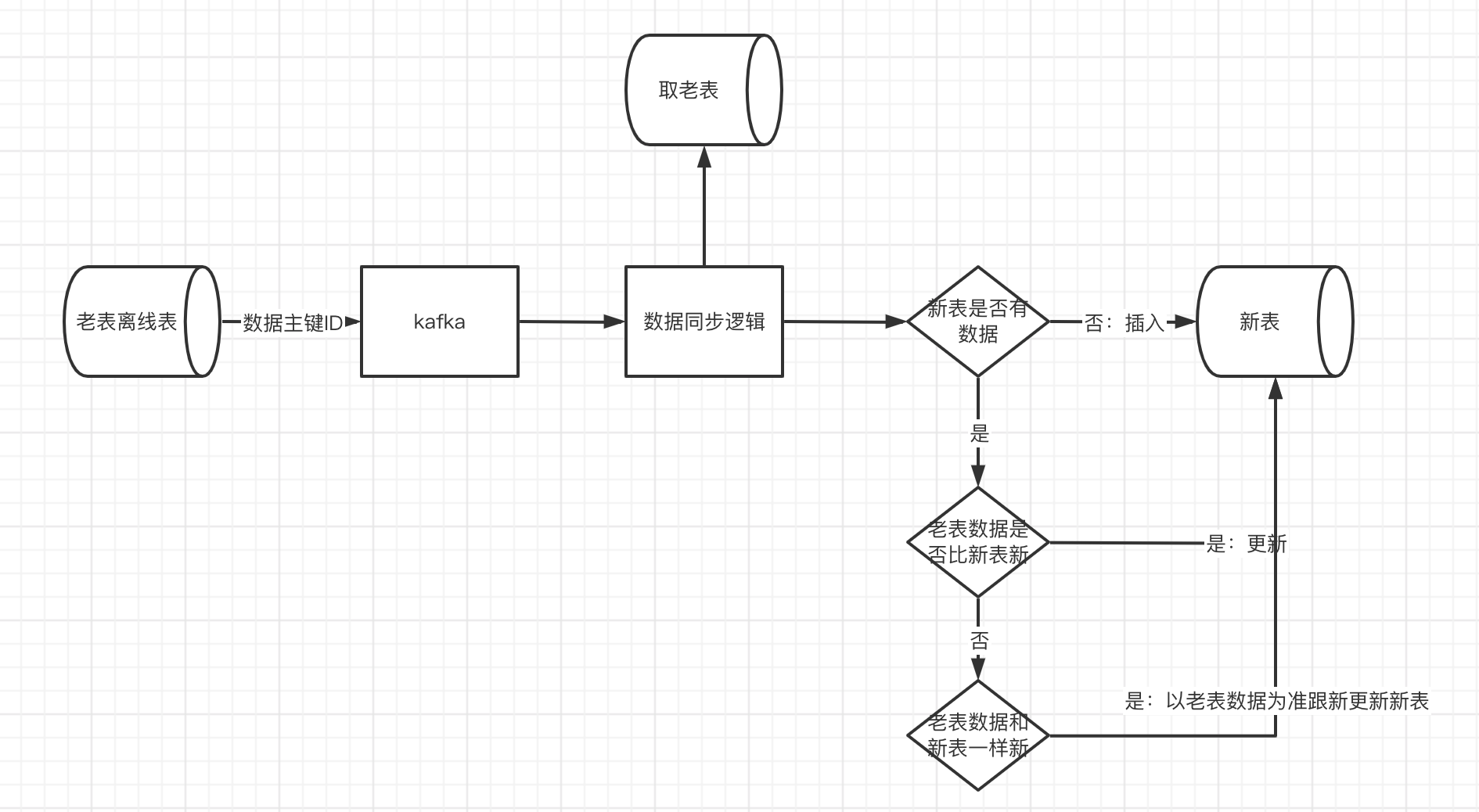

存量数据同步的时候也需要注意的是数据的版本问题,如果不存在就新增,如果存在就判断时间戳或版本号,总之就是将最新的数据更新进去,老版本数据抛弃。

从上面我们可以看出双向同步的问题就是同步代码的复用性差,业务代码内部维护的增量逻辑和存量同步的逻辑不能复用,需要重复开发。还有一个问题就是当新老模型差距较大或者新数据源的变动比较大的时候,比如从一种存储介质同步到另一种存储介质,这些复杂逻辑维护到了每个更新接口处,开发成本不可预估,因此此方案只适合公司没有中间件支持并且又要做改造的情况下使用。

ps:如果存量数据有时效性,比如一个月以前的数据不要了,并且改造的周期比较长,那么可以不需要同步存量数据,让增量数据跑一个月即可。

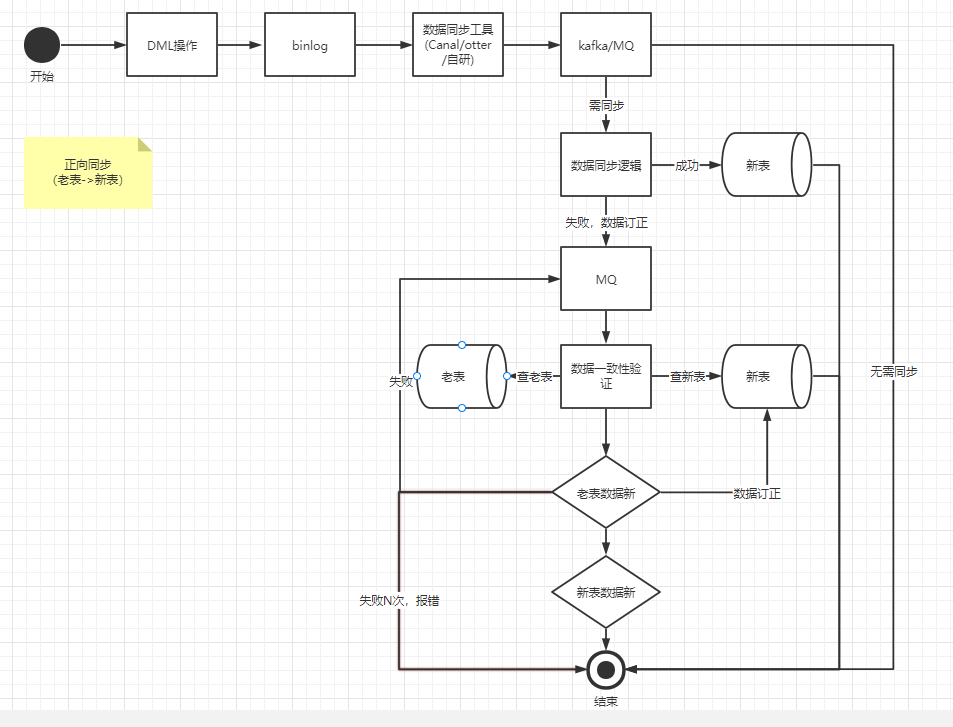

我们都知道当数据变更的时候(新增、更新、删除),db 都会记录变更日志,并且同步到各个从库中,这个日志就是我们耳闻能详的 binlog。开源的工具主要有:Canal、otter等,基本原理就是解析binlog日志,然后发送到消息中间件,客户端消费后进行处理。

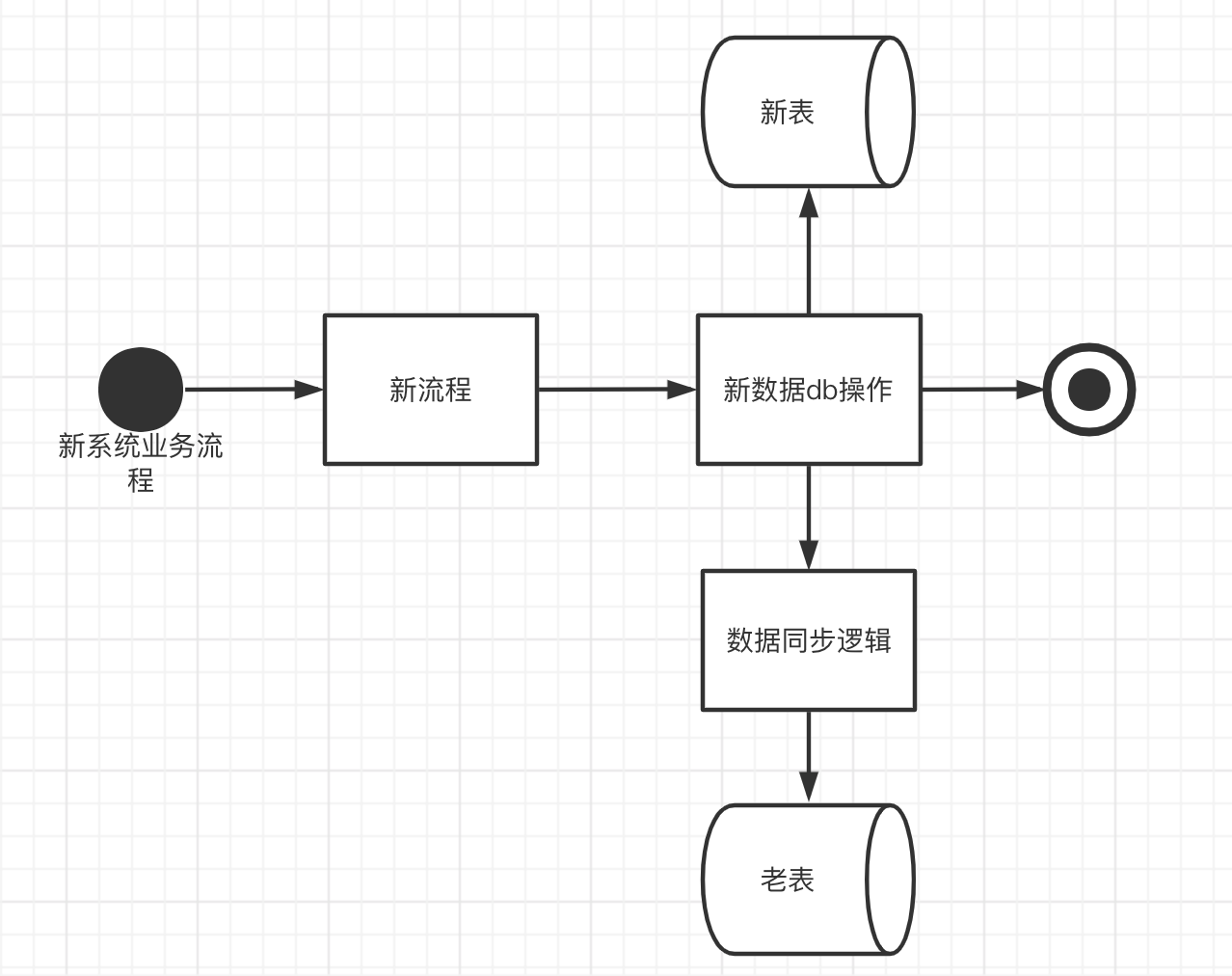

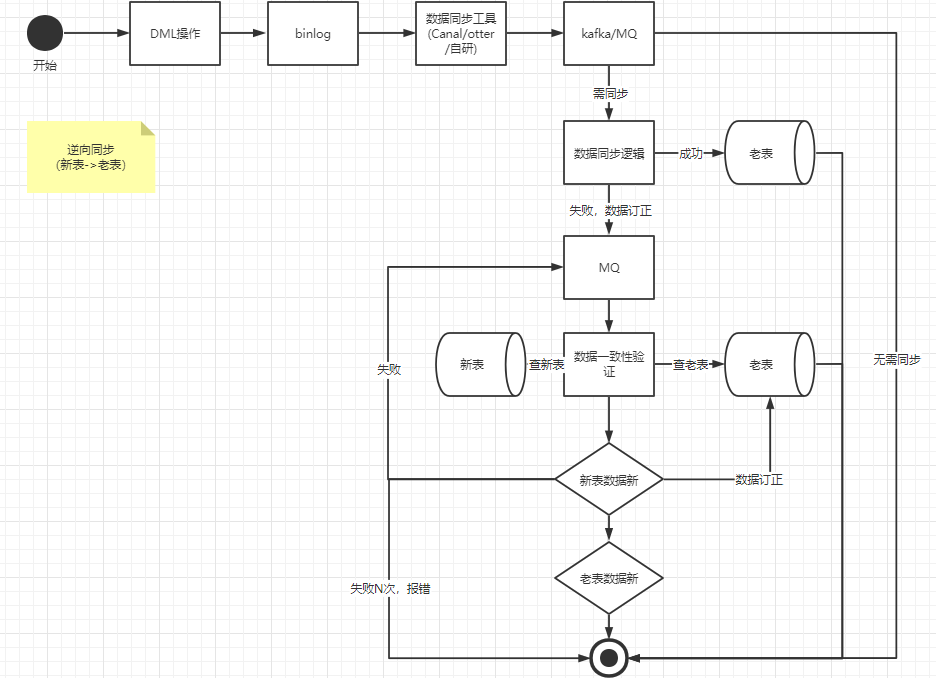

由于我们是线上新老系统一起在跑,因此我们需要进行数据双向同步,也就是正向同步:老表到新表;逆向同步:新表到老表。

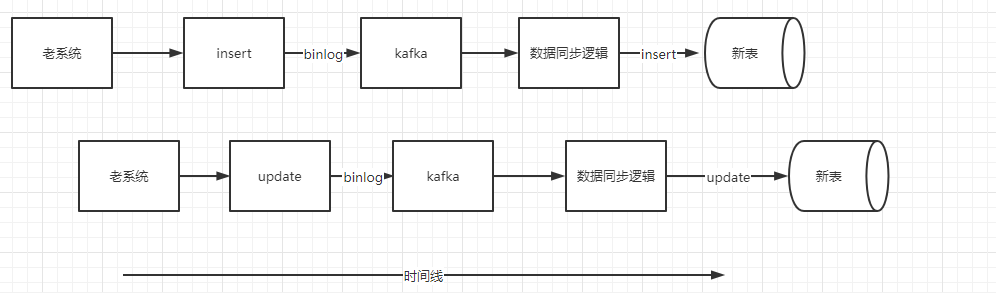

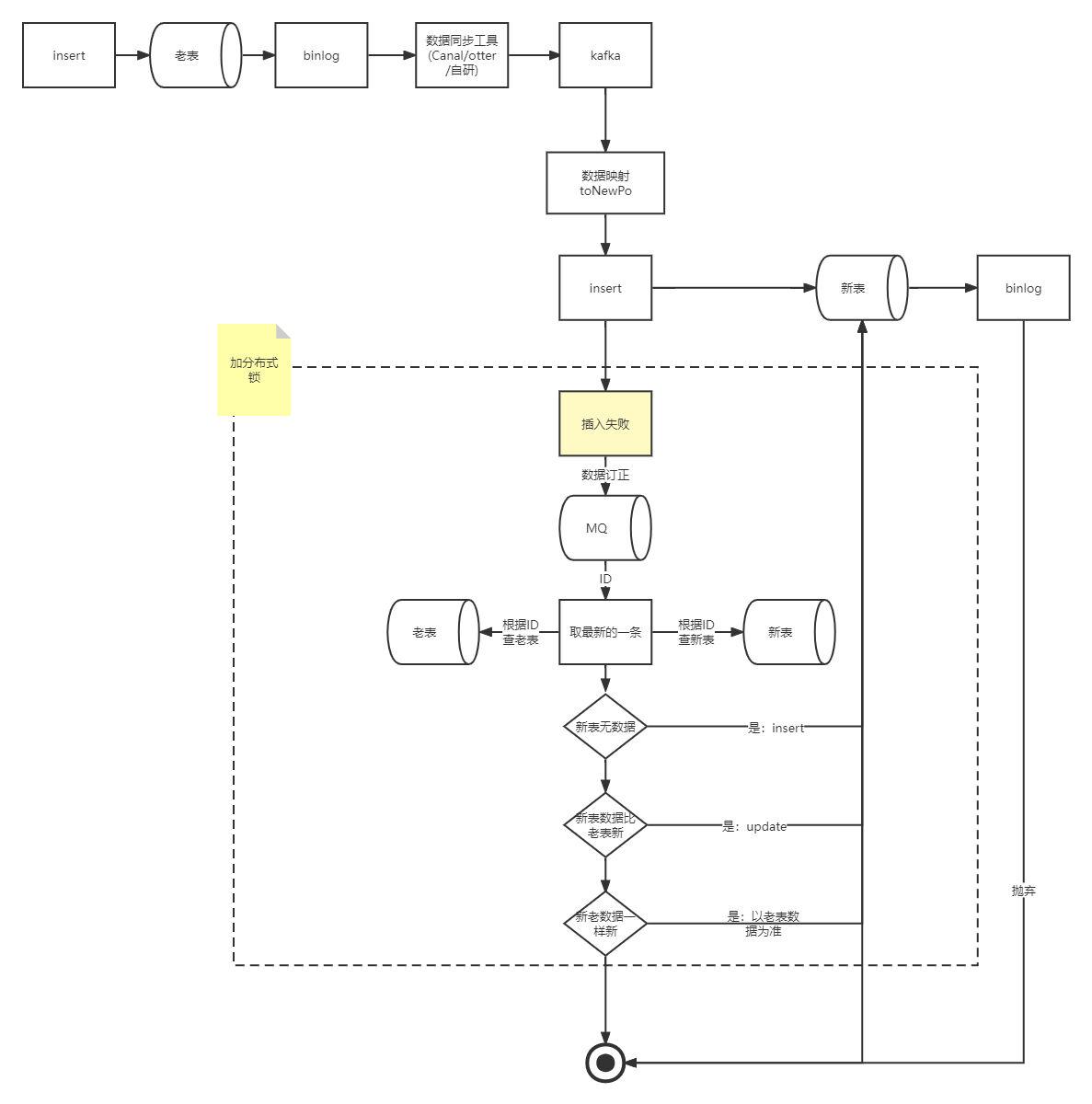

当老系统进行DML(insert、update,由于大部分业务都是采用逻辑删的情况也就是update,因此这里不考虑delete情况)操作的时候,老表会吐出相应的binlog,binlog 经过我们的数据同步工具会将对应的消息投递到kafka或者mq,在我们的 convert 数据同步逻辑内将对应的消息映射成新数据模型后,会将消息是 insert 还是 update 进行不同处理

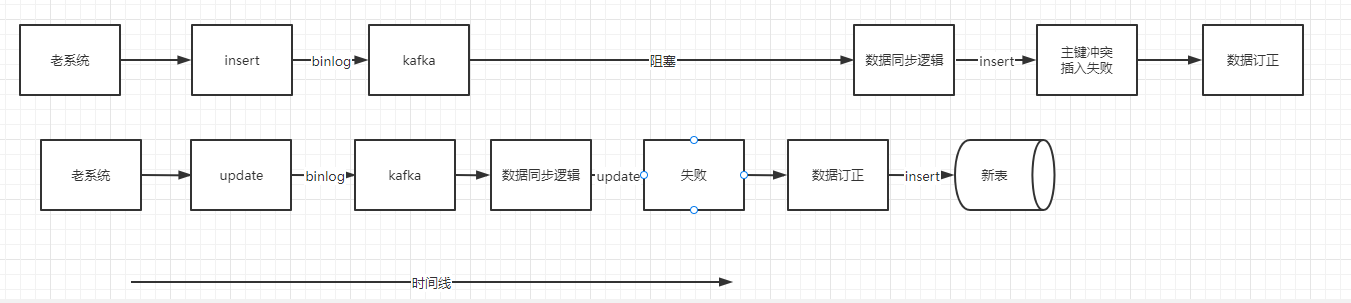

经过 convert 将消息转化成对应的新数据模型后,直接进行插入操作。这里可能会出现一些异常场景,比较常见的是 insert 操作还没插入新表,老系统就对该记录操作了一次更新,然后也吐出了一条 binlog,这时候这条 binlog 先被客户端消费,由于更新的时候如果新表内没有数据,会更新失败,更新失败后会走数据订正逻辑,数据订正的时候如果新表没有数据则会新增。这时候再操作 insert 操作就会报主键冲突。新增失败的时候也会走数据订正逻辑。

这里可能有个疑问,直接在消费到的时候根据数据的主键ID加一把分布式锁能不能解决问题。答案是不能解决,因为更新操作可能会更先被消费到,这时候还是会报主键重复,并且如果数据量大的情况下,加锁还会导致数据同步性能问题。

正常流程:

异常流程:

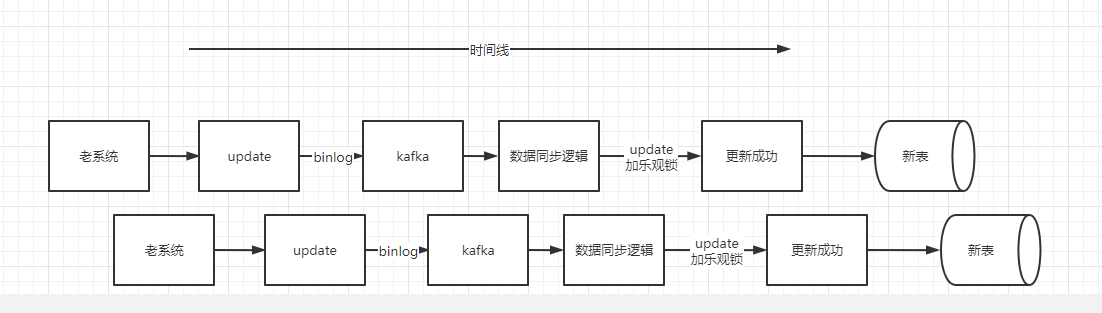

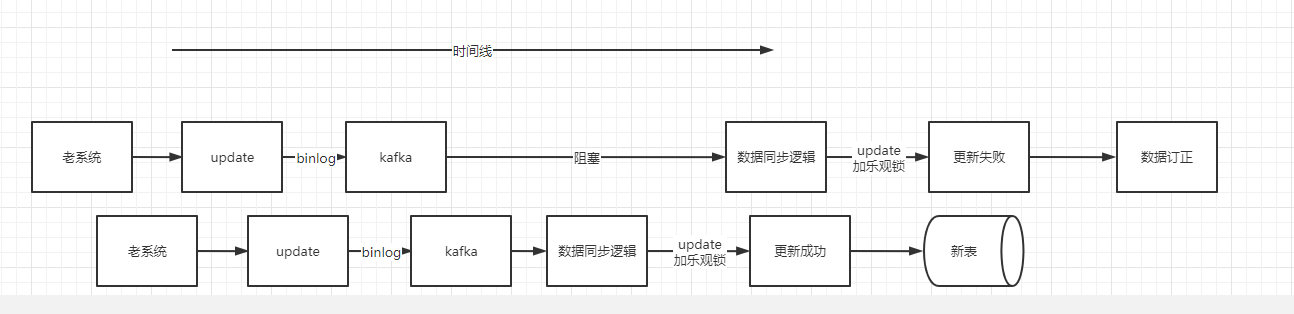

客户端收到 update 的binlog消息后,会将消息体内容经过 convert 逻辑转化成新模型,也就是数据库PO对象,然后进行 update 操作。但是不是无脑更新的,需要加个乐观锁(where update_time < #{updateTime}),如果表里数据已经比你新了,那么就不更新,更新失败,走数据订正逻辑。如果表里数据比较老,那么更新成功。

正常流程:

异常流程:

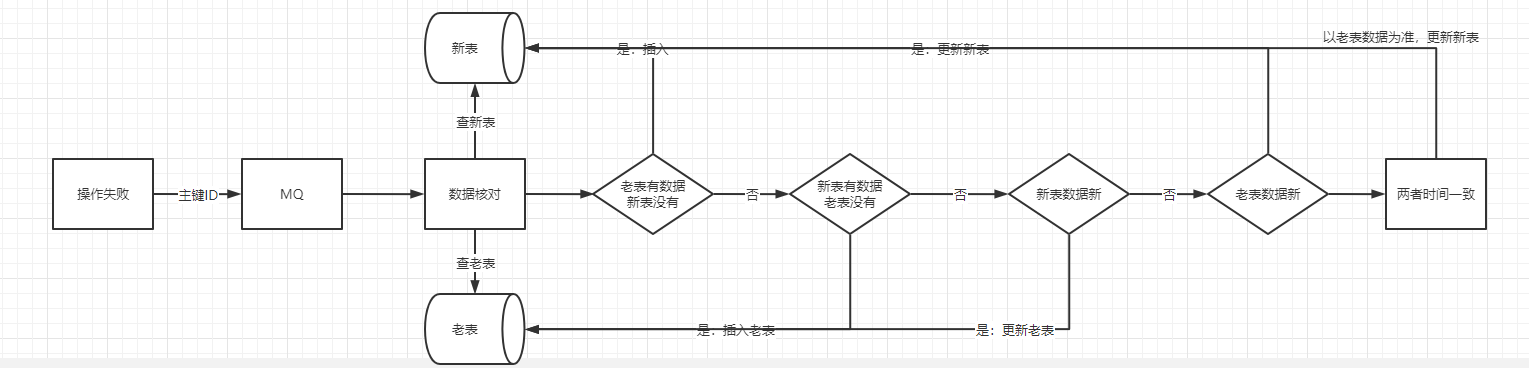

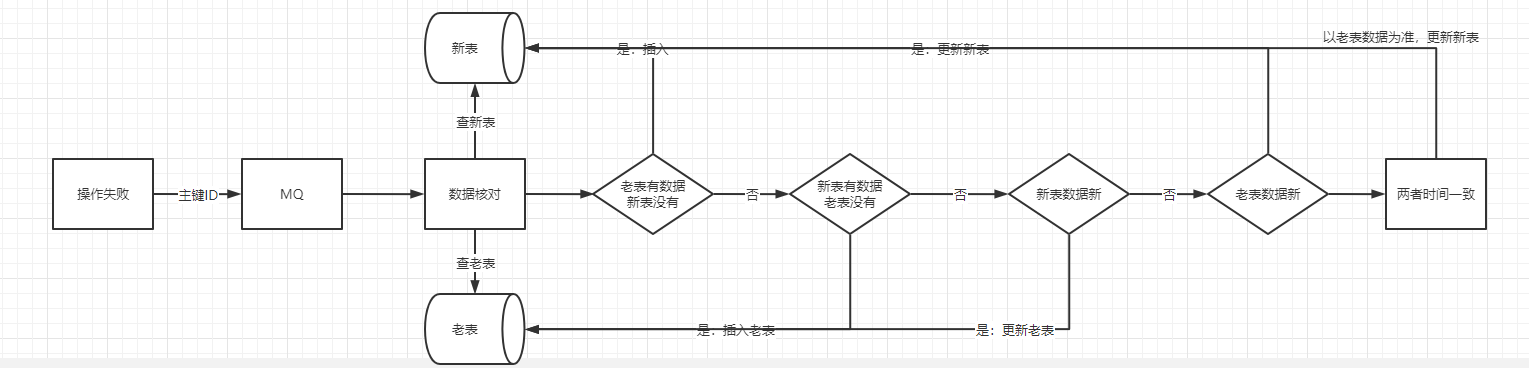

不管是 insert 操作还是 update 操作,当操作失败了以后,我们都要进行数据订正,这是为了保证最终数据一致性。

数据订正的整个过程都需要根据主键ID来进行加分布式锁,这是因为数据订正的时候是拿主键ID去新老表查数据,然后进行比对后才决定如何进行订正,这里如果不加锁的话会导致并发问题,从而订正失败。由于绝大多数的数据都是在同步流程中同步完毕,走入到数据订正的数据其实是少部分的,因此在这里加分布式锁其实是没太大影响的。

ps:新老表的主键ID要保持一致。

新表到老表也是一样的操作,无非就是双方角色互换下。新系统DML操作后,同步到老表,具体的同步逻辑还是一样的。

我们都注意到,当老表同步到新表,新表同步完成后,新表也会吐出相应的 binlog,这时候客户端监听后如果按照上面的流程走下去,那么会陷入一个死循环,无限消费,那么客户端怎么监听这部分数据并且抛弃掉呢。

我们可以在新老表加个flag字段,所有业务dml操作将该字段置为1,那么数据同步客户端监听到binlog消息就进行数据同步。如果是数据同步的dml操作,将该字段置为0,那么数据同步客户端监听到binlog消息就直接抛弃掉即可。

为了降低数据库压力,我们取存量数据是取的离线表,离线表具有延迟性,离线表存储的一半是t-1天的数据。为了防止丢数据,我们会先将老到新的增量同步逻辑先上线一两天,然后再从离线表取数,这样所有的数据都不会丢。假如我们先同步存量数据,再同步增量数据,或者增量数据同步逻辑一上线立马同步存量数据,那么t-1到t这中间就会有1天的数据缺口。

存量同步如果insert失败或者update失败和增量同步的逻辑一样,都会走数据订正逻辑,保证数据的最终一致性。

采用binlog同步的优点就是针对所有的dml操作集中处理,解耦业务、可发挥空间大;缺点就是需要中间件支持,并且具有一定的延迟性。

当我们老系统多张表,融合到新系统只有一张表;或者老系统一张表,拆到新系统多张表;那么这种场景就很适合用这种方式来同步,只需要在数据同步逻辑根据关联的字段查出对应的信息进行insert或者update即可。

同步的一定要做好监控!

如何正确创建Rails迁移,以便将表更改为MySQL中的MyISAM?目前是InnoDB。运行原始执行语句会更改表,但它不会更新db/schema.rb,因此当在测试环境中重新创建表时,它会返回到InnoDB并且我的全文搜索失败。我如何着手更改/添加迁移,以便将现有表修改为MyISAM并更新schema.rb,以便我的数据库和相应的测试数据库得到相应更新? 最佳答案 我没有找到执行此操作的好方法。您可以像有人建议的那样更改您的schema.rb,然后运行:rakedb:schema:load,但是,这将覆盖您的数据。我的做法是(假设

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

使用带有Rails插件的vim,您可以创建一个迁移文件,然后一次性打开该文件吗?textmate也可以这样吗? 最佳答案 你可以使用rails.vim然后做类似的事情::Rgeneratemigratonadd_foo_to_bar插件将打开迁移生成的文件,这正是您想要的。我不能代表textmate。 关于ruby-使用VimRails,您可以创建一个新的迁移文件并一次性打开它吗?,我们在StackOverflow上找到一个类似的问题: https://sta

有时我需要处理键/值数据。我不喜欢使用数组,因为它们在大小上没有限制(很容易不小心添加超过2个项目,而且您最终需要稍后验证大小)。此外,0和1的索引变成了魔数(MagicNumber),并且在传达含义方面做得很差(“当我说0时,我的意思是head...”)。散列也不合适,因为可能会不小心添加额外的条目。我写了下面的类来解决这个问题:classPairattr_accessor:head,:taildefinitialize(h,t)@head,@tail=h,tendend它工作得很好并且解决了问题,但我很想知道:Ruby标准库是否已经带有这样一个类? 最佳

我正在尝试使用Curbgem执行以下POST以解析云curl-XPOST\-H"X-Parse-Application-Id:PARSE_APP_ID"\-H"X-Parse-REST-API-Key:PARSE_API_KEY"\-H"Content-Type:image/jpeg"\--data-binary'@myPicture.jpg'\https://api.parse.com/1/files/pic.jpg用这个:curl=Curl::Easy.new("https://api.parse.com/1/files/lion.jpg")curl.multipart_form_

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

电脑0x0000001A蓝屏错误怎么U盘重装系统教学分享。有用户电脑开机之后遇到了系统蓝屏的情况。系统蓝屏问题很多时候都是系统bug,只有通过重装系统来进行解决。那么蓝屏问题如何通过U盘重装新系统来解决呢?来看看以下的详细操作方法教学吧。 准备工作: 1、U盘一个(尽量使用8G以上的U盘)。 2、一台正常联网可使用的电脑。 3、ghost或ISO系统镜像文件(Win10系统下载_Win10专业版_windows10正式版下载-系统之家)。 4、在本页面下载U盘启动盘制作工具:系统之家U盘启动工具。 U盘启动盘制作步骤: 注意:制作期间,U盘会被格式化,因此U盘中的重要文件请注

在应用开发中,有时候我们需要获取系统的设备信息,用于数据上报和行为分析。那在鸿蒙系统中,我们应该怎么去获取设备的系统信息呢,比如说获取手机的系统版本号、手机的制造商、手机型号等数据。1、获取方式这里分为两种情况,一种是设备信息的获取,一种是系统信息的获取。1.1、获取设备信息获取设备信息,鸿蒙的SDK包为我们提供了DeviceInfo类,通过该类的一些静态方法,可以获取设备信息,DeviceInfo类的包路径为:ohos.system.DeviceInfo.具体的方法如下:ModifierandTypeMethodDescriptionstatic StringgetAbiList()Obt

本教程将在Unity3D中混合Optitrack与数据手套的数据流,在人体运动的基础上,添加双手手指部分的运动。双手手背的角度仍由Optitrack提供,数据手套提供双手手指的角度。 01 客户端软件分别安装MotiveBody与MotionVenus并校准人体与数据手套。MotiveBodyMotionVenus数据手套使用、校准流程参照:https://gitee.com/foheart_1/foheart-h1-data-summary.git02 数据转发打开MotiveBody软件的Streaming,开始向Unity3D广播数据;MotionVenus中设置->选项选择Unit

文章目录一、概述简介原理模块二、配置Mysql使用版本环境要求1.操作系统2.mysql要求三、配置canal-server离线下载在线下载上传解压修改配置单机配置集群配置分库分表配置1.修改全局配置2.实例配置垂直分库水平分库3.修改group-instance.xml4.启动监听四、配置canal-adapter1修改启动配置2配置映射文件3启动ES数据同步查询所有订阅同步数据同步开关启动4.验证五、配置canal-admin一、概述简介canal是Alibaba旗下的一款开源项目,Java开发。基于数据库增量日志解析,提供增量数据订阅&消费。Git地址:https://github.co