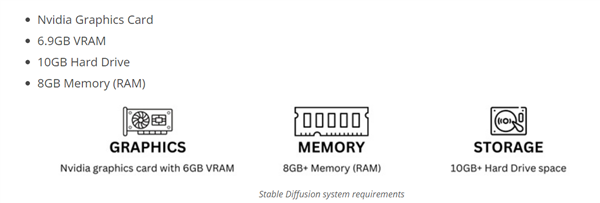

Stable-Diffusion的开源提供方Stability-AI在其官网上列出了硬件要求,内存8GB、本地硬盘空间10GB以上,还有就是NVIDIA显卡,以及6.9GB以上的显存。前面两个要求不算高要求,配置推荐核心总结起来就是N卡+大显存。Stable-Diffusion最低6.9GB显存,实际上坊间存在各种显存优化方法,能够让其在6GB甚至更低的显存上运行,但这些性能优化首先牺牲的就是性能,会让用户以难以忍受的龟速在较低的显存上生成绘画。因此为了保证AI画图流畅度和稳定性,玩家最好有一块8GB及以上显存的N卡。因为显存是AI画图的基石,特别是如果用户希望像现在风靡的Lora插件一样训练自己的自定义AI绘画模型,对显存的需求则会进一步提升,16GB甚至更高的显存才能保证流畅的训练自己的AI绘画模型。特别是RTX系列的,因为从RTX系列开始NVIDIA在显卡中加入了RTX Tensor Core,Tensor Core就是专为像Stable Diffusion这样的深度学习模型打造,能够以混合精度让深度学习模型在CUDA环境下得到极大的加速。N卡AI加速已发展四代:生态成熟 拿来即用这也是为何像Stable-Diffusion这样的AI应用绝大多数要求N卡的原因,NVIDIA前几年在显卡中加入AI功能还不被人理解,如今不得不承认老黄眼光太强了。N卡的AI核心被称为Tensor Core,RTX 40系列显卡上现在已经发展到了第四代,核心功能跟高性能计算中的H100 Tensor Core相同,,相比RTX 30系列性能飞跃提升。由于发展得更早,性能又强大,N卡的AI生态是当前显卡中最完善且最具稳定性的,绘图用户很自然选择N卡平台适配,所以稳定性和成熟度很到位,用N卡来训练AI画图,软件安装即可用。其他家的显卡虽然也可以通过更繁复的方法支持Stable-Diffusion这样的应用,但是安装麻烦,需要用户有一定的编程和编译基础才能跑起来,而且在AI绘图工作流兼容性上很容易出错,绘图圈共识:简单稳定快速出图还得看N卡。利用好网上的整合包及教程,N卡用户可能不到1小时就可以自己训练AI生成漂亮的图片了,想怎么玩就怎么玩。不止是画图 显卡AI还开辟了新领域:VSR视频增强正式上线N卡的AI不止是可以用于画图,还可以用于视频,这就是NVIDIA的又一个新技术了,“Video Super Resolution”,也就是视频超分辨率,简称VSR。游戏玩家都知道N卡的DLSS技术,它就是AI在提升游戏性能上的一个具体例子。VSR可以看作是视频版的DLSS,这是一种AI图像放大处理技术,技术基于AI人工智能、RTX Tensor张量核心硬件单元,智能锐化和强化特征和边缘,同时消除恼人的压缩伪影。它不仅可以提升视频的画质,还可以提升视频分辨率,视频源支持360p到1440p,最高可以获得4K级别的享受。

Stable-Diffusion的开源提供方Stability-AI在其官网上列出了硬件要求,内存8GB、本地硬盘空间10GB以上,还有就是NVIDIA显卡,以及6.9GB以上的显存。前面两个要求不算高要求,配置推荐核心总结起来就是N卡+大显存。Stable-Diffusion最低6.9GB显存,实际上坊间存在各种显存优化方法,能够让其在6GB甚至更低的显存上运行,但这些性能优化首先牺牲的就是性能,会让用户以难以忍受的龟速在较低的显存上生成绘画。因此为了保证AI画图流畅度和稳定性,玩家最好有一块8GB及以上显存的N卡。因为显存是AI画图的基石,特别是如果用户希望像现在风靡的Lora插件一样训练自己的自定义AI绘画模型,对显存的需求则会进一步提升,16GB甚至更高的显存才能保证流畅的训练自己的AI绘画模型。特别是RTX系列的,因为从RTX系列开始NVIDIA在显卡中加入了RTX Tensor Core,Tensor Core就是专为像Stable Diffusion这样的深度学习模型打造,能够以混合精度让深度学习模型在CUDA环境下得到极大的加速。N卡AI加速已发展四代:生态成熟 拿来即用这也是为何像Stable-Diffusion这样的AI应用绝大多数要求N卡的原因,NVIDIA前几年在显卡中加入AI功能还不被人理解,如今不得不承认老黄眼光太强了。N卡的AI核心被称为Tensor Core,RTX 40系列显卡上现在已经发展到了第四代,核心功能跟高性能计算中的H100 Tensor Core相同,,相比RTX 30系列性能飞跃提升。由于发展得更早,性能又强大,N卡的AI生态是当前显卡中最完善且最具稳定性的,绘图用户很自然选择N卡平台适配,所以稳定性和成熟度很到位,用N卡来训练AI画图,软件安装即可用。其他家的显卡虽然也可以通过更繁复的方法支持Stable-Diffusion这样的应用,但是安装麻烦,需要用户有一定的编程和编译基础才能跑起来,而且在AI绘图工作流兼容性上很容易出错,绘图圈共识:简单稳定快速出图还得看N卡。利用好网上的整合包及教程,N卡用户可能不到1小时就可以自己训练AI生成漂亮的图片了,想怎么玩就怎么玩。不止是画图 显卡AI还开辟了新领域:VSR视频增强正式上线N卡的AI不止是可以用于画图,还可以用于视频,这就是NVIDIA的又一个新技术了,“Video Super Resolution”,也就是视频超分辨率,简称VSR。游戏玩家都知道N卡的DLSS技术,它就是AI在提升游戏性能上的一个具体例子。VSR可以看作是视频版的DLSS,这是一种AI图像放大处理技术,技术基于AI人工智能、RTX Tensor张量核心硬件单元,智能锐化和强化特征和边缘,同时消除恼人的压缩伪影。它不仅可以提升视频的画质,还可以提升视频分辨率,视频源支持360p到1440p,最高可以获得4K级别的享受。 网上有很多视频都是很早之前的,比如老电影、老电视,清晰度很低,有了VSR技术,这些低清视频也能秒变4K大片。RTX VSR技术支持RTX 30系列、RTX 40系列显卡,提供多种画质提升选项,越高效果越好,同时对硬件的要求越高,所以选择最新的RTX 40系列显卡效果最好。深受游戏玩家欢迎的DLSS技术在RTX 40系列上也发展到了DLSS 3,由全新第四代Tensor Cores和GeForce RTX 40系列GPU的全新光流加速器驱动,并拥有开创性的光学多帧生成功能,从而带来惊人的性能提升,部分游戏中有3-4倍的性能变化。目前支持DLSS 3的游戏和应用多达50多款,其中28款游戏已经上市,包括《赛博朋克 2077》《巫师3:狂猎》等游戏。如果算上之前的DLSS及DLSS 2,整个DLSS阵营也在不断扩大支持,有超过280款已发布的游戏和应用支持DLSS,为GeForce RTX GPU、台式机和笔记本电脑用户提供更强性能和更佳画质,为支持DLSS的游戏带来最佳体验。总之,如今的显卡不仅在游戏方面大量支持AI技术,而且图形、视频等领域也开始了AI化,NVIDIA GeForce RTX系列显卡由于很早就集成了高性能AI单元Tensor Core,在新兴的AI玩法中占尽上风,Stable-Diffusion、Lora等应用的官方配置推荐都是优选N卡平台的。想要尝鲜Stable-Diffusion,Lora画图的玩家可以下手了,尽量选择最新的RTX 30或RTX 40系列显卡,而且显存别低于8GB,确保AI训练画图可以快速高效稳定完成。

网上有很多视频都是很早之前的,比如老电影、老电视,清晰度很低,有了VSR技术,这些低清视频也能秒变4K大片。RTX VSR技术支持RTX 30系列、RTX 40系列显卡,提供多种画质提升选项,越高效果越好,同时对硬件的要求越高,所以选择最新的RTX 40系列显卡效果最好。深受游戏玩家欢迎的DLSS技术在RTX 40系列上也发展到了DLSS 3,由全新第四代Tensor Cores和GeForce RTX 40系列GPU的全新光流加速器驱动,并拥有开创性的光学多帧生成功能,从而带来惊人的性能提升,部分游戏中有3-4倍的性能变化。目前支持DLSS 3的游戏和应用多达50多款,其中28款游戏已经上市,包括《赛博朋克 2077》《巫师3:狂猎》等游戏。如果算上之前的DLSS及DLSS 2,整个DLSS阵营也在不断扩大支持,有超过280款已发布的游戏和应用支持DLSS,为GeForce RTX GPU、台式机和笔记本电脑用户提供更强性能和更佳画质,为支持DLSS的游戏带来最佳体验。总之,如今的显卡不仅在游戏方面大量支持AI技术,而且图形、视频等领域也开始了AI化,NVIDIA GeForce RTX系列显卡由于很早就集成了高性能AI单元Tensor Core,在新兴的AI玩法中占尽上风,Stable-Diffusion、Lora等应用的官方配置推荐都是优选N卡平台的。想要尝鲜Stable-Diffusion,Lora画图的玩家可以下手了,尽量选择最新的RTX 30或RTX 40系列显卡,而且显存别低于8GB,确保AI训练画图可以快速高效稳定完成。 我目前正在使用带有Carrierwavegem的Rails3.2将文件上传到AmazonS3。现在我需要能够处理用户提交的大于5GB的文件,同时仍然使用Carrierwavegem。Carrierwave或Fog是否有任何其他gem或分支可以处理5GB以上的文件上传到S3?编辑:我不想重写一个完整的Rails上传解决方案,所以像这样的链接没有帮助:https://gist.github.com/908875. 最佳答案 我想出了如何做到这一点,并且现在可以正常工作了。在正确的config/environment文件中,添加以下内容以

文章目录前言1.AI的发展历程2.我是如何接触到人工智能的概念和产品的3.对于ChatGPT的一点看法4.AI对大学毕业生的职业发展的利与弊5.对于AI的思考和问题前言随着ChatGPT的爆火,生成式AI,大模型的人工智能被越来越多的人注意到,同时他也带来了许多问题。本文将对几方面进行探讨。1.AI的发展历程远古时期在公元前第一个千禧年,中国,印度和希腊哲学家都提出了一些推理的研究理论,比如亚里士多德(Aristotle)进行了演绎推理三段论的完整分析,欧几里得(Euclid)所著Elements是一种形式推理的模型,MuḥammadibnMūsāal-Khwārizmī,发明了代数学,即我们

目录1古彝文与古典保护2古文识别的挑战2.1西文与汉文OCR2.2古彝文识别难点3合合信息:古彝文保护新思路3.1图像矫正3.2图像增强3.3语义理解3.4工程技巧4总结1古彝文与古典保护彝文指的是云南、贵州、四川等地的彝族人使用的文字,区别于现代意义上的彝文,古彝文指的是在民间流通使用的原生态彝文,多达87046字。古彝文的起源距今至少数千年,是世界上最古老的文字之一。对古彝文字集研究有助于理解尚未被翻译成汉文、用字尚未规范化的古籍,更深层、透彻地作用于传统文化保护。古彝文字义对照图(网络资料+邵文苑供图)古籍是不可再生的宝贵资源,应当得到妥善保护。中国的古籍在历史上迭经水火兵燹等自然灾害、

您好,我将其视为一个面试问题,并认为这是一个有趣的问题,但我不确定答案。最好的方法是什么? 最佳答案 假设*nix:system("sortoutput_file")“排序”可以使用临时文件来处理大于内存的输入文件。如果需要,它有开关来调整主内存的数量和它将使用的临时文件的数量。如果不是*nix,或者面试官因为斜着回答皱眉,那我就编码一个外部mergesort.请参阅@psyho的回答以获得外部排序算法的良好总结。 关于ruby-使用Ruby作为脚本语言,使用4gbRAM的计算机对30g

我在循环中使用Twitter、Mongo和Parallel来检索和存储数据。内存利用率达到1.5GB+GC怎么不清理这个?更新:Hereisthescriptinquestion.allocatedmemorybylocation-----------------------------------973409328/Users/jordan/.rvm/rubies/ruby-2.1.5/lib/ruby/2.1.0/timeout.rb:82359655091/Users/jordan/.rvm/gems/ruby-2.1.5/gems/json-1.8.3/lib/json/com

作者|Harper审核 |gongyouliu编辑|auroral-L机器学习的商业应用上期给大家介绍了机器学习的概念,但是理解机器学习最好方法之一,就是了解其在具体商业世界中的各种应用。在道格’罗斯的这本《认识AI,人工智能赋能商业》中,介绍了几类机器学习的商业应用,在这里我给大家归纳一下。第一,数据安全,为了避免被发现,制造恶意软件的人会不断更改代码,通常为2%~10%的修改,但是通过机器学习,安全软件可以适应这一小部分变化,并准确识别新创建的恶意软件。它还可以寻找访问方式的模式,以识别可能的安全威胁。第二,投资。机器学习使得计算机能够处理大量的财务数据,并利用其发现的规律预测市场及每只股

ChatGPT提出了"机器学习"这个术语,他开发了一个西洋跳棋程序,可以从错误中吸取教训,经过学习后,甚至比编写程序的人棋力更强

背景我有一个包含数百万行的巨大CSV文件。每行都有一个时间戳,我可以用来对其进行排序。朴素的方法所以,我的第一个方法显然是通过将其放入内存然后排序来读取整个内容。它并没有像您猜想的那么好......朴素方法v2我的第二个尝试是遵循MapReduce背后的想法。所以,我会将这个巨大的文件分成几个部分,然后对每个部分进行排序。然后我会将所有部分合并到最终文件中。这里的问题是B部分可能有一条消息应该在A部分。所以最后,即使每个部分都是有序的,我也不能保证最终文件的顺序....目标我的目标是创建一个函数,当给定这个巨大的无序CSV文件时,可以创建一个具有相同信息的有序CSV文件。问题订购这么大

很难说出这里要问什么。这个问题模棱两可、含糊不清、不完整、过于宽泛或夸夸其谈,无法以目前的形式得到合理的回答。如需帮助澄清此问题以便重新打开,visitthehelpcenter.关闭11年前。在电视上我看到了一些有趣的机器人。这些有一些二极管、太阳能收集器和一些马达。二极管决定光的位置,因此它们将机器人转向为它提供光的方向。它有点跟随光。现在,基于此,我想知道一些简单的AI。有没有办法编写一个可以从用户交互中学习的引擎?作为初学者,只学习和记住用户在页面上的session就足够了。感谢任何帮助。