sqoop功能已经非常完善了,没有什么可以更新的了,官方停止更新维护了。因此官方集成的hadoop包停留在了2.6.0版本,在hadoop3.3.0版本会提示类版本过低错误,但纯净版sqoop有缺少必须的第三方库,所以将这两个包下载下来,提取部分sqoop_hadoop2.6.0版本的jar包放到纯净版sqoop的lib目录下,在sqoop配置文件中加入获取当前环境中的hive及hadoop的lib库来使用.

1:下载sqoop1.4.7的两个版本

http://archive.apache.org/dist/sqoop/1.4.7

sqoop-1.4.7.bin__hadoop-2.6.0.tar.gz # 只用到里面的jar包

sqoop-1.4.7.tar.gz # 上传到服务器

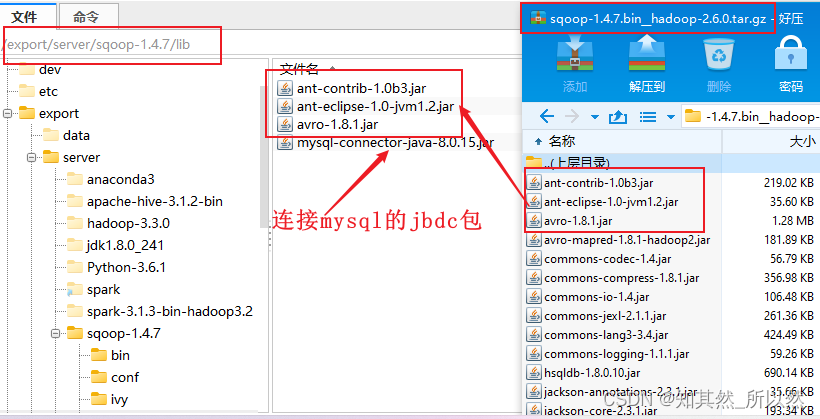

2:提取sqoop-1.4.7.bin__hadoop-2.6.0根目录下的sqoop-1.4.7.jar放到sqoop-1.4.7根目录,正常纯净版sqoop是没有这个jar包的

3:提取lib目录下的这三个必须的jar包放到sqoop-1.4.7/lib/目录下,正常纯净版sqoop的lib目录下是没有文件的。

4:提取出sqoop-1.4.6.jar放在hadoop的lib下

sqoop-1.4.7/conf 目录下的sqoop-env.sh文件追加如下信息

export HADOOP_COMMON_HOME=/export/server/hadoop-3.3.0

export HADOOP_MAPRED_HOME=/export/server/hadoop-3.3.0

export HIVE_HOME=/export/server/apache-hive-3.1.2-bin

export HIVE_CONF_DIR=/export/server/apache-hive-3.1.2-bin/conf

export HADOOP_CLASSPATH=$HADOOP_CLASSPATH:$HIVE_HOME/lib/*在/etc/profile 中添加

export SQOOP_HOME=/export/server/sqoop/

export PATH=$PATH:$SQOOP_HOME/bin:$SQOOP_HOME/bin1:sqoop help 查看帮助文档命令

2:查看数据库中的所有表

sqoop list-tables \

--connect jdbc:mysql://192.168.52.150:3306/hue \

--username root \

--password 123456 3:如何将MySQL中的数据全量的导入到HDFS中(全量)

命令1:

sqoop import \

--connect jdbc:mysql://192.168.50.150:3306/test \

--username root \

--password root \

--table emp

说明:

默认情况下, 会将数据导入到操作sqoop用户的HDFS的家目录下,在此目录下会创建一个以导入表的表名为名称文件夹, 在此文件夹下莫每一条数据会运行一个mapTask, 数据的默认分隔符号为 逗号

思考: 是否更改其默认的位置呢?

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp \

--delete-target-dir \

--target-dir '/sqoop_works/emp_1'

思考: 是否调整map的数量呢?

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp \

--delete-target-dir \

--target-dir '/sqoop_works/emp_2' \

--split-by id \

-m 2

思考: 是否调整默认分隔符号呢? 比如调整为 \001

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp \

--fields-terminated-by '\001' \

--delete-target-dir \

--target-dir '/sqoop_works/emp_3' \

-m 1 4:将MySQL中的数据全量的导入到hive中

以emp_add 表为例

第一步: 在HIVE中创建一个目标表

create database hivesqoop;

use hivesqoop;

create table hivesqoop.emp_add_hive(

id int,

hno string,

street string,

city string

)

row format delimited fields terminated by '\t'

stored as orc ;

第二步: 通过sqoop完成数据导入操作

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp_add \

--hcatalog-database hivesqoop \

--hcatalog-table emp_add_hive \

-m 1 5:如何将MySQL中的数据条件的导入到HDFS中

方式一: 通过 where的方式

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp \

--where 'id > 1205' \

--delete-target-dir \

--target-dir '/sqoop_works/emp_2' \

--split-by id \

-m 2

方式二: 通过SQL的方式

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--query 'select deg from emp where 1=1 AND \$CONDITIONS' \

--delete-target-dir \

--target-dir '/sqoop_works/emp_4' \

--split-by id \

-m 1

注意:

如果SQL语句使用 双引号包裹, $CONDITIONS前面需要将一个\进行转义, 单引号是不需要的6:如何通过条件的方式导入到hive中 (后续模拟增量导入数据)

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp_add \

--where 'id > 1205' \

--hcatalog-database hivesqoop \

--hcatalog-table emp_add_hive \

-m 1

或者:

sqoop import \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--query 'select * from emp_add where id>1205 and $CONDITIONS'

--hcatalog-database hivesqoop \

--hcatalog-table emp_add_hive \

-m 1 需求: 将hive中 emp_add_hive 表数据导出到MySQL中

# 第一步: 在mysql中创建目标表 (必须创建)

create table test.emp_add_mysql(

id INT ,

hno VARCHAR(32) NULL,

street VARCHAR(32) NULL,

city VARCHAR(32) NULL

);

# 第二步: 执行sqoop命令导出数据

sqoop export \

--connect jdbc:mysql://192.168.52.150:3306/test \

--username root \

--password 123456 \

--table emp_add_mysql \

--hcatalog-database hivesqoop \

--hcatalog-table emp_add_hive \

-m 1 | 说明 | |

|---|---|

| --connect | 连接关系型数据库的URL |

| --username | 连接数据库的用户名 |

| --password | 连接数据库的密码 |

| --driver | JDBC的driver class |

| --query或--e <statement> | 将查询结果的数据导入,使用时必须伴随参--target-dir,--hcatalog-table,如果查询中有where条件,则条件后必须加上关键字。如果使用双引号包含,则CONDITIONS前要加上\以完成转义:$CONDITIONS |

| --hcatalog-database | 指定HCatalog表的数据库名称。如果未指定,default则使用默认数据库名称。提供 --hcatalog-database不带选项--hcatalog-table是错误的。 |

| --hcatalog-table | 此选项的参数值为HCatalog表名。该--hcatalog-table选项的存在表示导入或导出作业是使用HCatalog表完成的,并且是HCatalog作业的必需选项。 |

| --create-hcatalog-table | 此选项指定在导入数据时是否应自动创建HCatalog表。表名将与转换为小写的数据库表名相同。 |

| --hcatalog-storage-stanza 'stored as orc tblproperties ("orc.compress"="SNAPPY")' \ | 建表时追加存储格式到建表语句中,tblproperties修改表的属性,这里设置orc的压缩格式为SNAPPY |

| -m | 指定并行处理的MapReduce任务数量。 -m不为1时,需要用split-by指定分片字段进行并行导入,尽量指定int型。 |

| --split-by id | 如果指定-split by, 必须使用$CONDITIONS关键字, 双引号的查询语句还要加\ |

| --hcatalog-partition-keys --hcatalog-partition-values | keys和values必须同时存在,相当于指定静态分区。允许将多个键和值提供为静态分区键。多个选项值之间用,(逗号)分隔。比如: --hcatalog-partition-keys year,month,day --hcatalog-partition-values 1999,12,31 |

| --null-string '\N' --null-non-string '\N' | 指定mysql数据为空值时用什么符号存储,null-string针对string类型的NULL值处理,--null-non-string针对非string类型的NULL值处理 |

| --hive-drop-import-delims | 设置无视字符串中的分割符(hcatalog默认开启) |

| --fields-terminated-by '\t' |

我想为Heroku构建一个Rails3应用程序。他们使用Postgres作为他们的数据库,所以我通过MacPorts安装了postgres9.0。现在我需要一个postgresgem并且共识是出于性能原因你想要pggem。但是我对我得到的错误感到非常困惑当我尝试在rvm下通过geminstall安装pg时。我已经非常明确地指定了所有postgres目录的位置可以找到但仍然无法完成安装:$envARCHFLAGS='-archx86_64'geminstallpg--\--with-pg-config=/opt/local/var/db/postgresql90/defaultdb/po

我打算为ruby脚本创建一个安装程序,但我希望能够确保机器安装了RVM。有没有一种方法可以完全离线安装RVM并且不引人注目(通过不引人注目,就像创建一个可以做所有事情的脚本而不是要求用户向他们的bash_profile或bashrc添加一些东西)我不是要脚本本身,只是一个关于如何走这条路的快速指针(如果可能的话)。我们还研究了这个很有帮助的问题:RVM-isthereawayforsimpleofflineinstall?但有点误导,因为答案只向我们展示了如何离线在RVM中安装ruby。我们需要能够离线安装RVM本身,并查看脚本https://raw.github.com/wayn

我有一个奇怪的问题:我在rvm上安装了rubyonrails。一切正常,我可以创建项目。但是在我输入“railsnew”时重新启动后,我有“程序'rails'当前未安装。”。SystemUbuntu12.04ruby-v"1.9.3p194"gemlistactionmailer(3.2.5)actionpack(3.2.5)activemodel(3.2.5)activerecord(3.2.5)activeresource(3.2.5)activesupport(3.2.5)arel(3.0.2)builder(3.0.0)bundler(1.1.4)coffee-rails(

我刚刚为fedora安装了emacs。我想用emacs编写ruby。为ruby提供代码提示、代码完成类型功能所需的工具、扩展是什么? 最佳答案 ruby-mode已经包含在Emacs23之后的版本中。不过,它也可以通过ELPA获得。您可能感兴趣的其他一些事情是集成RVM、feature-mode(Cucumber)、rspec-mode、ruby-electric、inf-ruby、rinari(用于Rails)等。这是我当前用于Ruby开发的Emacs配置:https://github.com/citizen428/emacs

我正在尝试在我的centos服务器上安装therubyracer,但遇到了麻烦。$geminstalltherubyracerBuildingnativeextensions.Thiscouldtakeawhile...ERROR:Errorinstallingtherubyracer:ERROR:Failedtobuildgemnativeextension./usr/local/rvm/rubies/ruby-1.9.3-p125/bin/rubyextconf.rbcheckingformain()in-lpthread...yescheckingforv8.h...no***e

我有一个在Linux服务器上运行的ruby脚本。它不使用rails或任何东西。它基本上是一个命令行ruby脚本,可以像这样传递参数:./ruby_script.rbarg1arg2如何将参数抽象到配置文件(例如yaml文件或其他文件)中?您能否举例说明如何做到这一点?提前谢谢你。 最佳答案 首先,您可以运行一个写入YAML配置文件的独立脚本:require"yaml"File.write("path_to_yaml_file",[arg1,arg2].to_yaml)然后,在您的应用中阅读它:require"yaml"arg

我的最终目标是安装当前版本的RubyonRails。我在OSXMountainLion上运行。到目前为止,这是我的过程:已安装的RVM$\curl-Lhttps://get.rvm.io|bash-sstable检查已知(我假设已批准)安装$rvmlistknown我看到当前的稳定版本可用[ruby-]2.0.0[-p247]输入命令安装$rvminstall2.0.0-p247注意:我也试过这些安装命令$rvminstallruby-2.0.0-p247$rvminstallruby=2.0.0-p247我很快就无处可去了。结果:$rvminstall2.0.0-p247Search

我实际上是在尝试使用RVM在我的OSX10.7.5上更新ruby,并在输入以下命令后:rvminstallruby我得到了以下回复:Searchingforbinaryrubies,thismighttakesometime.Checkingrequirementsforosx.Installingrequirementsforosx.Updatingsystem.......Errorrunning'requirements_osx_brew_update_systemruby-2.0.0-p247',pleaseread/Users/username/.rvm/log/138121

由于fast-stemmer的问题,我很难安装我想要的任何rubygem。我把我得到的错误放在下面。Buildingnativeextensions.Thiscouldtakeawhile...ERROR:Errorinstallingfast-stemmer:ERROR:Failedtobuildgemnativeextension./System/Library/Frameworks/Ruby.framework/Versions/2.0/usr/bin/rubyextconf.rbcreatingMakefilemake"DESTDIR="cleanmake"DESTDIR=

我已经在Sinatra上创建了应用程序,它代表了一个简单的API。我想在生产和开发上进行部署。我想在部署时选择,是开发还是生产,一些方法的逻辑应该改变,这取决于部署类型。是否有任何想法,如何完成以及解决此问题的一些示例。例子:我有代码get'/api/test'doreturn"Itisdev"end但是在部署到生产环境之后我想在运行/api/test之后看到ItisPROD如何实现? 最佳答案 根据SinatraDocumentation:EnvironmentscanbesetthroughtheRACK_ENVenvironm