目录

本篇博文是《双目三维重建系统(双目标定+立体校正+双目测距+点云显示)Python》的续作,我们将搭建一个OpenCV C++版本的双目三维重建系统。由于我们只考虑三维重建实现双目测距效果,因而去除了PCL和Open3d库三维显示效果,但依然保留了视差图,深度图等可视化效果,用户可以通过鼠标点击图像,即可获得对应的世界坐标以及深度距离信息。

从效果来看,C++版本的双目测距和Python版本的效果几乎一致,性能更优,速度更快,基本可以达到工业级别测距精度,可在Linux开发板运行,非常适合应用于无人机,智能小车测距避障等场景。

来~先看一下Demo的效果图(鼠标点击,终端会打印对应距离信息):

OpenCV C++双目摄像头实现双目测距主要支持:

- 支持双USB连接线的双目摄像头

- 支持使用WLS滤波器对视差图进行滤波

- 支持双目测距(鼠标点击图像即可获得其深度距离)

- 提供配套的opencv-4.3.0和opencv_contrib-4.3.0源码 (需要自己编译)

- 相比Python版本,C++版本性能更优,速度更快,可在Linux开发板运行,非常适合应用于无人机,智能小车测距避障等场景。

- 简单运行,项目源码只在Ubuntu 18.04系统进行了验证;第三方依赖库只有opencv和opencv_contrib,如果你在Windows系统开发,请在Windows平台配置好opencv和opencv_contrib开发环境;

诚然,网上有很多C++版本双测距的代码,但项目都不是十分完整,而且恢复视差图效果也一般,难以达到商业实际应用,究其原因,主要有下面几个:

- 双目摄像头质量问题,

- 双目标定存在问题,导致校准误差较大

- 没有使用WLS滤波器对视差图进行滤波,该方法可以极大提高视差图的效果

|

双目测距Demo视频 |

如果你需要Python版本的双目测距, 请查看鄙人另一篇博客《双目三维重建:双目摄像头实现双目测距(Python》

本篇将着重介绍OpenCV C++项目实现双目测距的过程,关于双目相机标定+双目校正+双目匹配等内容,请查看鄙人另一篇博客 《双目三维重建系统(双目标定+立体校正+双目测距+点云显示)Python》

【项目源码下载地址】OpenCV C++双目摄像头实现双目测距

【尊重原则,转载请注明出处】https://blog.csdn.net/guyuealian/article/details/127446435

.

├── configs # 相机参数文件

├── data # 相机采集的数据

├── docs # 一些文档图片

├── src # C++源码

├── build.sh # 构建build脚本

├── main.cpp # 主程序

├── CMakeLists.txt # CMake文件

└── README.md # 说明文档opencv安装教程,请参考文章:Ubuntu18.04安装opencv和opencv_contrib

PS: 需确保opencv和opencv_contrib的版本号一致,避免版本差异导致编译错误。

项目源码只在Ubuntu 18.04系统进行了验证;第三方依赖库只有opencv和opencv_contrib,如果你在Windows系统开发,请在Windows平台配置好opencv和opencv_contrib开发环境;

请参考鄙人另一篇博客,无需Matlab,即可进行相机标定:双目三维重建系统(双目标定+立体校正+双目测距+点云显示)Python

该方法双目标定完成后,会得到一个双目相机内外参数信息(stereo_cam.yml)文件:

%YAML:1.0

---

size: !!opencv-matrix

rows: 2

cols: 1

dt: d

data: [ 640., 480. ]

K1: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ 7.6159209686584518e+02, 0., 3.2031427422505453e+02, 0.,

7.6167321445963728e+02, 2.2467546927337131e+02, 0., 0., 1. ]

D1: !!opencv-matrix

rows: 1

cols: 5

dt: d

data: [ 3.4834574885170888e-02, -5.5261651661983137e-02,

5.7491952731614823e-04, -4.2764224824172658e-05,

1.8477350140315381e-02 ]

K2: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ 7.6327773941976670e+02, 0., 2.8768149948082271e+02, 0.,

7.6350419442870850e+02, 2.1897333598636970e+02, 0., 0., 1. ]

D2: !!opencv-matrix

rows: 1

cols: 5

dt: d

data: [ 3.5020972475517692e-02, -4.0770660841280497e-02,

-4.4231087565750534e-04, -1.0552562170995372e-03,

-9.7749906830348537e-02 ]

R: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ 9.9999370552351063e-01, 7.8563885326366346e-04,

3.4600122760633780e-03, -7.9503151737356746e-04,

9.9999600079883766e-01, 2.7140949167922721e-03,

-3.4578661403601796e-03, -2.7168286517956050e-03,

9.9999033095517087e-01 ]

T: !!opencv-matrix

rows: 3

cols: 1

dt: d

data: [ -6.0005833133148414e+01, 1.7047017063672587e-01,

6.0300223404957642e-01 ]

E: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ -1.1005724987007073e-04, -6.0346296076620343e-01,

1.6883191705475561e-01, 3.9550629985097430e-01,

-1.6255182474732952e-01, 6.0007339329190145e+01,

-1.2276256904913259e-01, -6.0005727085740176e+01,

-1.6345135556766910e-01 ]

F: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ -6.7250769136371160e-10, -3.6870834234286016e-06,

1.6143104894409041e-03, 2.4160347372858321e-06,

-9.9287680075344234e-07, 2.7862421257891157e-01,

-1.1014218394645766e-03, -2.7856049650040260e-01, 1. ]

R1: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ 9.9997618806974742e-01, -2.0278309638726887e-03,

-6.5963016213173775e-03, 2.0367881225372914e-03,

9.9999701250432615e-01, 1.3514719999064883e-03,

6.5935413581266105e-03, -1.3648750875444691e-03,

9.9997733090723306e-01 ]

R2: !!opencv-matrix

rows: 3

cols: 3

dt: d

data: [ 9.9994547731576255e-01, -2.8407384289991728e-03,

-1.0048512373976153e-02, 2.8270879178959596e-03,

9.9999506202764499e-01, -1.3724045434755307e-03,

1.0052361397026631e-02, 1.3439216883706559e-03,

9.9994857062992937e-01 ]

P1: !!opencv-matrix

rows: 3

cols: 4

dt: d

data: [ 7.3741438842621210e+02, 0., 3.1126281356811523e+02, 0., 0.,

7.3741438842621210e+02, 2.2189782714843750e+02, 0., 0., 0., 1.,

0. ]

P2: !!opencv-matrix

rows: 3

cols: 4

dt: d

data: [ 7.3741438842621210e+02, 0., 3.1126281356811523e+02,

-4.4251577456670653e+04, 0., 7.3741438842621210e+02,

2.2189782714843750e+02, 0., 0., 0., 1., 0. ]

Q: !!opencv-matrix

rows: 4

cols: 4

dt: d

data: [ 1., 0., 0., -3.1126281356811523e+02, 0., 1., 0.,

-2.2189782714843750e+02, 0., 0., 0., 7.3741438842621210e+02, 0.,

0., 1.6664137886344466e-02, 0. ]

参数说明:

- 参数size,对应图像宽高(width,height)

- 参数K1,对应左目相机内参矩阵(3×3)

- 参数D1,对应左目相机畸变系数矩阵(5×1)

- 参数K2,对应右目相机内参矩阵(3×3)

- 参数D2,对应右目相机畸变系数矩阵(5×1)

- 参数T,对应双目相机平移向量T(3×1)

- 参数R,对应双目相机旋转矩阵R(3×3)

- 至于配置文件中的参数,如R1, R2, P1, P2, Q这些重投影矩阵,可默写即可,不用修改,这些在运行时,会重新计算。

网上已经存在很多Matlab双目相机标定的教程,请自行百度哈 ;使用Matlab工具箱进行双目相机标定后,请对应参数进行修改

需要注意的是:旋转矩阵R是(3×3)二维矩阵,而Matlab给出的是旋转向量om(1×3),请使用cv2.Rodrigues()将旋转向量转为旋转矩阵,参考下面的代码进行转换

import cv2

import numpy as np

# 定义旋转矩阵R,旋转向量om

R = [[9.9999370551606337e-01, 7.8563882630048958e-04, 3.4600144345510440e-03],

[-7.9503149273969136e-04, 9.9999600080163187e-01, 2.7140938945082542e-03],

[-3.4578682997252063e-03, -2.7168276311286426e-03, 9.9999033095047696e-01]]

R = np.asarray(R)

print(f"旋转矩阵R:\n {R}")

# 把旋转矩阵R转化为旋转向量om

om, _ = cv2.Rodrigues(R)

print(f"旋转向量om:\n {om}")

# 把旋转向量om转换为旋转矩阵R

R1, _ = cv2.Rodrigues(om)

print(f"旋转矩阵R1:\n {R1}")

CameraParam即可

/**

* 双目摄像头的相机参数

*/

struct CameraParam {

int width; //图像的宽度width

int height; //图像的高度height

Mat cameraMatrixL; //左相机内参K1(3×3)

Mat distCoeffL; //左相机畸变系数D1(5×1)

Mat cameraMatrixR; //右相机内参K2(3×3)

Mat distCoeffR; //右相机畸变系数D2(5×1)

Mat T; //平移向量T(3×1)

Mat R; //旋转矩阵R(3×3),如果是(3×1)旋转向量,请使用cv::Rodrigues()进行变换转为(3×3)旋转矩阵R

};

/***

* 设置摄像头参数,需要根据双目摄像头标定结果进行填写

*/

static CameraParam camera1 = {

640,//width

480,//height

(Mat_<double>(3, 3)

<< 7.6159209686633153e+02, 0., 3.2031427422691633e+02, 0., 7.6167321446015626e+02, 2.2467546926913309e+02, 0., 0., 1.),//cameraMatrixL

(Mat_<double>(5, 1)

<< 3.4834574887256914e-02, -5.5261651680159028e-02, 5.7491952534806736e-04, -4.2764223950233445e-05, 1.8477350164208820e-02),//distCoeffL

(Mat_<double>(3, 3)

<< 7.6327773983796783e+02, 0., 2.8768149776326379e+02, 0., 7.6350419482215057e+02, 2.1897333669573928e+02, 0., 0., 1.),

(Mat_<double>(5, 1)

<< 3.5020967512300320e-02, -4.0770565902033332e-02, -4.4231049297594003e-04, -1.0552565496142535e-03, -9.7750314807571667e-02),

(Mat_<double>(3, 1)

<< -6.0005833075452117e+01, 1.7047023105446815e-01, 6.0300273851103448e-01),

(Mat_<double>(3, 3)

<< 9.9999370551606337e-01, 7.8563882630048958e-04, 3.4600144345510440e-03, -7.9503149273969136e-04, 9.9999600080163187e-01, 2.7140938945082542e-03, -3.4578682997252063e-03, -2.7168276311286426e-03, 9.9999033095047696e-01),

};

OpenCV C++版本的双目测距与Python版本双目测距的效果几乎一致,且性能更优,速度更快,基本可以达到工业级别测距精度。由于我们只考虑三维重建实现双目测距效果,因而去除了PCL和Open3d库三维显示效果,但依然保留了视差图,深度图等可视化效果,用户可以通过鼠标点击图像,即可获得对应的世界坐标以及深度距离信息。

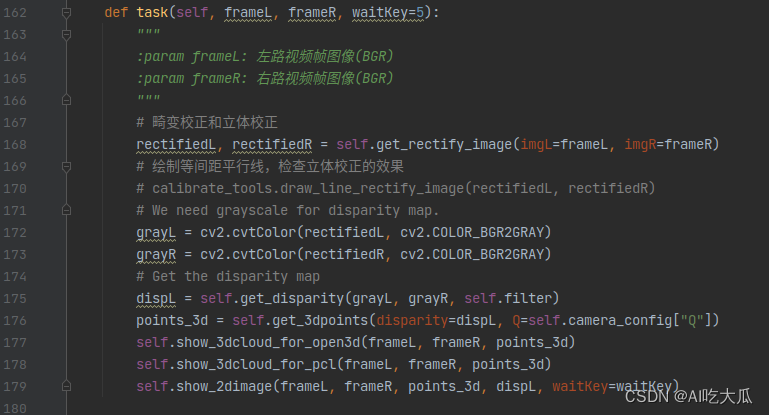

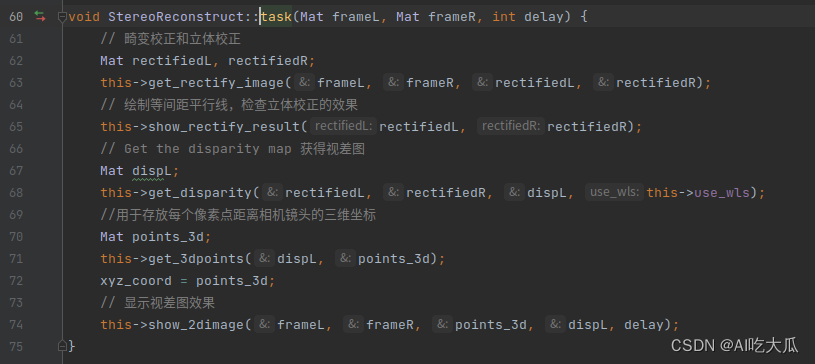

函数接口声明,都已经给出了详细的参数说明,为了方便大家学习,函数命名和实现逻辑与Python版本的几乎一致:

| Python版本 | C++版本 |

|  |

//

// Created by pan_jinquan@163.com on 2022/10/6.

//

#ifndef CAMERA_CALIBRATION_RECONSTRUCT_CPP_STEREO_RECONSTRUCT_H

#define CAMERA_CALIBRATION_RECONSTRUCT_CPP_STEREO_RECONSTRUCT_H

#include <opencv2/opencv.hpp>

#include <iostream>

using namespace std;

using namespace cv;

cv::Mat xyz_coord; //用于存放每个像素点距离相机镜头的三维坐标

cv::Point start; //鼠标按下的起始点

cv::Rect buttonRect; //定义矩形选框

bool buttonStatus = false; //是否选择对象

/**

* 双目摄像头的相机参数

*/

struct CameraParam {

int width; //图像的宽度width

int height; //图像的高度height

Mat cameraMatrixL; //左相机内参K1(3×3)

Mat distCoeffL; //左相机畸变系数D1(5×1)

Mat cameraMatrixR; //右相机内参K2(3×3)

Mat distCoeffR; //右相机畸变系数D2(5×1)

Mat T; //平移向量T(3×1)

Mat R; //旋转矩阵R(3×3),如果是(3×1)旋转向量,请使用cv::Rodrigues()进行变换转为(3×3)旋转矩阵R

};

/***

* 设置摄像头参数,需要根据双目摄像头标定结果进行填写

*/

static CameraParam camera1 = {640,//width

480,//height

(Mat_<double>(3, 3)

<< 7.6159209686633153e+02, 0., 3.2031427422691633e+02, 0., 7.6167321446015626e+02, 2.2467546926913309e+02, 0., 0., 1.),//cameraMatrixL

(Mat_<double>(5, 1)

<< 3.4834574887256914e-02, -5.5261651680159028e-02, 5.7491952534806736e-04, -4.2764223950233445e-05, 1.8477350164208820e-02),//distCoeffL

(Mat_<double>(3, 3)

<< 7.6327773983796783e+02, 0., 2.8768149776326379e+02, 0., 7.6350419482215057e+02, 2.1897333669573928e+02, 0., 0., 1.),

(Mat_<double>(5, 1)

<< 3.5020967512300320e-02, -4.0770565902033332e-02, -4.4231049297594003e-04, -1.0552565496142535e-03, -9.7750314807571667e-02),

(Mat_<double>(3, 1)

<< -6.0005833075452117e+01, 1.7047023105446815e-01, 6.0300273851103448e-01),

(Mat_<double>(3, 3)

<< 9.9999370551606337e-01, 7.8563882630048958e-04, 3.4600144345510440e-03, -7.9503149273969136e-04, 9.9999600080163187e-01, 2.7140938945082542e-03, -3.4578682997252063e-03, -2.7168276311286426e-03, 9.9999033095047696e-01),

};

/***

* 鼠标响应回调函数

* @param event

* @param x

* @param y

*/

static void onMouse(int event, int x, int y, int, void *) {

if (buttonStatus) {

buttonRect.x = MIN(x, start.x);

buttonRect.y = MIN(y, start.y);

buttonRect.width = std::abs(x - start.x);

buttonRect.height = std::abs(y - start.y);

}

switch (event) {

case EVENT_LBUTTONDOWN: //鼠标左按钮按下的事件

start = Point(x, y);

buttonRect = Rect(x, y, 0, 0);

buttonStatus = true;

cout << "image(x,y)=" << start;

cout << " world coords=(x,y,depth)=" << xyz_coord.at<Vec3f>(start) << endl;

break;

case EVENT_LBUTTONUP: //鼠标左按钮释放的事件

buttonStatus = false;

if (buttonRect.width > 0 && buttonRect.height > 0)

break;

}

}

/***

* 显示图像

* @param winname 窗口名称

* @param image 图像

* @param delay 显示延迟,0表示阻塞显示

* @param flags 显示方式

*/

static void show_image(const string &winname, cv::Mat &image, int delay = 0, int flags = cv::WINDOW_AUTOSIZE) {

cv::namedWindow(winname, flags);

cv::imshow(winname, image);

cv::waitKey(delay);

}

/***

* 读取视频文件

* @param video_file 视频文件

* @param cap 视频流对象

* @param width 设置图像的宽度

* @param height 设置图像的高度

* @param fps 设置视频播放频率

* @return

*/

bool get_video_capture(string video_file, cv::VideoCapture &cap, int width = -1, int height = -1, int fps = -1) {

//VideoCapture video_cap;

cap.open(video_file);

if (width > 0 && height > 0) {

cap.set(cv::CAP_PROP_FRAME_WIDTH, width); //设置图像的宽度

cap.set(cv::CAP_PROP_FRAME_HEIGHT, height); //设置图像的高度

}

if (fps > 0) {

cap.set(cv::CAP_PROP_FPS, fps);

}

if (!cap.isOpened())//判断是否读取成功

{

return false;

}

return true;

}

/***

* 读取摄像头

* @param camera_id 摄像头ID号,默认从0开始

* @param cap 视频流对象

* @param width 设置图像的宽度

* @param height 设置图像的高度

* @param fps 设置视频播放频率

* @return

*/

bool get_video_capture(int camera_id, cv::VideoCapture &cap, int width = -1, int height = -1, int fps = -1) {

//VideoCapture video_cap;

cap.open(camera_id); //摄像头ID号,默认从0开始

if (width > 0 && height > 0) {

cap.set(cv::CAP_PROP_FRAME_WIDTH, width); //设置捕获图像的宽度

cap.set(cv::CAP_PROP_FRAME_HEIGHT, height); //设置捕获图像的高度

}

if (fps > 0) {

cap.set(cv::CAP_PROP_FPS, fps);

}

if (!cap.isOpened()) //判断是否成功打开相机

{

return false;

}

return true;

}

class StereoReconstruct {

public:

/***

* 构造函数,初始化StereoReconstruct

* @param camera 双目相机参数

* @param use_wls 是否使用WLS滤波器对视差图进行滤波

*/

StereoReconstruct(CameraParam camera, bool use_wls = true);

/***

* release

*/

~StereoReconstruct();

/***

* 开始双目测距任务

* @param frameL

* @param frameR

*/

void task(Mat frameL, Mat frameR, int delay = 0);

/***

* 畸变校正和立体校正

* @param imgL 左视图

* @param imgR 右视图

* @param rectifiedL 校正后左视图

* @param rectifiedR 校正后右视图

*/

void get_rectify_image(Mat &imgL, Mat &imgR, Mat &rectifiedL, Mat &rectifiedR);

/***

* 获得视差图

* @param imgL 畸变校正和立体校正后的左视图

* @param imgR 畸变校正和立体校正后的右视图

* @param dispL 返回视差图

* @param use_wls 是否使用WLS滤波器对视差图进行滤波

*/

void get_disparity(Mat &imgL, Mat &imgR, Mat &dispL, bool use_wls = true);//SGBM匹配算法

/***

* 计算像素点的3D坐标(左相机坐标系下)

* @param disp 视差图

* @param points_3d 返回三维坐标points_3d,三个通道分布表示(X,Y,Z),其中Z是深度图depth, 即距离,单位是毫米(mm)

* @param scale 单位变换尺度,默认scale=1.0,单位为毫米

*/

void get_3dpoints(Mat &disp, Mat &points_3d, float scale = 1.0);

/***

* 将输入深度图转换为伪彩色图,方面可视化

* @param depth

* @param colormap

*/

void get_visual_depth(cv::Mat &depth, cv::Mat &colormap, float clip_max = 6000.0);

/***

* 显示矫正效果

* @param rectifiedL

* @param rectifiedR

*/

void show_rectify_result(cv::Mat rectifiedL, cv::Mat rectifiedR);

/***

* 可视化视差图和深度图

* @param frameL

* @param frameR

* @param points_3d

* @param disp

* @param delay

*/

void show_2dimage(Mat &frameL, Mat &frameR, Mat &points_3d, Mat &disp, int delay);

/***

* 显示Mat的最大最小值

* @param src

* @param vmin 最小值下限

* @param vmax 最大值下限

*/

void clip(cv::Mat &src, float vmin, float vmax);

/***

* 显示Mat的最大最小值

* @param src

* @param th

* @param vmin

*/

void clip_min(cv::Mat &src, float th, float vmin);

public:

string depth_windows = "depth-color"; // 深度图的窗口名称

int use_wls; // 是否使用WLS滤波器对视差图进行滤波

Size image_size; // 图像宽高(width,height)

Rect validROIL; // 图像校正之后,会对图像进行裁剪,这里的左视图裁剪之后的区域

Rect validROIR; // 图像校正之后,会对图像进行裁剪,这里的右视图裁剪之后的区域

Mat mapLx, mapLy, mapRx, mapRy; // 映射表

Mat Rl, Rr, Pl, Pr, Q; // 校正后的旋转矩阵R,投影矩阵P, 重投影矩阵Q

cv::Ptr<cv::StereoSGBM> sgbm;

};

#endif //CAMERA_CALIBRATION_RECONSTRUCT_CPP_STEREO_RECONSTRUCT_H

- 测试demo视频文件: 这是使用摄像头录制的双目视频文件,用于测试效果双目测距的效果

- 测试双目摄像头(双USB连接线的双目摄像头):用于测试双目摄像头,需要根据自己的摄像头修改ID号

- 测试一对左右相机图像效果

//

// 双目测距Demo

// Created by AI吃大瓜 on 2022/10/6.

//

#include <opencv2/opencv.hpp>

#include <iostream>

#include "stereo_reconstruct.h"

/***

* 测试demo视频文件

* @return

*/

int test_video_file() {

CameraParam camera = camera1;//双目相机参数

bool use_wls = true; //是否使用WLS滤波器对视差图进行滤波

StereoReconstruct *detector = new StereoReconstruct(camera, use_wls);

int imageWidth = camera1.width; //单目图像的宽度

int imageHeight = camera1.height; //单目图像的高度

string left_video = "../data/lenacv-video/left_video.avi";

string right_video = "../data/lenacv-video/right_video.avi";

VideoCapture capL, capR;

bool retL = get_video_capture(left_video, capL, imageWidth, imageHeight);

bool retR = get_video_capture(right_video, capR, imageWidth, imageHeight);

Mat frameL, frameR;

while (retL && retR) {

capL >> frameL;

capR >> frameR;

if (frameL.empty() or frameR.empty()) break;

detector->task(frameL, frameR, 20);

}

capL.release(); //释放对相机的控制

capR.release(); //释放对相机的控制

delete detector;

return 0;

}

/***

* 测试双目摄像头(双USB连接线的双目摄像头)

* @return

*/

int test_camera() {

CameraParam camera = camera1;//双目相机参数

bool use_wls = true; //是否使用WLS滤波器对视差图进行滤波

StereoReconstruct *detector = new StereoReconstruct(camera, use_wls);

int imageWidth = camera1.width; //单目图像的宽度

int imageHeight = camera1.height; //单目图像的高度

int camera1 = 0; //左摄像头ID号(请修改成自己左摄像头ID号)

int camera2 = 1; //右摄像头ID号(请修改成自己右摄像头ID号)

VideoCapture capL, capR;

bool retL = get_video_capture(camera1, capL, imageWidth, imageHeight);

bool retR = get_video_capture(camera2, capR, imageWidth, imageHeight);

Mat frameL, frameR;

while (retL && retR) {

capL >> frameL;

capR >> frameR;

if (frameL.empty() or frameR.empty()) break;

detector->task(frameL, frameR, 20);

}

capL.release(); //释放对相机的控制

capR.release(); //释放对相机的控制

delete detector;

return 0;

}

/***

* 测试一对左右图像

* @return

*/

int test_pair_image_file() {

CameraParam camera = camera1;//双目相机参数

bool use_wls = true; //是否使用WLS滤波器对视差图进行滤波

StereoReconstruct *detector = new StereoReconstruct(camera, use_wls);

Mat frameL = imread("../data/left.png", IMREAD_COLOR);

Mat frameR = imread("../data/right.png", IMREAD_COLOR);

detector->task(frameL, frameR, 0);

delete detector;

return 0;

}

int main() {

//测试一对左右图像

test_pair_image_file();

//测试demo视频文件

test_video_file();

//测试双目摄像头(双USB连接线的双目摄像头)

test_camera();

return 0;

}

bash build.sh#!/usr/bin/env bash

if [ ! -d "build/" ];then

mkdir "build"

else

echo "exist build"

fi

cd build

cmake ..

make -j4

sleep 1

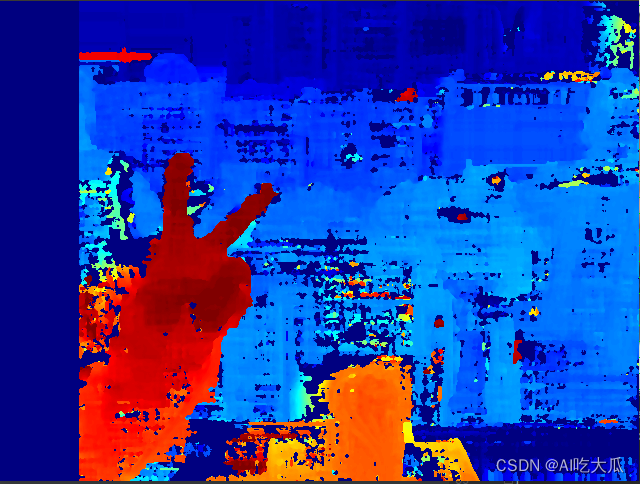

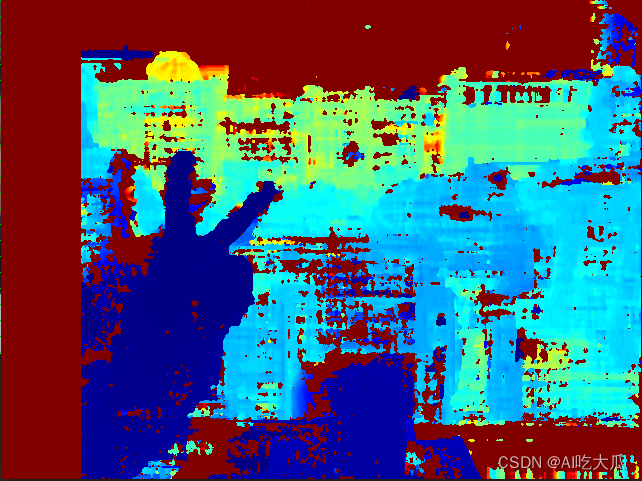

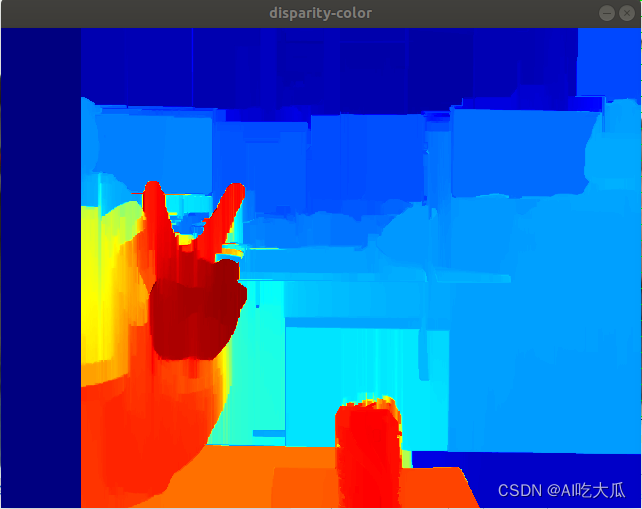

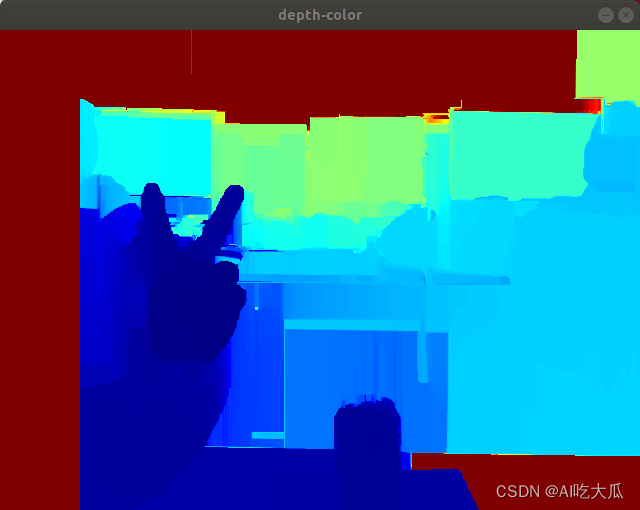

./DemoC++版本的双目测距与Python版本的效果几乎一致。从重建效果来看,未使用WLS滤波,其视差图出现了很多空洞,存在很多误匹配点;但使用WLS滤波后,视差图变得比较平滑,整体效果都有明显改善。

| 左视图 | 右视图 |

|---|---|

|  |

| 视差图(未滤波) | 深度图(未滤波) |

|  |

| 视差图(滤波后) | 深度图(滤波后) |

|  |

depth-color窗口的图像任意区域,终端会打印对应距离信息

OpenCV C++版本双目测距项目代码包含:OpenCV C++双目摄像头实现双目测距

【项目源码下载地址】OpenCV C++双目摄像头实现双目测距

- 支持双USB连接线的双目摄像头

- 支持使用WLS滤波器对视差图进行滤波

- 支持双目测距(鼠标点击图像即可获得其深度距离)

- 提供配套的opencv-4.3.0和opencv_contrib-4.3.0源码 (需要自己编译)

- 相比Python版本,C++版本性能更优,速度更快,可在Linux开发板运行,非常适合应用于无人机,智能小车测距避障等场景。

- 简单运行,项目源码只在Ubuntu 18.04系统进行了验证;第三方依赖库只有opencv和opencv_contrib,如果你在Windows系统开发,请在Windows平台配置好opencv和opencv_contrib开发环境;

如果你需要Python版本的双目测距, 请查看鄙人另一篇博客《双目三维重建系统(双目标定+立体校正+双目测距+点云显示)Python》

|

双目测距Demo视频 |

如果你需要Android版本的双目测距, 请查看鄙人另一篇博客《Android OpenCV实现双目三维重建:双目摄像头实现双目测距》

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复

在ruby中,你可以这样做:classThingpublicdeff1puts"f1"endprivatedeff2puts"f2"endpublicdeff3puts"f3"endprivatedeff4puts"f4"endend现在f1和f3是公共(public)的,f2和f4是私有(private)的。内部发生了什么,允许您调用一个类方法,然后更改方法定义?我怎样才能实现相同的功能(表面上是创建我自己的java之类的注释)例如...classThingfundeff1puts"hey"endnotfundeff2puts"hey"endendfun和notfun将更改以下函数定

我目前有一个reddit克隆类型的网站。我正在尝试根据我的用户之前喜欢的帖子推荐帖子。看起来K最近邻或k均值是执行此操作的最佳方法。我似乎无法理解如何实际实现它。我看过一些数学公式(例如k表示维基百科页面),但它们对我来说并没有真正意义。有人可以推荐一些伪代码,或者可以查看的地方,以便我更好地了解如何执行此操作吗? 最佳答案 K最近邻(又名KNN)是一种分类算法。基本上,您采用包含N个项目的训练组并对它们进行分类。如何对它们进行分类完全取决于您的数据,以及您认为该数据的重要分类特征是什么。在您的示例中,这可能是帖子类别、谁发布了该项

我查看了Stripedocumentationonerrors,但我仍然无法正确处理/重定向这些错误。基本上无论发生什么,我都希望他们返回到edit操作(通过edit_profile_path)并向他们显示一条消息(无论成功与否)。我在edit操作上有一个表单,它可以POST到update操作。使用有效的信用卡可以正常工作(费用在Stripe仪表板中)。我正在使用Stripe.js。classExtrasController5000,#amountincents:currency=>"usd",:card=>token,:description=>current_user.email)

虽然1.8.7的构建我似乎有一个向后移植的Shellwords::shellescape版本,但我知道该方法是1.9的一个特性,在1.8的早期版本中绝对不支持.有谁知道我在哪里可以找到(以Gem形式或仅作为片段)针对Ruby转义的Bourne-shell命令的强大独立实现? 最佳答案 您也可以从shellwords.rb中复制您想要的内容。在Ruby的颠覆存储库的主干中(即GPLv2'd):defshellescape(str)#Anemptyargumentwillbeskipped,soreturnemptyquotes.ret