黑马程序猿的python学习视频:https://www.bilibili.com/video/BV1qW4y1a7fU/

===============================================================

目录

7. 如何输入数据到Spark(即得到RDD对象)

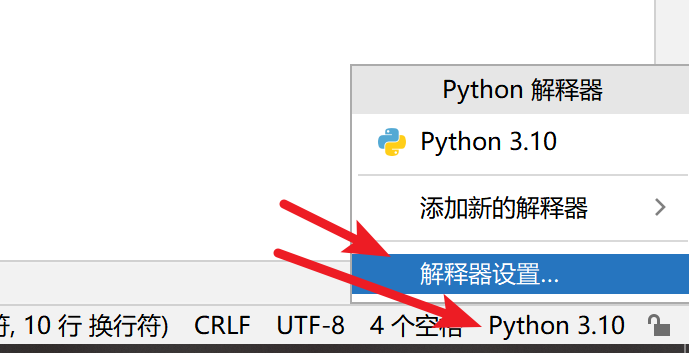

点击右下角版本 点击解释器设置

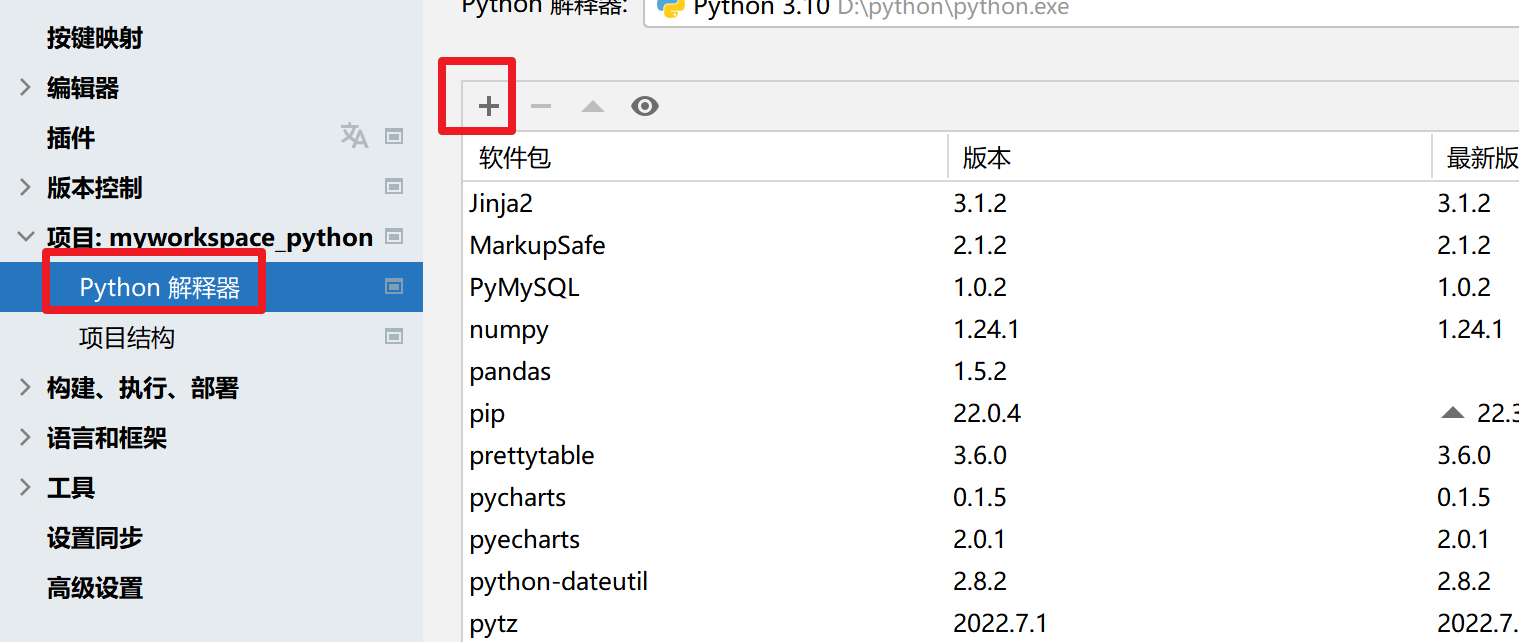

点击+号

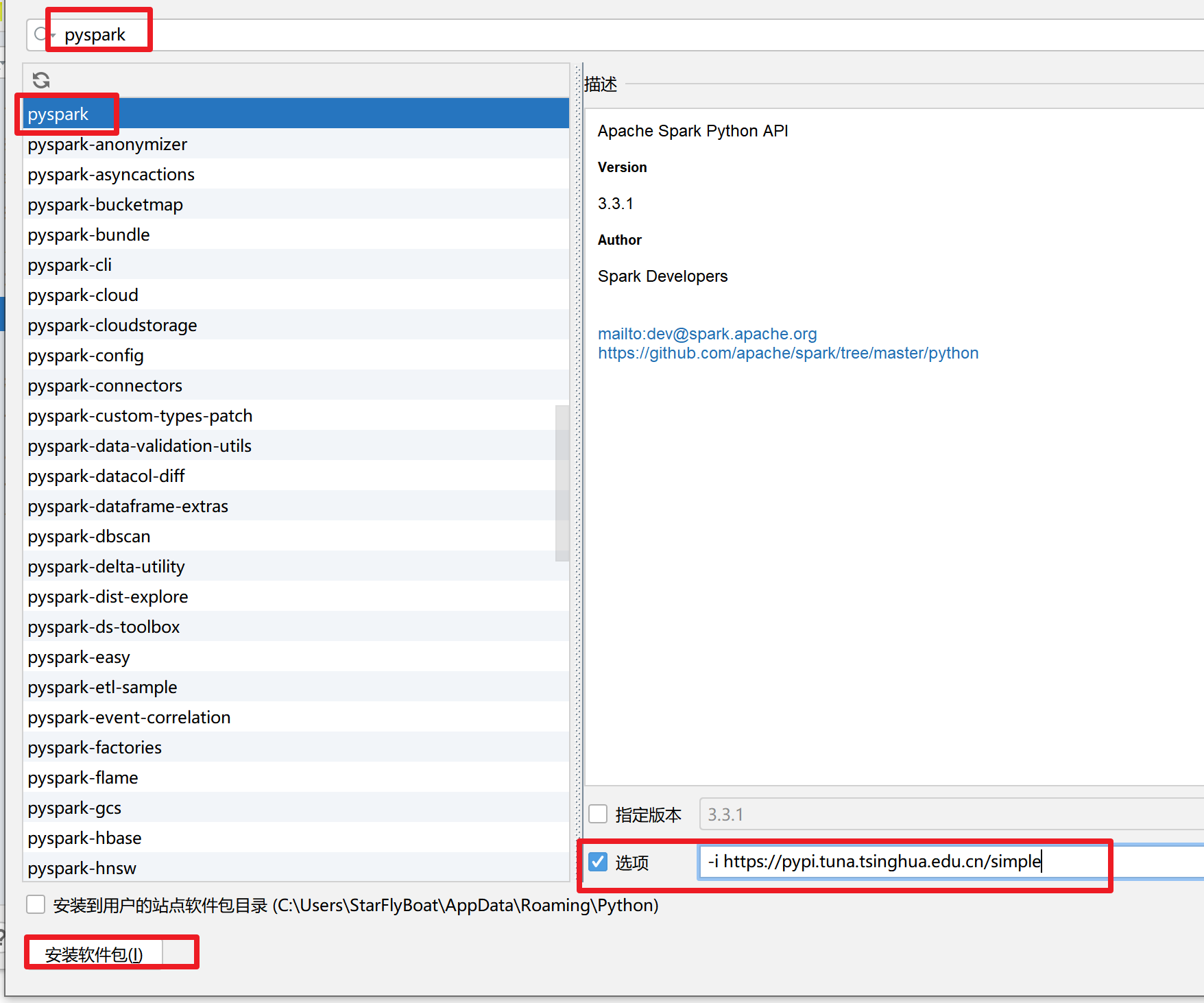

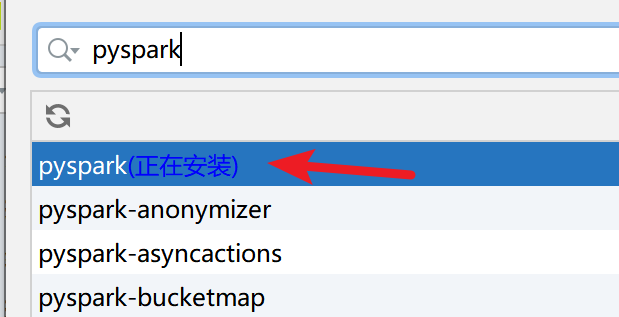

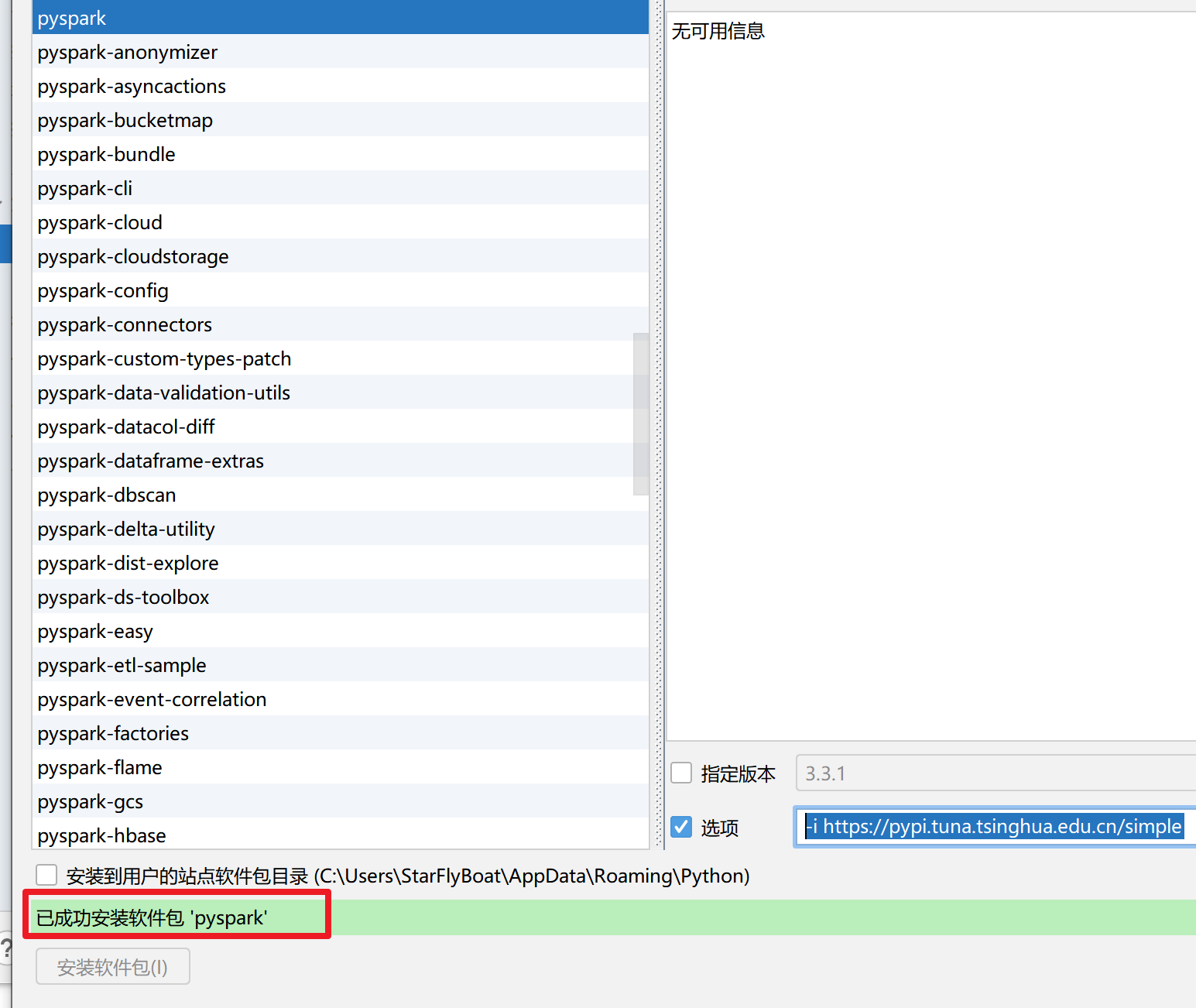

搜索pyspark 选择pyspark

勾选选项 在输入框中输入

| -i https://pypi.tuna.tsinghua.edu.cn/simple |

点击安装软件包

提示正在安装

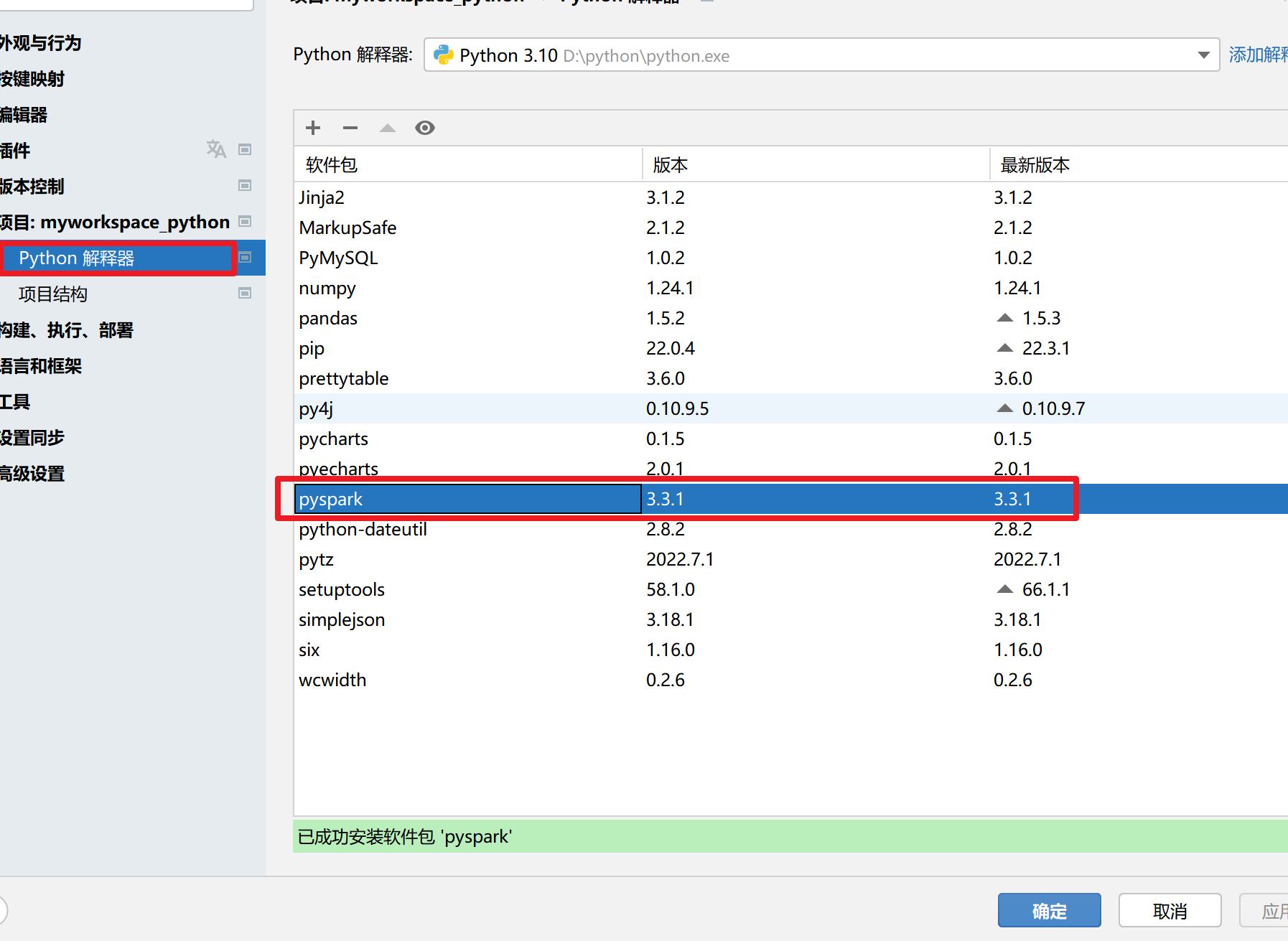

等一两分钟就能安装完毕

| # 导包 from pyspark import SparkConf,SparkContext # 创建SparkConf对象 conf = SparkConf().setMaster("local[*]").setAppName("test_spark_app") # 基于SparkConf类对象创建SparkContext对象 sc = SparkContext(conf=conf) # 打印PySpark的运行版本 print(sc.version) # 停止SparkContext对象的运行 (停止Spark对象) sc.stop()

|

| 3.3.1

|

| from pyspark import SparkConf,SparkContext

conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 通过parallelize方法将Python对象加载到Spark内 成为RDD对象 rdd1 = sc.parallelize([1, 2, 3, 4, 5]) rdd2 = sc.parallelize((1, 2, 3, 4, 5)) rdd3 = sc.parallelize("abcdefg") rdd4 = sc.parallelize({1, 2, 3, 4, 5}) rdd5 = sc.parallelize({"key1": "value1", "key2": "value2"})

# 如果要查看RDD里边有什么内容 需要用Collect()方法 print(rdd1.collect()) print(rdd2.collect()) print(rdd3.collect()) print(rdd4.collect()) print(rdd5.collect())

|

| [1, 2, 3, 4, 5] [1, 2, 3, 4, 5] ['a', 'b', 'c', 'd', 'e', 'f', 'g'] [1, 2, 3, 4, 5] ['key1', 'key2'] |

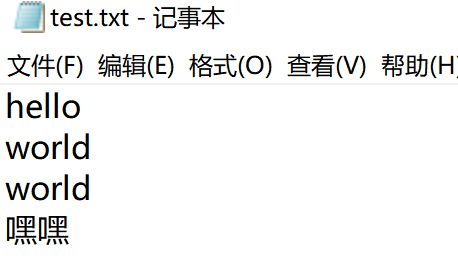

在D盘准备一个test的txt文档

| from pyspark import SparkConf,SparkContext

conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 通过textFile方法,读取文件数据加载到Spark内,成为RDD对象 rdd = sc.textFile("D:/test.txt") print(rdd.collect())

sc.stop()

|

| 23/01/23 23:15:35 WARN NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable ['hello', 'world', 'world', '嘿嘿'] |

RDD对象称之为分布式弹性数据集,是PySpark中数据计算的载体,他可以:

后续对数据进行各类计算,都是基于RDD对象进行

通过SparkContext的parallelize的成员方法,将Python数据容器转换为RDD对象

通过SparkContext的textFile成员方法,读取文本文件得到RDD对象

| from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe"

conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([1,2,3,4,5]) # 通过map方法将全部数据乘以10 rdd2 = rdd.map(lambda x:x*10)

print(rdd2.collect()) sc.stop()

|

| [10, 20, 30, 40, 50] |

接受一个处理函数,可用lambda表达式快速编写

对RDD内的元素逐个处理,并返回新的RDD

将rdd中的单词全部提取出来 解除嵌套

注意:

计算逻辑和map一样

但是比map方法多出了解除一层嵌套的功能

| from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe"

conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个RDD rdd = sc.parallelize(["111 222 333","444 555 666","777 888 999 000"]) # 将rdd中的单词全部提取出来 解除嵌套 rdd2 = rdd.flatMap(lambda x:x.split(" ")) print(rdd2.collect()) sc.stop()

|

| ['111', '222', '333', '444', '555', '666', '777', '888', '999', '000'] |

功能:针对KV型RDD,自动按照key分组,然后根据你提供的聚合逻辑,完成组内数据(value)的聚合操作

如下案例实现了对男女两个组的分组,并且分别计算2个组的和

| from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe"

conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个RDD rdd = sc.parallelize([("男", 99), ("男",88), ("女",77), ("女",99), ("女",66),]) # 求男生和女生两个组的成绩之和 rdd2 = rdd.reduceByKey(lambda a, b: a+b) print(rdd2.collect()) sc.stop()

|

| [('男', 187), ('女', 242)] |

需求:读取txt文档信息,计算各个单词出现的次数

text.txt文档数据

| hello hello world world 啦啦 啦啦 啦啦 嘿嘿 嘿嘿 嘿嘿 |

代码和结果如下

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 2.读取数据文件 rdd = sc.textFile("D:/test.txt") # 3. 取出全部单词 word_add = rdd.flatMap(lambda x:x.split(" ")) # 4. 将所有的单词 都转成二元元组 单词为key,value设置成1 方便计数 word_with_one_rdd = word_add.map(lambda x:(x,1)) # 5. 分组求和 result_add = word_with_one_rdd.reduceByKey(lambda a, b:a+b) # 6. 打印输出结果 print(result_add.collect()) sc.stop()

|

| [('world', 2), ('啦啦', 3), ('hello', 2), ('嘿嘿', 3)] |

filter算子概念:接受一个处理函数,可以用lambda快速编写

函数对RDD数据逐个处理,得到True的保留至返回值的RDD中

以下案例是:获取数组中的偶数,把奇数过滤掉

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([1,2,3,4,5,6,7,8,9]) # 对RDD的数据进行过滤 rdd2 = rdd.filter(lambda num:num%2==0) print(rdd2.collect())

sc.stop()

|

| [2, 4, 6, 8] |

概念:完成对RDD内数据的去重操作

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([1,1,1,2,2,2,3,3,4,5,6,6,6]) # 对RDD的数据进行去重 rdd2 = rdd.distinct() print(rdd2.collect())

sc.stop()

|

| [1, 2, 3, 4, 5, 6] |

概念:接收一个处理函数,可用lambda快速编写

函数表示用来决定排序的依据

可以控制升序或降序

全局排序需要设置分区数为1

案例如下:对学生的成绩进行降序排序

第一个参数:取分数

第二个参数:设置False 说明是降序

第三个参数:设置为1

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([('张三',99),('李四', 77),('王五', 88),('赵六', 100),('七七', 87)]) # 对结果进行排序 rdd2 = rdd.sortBy(lambda x:x[1], ascending=False, numPartitions=1) print(rdd2.collect())

sc.stop()

|

| [('赵六', 100), ('张三', 99), ('王五', 88), ('七七', 87), ('李四', 77)] |

rdd.collect():返回值是一个list

reduce算子,对RDD进行两两聚合

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([1,2,3,4,5,6,7,8,9,10]) num = rdd.reduce(lambda a,b:a+b) print(rdd2) sc.stop()

|

| 55 |

概念:取出RDD中的前N个元素,组成list返回

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd rdd = sc.parallelize([('张三',99),('李四', 77),('王五', 88),('赵六', 100),('七七', 87)]) # 取出rdd中前两个元素,组成list返回 rdd2 = rdd.take(2) print(rdd2)

sc.stop()

|

| [('张三', 99), ('李四', 77)] |

| # 构建执行环境入口对象 from pyspark import SparkConf,SparkContext import os os.environ['PYSPARK_PYTHON'] = "D:/python/python.exe" conf = SparkConf().setMaster("local[*]").setAppName("test_spark") sc = SparkContext(conf=conf)

# 准备一个rdd num = sc.parallelize([('张三',99),('李四', 77),('王五', 88),('赵六', 100),('七七', 87)]).count() print(num) sc.stop()

|

| 5 |

saveAsTextFile算子:将RDD的数据写入到文本文件中

支持本地写出,hdfs等文件系统

我需要在客户计算机上运行Ruby应用程序。通常需要几天才能完成(复制大备份文件)。问题是如果启用sleep,它会中断应用程序。否则,计算机将持续运行数周,直到我下次访问为止。有什么方法可以防止执行期间休眠并让Windows在执行后休眠吗?欢迎任何疯狂的想法;-) 最佳答案 Here建议使用SetThreadExecutionStateWinAPI函数,使应用程序能够通知系统它正在使用中,从而防止系统在应用程序运行时进入休眠状态或关闭显示。像这样的东西:require'Win32API'ES_AWAYMODE_REQUIRED=0x0

关闭。这个问题是opinion-based.它目前不接受答案。想要改进这个问题?更新问题,以便editingthispost可以用事实和引用来回答它.关闭4年前。Improvethisquestion我想在固定时间创建一系列低音和高音调的哔哔声。例如:在150毫秒时发出高音调的蜂鸣声在151毫秒时发出低音调的蜂鸣声200毫秒时发出低音调的蜂鸣声250毫秒的高音调蜂鸣声有没有办法在Ruby或Python中做到这一点?我真的不在乎输出编码是什么(.wav、.mp3、.ogg等等),但我确实想创建一个输出文件。

Rackup通过Rack的默认处理程序成功运行任何Rack应用程序。例如:classRackAppdefcall(environment)['200',{'Content-Type'=>'text/html'},["Helloworld"]]endendrunRackApp.new但是当最后一行更改为使用Rack的内置CGI处理程序时,rackup给出“NoMethodErrorat/undefinedmethod`call'fornil:NilClass”:Rack::Handler::CGI.runRackApp.newRack的其他内置处理程序也提出了同样的反对意见。例如Rack

我想用ruby编写一个小的命令行实用程序并将其作为gem分发。我知道安装后,Guard、Sass和Thor等某些gem可以从命令行自行运行。为了让gem像二进制文件一样可用,我需要在我的gemspec中指定什么。 最佳答案 Gem::Specification.newdo|s|...s.executable='name_of_executable'...endhttp://docs.rubygems.org/read/chapter/20 关于ruby-在Ruby中编写命令行实用程序

我构建了两个需要相互通信和发送文件的Rails应用程序。例如,一个Rails应用程序会发送请求以查看其他应用程序数据库中的表。然后另一个应用程序将呈现该表的json并将其发回。我还希望一个应用程序将存储在其公共(public)目录中的文本文件发送到另一个应用程序的公共(public)目录。我从来没有做过这样的事情,所以我什至不知道从哪里开始。任何帮助,将不胜感激。谢谢! 最佳答案 无论Rails是什么,几乎所有Web应用程序都有您的要求,大多数现代Web应用程序都需要相互通信。但是有一个小小的理解需要你坚持下去,网站不应直接访问彼此

我尝试运行2.x应用程序。我使用rvm并为此应用程序设置其他版本的ruby:$rvmuseree-1.8.7-head我尝试运行服务器,然后出现很多错误:$script/serverNOTE:Gem.source_indexisdeprecated,useSpecification.Itwillberemovedonorafter2011-11-01.Gem.source_indexcalledfrom/Users/serg/rails_projects_terminal/work_proj/spohelp/config/../vendor/rails/railties/lib/r

刚入门rails,开始慢慢理解。有人可以解释或给我一些关于在application_controller中编码的好处或时间和原因的想法吗?有哪些用例。您如何为Rails应用程序使用应用程序Controller?我不想在那里放太多代码,因为据我了解,每个请求都会调用此Controller。这是真的? 最佳答案 ApplicationController实际上是您应用程序中的每个其他Controller都将从中继承的类(尽管这不是强制性的)。我同意不要用太多代码弄乱它并保持干净整洁的态度,尽管在某些情况下ApplicationContr

Sinatra新手;我正在运行一些rspec测试,但在日志中收到了一堆不需要的噪音。如何消除日志中过多的噪音?我仔细检查了环境是否设置为:test,这意味着记录器级别应设置为WARN而不是DEBUG。spec_helper:require"./app"require"sinatra"require"rspec"require"rack/test"require"database_cleaner"require"factory_girl"set:environment,:testFactoryGirl.definition_file_paths=%w{./factories./test/

我是一个Rails初学者,但我想从我的RailsView(html.haml文件)中查看Ruby变量的内容。我试图在ruby中打印出变量(认为它会在终端中出现),但没有得到任何结果。有什么建议吗?我知道Rails调试器,但更喜欢使用inspect来打印我的变量。 最佳答案 您可以在View中使用puts方法将信息输出到服务器控制台。您应该能够在View中的任何位置使用Haml执行以下操作:-puts@my_variable.inspect 关于ruby-on-rails-如何在我的R

我有两个Rails模型,即Invoice和Invoice_details。一个Invoice_details属于Invoice,一个Invoice有多个Invoice_details。我无法使用accepts_nested_attributes_forinInvoice通过Invoice模型保存Invoice_details。我收到以下错误:(0.2ms)BEGIN(0.2ms)ROLLBACKCompleted422UnprocessableEntityin25ms(ActiveRecord:4.0ms)ActiveRecord::RecordInvalid(Validationfa