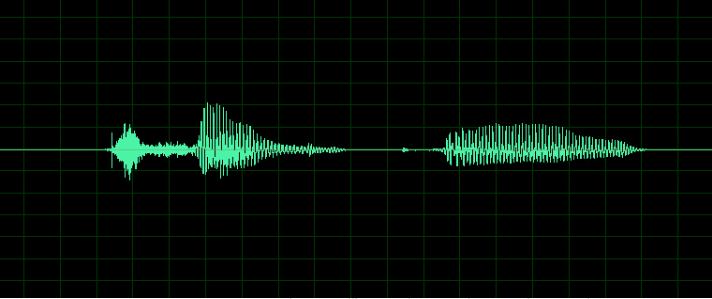

1.1 声音信号是一维的时域信号,无法观察出频率随时间的变化规律。

动态信号x(t): 是描述信号在不同时刻取值的函数, 其中t是自变量;

即横轴代表时间, 纵轴是信号的变化(振幅)。

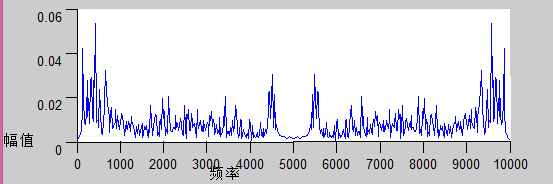

信号通过傅里叶变换把它变到频域上,可以看出信号的频率成分;

横轴代表各个频率成分, 纵轴: 信号的幅度值。

是一个时间平均(time average)概念。

简单地说,任何信号(当然要满足一定的数学条件),都可以通过傅立叶变换而分解成一个直流分量(也就是一个常数)和若干个(一般是无穷多个)正弦信号的和。

每个正弦分量都有自己的频率和幅值;

这样,以频率值作横轴,以幅值作纵轴,

把上述若干个正弦信号的幅值画在其所对应的频率上,就做出了信号的幅频分布图,也就是所谓频谱图 。

在实际使用中,频谱图有三种,即

其中, 对数振幅谱中各谱线的振幅都作了对数计算,所以其纵坐标的单位是dB(分贝), 这个变换的目的是使那些振幅较低的成分相对高振幅成分得以拉高,以便观察掩盖在低幅噪声中的周期信号。

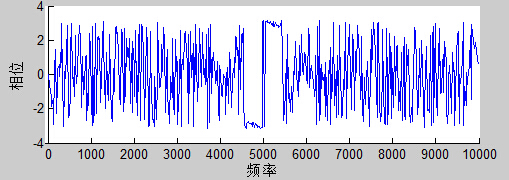

横坐标: 频率 ;

纵坐标: 相位;

功率谱可以从两方面来定义,

一个是自相关函数的傅立叶变换,第一种定义就是常说的维纳辛钦定理。

另一个是时域信号傅氏变换模平方然后除以时间长度。

第二种其实从能量谱密度来的。

根据parseval定理,信号傅氏变换模平方被定义为能量谱,能量谱密度在时间上平均就得到了功率谱。

功率谱的概念是针对功率有限信号的(能量有限信号可用能量谱分析),所表现的是单位频带内信号功率随频率的变换情况。保留频谱的幅度信息,但是丢掉了相位信息,所以频谱不同的信号其功率谱是可能相同的。

功率谱是随机过程的统计平均概念,平稳随机过程的功率谱是一个确定函数;而频谱是随机过程样本的Fourier变换,对于一个随机过程而言,频谱也是一个“随机过程”。(随机的频域序列)

功率概念和幅度概念的差别。此外,只能对宽平稳的各态历经的二阶矩过程谈功率谱,其存在性取决于二阶局是否存在并且二阶矩的Fourier变换收敛;而频谱的存在性仅仅取决于该随机过程的该样本的Fourier变换是否收敛。

在频域分析信号分两种:

(1).对确定性信号进行傅里叶变换,分析频谱信息。

(2).随机信号的傅里叶信号不存在,转向研究它的功率谱。随机信号的功率谱和自相关函数是傅里叶变换对(即维纳辛钦定理)。功率谱估计有很多种方法;

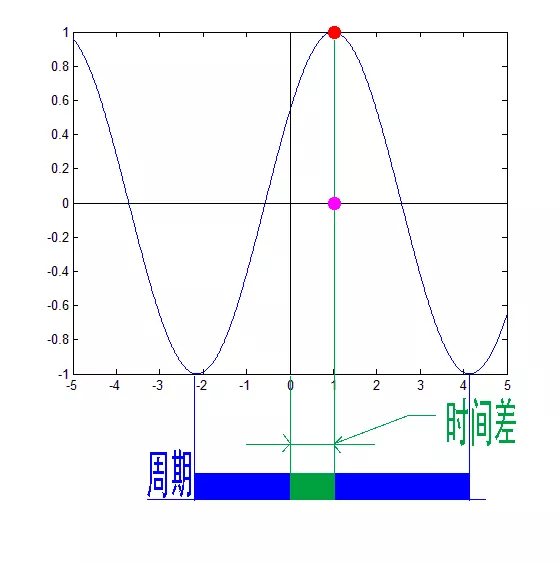

如下面静态图所示:

正弦波就是一个圆周运动在一条直线上的投影。

任意时刻的相位 为

ϕ

\phi

ϕ ;

任意时间的 幅度值: 振幅A × sin

ϕ

\phi

ϕ

sin = 对边/ 斜边;

对边 = sin × 斜边

如下图所示:

频域的基本单元也可以理解为一个始终在旋转的圆。

举例, 矩形波的 FFT过程:

任意波形FFT:

相位差 = (时间差 / 周期 ) × 2

π

\pi

π

图中, 小红点是距离频率轴最近的波峰, 我们将红色的点投影到下平面,投影点我们用粉色点来表示。当然,这些粉色的点只标注了波峰距离频率轴的距离,并不是相位。时间差并不是相位差。如果将全部周期看作2Π或者360度的话,相位差则是时间差在一个周期中所占的比例。我们将时间差除周期再乘 2Π,就得到了相位差。

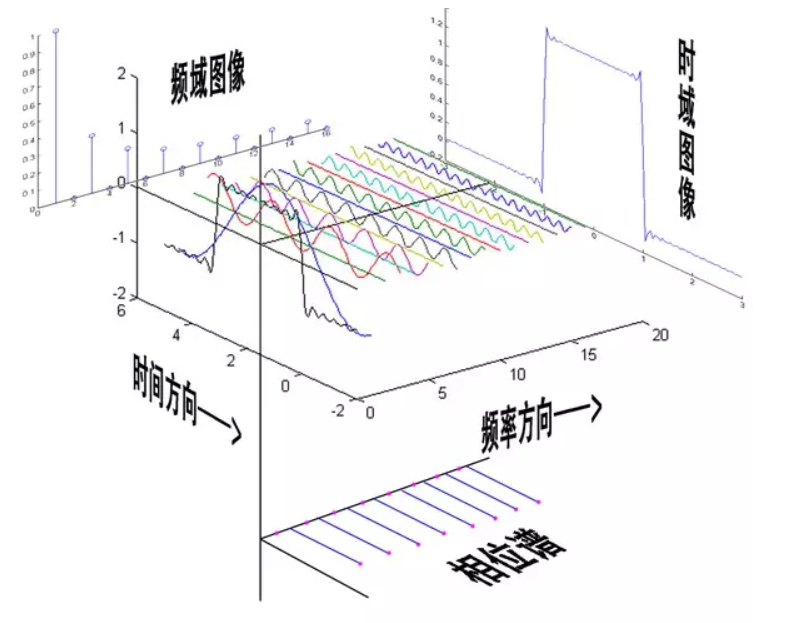

频谱虽然可以看出信号的频率分布, 但是丢失了时域信息,无法看出频率分布随时间的变化。

为了解决这个问题,很多时频域分析手段应运而生。

短时傅里叶,小波,Wigner分布等都是常用的时频域分析方法。

短时傅里叶变换,是对短时的信号做傅里叶变换。

短时的信号怎么得到? —> 是长时的信号分帧得来的。

python可以使用scipy库中的signal模块。

如果做STFT分解的音频信号(wav文件)的路径存在path变量中,可通过下面的代码得到STFT数据。

import wavio

import numpy as np

from scipy import signal

wav_struct=wavio.read(path)

wav=wav_struct.data.astype(float)/np.power(2,wav_struct.sampwidth*8-1)

[f,t,X]=signal.spectral.spectrogram(wav,np.hamming(1024),nperseg=1024,noverlap=0,detrend=False,return_onesided=True,mode='magnitude')

关于signal模块中spectrogram的使用方法和各个参数的具体意义,参见

https://docs.scipy.org/doc/scipy/reference/generated/scipy.signal.spectrogram.html#scipy.signal.spectrogram

本人是音乐爱好者,从小就特别喜欢那个随着音乐跳动的方框效果,就是这个:arduino上一大把对,我忍你很久了,我就想用mpy做,全网没有,行我自己研究。果然兴趣是最好的老师,我之前有篇博客专门讲音频,有兴趣的可以回顾一下。提到可视化频谱,必然绕不开fft,大学学过这玩意,当时一心玩,老师讲的一个字都么听进去,网上教程简略扫了一下,大该就是把时域转频域的工具,我大mpy居然没有fft函数,奶奶的,先放着。音频信息如何收集?第一种傻瓜式的ADC,模拟转数字,原始粗暴,第二种,I2S库,我之前博客有讲过,数据是PCM编码。然后又去学PCM编码,一学豁然开朗,舒服,以代码为例:audio_in=I2S

解决台式机麦克风不可用问题戴尔灵越3880最近因为需要开线上会议,发现戴尔台式机音频只有输出没有输入,也就是只能听见声音,无法输入声音。先后尝试了各种驱动安装更新之类的调试,无果。之后通过戴尔支持解决~这里多说一句,专业的就是专业,问题描述过去,直接给了解决方案,可能是他们遇到的相似问题比较多了,但也告诉我们,有些时候是可以通过这些官方服务解决问题的,比起自己折腾效率要高很多。那就记录一下吧~问题描述:电脑只能输出声音,不能输入声音。1、前提需要准备一只带麦克风的耳机,将耳机插入面板。2、先确定是否可以听到声音,可以通过播放歌曲或者视频。3、然后确认麦克风是否可用,可以通过调用win自带麦克风

以VSTiTriforce为例,由Tweakbench提供。当加载到市场上的任何VST主机时,它允许主机向VSTi发送(大概是MIDI)信号。然后VSTi将处理该信号并输出由VSTi内的软件乐器创建的合成音频。例如,将A4(我相信是MIDI音符)发送到VSTi会导致它合成高于中央C的A。它将音频数据发送回VST主机,然后它可以在我的扬声器上播放或将其保存为.wav或其他一些音频文件格式。假设我有Triforce,我正在尝试用我选择的语言编写一个程序,它可以通过发送要合成的A4纸条与VSTi交互,并自动将其保存到系统上的文件?最终,我希望能够解析整个单轨MIDI文件(使用已经可用于此

特性工作电压范围:6V-14V输出功率:7W(CLASSD,7.4V/4Ω,THD=10%)10W(CLASSD,9V/4Ω,THD=10%)18W(CLASSD,12V/4Ω,THD=10%)最高可达92%效率(12V/8Ω)电平设置工作模式无需输出滤波器差分输入优异的“上电,掉电”噪声抑制过流保护、过热保护、欠压保护 eSOP-8封装典型应用电路很简单:如下是本人的设计。 输入电阻:输入电阻主要是确定增益,即输出功率,所以一定要确定输入信号的幅度,喇叭的幅度,前后使用有效值计算。此设计搭配的喇叭是8R3W,额定功率3W,额定电压4.89V(有效值),最大功率4W。我们先确定输入信号的赋值,

做音频处理(虽然它也可以是图像处理)我有一个一维数字数组。(它们恰好是代表音频样本的16位有符号整数,这个问题同样适用于float或不同大小的整数。)为了匹配不同频率的音频(例如,将44.1kHz样本与22kHz样本混合),我需要拉伸(stretch)或压缩值数组以满足特定长度。将数组减半很简单:每隔一个样本丢弃一次。[231,8143,16341,2000,-9352,...]=>[231,16341,-9352,...]将数组宽度加倍稍微不那么简单:将每个条目加倍(或可选地在相邻的“真实”样本之间执行一些插值)。[231,8143,16341,2000,-9352,...]=>[2

我正在尝试实现一个具有两个输入channel和一个输出channel的ScriptProcessorNode。varsource=newArray(2);source[0]=context.createBufferSource();source[0].buffer=buffer[0];source[1]=context.createBufferSource();source[1].buffer=buffer[1];vartest=context.createScriptProcessor(4096,2,1);source[0].connect(test,0,0);source[1].c

我正在尝试在加载Javascriptaudio()对象时调用一个函数,但使用onload时它不起作用。myaud.onload=audioDone;但它正在使用image()对象。我怎样才能让它与audio()对象一起工作?谢谢 最佳答案 安元素有一组特定的事件称为mediaevents,和onload不是其中之一您可以使用canplaythrough检查音频是否已加载并可以播放。事件myaud.addEventListener('canplaythrough',audioDone,false);

我有一个音频元素varaudioSrc='https://mfbx9da4.github.io/assets/audio/dope-drum-loop_C_major.wav'varaudio=document.createElement('audio')audio.src=audioSrc我需要AudioBuffer做beatdetection所以我尝试在加载音频时访问缓冲区:audio.oncanplaythrough=()=>{console.info('loaded');varsource=context.createMediaElementSource(audio);sour

我有一个绑定(bind)到onClick事件的函数。它应该播放一首歌。如果有一首歌曲已经在播放,它应该停止当前歌曲并开始播放新歌曲。唯一的问题是,据我所知,只有一个pause方法,这意味着上一首歌曲将从暂停位置而不是开头继续播放。有什么办法解决这个问题(比如.stop()方法)吗?这是我的代码:varcurrSong="";functionplaySong(newSong){alert(newSong);if(newSong!=""){if(currSong!=""){document.getElementById(currSong).pause();}document.getElem

是否可以收听iframe中的youtube视频的音频,然后对其进行分析以用于基于网络音频api的可视化工具?从我的网站制作方式来看,我只能从iframe中获取源url。这是我的一个iframe的示例: 最佳答案 希望这对future的Google员工有所帮助。我发现这样做的唯一方法是使用音频流库(如节点的youtube-audio-stream)并从服务器端缓冲/传输音频。varexpress=require('express');varrouter=express.Router();varyoutubeStream=require