海康威视摄像头完成实时预览功能和抓拍功能

最近在新系统的研发中负责了视频监控模块的开发,项目监控设备全部采用海康的摄像头,枪机、球机都有,开发的过程中,有个需求是在前端页面上把摄像头画面进行平铺展示,最开始的方案是通过官方API完成,但是后面发现项目上所有的设备都是不联网的,所以只能转由SDK进行二次开发,这里使用的语言是JAVA,框架用的是SpringCloud。

关于大致的SDK调用流程、百度一大堆就不细说了,总结下来分成以下几小步:

1.加载dll函数库

2.初始化SDK:NET_DVR_Init();

3.设置摄像头IP、PORT、USERNAME、PWD信息进行设备登录操作:NET_DVR_Login_V40();

4.登陆成功后即可开始进行需要的操作,我的就是实时预览、抓拍。

5.操作完成后将刚才登录的设备注销:NET_DVR_Logout();

6.SDK使用完毕后,释放SDK资源:NET_DVR_Cleanup();

7.下班收工

根据上面的流程我依次贴出我的代码,至于如何成功导入SDK到项目,官网和SDK里都有说的,实在不行csdn也有很多教学。

@EnableCustomConfig

@EnableCustomSwagger2

@EnableRyFeignClients

@EnableConfigurationProperties

@SpringBootApplication(exclude = {DataSourceAutoConfiguration.class})

@Slf4j

public class Start_monitor_9500 {

public static void main(String[] args) {

SpringApplication.run(Start_monitor_9500.class, args);

}

/**

* 程序启动之初 初始化一次sdk即可 后续不用再重复初始化

*/

@PostConstruct

public void initSDK() {

new HCUtils().beforeInit();

}

}

举例说明:

通道01主码流:

rtsp://admin:test1234@172.6.22.106:554/h264/ch01/main/av_stream

通道01子码流:

rtsp://admin:test1234@172.6.22.106:554/h264/ch01/sub/av_stream

通道01第3码流:

rtsp://admin:test1234@172.6.22.106:554/h264/ch01/stream3/av_stream

IP通道01的主码流:

rtsp://admin:test1234@172.6.22.106:554/h264/ch33/main/av_stream

IP通道01的子码流:

rtsp://admin:test1234@172.6.22.106:554/h264/ch33/sub/av_stream

零通道主码流(零通道无子码流):

rtsp://admin:test1234@172.6.22.106:554/h264/ch0/main/av_stream

注:老版本URL,64路以下的NVR的IP通道的通道号从33开始,64路以及以上路数的NVR的IP通道的通道号从1开始。

上面是老版本的url拼接规则,这里用不到SDK,直接根据你的设备信息进行字符串拼接就好。

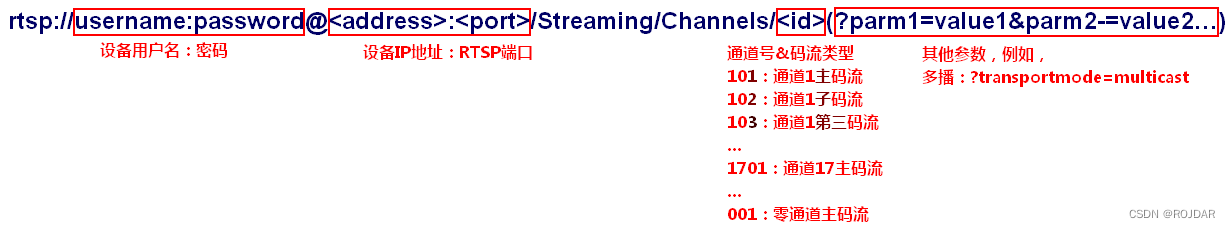

举例说明:

通道01主码流:

rtsp://admin:abc12345@172.6.22.234:554/Streaming/Channels/101?transportmode=unicast

通道01子码流:

rtsp://admin:abc12345@172.6.22.234:554/Streaming/Channels/102?transportmode=unicast(单播)

rtsp://admin:abc12345@172.6.22.106:554/Streaming/Channels/102?transportmode=multicast (多播)

rtsp://admin:abc12345@172.6.22.106:554/Streaming/Channels/102 (?后面可省略,默认单播)

通道01第3码流:

rtsp://admin:abc12345@172.6.22.234:554/Streaming/Channels/103?transportmode=unicast

零通道主码流(零通道无子码流):

rtsp://admin:12345@172.6.22.106:554/Streaming/Channels/001

注:新版本URL,通道号全部按顺序从1开始。

上面是新版本的拼接规则,至于到底是用老版本还是新版本,海康给的说法是都可以的,所以我直接用的老版本,并且我的项目中没有使用到录像机,全都是直连摄像头进行操作,所以我的通道号为01,拼完就是下面这样

rtsp://admin:CTUZB@swc123@192.168.200.192:554/h264/ch01/main/av_stream

如果想验证是否拼接正确,可以下载一个VLC播放器直接填写地址点击播放看有没有画面,VLC播放器有很多,百度一搜就行。

工具类,这个很重要,我的方法都丢在这里的

其中HCNetSDK是海康给出的官方的sdk资源类,成功导入SDK资源即可不会报错

import cn.com.guanfang.web.domain.AjaxResult;

import com.sun.jna.Native;

import com.sun.jna.ptr.IntByReference;

import lombok.extern.slf4j.Slf4j;

/**

* @ClassName: HCUtils

* @author: ROJDAR

* @CreateDate: 2022/9/28 15:07

* @Description: 海康对接相关函数

**/

@Slf4j

public class HCUtils {

/**

* 接口的实例,通过接口实例调用外部dll/so的函数

*/

public static HCNetSDK hCNetSDK = HCNetSDK.INSTANCE;

/**

* 全局的语音对讲句柄

*/

public static int g_lVoiceHandle;

/**

* 设备信息

*/

static HCNetSDK.NET_DVR_DEVICEINFO_V30 m_strDeviceInfo;

/**

* IP参数

*/

static HCNetSDK.NET_DVR_IPPARACFG m_strIpparaCfg;

/**

* 用户参数

*/

static HCNetSDK.NET_DVR_CLIENTINFO m_strClientInfo;

/**

* 是否在预览.

*/

boolean bRealPlay;

/**

* 已登录设备的IP地址

*/

String m_sDeviceIP;

/**

* 预览句柄

*/

int lPreviewHandle;

/**

* 回调预览时播放库端口指针

*/

IntByReference m_lPort;

/**

* 报警布防句柄

*/

int lAlarmHandle;

/**

* 报警监听句柄

*/

int lListenHandle;

/**

* 用户登录返回句柄(操作唯一id)

*/

static int lUserID;

int iErr = 0;

/**

* 动态库加载

*

* @return

*/

public static boolean CreateSDKInstance() {

if (hCNetSDK == null) {

synchronized (HCNetSDK.class) {

String strDllPath = "";

try {

//win系统加载库路径

if (osSelect.isWindows()) {

strDllPath = System.getProperty("user.dir") + "\\HCNetSDK.dll";

//Linux系统加载库路径

} else if (osSelect.isLinux()) {

strDllPath = "/home/hik/LinuxSDK/libhcnetsdk.so";

}

hCNetSDK = (HCNetSDK) Native.loadLibrary(strDllPath, HCNetSDK.class);

} catch (Exception ex) {

System.out.println("loadLibrary: " + strDllPath + " Error: " + ex.getMessage());

return false;

}

}

}

return true;

}

/**

* @param m_sDeviceIP 设备ip地址

* @param wPort 端口号,设备网络SDK登录默认端口8000

* @param m_sUsername 用户名

* @param m_sPassword 密码

*/

public Integer Login_V40(String m_sDeviceIP, short wPort, String m_sUsername, String m_sPassword) {

/* 注册 */

// 设备登录信息

HCNetSDK.NET_DVR_USER_LOGIN_INFO m_strLoginInfo = new HCNetSDK.NET_DVR_USER_LOGIN_INFO();

// 设备信息

HCNetSDK.NET_DVR_DEVICEINFO_V40 m_strDeviceInfo = new HCNetSDK.NET_DVR_DEVICEINFO_V40();

m_strLoginInfo.sDeviceAddress = new byte[HCNetSDK.NET_DVR_DEV_ADDRESS_MAX_LEN];

System.arraycopy(m_sDeviceIP.getBytes(), 0, m_strLoginInfo.sDeviceAddress, 0, m_sDeviceIP.length());

m_strLoginInfo.wPort = wPort;

m_strLoginInfo.sUserName = new byte[HCNetSDK.NET_DVR_LOGIN_USERNAME_MAX_LEN];

System.arraycopy(m_sUsername.getBytes(), 0, m_strLoginInfo.sUserName, 0, m_sUsername.length());

m_strLoginInfo.sPassword = new byte[HCNetSDK.NET_DVR_LOGIN_PASSWD_MAX_LEN];

System.arraycopy(m_sPassword.getBytes(), 0, m_strLoginInfo.sPassword, 0, m_sPassword.length());

// 是否异步登录:false- 否,true- 是

m_strLoginInfo.bUseAsynLogin = false;

// write()调用后数据才写入到内存中

m_strLoginInfo.write();

lUserID = hCNetSDK.NET_DVR_Login_V40(m_strLoginInfo, m_strDeviceInfo);

if (lUserID == -1) {

return lUserID;

} else {

// read()后,结构体中才有对应的数据

m_strDeviceInfo.read();

return lUserID;

}

}

/**

* 设备注销

*/

public AjaxResult Logout() {

if (lUserID >= 0) {

if (hCNetSDK.NET_DVR_Logout(lUserID) == false) {

return AjaxResult.error(1000, "注销失败,错误码为" + hCNetSDK.NET_DVR_GetLastError());

}

return AjaxResult.success("注销成功");

}

return AjaxResult.success("注销成功");

}

/**

* 开启实时预览

*

* @param lUserID

* @return

* @throws Exception

*/

public Integer startRealPlay(Integer lUserID) throws Exception {

HCNetSDK.NET_DVR_PREVIEWINFO previewInfo = new HCNetSDK.NET_DVR_PREVIEWINFO();

previewInfo.lChannel = 1;

previewInfo.dwStreamType = 0;

previewInfo.dwLinkMode = 5;

previewInfo.hPlayWnd = null;

previewInfo.bBlocked = 0;

previewInfo.bPassbackRecord = 0;

previewInfo.byPreviewMode = 0;

previewInfo.byProtoType = 1;

previewInfo.dwDisplayBufNum = 15;

previewInfo.write();

int realPlayV40 = hCNetSDK.NET_DVR_RealPlay_V40(lUserID, previewInfo, new FRealDataCallBack(), null);

if (realPlayV40 < 0) {

System.out.println("预览操作出错:" + hCNetSDK.NET_DVR_GetLastError());

throw new Exception();

}

return realPlayV40;

}

/**

* 停止实时预览

*

* @return nativeLong

* @author ROJDAR

*/

private void stopRealPlay(Integer lUserID) {

Boolean response = hCNetSDK.NET_DVR_StopRealPlay(lUserID);

if (!response) {

System.out.println("预览操作出错:" + hCNetSDK.NET_DVR_GetLastError());

}

}

/**

* 初始化

*/

public void init() {

//SDK初始化,一个程序只需要调用一次

boolean initSuc = HCNetSDK.INSTANCE.NET_DVR_Init();

if (initSuc != true) {

System.out.println("初始化失败");

}

//启动SDK写日志

HCNetSDK.INSTANCE.NET_DVR_SetLogToFile(3, "..\\sdkLog\\", false);

log.info("初始化sdk完成");

}

public void beforeInit() {

if (hCNetSDK == null) {

boolean b = CreateSDKInstance();

if (!b) {

log.error("SDK对象加载失败");

}

}

//linux系统建议调用以下接口加载组件库

if (osSelect.isLinux()) {

HCNetSDK.BYTE_ARRAY ptrByteArray1 = new HCNetSDK.BYTE_ARRAY(256);

HCNetSDK.BYTE_ARRAY ptrByteArray2 = new HCNetSDK.BYTE_ARRAY(256);

//这里是库的绝对路径,请根据实际情况修改,注意改路径必须有访问权限

String strPath1 = System.getProperty("user.dir") + "/lib/libcrypto.so.1.1";

String strPath2 = System.getProperty("user.dir") + "/lib/libssl.so.1.1";

System.arraycopy(strPath1.getBytes(), 0, ptrByteArray1.byValue, 0, strPath1.length());

ptrByteArray1.write();

hCNetSDK.NET_DVR_SetSDKInitCfg(3, ptrByteArray1.getPointer());

System.arraycopy(strPath2.getBytes(), 0, ptrByteArray2.byValue, 0, strPath2.length());

ptrByteArray2.write();

hCNetSDK.NET_DVR_SetSDKInitCfg(4, ptrByteArray2.getPointer());

String strPathCom = System.getProperty("user.dir") + "/lib";

HCNetSDK.NET_DVR_LOCAL_SDK_PATH struComPath = new HCNetSDK.NET_DVR_LOCAL_SDK_PATH();

System.arraycopy(strPathCom.getBytes(), 0, struComPath.sPath, 0, strPathCom.length());

struComPath.write();

hCNetSDK.NET_DVR_SetSDKInitCfg(2, struComPath.getPointer());

}

/*

2.初始化sdk

*/

init();

}

/**

* 抓拍图片

*

* @param imgPath 图片路径

* @param dvr 用户信息

*/

public AjaxResult getDVRPic(Device dvr, String imgPath) {

//登录设备

Integer isLogin = Login_V40(dvr.getIp(), dvr.getPort(), dvr.getUserName(), dvr.getPassWord());

// 返回一个用户编号,同时将设备信息写入devinfo

if (isLogin == -1) {

log.error("抓图时摄像头登录失败,错误码:{}", hCNetSDK.NET_DVR_GetLastError());

return AjaxResult.error(1000, "抓图时摄像头登录失败,错误码:" + hCNetSDK.NET_DVR_GetLastError());

}

HCNetSDK.NET_DVR_WORKSTATE_V30 devwork = new HCNetSDK.NET_DVR_WORKSTATE_V30();

//判断是否具有获取设备能力

if (!hCNetSDK.NET_DVR_GetDVRWorkState_V30(lUserID, devwork)) {

log.error("抓图时摄像头返回设备状态失败,错误码:{}", hCNetSDK.NET_DVR_GetLastError());

return AjaxResult.error(1000, "抓图时摄像头返回设备状态失败,错误码:{}" + hCNetSDK.NET_DVR_GetLastError());

}

/*

图片质量

*/

HCNetSDK.NET_DVR_JPEGPARA jpeg = new HCNetSDK.NET_DVR_JPEGPARA();

//设置图片分辨率

jpeg.wPicSize = 0;

//设置图片质量

jpeg.wPicQuality = 0;

/*

抓图

*/

String path = imgPath + System.currentTimeMillis() + ".jpeg";

boolean is = hCNetSDK.NET_DVR_CaptureJPEGPicture(lUserID, 01, jpeg, path);

if (!is) {

log.info("抓图失败,错误码:{}", hCNetSDK.NET_DVR_GetLastError());

return AjaxResult.error(1000, "抓图失败,错误码:" + hCNetSDK.NET_DVR_GetLastError());

}

//退出登录

hCNetSDK.NET_DVR_Logout(lUserID);

return AjaxResult.success(path);

}

}

第一个类:

import javax.servlet.AsyncContext;

import java.io.IOException;

import java.time.LocalDate;

public interface Converter {

String getKey();

String getUrl();

void addOutputStreamEntity(String key, AsyncContext entity) throws IOException;

void exit();

void start();

int respNum();

LocalDate obtainCreatedDate();

}

第二个类:

import com.alibaba.fastjson.util.IOUtils;

import lombok.extern.slf4j.Slf4j;

import org.bytedeco.ffmpeg.avcodec.AVPacket;

import org.bytedeco.ffmpeg.global.avcodec;

import org.bytedeco.ffmpeg.global.avutil;

import org.bytedeco.javacv.FFmpegFrameGrabber;

import org.bytedeco.javacv.FFmpegFrameRecorder;

import javax.servlet.AsyncContext;

import java.io.ByteArrayOutputStream;

import java.io.IOException;

import java.time.LocalDate;

import java.util.Iterator;

import java.util.List;

import java.util.Map;

import static org.bytedeco.ffmpeg.global.avutil.AV_LOG_ERROR;

/**

*

* 无须转码,更低的资源消耗,更低的延迟

* 确保流来源视频H264格式,音频AAC格式

*

*/

@Slf4j

public class ConverterFactories extends Thread implements Converter {

public volatile boolean runing = true;

private final LocalDate date = LocalDate.now();

private FFmpegFrameGrabber grabber;

private FFmpegFrameRecorder recorder;

private byte[] headers;

private ByteArrayOutputStream stream;

private String url;

private List<AsyncContext> outEntitys;

private String key;

private Map<String, Converter> factories;

public ConverterFactories(String url, String key, Map<String, Converter> factories, List<AsyncContext> outEntitys) {

this.url = url;

this.key = key;

this.factories = factories;

this.outEntitys = outEntitys;

}

@Override

public void run() {

//只打印错误日志

avutil.av_log_set_level(AV_LOG_ERROR);

boolean isCloseGrabberAndResponse = true;

try {

grabber = new FFmpegFrameGrabber(url);

if ("rtsp".equals(url.substring(0, 4))) {

grabber.setOption("rtsp_transport", "tcp");

grabber.setOption("stimeout", "5000000");

}

grabber.start();

if (avcodec.AV_CODEC_ID_H264 == grabber.getVideoCodec()

&& (grabber.getAudioChannels() == 0 || avcodec.AV_CODEC_ID_AAC == grabber.getAudioCodec())) {

// 来源视频H264格式,音频AAC格式

// 无须转码,更低的资源消耗,更低的延迟

log.info("开始从RTSP协议中取流:{}", url);

stream = new ByteArrayOutputStream();

recorder = new FFmpegFrameRecorder(stream, grabber.getImageWidth(), grabber.getImageHeight(),

grabber.getAudioChannels());

recorder.setInterleaved(true);

recorder.setVideoOption("preset", "ultrafast");

recorder.setVideoOption("tune", "zerolatency");

recorder.setVideoOption("crf", "25");

recorder.setFrameRate(grabber.getFrameRate());

recorder.setSampleRate(grabber.getSampleRate());

if (grabber.getAudioChannels() > 0) {

recorder.setAudioChannels(grabber.getAudioChannels());

recorder.setAudioBitrate(grabber.getAudioBitrate());

recorder.setAudioCodec(grabber.getAudioCodec());

}

recorder.setFormat("flv");

recorder.setVideoBitrate(grabber.getVideoBitrate());

recorder.setVideoCodec(grabber.getVideoCodec());

recorder.start(grabber.getFormatContext());

if (headers == null) {

headers = stream.toByteArray();

stream.reset();

writeResponse(headers);

}

long runTime,stopTime;

runTime = stopTime = System.currentTimeMillis();

while (runing) {

AVPacket k = grabber.grabPacket();

if (k != null) {

try {

recorder.recordPacket(k);

} catch (Exception ignored) {

}

if (stream.size() > 0) {

byte[] b = stream.toByteArray();

stream.reset();

writeResponse(b);

if (outEntitys.isEmpty()) {

// log.info("没有输出退出");

break;

}

}

avcodec.av_packet_unref(k);

runTime = System.currentTimeMillis();

} else {

stopTime = System.currentTimeMillis();

}

if ((stopTime - runTime) > 10000) {

break;

}

}

} else {

log.info("开始从RTSP协议中取流:{}", url);

isCloseGrabberAndResponse = false;

// 需要转码为视频H264格式,音频AAC格式

ConverterTranFactories c = new ConverterTranFactories(url, key, factories, outEntitys, grabber);

factories.put(key, c);

c.setName("flv-tran-[" + url + "]");

c.start();

}

} catch (Exception e) {

log.error(e.getMessage(), e);

} finally {

closeConverter(isCloseGrabberAndResponse);

completeResponse(isCloseGrabberAndResponse);

}

}

public void writeResponse(byte[] b) {

Iterator<AsyncContext> it = outEntitys.iterator();

while (it.hasNext()) {

AsyncContext o = it.next();

try {

o.getResponse().getOutputStream().write(b);

} catch (Exception e) {

// log.info("移除一个输出");

it.remove();

}

}

}

public void closeConverter(boolean isCloseGrabberAndResponse) {

if (isCloseGrabberAndResponse) {

IOUtils.close(grabber);

factories.remove(this.key);

}

IOUtils.close(recorder);

IOUtils.close(stream);

}

public void completeResponse(boolean isCloseGrabberAndResponse) {

if (isCloseGrabberAndResponse) {

for (AsyncContext o : outEntitys) {

o.complete();

}

}

}

@Override

public String getKey() {

return this.key;

}

@Override

public String getUrl() {

return this.url;

}

@Override

public void addOutputStreamEntity(String key, AsyncContext entity) throws IOException {

if (headers == null) {

outEntitys.add(entity);

} else {

entity.getResponse().getOutputStream().write(headers);

entity.getResponse().getOutputStream().flush();

outEntitys.add(entity);

}

}

@Override

public void exit() {

this.runing = false;

try {

this.join();

} catch (Exception e) {

log.error(e.getMessage(), e);

}

}

@Override

public int respNum() {

return outEntitys.size();

}

@Override

public LocalDate obtainCreatedDate() {

return date;

}

}

第三个类:

import com.alibaba.fastjson.util.IOUtils;

import lombok.extern.slf4j.Slf4j;

import org.bytedeco.ffmpeg.global.avcodec;

import org.bytedeco.ffmpeg.global.avutil;

import org.bytedeco.javacv.FFmpegFrameGrabber;

import org.bytedeco.javacv.FFmpegFrameRecorder;

import org.bytedeco.javacv.Frame;

import javax.servlet.AsyncContext;

import java.io.ByteArrayOutputStream;

import java.io.IOException;

import java.time.LocalDate;

import java.util.Iterator;

import java.util.List;

import java.util.Map;

import static org.bytedeco.ffmpeg.global.avutil.AV_LOG_ERROR;

/**

* 流来源不是视频H264格式,音频AAC格式 转码为视频H264格式,音频AAC格式

*/

@Slf4j

public class ConverterTranFactories extends Thread implements Converter {

public volatile boolean runing = true;

private final LocalDate date = LocalDate.now();

private FFmpegFrameGrabber grabber;

private FFmpegFrameRecorder recorder;

private byte[] headers;

private ByteArrayOutputStream stream;

private String url;

private List<AsyncContext> outEntitys;

private String key;

private Map<String, Converter> factories;

public ConverterTranFactories(String url, String key, Map<String, Converter> factories,

List<AsyncContext> outEntitys, FFmpegFrameGrabber grabber) {

this.url = url;

this.key = key;

this.factories = factories;

this.outEntitys = outEntitys;

this.grabber = grabber;

}

/**

* 转码函数

* 转码为视频H264格式,音频AAC格式

*/

@Override

public void run() {

//只打印错误日志

avutil.av_log_set_level(AV_LOG_ERROR);

try {

grabber.setFrameRate(25);

if (grabber.getImageWidth() > 1920) {

grabber.setImageWidth(1920);

}

if (grabber.getImageHeight() > 1080) {

grabber.setImageHeight(1080);

}

stream = new ByteArrayOutputStream();

recorder = new FFmpegFrameRecorder(stream, grabber.getImageWidth(), grabber.getImageHeight(),

grabber.getAudioChannels());

recorder.setInterleaved(true);

recorder.setVideoOption("preset", "ultrafast");

recorder.setVideoOption("tune", "zerolatency");

recorder.setVideoOption("crf", "25");

recorder.setVideoOption("colorspace", "bt709");

recorder.setVideoOption("color_range", "jpeg");

recorder.setGopSize(50);

recorder.setFrameRate(25);

recorder.setPixelFormat(tranFormat(grabber.getPixelFormat()));

recorder.setSampleRate(grabber.getSampleRate());

if (grabber.getAudioChannels() > 0) {

recorder.setAudioChannels(grabber.getAudioChannels());

recorder.setAudioBitrate(grabber.getAudioBitrate());

recorder.setAudioCodec(avcodec.AV_CODEC_ID_AAC);

}

recorder.setFormat("flv");

recorder.setVideoBitrate(grabber.getVideoBitrate());

recorder.setVideoCodec(avcodec.AV_CODEC_ID_H264);

recorder.start();

if (headers == null) {

headers = stream.toByteArray();

stream.reset();

writeResponse(headers);

}

long runTime, stopTime;

runTime = stopTime = System.currentTimeMillis();

while (runing) {

Frame f = grabber.grab();

if (f != null) {

try {

recorder.record(f);

} catch (Exception ignored) {

}

if (stream.size() > 0) {

byte[] b = stream.toByteArray();

stream.reset();

writeResponse(b);

if (outEntitys.isEmpty()) {

log.info("没有输出退出");

break;

}

}

runTime = System.currentTimeMillis();

} else {

stopTime = System.currentTimeMillis();

}

if ((stopTime - runTime) > 10000) {

break;

}

}

} catch (Exception e) {

log.error(e.getMessage(), e);

} finally {

closeConverter();

completeResponse();

log.info("RTSP取流正常关闭:{}", url);

factories.remove(this.key);

}

}

private int tranFormat(int format) {

switch (format) {

case avutil.AV_PIX_FMT_YUVJ420P: {

return avutil.AV_PIX_FMT_YUV420P;

}

case avutil.AV_PIX_FMT_YUVJ422P: {

return avutil.AV_PIX_FMT_YUV422P;

}

case avutil.AV_PIX_FMT_YUVJ444P: {

return avutil.AV_PIX_FMT_YUV444P;

}

case avutil.AV_PIX_FMT_YUVJ440P: {

return avutil.AV_PIX_FMT_YUV440P;

}

default: {

return avutil.AV_PIX_FMT_NONE;

}

}

}

public void writeResponse(byte[] b) {

Iterator<AsyncContext> it = outEntitys.iterator();

while (it.hasNext()) {

AsyncContext o = it.next();

try {

o.getResponse().getOutputStream().write(b);

} catch (Exception e) {

log.info("移除一个输出");

it.remove();

}

}

}

public void closeConverter() {

IOUtils.close(grabber);

IOUtils.close(recorder);

IOUtils.close(stream);

}

public void completeResponse() {

for (AsyncContext o : outEntitys) {

o.complete();

}

}

@Override

public String getKey() {

return this.key;

}

@Override

public String getUrl() {

return this.url;

}

@Override

public void addOutputStreamEntity(String key, AsyncContext entity) throws IOException {

if (headers == null) {

outEntitys.add(entity);

} else {

entity.getResponse().getOutputStream().write(headers);

entity.getResponse().getOutputStream().flush();

outEntitys.add(entity);

}

}

@Override

public void exit() {

this.runing = false;

try {

this.join();

} catch (Exception e) {

log.error(e.getMessage(), e);

}

}

@Override

public int respNum() {

return outEntitys.size();

}

@Override

public LocalDate obtainCreatedDate() {

return date;

}

}

controller层接口,注意这里的url就是rtsp地址,但是进行了BASE64的加密,所以你可以让前端把地址加密后传给你,也可以自己加密一下

/**

* 打开一个流转换

* base64加密后的流地址

*/

@GetMapping(value = "/monitor/live")

public void open2(String url, HttpServletResponse response,

HttpServletRequest request) {

itdMonitorService.open(new String(Base64.getDecoder().decode(url)), response, request);

}

service层:接口我就不贴了,你们自己根据impl的方法名创建一个就行

/**

* 通过rtsp协议取流播放视频

*

* @param url

* @param response

* @param request

*/

@Override

public void open(String url, HttpServletResponse response, HttpServletRequest request) {

String key = md5(url);

AsyncContext async = request.startAsync();

async.setTimeout(0);

if (converters.containsKey(key)) {

Converter c = converters.get(key);

try {

c.addOutputStreamEntity(key, async);

} catch (IOException e) {

log.error(e.getMessage(), e);

throw new IllegalArgumentException(e.getMessage());

}

} else {

List<AsyncContext> outs = Lists.newArrayList();

outs.add(async);

ConverterFactories c = new ConverterFactories(url, key, converters, outs);

c.setName("flv-[" + url + "]");

c.start();

converters.put(key, c);

}

// response.setContentType("video/x-flv");

response.setHeader("Connection", "keep-alive");

response.setStatus(HttpServletResponse.SC_OK);

try {

response.flushBuffer();

} catch (IOException e) {

log.error(e.getMessage(), e);

}

}

相关的pom.xml 注意不一样的系统下面的properties要改一改

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>javacv</artifactId>

<version>1.5.6</version>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>javacpp</artifactId>

<version>1.5.6</version>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>opencv</artifactId>

<version>4.5.3-1.5.6</version>

<classifier>${transcode-platform}</classifier>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>openblas</artifactId>

<version>0.3.17-1.5.6</version>

<classifier>${transcode-platform}</classifier>

</dependency>

<dependency>

<groupId>org.bytedeco</groupId>

<artifactId>ffmpeg</artifactId>

<version>4.4-1.5.6</version>

<classifier>${transcode-platform}</classifier>

</dependency>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

<!-- windows-x86_64 linux-x86_64-->

<transcode-platform>windows-x86_64</transcode-platform>

</properties>

到这里实时预览就完成了,很简单对不对,全靠CV就行 :)

下面贴出抓图的代码,需求是实时的根据前端的需要进行设备的抓图,ok fine ,前端是大哥,叫我抓就抓呗…

首先SDK接口的调用步骤和最开始说的是一样的,即:加载DLL库 >> 初始化SDK >> 登录设备 >> 抓图 >>注销设备 >> 释放SDK资源

但是我们在程序加载之初就已经初始化sdk和加载DLL库过了,所以直接开始登录然后抓图就行:

controller:

/**

* 设备抓图

* 通过设备序列号获取设备ip等信息,登录sdk后调取抓图接口,将抓取的图片直接保存到设置的地址

* @param serialNo

* @return 抓出的图片地址

*/

@GetMapping("/monitor/cutPic")

public AjaxResult cutPic(String serialNo) {

return itdMonitorService.cutPic(serialNo);

}

service同样只贴实现类:

/**

* 设备抓图:

* 通过设备序列号获取设备ip等信息,登录sdk后调取抓图接口,将抓取的图片直接保存到设置的地址

*

* @param serialNo 摄像头序列号

* @return 抓出的图片地址

*/

@Override

public AjaxResult cutPic(String serialNo) {

TDMonitor monitor = monitorMapper.findCameraInfoById(serialNo);

Device dvr = new Device(monitor.getCameraIP(), monitor.getUsername(), monitor.getPassword(), (short) 8000);

new HCUtils().getDVRPic(dvr, "E:\\pic\\");

return AjaxResult.success();

}

剩下的一些相关的实体类或者DTO、VO之类的:

设备登陆参数类:

import lombok.AllArgsConstructor;

import lombok.Data;

import lombok.NoArgsConstructor;

@Data

@AllArgsConstructor

@NoArgsConstructor

public class Device {

private String ip;

private String userName;

private String passWord;

private short port = 8000;

public String getIp() {

return ip;

}

public void setIp(String ip) {

this.ip = ip;

}

public String getUserName() {

return userName;

}

public void setUserName(String userName) {

this.userName = userName;

}

public String getPassWord() {

return passWord;

}

public void setPassWord(String passWord) {

this.passWord = passWord;

}

}

SDK回调函数:

package cn.com.guanfang.SDK;

import com.sun.jna.Pointer;

import com.sun.jna.ptr.ByteByReference;

import java.nio.ByteBuffer;

import static cn.com.guanfang.SDK.HCNetSDK.NET_DVR_STREAMDATA;

/**

* @ClassName: FRealDataCallBack

* @author: ROJDAR

* @CreateDate: 2022/10/8 16:36

* @Description: 回调类

**/

public class FRealDataCallBack implements HCNetSDK.FRealDataCallBack_V30 {

@Override

public void invoke(int lRealHandle, int dwDataType, ByteByReference pBuffer, int dwBufSize, Pointer pUser) {

switch (dwDataType) {

case NET_DVR_STREAMDATA://码流数据

long offset = 0;

ByteBuffer buffers = pBuffer.getPointer().getByteBuffer(offset, dwBufSize);

byte[] bytes = new byte[dwBufSize];

buffers.rewind();

buffers.get(bytes);

try {

//从map中取出对应的流读取数据

// outputStreamMap.get(lRealHandle).write(bytes);

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

DLL资源的加载

/**

* @author rojdar

*/

public class osSelect {

public static boolean isLinux() {

return System.getProperty("os.name").toLowerCase().contains("linux");

}

public static boolean isWindows() {

return System.getProperty("os.name").toLowerCase().contains("windows");

}

}

完工,如果发现代码有遗漏没有贴上来的可以评论或者私信我,我会补上的,还有这玩意儿写了我一上午,你们要是白嫖了还不给我点赞那你们和嫖完撒腿就跑不给钱的人有什么区别!!!

我发现ActiveRecord::Base.transaction在复杂方法中非常有效。我想知道是否可以在如下事务中从AWSS3上传/删除文件:S3Object.transactiondo#writeintofiles#raiseanexceptionend引发异常后,每个操作都应在S3上回滚。S3Object这可能吗?? 最佳答案 虽然S3API具有批量删除功能,但它不支持事务,因为每个删除操作都可以独立于其他操作成功/失败。该API不提供任何批量上传功能(通过PUT或POST),因此每个上传操作都是通过一个独立的API调用完成的

只是想确保我理解了事情。据我目前收集到的信息,Cucumber只是一个“包装器”,或者是一种通过将事物分类为功能和步骤来组织测试的好方法,其中实际的单元测试处于步骤阶段。它允许您根据事物的工作方式组织您的测试。对吗? 最佳答案 有点。它是一种组织测试的方式,但不仅如此。它的行为就像最初的Rails集成测试一样,但更易于使用。这里最大的好处是您的session在整个Scenario中保持透明。关于Cucumber的另一件事是您(应该)从使用您的代码的浏览器或客户端的角度进行测试。如果您愿意,您可以使用步骤来构建对象和设置状态,但通常您

在Rails自动生成的功能测试(test/functional/products_controller_test.rb)中,我看到以下代码:classProductsControllerTest我的问题是:方法调用products()在哪里/如何定义?products(:one)到底是什么意思?看代码,大概意思是“创建一个产品”,但是它是如何工作的呢?注意我是Ruby/Rails的新手,如果这些是微不足道的问题,我深表歉意。 最佳答案 如果您查看test/fixtures文件夹,您会看到一个products.yml文件。这是在您创建

在我的一些Controller中,我有一个before_filter检查用户是否登录?用于CRUD操作。application.rbdeflogged_in?unlesscurrent_userredirect_toroot_pathendendprivatedefcurrent_user_sessionreturn@current_user_sessionifdefined?(@current_user_session)@current_user_session=UserSession.findenddefcurrent_userreturn@current_userifdefine

三分钟集成Tap防沉迷SDK(Unity版)一、SDK介绍基于国家对上线所有游戏必须增加防沉迷功能的政策下,TapTap推出防沉迷SDK,供游戏开发者进行接入;允许未成年用户在周五、六、日以及法定节假日晚上8:00-9:00进行游戏,防沉谜时间段进入游戏会弹窗进行提示!开发环境要求:Unity2019.4或更高版本iOS10或更高版本Android5.0(APIlevel21)或更高版本🔗Unity集成Demo参考链接🔗UnityTapSDK功能体验APK下载链接二、集成前准备1.创建应用进入开发者后台,按照提示开始创建应用;2.开通服务在使用TDS实名认证和防沉迷服务之前,需要在上面创建的应

EC2会在实例停止然后重新启动时为其提供新的IP地址,因此我需要能够自动管理route53记录集,以便我可以一致地访问内容。遗憾的是,sdk的route53部分的文档远不如ec2的文档那么健壮(可以理解),所以我有点卡住了。到目前为止,从我所看到的情况来看,似乎change_resource_record_sets(link)是可行的方法,但我对:chages需要什么感到困惑>因为它提到了一个Change对象,但没有提供指向所述对象描述的链接。这是我的代码目前的样子:r53.client.change_resource_record_sets(:hosted_zone_id=>'MY_

require'pp'p*1..10这会打印出1-10。为什么这么简洁?您还可以用它做什么? 最佳答案 它是“splat”运算符。它可用于分解数组和范围并在赋值期间收集值。这里收集赋值中的值:a,*b=1,2,3,4=>a=1b=[2,3,4]在此示例中,内部数组([3,4])中的值被分解并收集到包含数组中:a=[1,2,*[3,4]]=>a=[1,2,3,4]您可以定义将参数收集到数组中的函数:deffoo(*args)pargsendfoo(1,2,"three",4)=>[1,2,"three",4]

我读过的关于Ruby符号的每一篇文章都在谈论符号相对于字符串的效率。但是,这不是1970年代。我的电脑可以处理一些额外的垃圾收集。我错了吗?我拥有最新最好的奔腾双核处理器和4GBRAM。我认为这应该足以处理一些字符串。 最佳答案 您的计算机可能能够处理“一点点额外的垃圾收集”,但是当“一点点”发生在运行数百万次的内部循环中时呢?如果它在内存有限的嵌入式系统上运行呢?有很多地方你可以随意使用字符串,但在某些地方你不能。这完全取决于上下文。 关于ruby-现代计算机的功能是否不足以处理字符串

我正在使用Windows并尝试运行一个现有的功能包,该功能包最初是在MacOS上构建的,这允许他们通过使用带空格的"\"来解决问题。我正在使用Ruby2.2.3和Cucumber。功能名称包含空格,我无法更改它。我尝试使用""和''来绕过空白,但每次都有同样的问题。这是问题的一个例子。如果我运行:cucumberfeatures/'Namecontainingwhitespaces.feature'它工作正常。但是当我运行时:cucumber-pmy_profile和cucumber.yml包含:my_profile:features/'Namecontainingwhitespace

单元测试的好方法是测试脚本在执行之间保持正确数据的能力——在使用Ctrl-C终止脚本然后重新运行之后?是否有针对执行类似操作的现有模块或脚本的任何测试可以针对最佳实践进行审查? 最佳答案 像http://avdi.org/devblog/2010/07/19/greenletters-painless-automation-and-testing-for-command-line-applications/一样使用库或者期望、运行、终止并重新运行您的程序,并检查它是否运行正确。好的做法是将程序设计为独立的模块,每个模块都经过良好测试