最近被选中做音视频,挺幸运的吧,一直在接触新的项目,每次都能被分到新的项目组,干好多费头发的事情😂

上周五肝到12点半,总算是把音频编辑上了线

总结了一下,决定写一写,也盘点一下遇到的坑

web audio API是 HTML5新增的API,提供了在web上控制音频的一个有效通用的系统,开发者可以自选音频源,对音频添加特效,添加空间效果,使音频可视化,等等。

注:目前这个API浏览器支持度并不高,pc浏览器支持较好的有firefox、Chrome和safari,Safari上也依然有不少兼容问题,移动端支持android5.0及以上,iOS端是6.1以上版本支持;

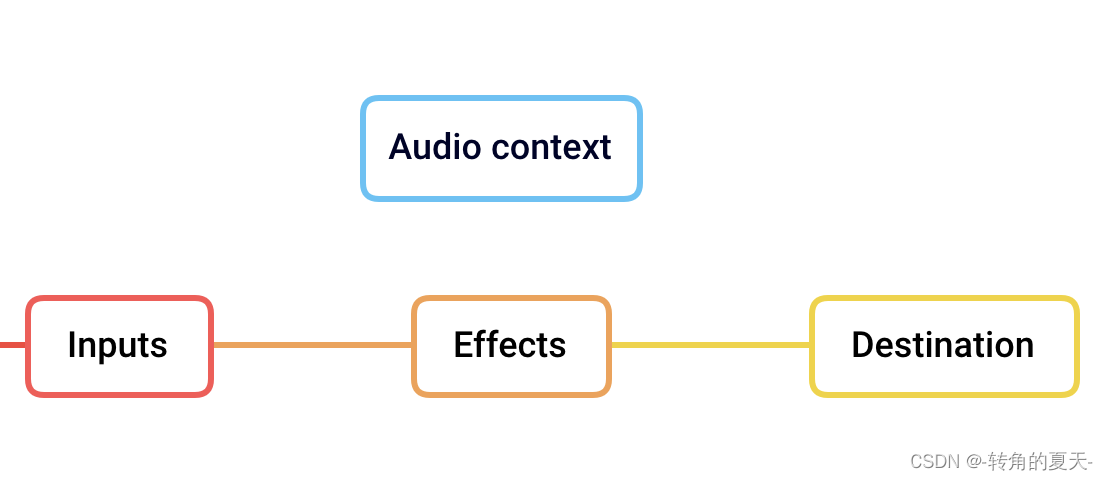

web audio 从获取数据到播放的过程大概如下图:

Inputs: audio的输入节点,可以是buffer,也可以是audio对象;

Effects:操控音频的节点(目前就用到这个:GainNode, 后续用到其他的再补充)GainNode可以用来控制音量大小,默认为静音,即0,也可以用来设置音频播放的淡入淡出;

Destination:音频播放节点,负责把声音传输给扬声器或耳机;

完整的web audio流程如下:

1. 获取音频文件,实例化一个音频对象;

2. 将获取到的音频文件转成ArrayBuffer;

3. 用ArrayBuffer ,通过AudioContext 实例化一个AudioBuffer对象;

4. 用createBufferSource() 创建一个bufferSource对象,将AudioBuffer 赋值给bufferSource.buffer;

5. 用connect()把bufferSource和GainNode连接,然后再连接到音频播放节点Destination,开始播放音频;

具体代码分析如下:

1. 实例化一个音频对象;

const AudioContext = window.AudioContext || (window.webkitAudioContext as AudioContext)

this.audioContext = new AudioContext()

2. 将获取到的音频文件转成ArrayBuffer;

上传音频文件可以直接通过input file来获取,将上传的音频文件解析后上传至服务器,获取到audioUrl,上传音频这里就不多做介绍了;

async function getAudioArrayBuffer(audioUrl: string): Promise<ArrayBuffer> {

const res = await fetch(audioUrl)

return res.arrayBuffer()

}

const arrayBuffer = await getAudioArrayBuffer(audioUrl)3. 用ArrayBuffer ,通过AudioContext 实例化一个AudioBuffer对象;

该方法涉及到一个兼容问题:iOS6上报错:Not enough arguments,iOS不知道是基于 promise 的decodeAudioData,所以此处需使用回调;

async function getAudioBuffer(arrayBuffer: ArrayBuffer, audioContext: AudioContext): Promise<AudioBuffer> {

let resolveFn

const promise = new Promise(resolve => resolveFn = resolve)

audioContext.decodeAudioData(arrayBuffer, resolveFn)

return promise as Promise<AudioBuffer>

}

this.audioBuffer = await getAudioBuffer(arrayBuffer, this.audioContext)4. 创建一个bufferSource对象,将AudioBuffer 赋值给bufferSource.buffer;然后用connect连接;

this.bufferSourceNode = this.audioContext.createBufferSource()

this.volumeGainNode = this.audioContext.createGain()

this.fadeGainNode = this.audioContext.createGain()

this.bufferSourceNode.buffer = this.audioBuffer

this.bufferSourceNode.connect(this.volumeGainNode)

this.volumeGainNode.connect(this.fadeGainNode)

this.fadeGainNode.connect(this.audioContext.destination)5. 接下来就可以开始播放了,播放前需设置音量和淡入淡出效果(如果是以默认值播放的话就不用,我这里涉及到操作,所以有预设值)

setVolume(value?: number) {

this.volume = value ?? this.volume

this.volumeGainNode?.gain?.value = this.volume / 100

}

setFadein() {

this.fadein = Math.min(this.fadein, this.audioDuration / 2, 5)

if (this.fadein === 0) return

const waveArray = new Float32Array(2)

waveArray[0] = 0.001

waveArray[1] = 1

this.fadeGainNode?.gain?.setValueCurveAtTime(waveArray, this.currentTime, this.fadein)

}

setFadeout() {

this.fadeout = Math.min(this.fadeout, this.audioDuration / 2, 5)

if (this.fadeout === 0) return

const waveArray = new Float32Array(2)

waveArray[0] = 1

waveArray[1] = 0.001

this.fadeGainNode?.gain?.setValueCurveAtTime(waveArray, this.currentTime + this.audioDuration - this.fadeout + 0.001, this.fadeout)

}

play() {

if (!this.audioContext) return

this.setVolume()

this.setFadein()

this.setFadeout()

// 暂停后的播放

this.audioContext.resume()

// 设置播放开始时间startTime,有就设置,没有就不设置,默认为0,如需跳转至某个时间点播放,则需设置startTime值

this.bufferSourceNode?.start(this.currentTime, this.startTime, this.audioDuration);

}

pause() {

if (!this.isPlaying) return

// 暂停音频上下文中的时间进程,暂停音频硬件访问并减少进程中的CPU/电池使用

this.audioContext?.suspend()

}

resume() {

if (this.isPlaying) return

this.audioContext?.resume()

this.isPlaying = true

}这样的话一个基础的播放就实现了。

我有一个用户工厂。我希望默认情况下确认用户。但是鉴于unconfirmed特征,我不希望它们被确认。虽然我有一个基于实现细节而不是抽象的工作实现,但我想知道如何正确地做到这一点。factory:userdoafter(:create)do|user,evaluator|#unwantedimplementationdetailshereunlessFactoryGirl.factories[:user].defined_traits.map(&:name).include?(:unconfirmed)user.confirm!endendtrait:unconfirmeddoenden

华为OD机试题本篇题目:明明的随机数题目输入描述输出描述:示例1输入输出说明代码编写思路最近更新的博客华为od2023|什么是华为od,od薪资待遇,od机试题清单华为OD机试真题大全,用Python解华为机试题|机试宝典【华为OD机试】全流程解析+经验分享,题型分享,防作弊指南华为o

C#实现简易绘图工具一.引言实验目的:通过制作窗体应用程序(C#画图软件),熟悉基本的窗体设计过程以及控件设计,事件处理等,熟悉使用C#的winform窗体进行绘图的基本步骤,对于面向对象编程有更加深刻的体会.Tutorial任务设计一个具有基本功能的画图软件**·包括简单的新建文件,保存,重新绘图等功能**·实现一些基本图形的绘制,包括铅笔和基本形状等,学习橡皮工具的创建**·设计一个合理舒适的UI界面**注明:你可能需要先了解一些关于winform窗体应用程序绘图的基本知识,以及关于GDI+类和结构的知识二.实验环境Windows系统下的visualstudio2017C#窗体应用程序三.

MIMO技术的优缺点优点通过下面三个增益来总体概括:阵列增益。阵列增益是指由于接收机通过对接收信号的相干合并而活得的平均SNR的提高。在发射机不知道信道信息的情况下,MIMO系统可以获得的阵列增益与接收天线数成正比复用增益。在采用空间复用方案的MIMO系统中,可以获得复用增益,即信道容量成倍增加。信道容量的增加与min(Nt,Nr)成正比分集增益。在采用空间分集方案的MIMO系统中,可以获得分集增益,即可靠性性能的改善。分集增益用独立衰落支路数来描述,即分集指数。在使用了空时编码的MIMO系统中,由于接收天线或发射天线之间的间距较远,可认为它们各自的大尺度衰落是相互独立的,因此分布式MIMO

遍历文件夹我们通常是使用递归进行操作,这种方式比较简单,也比较容易理解。本文为大家介绍另一种不使用递归的方式,由于没有使用递归,只用到了循环和集合,所以效率更高一些!一、使用递归遍历文件夹整体思路1、使用File封装初始目录,2、打印这个目录3、获取这个目录下所有的子文件和子目录的数组。4、遍历这个数组,取出每个File对象4-1、如果File是否是一个文件,打印4-2、否则就是一个目录,递归调用代码实现publicclassSearchFile{publicstaticvoidmain(String[]args){//初始目录Filedir=newFile("d:/Dev");Datebeg

通常,数组被实现为内存块,集合被实现为HashMap,有序集合被实现为跳跃列表。在Ruby中也是如此吗?我正在尝试从性能和内存占用方面评估Ruby中不同容器的使用情况 最佳答案 数组是Ruby核心库的一部分。每个Ruby实现都有自己的数组实现。Ruby语言规范只规定了Ruby数组的行为,并没有规定任何特定的实现策略。它甚至没有指定任何会强制或至少建议特定实现策略的性能约束。然而,大多数Rubyist对数组的性能特征有一些期望,这会迫使不符合它们的实现变得默默无闻,因为实际上没有人会使用它:插入、前置或追加以及删除元素的最坏情况步骤复

在ruby中,你可以这样做:classThingpublicdeff1puts"f1"endprivatedeff2puts"f2"endpublicdeff3puts"f3"endprivatedeff4puts"f4"endend现在f1和f3是公共(public)的,f2和f4是私有(private)的。内部发生了什么,允许您调用一个类方法,然后更改方法定义?我怎样才能实现相同的功能(表面上是创建我自己的java之类的注释)例如...classThingfundeff1puts"hey"endnotfundeff2puts"hey"endendfun和notfun将更改以下函数定

我目前有一个reddit克隆类型的网站。我正在尝试根据我的用户之前喜欢的帖子推荐帖子。看起来K最近邻或k均值是执行此操作的最佳方法。我似乎无法理解如何实际实现它。我看过一些数学公式(例如k表示维基百科页面),但它们对我来说并没有真正意义。有人可以推荐一些伪代码,或者可以查看的地方,以便我更好地了解如何执行此操作吗? 最佳答案 K最近邻(又名KNN)是一种分类算法。基本上,您采用包含N个项目的训练组并对它们进行分类。如何对它们进行分类完全取决于您的数据,以及您认为该数据的重要分类特征是什么。在您的示例中,这可能是帖子类别、谁发布了该项

我查看了Stripedocumentationonerrors,但我仍然无法正确处理/重定向这些错误。基本上无论发生什么,我都希望他们返回到edit操作(通过edit_profile_path)并向他们显示一条消息(无论成功与否)。我在edit操作上有一个表单,它可以POST到update操作。使用有效的信用卡可以正常工作(费用在Stripe仪表板中)。我正在使用Stripe.js。classExtrasController5000,#amountincents:currency=>"usd",:card=>token,:description=>current_user.email)

虽然1.8.7的构建我似乎有一个向后移植的Shellwords::shellescape版本,但我知道该方法是1.9的一个特性,在1.8的早期版本中绝对不支持.有谁知道我在哪里可以找到(以Gem形式或仅作为片段)针对Ruby转义的Bourne-shell命令的强大独立实现? 最佳答案 您也可以从shellwords.rb中复制您想要的内容。在Ruby的颠覆存储库的主干中(即GPLv2'd):defshellescape(str)#Anemptyargumentwillbeskipped,soreturnemptyquotes.ret