OpenGL 学习教程

Android OpenGL ES 学习(一) – 基本概念

Android OpenGL ES 学习(二) – 图形渲染管线和GLSL

Android OpenGL ES 学习(三) – 绘制平面图形

Android OpenGL ES 学习(四) – 正交投影

Android OpenGL ES 学习(五) – 渐变色

Android OpenGL ES 学习(六) – 使用 VBO、VAO 和 EBO/IBO 优化程序

Android OpenGL ES 学习(七) – 纹理

Android OpenGL ES 学习(八) –矩阵变换

Android OpenGL ES 学习(九) – 坐标系统和。实现3D效果

Android OpenGL ES 学习(十) – GLSurfaceView 源码解析GL线程以及自定义 EGL

Android OpenGL ES 学习(十一) –渲染YUV视频以及视频抖音特效

代码工程地址: https://github.com/LillteZheng/OpenGLDemo.git

更多音视频,参考:Android 音视频入门/进阶教程

这是OpenGL 最后一篇教程了,待我把C/Jni/Ndk 相关的知识,再深入一遍,再来学习光照等知识。

前面我们学习了OpenGL是如何渲染 YUV 视频的Android OpenGL ES 学习(十一) –渲染YUV视频以及视频抖音特效 ,这一章,我们让OpenGL 与 MediaCodec 结合,实现解析 H264 文件,并实现抖音效果。效果如下:

MediaCodec 为Android 的硬编,在一些快速解码设备,我们都是使用MediaCodec,如果你对 MediaCodec 如何解码不熟悉,可以先阅读

Android 音视频编解码(一) – MediaCodec 初探

Android 音视频编解码(二) – MediaCodec 解码(同步和异步)

实际工作中,我们也会使用 MediaCodec 把其他设备传输过来的码流,通过与 OpenGL 结合,实现解码和滤镜效果,比如投屏,投屏的基础上,加一些滤镜和特效。

OpenGL 与 MediaCodec 结合,需要 OpenGL 提供一个 Surface ,让MediaCodec 把解码出来的 YUV 渲染出来,而这个 Surface 就是 SurfaceTexure

SurfaceTexture 是 Surface 与 OpenGL ES 的结合 ,与传统的纹理(GL_TEXTURE_2D)不同,它有以下特点:

SurfaceTexture实例包括检索时间戳的getTimeStamp()方法和检索变换矩阵的getTransformMatrix()方法。调用updateTexImage()设置时间戳和转换矩阵

当你创建了SurfaceTexture ,也会创建一个待消耗的BufferQueue,当生产方(比如 MediaCodec )有新的缓冲数据加入队列,会回调 onFrameAvailable() 方法,表示已经消化了一帧。

当你调用了 updateTexImage() ,会释放当前的缓冲区,并从BufferQueue 拿到最新的缓冲区,这时会调用 EGL 的一些操作,使 GLES 可以将缓冲区作为外部纹理使用,即告知 OpenGL ,当前缓冲区可用,可进行一些操作。

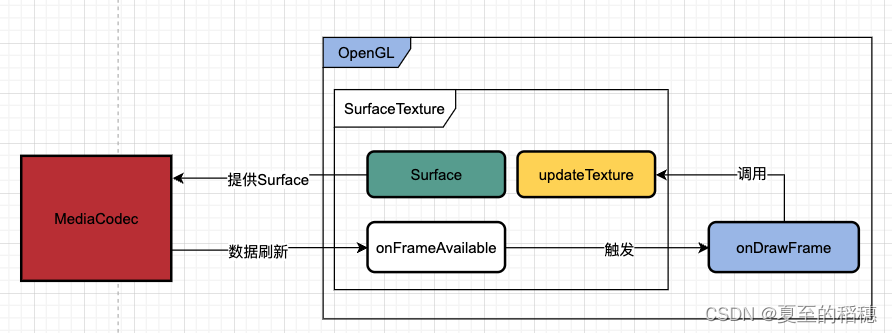

从上面的了解,我们可以得出MediaCodec , SurfaceTexture 和 OpenGL 结合的关系:

流程如下:

OpenGL 的外部纹理,使用的是GLES11Ext中的 samplerExternalOES:

uniform samplerExternalOES ourTexture;

因此,我们的片段着色器可以修改成:

/**

* 片段着色器

*/

private var FRAGMENT_SHADER = """#version 300 es

precision mediump float;

out vec4 FragColor;

in vec2 vTexture;

uniform samplerExternalOES ourTexture;

void main() {

FragColor = texture(ourTexture,vTexture);

}

"""

纹理的绑定,需要注意的是使用 GLES11Ext :

GLES30.glGenTextures(1, textures, 0)

GLES30.glBindTexture(GLES11Ext.GL_TEXTURE_EXTERNAL_OES, textures[0])

//纹理环绕

GLES30.glTexParameteri(

GLES11Ext.GL_TEXTURE_EXTERNAL_OES,

GLES30.GL_TEXTURE_WRAP_S,

GLES30.GL_REPEAT

)

GLES30.glTexParameteri(

GLES11Ext.GL_TEXTURE_EXTERNAL_OES,

GLES30.GL_TEXTURE_WRAP_T,

GLES30.GL_REPEAT

)

//纹理过滤

GLES30.glTexParameteri(

GLES11Ext.GL_TEXTURE_EXTERNAL_OES,

GLES30.GL_TEXTURE_MIN_FILTER,

GLES30.GL_LINEAR

)

GLES30.glTexParameteri(

GLES11Ext.GL_TEXTURE_EXTERNAL_OES,

GLES30.GL_TEXTURE_MAG_FILTER,

GLES30.GL_LINEAR

)

//解绑纹理对象

GLES30.glBindTexture(GLES11Ext.GL_TEXTURE_EXTERNAL_OES, 0)

然后创建 SurfaceTexture:

surfaceTexture = SurfaceTexture(textures[0]).apply {

setDefaultBufferSize(width, height)

setOnFrameAvailableListener {

}

}

Mediacodec 解码H264比较简单,配置解码的属性,使用异步解码即可,不熟悉Mediacodec可以参考:

Android 音视频编解码(一) – MediaCodec 初探

Android 音视频编解码(二) – MediaCodec 解码(同步和异步)

解码代码如下:

/**

* @author by zhengshaorui 2022/12/26

* describe:视频解码

*/

class VideoDncoder {

companion object {

internal val instance: VideoDncoder by lazy { VideoDncoder() }

private const val MSG_INIT = 1;

private const val MSG_QUERY = 2;

private const val DECODE_NAME = "video/avc"

private const val TAG = "VideoEncoder"

}

private var handleThread: HandlerThread? = null

private var handler: Handler? = null

private var surface: Surface? = null

private var decoder: MediaCodec? = null

private val indexQueue = LinkedBlockingDeque<Int>();

private val handlerCallback = Handler.Callback { msg ->

when (msg.what) {

MSG_INIT -> {

configAndStart()

}

MSG_QUERY -> {

// handler?.sendEmptyMessageDelayed(MSG_QUERY, 10)

}

}

false

}

private var listener: IDecoderListener? = null

fun start(surface: Surface, iDecoderListener: IDecoderListener) {

listener = iDecoderListener

this.surface = surface

if (handleThread == null) {

handleThread = HandlerThread("VideoEncoder").apply {

start()

handler = Handler(this.looper, handlerCallback)

}

}

handler?.let {

it.removeMessages(MSG_INIT)

it.sendEmptyMessage(MSG_INIT)

}

}

/**

* 喂数据

*/

fun feedData(buffer: ByteArray, offset: Int, length: Int) {

val index = indexQueue.take()

if (index != -1) {

decoder?.let {

it.getInputBuffer(index)?.apply {

clear()

val time = System.nanoTime() / 1000000

put(buffer, offset, length)

it.queueInputBuffer(index, 0, length, time, 0)

}

}

}

}

private fun configAndStart() {

var width = getRealWidth(MainApplication.context)

var height = getRealHeight(MainApplication.context)

if (null == surface || !surface!!.isValid || width < 1 || height < 1) {

throw IllegalArgumentException("Some argument is invalid");

}

Log.d(TAG, "configAndStart() called: $width,$height")

decoder = MediaCodec.createDecoderByType(DECODE_NAME)

val format = MediaFormat()

format.setString(MediaFormat.KEY_MIME, DECODE_NAME)

format.setInteger(MediaFormat.KEY_WIDTH, width)

format.setInteger(MediaFormat.KEY_HEIGHT, height)

decoder?.let {

it.reset()

it.configure(format, surface, null, 0)

it.setCallback(decodeCallback)

it.start()

Log.d(TAG, "解码器启动成功")

listener?.onReady()

handler?.sendEmptyMessage(MSG_QUERY)

}

}

public interface IDecoderListener {

fun onReady()

}

private val decodeCallback = object : MediaCodec.Callback() {

override fun onInputBufferAvailable(codec: MediaCodec, index: Int) {

indexQueue.add(index)

}

override fun onOutputBufferAvailable(

codec: MediaCodec,

index: Int,

info: MediaCodec.BufferInfo

) {

decoder?.releaseOutputBuffer(index, true)

}

override fun onError(codec: MediaCodec, e: MediaCodec.CodecException) {

Log.e(TAG, "onError() called with: codec = $codec, e = $e")

}

override fun onOutputFormatChanged(codec: MediaCodec, format: MediaFormat) {

var width = format.getInteger(MediaFormat.KEY_WIDTH)

if (format.containsKey("crop-left") && format.containsKey("crop-right")) {

width = format.getInteger("crop-right") + 1 - format.getInteger("crop-left")

}

var height = format.getInteger(MediaFormat.KEY_HEIGHT)

if (format.containsKey("crop-top") && format.containsKey("crop-bottom")) {

height = format.getInteger("crop-bottom") + 1 - format.getInteger("crop-top")

}

Log.d(TAG, "视频解码后的宽高:$width,$height")

}

}

fun release() {

handleThread?.quitSafely()

handleThread = null

handler = null

surface?.release()

try {

decoder?.let {

it.stop()

it.release()

}

} catch (e: Exception) {

}

}

}

接下来就是解析H264文件了,需要注意的是,喂给解码器的数据,要以一帧的结尾,不然会出现数据错乱,花屏的问题,如果你对H264不熟悉,可参考 Android 音视频编解码(三) – 视频编码和H264格式原理讲解

因此,我们读取H264每一帧的数据,然后一帧一帧喂给解码器,H264解析的简单代码如下:

/**

* @author by zhengshaorui 2022/12/28

* describe:H264 帧解析类

*/

class H264ParseThread(val inputStream: InputStream, val listener: IFrameListener) : Thread() {

companion object {

private const val TAG = "H264Parse"

//一般H264帧大小不超过200k,如果解码失败可以尝试增大这个值

private const val FRAME_MAX_LEN = 300 * 1024

private const val P_FRAME = 0x01

private const val I_FRAME = 0x05

private const val SPS = 0x07

private const val PPS = 0x08

}

private var isFinish = false

public interface IFrameListener {

fun onLog(msg: String)

fun onFrame(byteArray: ByteArray, offset: Int, count: Int)

}

override fun run() {

super.run()

try {

isFinish = false

val header = ByteArray(4)

val formatLength = getHeaderFormatLength(header, inputStream)

if (formatLength < 0) {

listener.onLog("不符合H264文件规范: $formatLength")

return

}

//帧数组

val frame = ByteArray(FRAME_MAX_LEN)

//每次读取的数据

val readData = ByteArray(2 * 1024)

//把头部信息给到 frame

System.arraycopy(header, 0, frame, 0, header.size)

//开始肯定是 sps,所以,帧的起始位置为0,由于前面读取了头部,偏移量为4

var frameLen = 4

while (!isFinish) {

val readLen = inputStream.read(readData)

if (readLen < 0) {

//文件末尾

listener.onLog("文件末尾,退出")

isFinish = true

return

}

if (frameLen + readLen > FRAME_MAX_LEN) {

//文件末尾

listener.onLog("文件末尾,大于预留数组,退出")

isFinish = true

return

}

//先把数据拷贝到帧数组

System.arraycopy(readData, 0, frame, frameLen, readLen)

//修改当前帧的大小

frameLen += readLen

//寻找第一帧

var firstHeadIndex = findHeader(frame, 0, frameLen)

while (firstHeadIndex >= 0) {

//找第二帧,从第一帧之后的间隔开始找

val secondFrameIndex =

findHeader(frame, firstHeadIndex + 100, frameLen)

if (secondFrameIndex > 0) {

//找到第二帧

listener.onFrame(frame, firstHeadIndex, secondFrameIndex - firstHeadIndex)

//把第二帧的数组数据,拷贝到前面,方便继续寻找下一帧

val temp = frame.copyOfRange(secondFrameIndex, frameLen)

System.arraycopy(temp, 0, frame, 0, temp.size)

//帧下表指向第二帧的数据

frameLen = temp.size

//继续寻找下一帧

firstHeadIndex = findHeader(frame, 0, frameLen)

} else {

//没有找到,继续循环去找

firstHeadIndex = -1

}

}

}

} catch (e: Exception) {

listener.onLog("read file fail: $e")

}

}

fun release() {

isFinish = true

}

private fun findHeader(data: ByteArray, offset: Int, count: Int): Int {

for (i in offset until count) {

if (isFrameHeader(data, i)) {

return i

}

}

return -1

}

private fun isFrameHeader(data: ByteArray, index: Int): Boolean {

if (data.size < 5) {

return false

}

val d1 = data[index].toInt() == 0

val d2 = data[index + 1].toInt() == 0

val isNaluHeader = d1 && d2

if (isNaluHeader && data[index + 2].toInt() == 1 && isFrameHeadType(data[index + 3])){

return true

}else if (isNaluHeader && data[index + 2].toInt() == 0 && data[index + 3].toInt() == 1 && isFrameHeadType(data[index + 4])){

return true

}

return false

}

/**

* 解析的时候,找到I和P去解析即可

* 为啥使用and这个会导致播放卡顿?有大佬可以解释一下吗

*/

private fun isSpecialFrame(byte: Byte): Boolean {

val type = byte.toInt() and 0x11

return type == P_FRAME || type == I_FRAME || type == SPS || type == PPS

}

/**

* 65 -- I帧/IDR帧

* 41/61 -- p帧

* 67 -- sps

* 68 -- pps

*

*/

fun isFrameHeadType(head: Byte): Boolean {

// val type = byte.toInt() and 0x11

return head == 0x65.toByte() || head == 0x61.toByte()

|| head == 0x41.toByte() || head == 0x67.toByte()

|| head == 0x68.toByte() || head == 0x06.toByte()

}

private fun getHeaderFormatLength(header: ByteArray, inputStream: InputStream): Int {

//先读取头部4个字节,判断h264 是哪种格式

if (header.size < 4) {

return -1

}

inputStream.read(header)

val h1 = header[0].toInt()

val h2 = header[1].toInt()

val h3 = header[2].toInt()

val h4 = header[3].toInt()

//码流格式类型00 00 01 或者 00 00 00 01

return if (h1 == 0 && h2 == 0 && h3 == 1) {

3

} else if (h1 == 0 && h2 == 0 && h3 == 0 && h4 == 1) {

4

} else {

//不符合H264文件规范

-1

}

}

}

综上,拿到H264数据后,直接丢给解码器:

decoder = VideoDncoder().apply {

surfaceTexture = SurfaceTexture(textures[0]).apply {

setDefaultBufferSize(width, height)

setOnFrameAvailableListener {

}

}

start(Surface(surfaceTexture), object : VideoDncoder.IDecoderListener {

override fun onReady() {

readFile()

}

})

}

/**

* 读取文件

*/

private fun readFile() {

val stream = context.resources.assets.open("video.h264")

h264ParseThread = H264ParseThread(stream, object : H264ParseThread.IFrameListener {

override fun onLog(msg: String) {

Log.d(TAG, "H264ParseThread msg: $msg")

}

override fun onFrame(byteArray: ByteArray, offset: Int, count: Int) {

decoder?.feedData(byteArray, offset, count)

Thread.sleep(55)

}

})

h264ParseThread?.start()

}

onDrawFrame 那里,更新缓冲区,updateTexImage:

override fun onDrawFrame(gl: GL10?) {

//步骤1:使用glClearColor设置的颜色,刷新Surface

GLES30.glClear(GLES30.GL_COLOR_BUFFER_BIT)

surfaceTexture?.updateTexImage()

GLES30.glBindTexture(GLES11Ext.GL_TEXTURE_EXTERNAL_OES, textures[0])

GLES30.glBindVertexArray(vao[0])

GLES30.glDrawElements(GLES30.GL_TRIANGLE_STRIP, 6, GLES30.GL_UNSIGNED_INT, 0)

}

记得释放:

private fun release() {

h264ParseThread?.release()

h264ParseThread = null

decoder?.release()

decoder = null

surfaceTexture?.release()

surfaceTexture = null

}

这样,我们就完成 Mediacodec 和 OpenGL 的结合,实现了H264的解析。

从Android OpenGL ES 学习(十一) –渲染YUV视频以及视频抖音特效 知道,滤镜是对 rgb 的基础上,添加一些效果。

所以,在片段着色器拿到 rgb 的数据后,我们也能实现一些滤镜效果,如灰色:

#version 300 es

precision mediump float;

out vec4 FragColor;

in vec2 vTexture;

uniform samplerExternalOES ourTexture;

void main() {

vec4 temColor = texture(ourTexture,vTexture);

float gray = temColor.r * 0.2126 + temColor.g * 0.7152 + temColor.b * 0.0722;

FragColor = vec4(gray,gray,gray,1.0);

}

其他效果,参考工程。

至此,OpenGL 教程,就暂时告一段了。

参考:

https://source.android.google.cn/docs/core/graphics/arch-st

我有一个字符串input="maybe(thisis|thatwas)some((nice|ugly)(day|night)|(strange(weather|time)))"Ruby中解析该字符串的最佳方法是什么?我的意思是脚本应该能够像这样构建句子:maybethisissomeuglynightmaybethatwassomenicenightmaybethiswassomestrangetime等等,你明白了......我应该一个字符一个字符地读取字符串并构建一个带有堆栈的状态机来存储括号值以供以后计算,还是有更好的方法?也许为此目的准备了一个开箱即用的库?

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

我正在使用ruby1.9解析以下带有MacRoman字符的csv文件#encoding:ISO-8859-1#csv_parse.csvName,main-dialogue"Marceu","Giveittohimóhe,hiswife."我做了以下解析。require'csv'input_string=File.read("../csv_parse.rb").force_encoding("ISO-8859-1").encode("UTF-8")#=>"Name,main-dialogue\r\n\"Marceu\",\"Giveittohim\x97he,hiswife.\"\

简而言之错误:NOTE:Gem::SourceIndex#add_specisdeprecated,useSpecification.add_spec.Itwillberemovedonorafter2011-11-01.Gem::SourceIndex#add_speccalledfrom/opt/local/lib/ruby/site_ruby/1.8/rubygems/source_index.rb:91./opt/local/lib/ruby/gems/1.8/gems/rails-2.3.8/lib/rails/gem_dependency.rb:275:in`==':und

目录前言滤波电路科普主要分类实际情况单位的概念常用评价参数函数型滤波器简单分析滤波电路构成低通滤波器RC低通滤波器RL低通滤波器高通滤波器RC高通滤波器RL高通滤波器部分摘自《LC滤波器设计与制作》,侵权删。前言最近需要学习放大电路和滤波电路,但是由于只在之前做音乐频谱分析仪的时候简单了解过一点点运放,所以也是相当从零开始学习了。滤波电路科普主要分类滤波器:主要是从不同频率的成分中提取出特定频率的信号。有源滤波器:由RC元件与运算放大器组成的滤波器。可滤除某一次或多次谐波,最普通易于采用的无源滤波器结构是将电感与电容串联,可对主要次谐波(3、5、7)构成低阻抗旁路。无源滤波器:无源滤波器,又称

最近在学习CAN,记录一下,也供大家参考交流。推荐几个我觉得很好的CAN学习,本文也是在看了他们的好文之后做的笔记首先是瑞萨的CAN入门,真的通透;秀!靠这篇我竟然2天理解了CAN协议!实战STM32F4CAN!原文链接:https://blog.csdn.net/XiaoXiaoPengBo/article/details/116206252CAN详解(小白教程)原文链接:https://blog.csdn.net/xwwwj/article/details/105372234一篇易懂的CAN通讯协议指南1一篇易懂的CAN通讯协议指南1-知乎(zhihu.com)视频推荐CAN总线个人知识总

深度学习部署:Windows安装pycocotools报错解决方法1.pycocotools库的简介2.pycocotools安装的坑3.解决办法更多Ai资讯:公主号AiCharm本系列是作者在跑一些深度学习实例时,遇到的各种各样的问题及解决办法,希望能够帮助到大家。ERROR:Commanderroredoutwithexitstatus1:'D:\Anaconda3\python.exe'-u-c'importsys,setuptools,tokenize;sys.argv[0]='"'"'C:\\Users\\46653\\AppData\\Local\\Temp\\pip-instal

动漫制作技巧是很多新人想了解的问题,今天小编就来解答与大家分享一下动漫制作流程,为了帮助有兴趣的同学理解,大多数人会选择动漫培训机构,那么今天小编就带大家来看看动漫制作要掌握哪些技巧?一、动漫作品首先完成草图设计和原型制作。设计草图要有目的、有对象、有步骤、要形象、要简单、符合实际。设计图要一致性,以保证制作的顺利进行。二、原型制作是根据设计图纸和制作材料,可以是手绘也可以是3d软件创建。在此步骤中,要注意的问题是色彩和平面布局。三、动漫制作制作完成后,加工成型。完成不同的表现形式后,就要对设计稿进行加工处理,使加工的难易度降低,并得到一些基本准确的概念,以便于后续的大样、准确的尺寸制定。四、

2022/8/4更新支持加入水印水印必须包含透明图像,并且水印图像大小要等于原图像的大小pythonconvert_image_to_video.py-f30-mwatermark.pngim_dirout.mkv2022/6/21更新让命令行参数更加易用新的命令行使用方法pythonconvert_image_to_video.py-f30im_dirout.mkvFFMPEG命令行转换一组JPG图像到视频时,是将这组图像视为MJPG流。我需要转换一组PNG图像到视频,FFMPEG就不认了。pyav内置了ffmpeg库,不需要系统带有ffmpeg工具因此我使用ffmpeg的python包装p

Transformers开始在视频识别领域的“猪突猛进”,各种改进和魔改层出不穷。由此作者将开启VideoTransformer系列的讲解,本篇主要介绍了FBAI团队的TimeSformer,这也是第一篇使用纯Transformer结构在视频识别上的文章。如果觉得有用,就请点赞、收藏、关注!paper:https://arxiv.org/abs/2102.05095code(offical):https://github.com/facebookresearch/TimeSformeraccept:ICML2021author:FacebookAI一、前言Transformers(VIT)在图