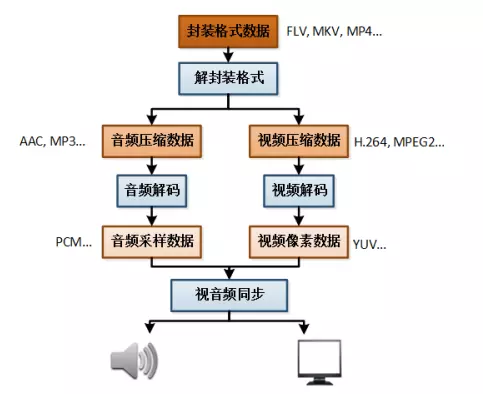

解码如下图所示,将H.264数据解码为YUV。

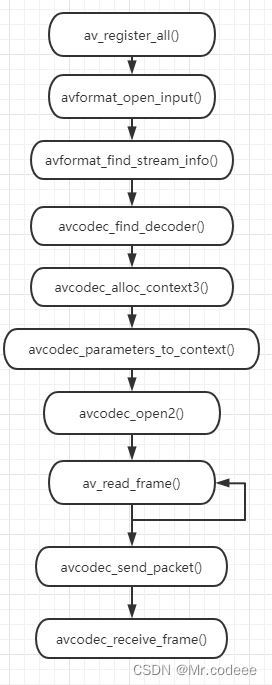

2.1 在使用FFmpeg API之前,需要先注册API,然后才能使用API。当然,新版本的库不需要再调用下面的方法。

av_register_all()2.2 构建输入AVFormatContext

声明输入的封装结构体,通过输入文件或者流地址作为封装结构的句柄。

AVFormatContext* ifmt_ctx = NULL;

const char* inputUrl = "test.mp4";

///打开输入的流

int ret = avformat_open_input(&ifmt_ctx, inputUrl, NULL, NULL);

if (ret != 0)

{

printf("Couldn't open input stream.\n");

return -1;

}2.3查找音视频流信息,通过下面的接口与AVFormatContext中建立输入文件对应的流信息。

//查找;

if (avformat_find_stream_info(inputFmtCtx, NULL) < 0)

{

printf("Couldn't find stream information.\n");

return -1;

}

2.4查找解码器

先找到视频流索引,找到视频流,根据视频流的codec_id找到解码器。

//找到视频流索引

int video_index = av_find_best_stream(ifmt_ctx, AVMEDIA_TYPE_VIDEO, -1, -1, NULL, 0);

AVStream* st = ifmt_ctx->streams[video_index];

AVCodec* codec = nullptr;

//找到解码器

codec = avcodec_find_decoder(st->codecpar->codec_id);

if (!codec)

{

fprintf(stderr, "Codec not found\n");

exit(1);

}2.5申请AVCodecContenxt

//申请AVCodecContext

AVCodecContext* codec_ctx = nullptr;

codec_ctx = avcodec_alloc_context3(codec);

if (!codec_ctx)

{

exit(1);

}2.6同步AVCodecParameters

FFmpeg在解码时获取的相关编码信息,首先存储到AVCodecParameters中,然后对AVCodecParameters中存储的信息进行解析与处理,为了兼容,将AVCodecParameters的参数同步到AVCodecContext中。

avcodec_parameters_to_context(codec_ctx, ifmt_ctx->streams[video_index]->codecpar);2.7打开解码器

解码器参数设置完成后,就需要打开解码器

//打开解码器

if ((ret = avcodec_open2(codec_ctx, codec, NULL) < 0))

{

return -1;

}2.8然后通过while循环,不停的读取数据

av_read_frame(ifmt_ctx, pkt)2.9帧解码

通过下面两个接口解码,获取到解码后的帧数据。

avcodec_send_packet(codec_ctx, pkt);

avcodec_receive_frame(codec_ctx, frame);此源码演示解码后的数据保存到本地,以yuv为结尾的文件。

#include "pch.h"

#include <iostream>

extern "C"

{

#include "libavformat/avformat.h"

#include "libavutil/dict.h"

#include "libavutil/opt.h"

#include "libavutil/timestamp.h"

#include "libswscale/swscale.h"

#include "libswresample/swresample.h"

#include "libavutil/imgutils.h"

};

int main()

{

//av_register_all();

avformat_network_init();

AVFormatContext* ifmt_ctx = NULL;

const char* inputUrl = "test.mp4";

///打开输入的流

int ret = avformat_open_input(&ifmt_ctx, inputUrl, NULL, NULL);

if (ret != 0)

{

printf("Couldn't open input stream.\n");

return -1;

}

//查找流信息

if (avformat_find_stream_info(ifmt_ctx, NULL) < 0)

{

printf("Couldn't find stream information.\n");

return -1;

}

//找到视频流索引

int video_index = av_find_best_stream(ifmt_ctx, AVMEDIA_TYPE_VIDEO, -1, -1, NULL, 0);

AVStream* st = ifmt_ctx->streams[video_index];

AVCodec* codec = nullptr;

//找到解码器

codec = avcodec_find_decoder(st->codecpar->codec_id);

if (!codec)

{

fprintf(stderr, "Codec not found\n");

exit(1);

}

//申请AVCodecContext

AVCodecContext* codec_ctx = nullptr;

codec_ctx = avcodec_alloc_context3(codec);

if (!codec_ctx)

{

exit(1);

}

avcodec_parameters_to_context(codec_ctx, ifmt_ctx->streams[video_index]->codecpar);

//打开解码器

if ((ret = avcodec_open2(codec_ctx, codec, NULL) < 0))

{

return -1;

}

AVPacket* pkt = av_packet_alloc();

//av_init_packet(pkt);

AVFrame *frame = av_frame_alloc();

while (av_read_frame(ifmt_ctx, pkt) >= 0)

{

if (pkt->stream_index == video_index)

{

int ret = avcodec_send_packet(codec_ctx, pkt);

if (ret >= 0)

{

ret = avcodec_receive_frame(codec_ctx, frame);

if (ret == AVERROR(EAGAIN) || ret == AVERROR_EOF)

{

break;

}

else if (ret < 0)

{

break;

}

switch (codec_ctx->pix_fmt)

{

case AV_PIX_FMT_YUV420P:

{

int size = av_image_get_buffer_size(AV_PIX_FMT_YUV420P, frame->width, frame->height, 1);

uint8_t* yuvbuf = (uint8_t*)av_malloc(size);

int i, j, k = 0;

for (i = 0; i < frame->height; i++)

{

memcpy(yuvbuf + frame->width * i, frame->data[0] + frame->linesize[0] * i, frame->width);

}

for (j = 0; j < frame->height / 2; j++)

{

memcpy(yuvbuf + frame->width * i + frame->width / 2 * j,frame->data[1] + frame->linesize[1] * j,frame->width / 2);

}

for (k = 0; k < frame->height / 2; k++)

{

memcpy(yuvbuf + frame->width * i + frame->width / 2 * j + frame->width / 2 * k,frame->data[2] + frame->linesize[2] * k,frame->width / 2);

}

char fileName[20] = { 0 };

sprintf(fileName, "img/%d.yuv", codec_ctx->frame_number);

FILE* f;

f = fopen(fileName, "wb");

fwrite(yuvbuf,1, size,f);

fclose(f);

av_free(yuvbuf);

}

break;

default:

return -1;

}

}

}

}

avcodec_close(codec_ctx);

avcodec_free_context(&codec_ctx);

avformat_close_input(&ifmt_ctx);

av_frame_free(&frame);

av_packet_free(&pkt);

return 0;

}

动漫制作技巧是很多新人想了解的问题,今天小编就来解答与大家分享一下动漫制作流程,为了帮助有兴趣的同学理解,大多数人会选择动漫培训机构,那么今天小编就带大家来看看动漫制作要掌握哪些技巧?一、动漫作品首先完成草图设计和原型制作。设计草图要有目的、有对象、有步骤、要形象、要简单、符合实际。设计图要一致性,以保证制作的顺利进行。二、原型制作是根据设计图纸和制作材料,可以是手绘也可以是3d软件创建。在此步骤中,要注意的问题是色彩和平面布局。三、动漫制作制作完成后,加工成型。完成不同的表现形式后,就要对设计稿进行加工处理,使加工的难易度降低,并得到一些基本准确的概念,以便于后续的大样、准确的尺寸制定。四、

2022/8/4更新支持加入水印水印必须包含透明图像,并且水印图像大小要等于原图像的大小pythonconvert_image_to_video.py-f30-mwatermark.pngim_dirout.mkv2022/6/21更新让命令行参数更加易用新的命令行使用方法pythonconvert_image_to_video.py-f30im_dirout.mkvFFMPEG命令行转换一组JPG图像到视频时,是将这组图像视为MJPG流。我需要转换一组PNG图像到视频,FFMPEG就不认了。pyav内置了ffmpeg库,不需要系统带有ffmpeg工具因此我使用ffmpeg的python包装p

Transformers开始在视频识别领域的“猪突猛进”,各种改进和魔改层出不穷。由此作者将开启VideoTransformer系列的讲解,本篇主要介绍了FBAI团队的TimeSformer,这也是第一篇使用纯Transformer结构在视频识别上的文章。如果觉得有用,就请点赞、收藏、关注!paper:https://arxiv.org/abs/2102.05095code(offical):https://github.com/facebookresearch/TimeSformeraccept:ICML2021author:FacebookAI一、前言Transformers(VIT)在图

我正在尝试使用以下代码通过将ffmpeg实用程序作为子进程运行并获取其输出并解析它来确定视频分辨率:IO.popen'ffmpeg-i'+path_to_filedo|ffmpegIO|#myparsegoeshereend...但是ffmpeg输出仍然连接到标准输出并且ffmepgIO.readlines是空的。ffmpeg实用程序是否需要一些特殊处理?或者还有其他方法可以获得ffmpeg输出吗?我在WinXP和FedoraLinux下测试了这段代码-结果是一样的。 最佳答案 要跟进mouviciel的评论,您需要使用类似pope

目前我正在使用这个正则表达式从YoutubeURL中提取视频ID:url.match(/v=([^&]*)/)[1]我怎样才能改变它,以便它也可以从这个没有v参数的YoutubeURL获取视频ID:http://www.youtube.com/user/SHAYTARDS#p/u/9/Xc81AajGUMU感谢阅读。编辑:我正在使用ruby1.8.7 最佳答案 对于Ruby1.8.7,这就可以了。url_1='http://www.youtube.com/watch?v=8WVTOUh53QY&feature=feedf'url

我有一个使用postgresql的Rails4应用程序。我还有一个backbone.js应用程序,可将JSON推送到Rails4应用程序。这是我的Controller:defcreate@product=Product.new(ActiveSupport::JSON.decodeproduct_params)respond_todo|format|if@product.saveformat.json{renderaction:'show',status::created,location:@product}elseformat.json{renderjson:@product.erro

我运行的是OSX,对视频转换一无所知。但我有大约200个视频都是mp4格式,无法在Firefox中播放。我需要将它们转换为ogg才能使用html5视频标签。这些文件位于一个文件夹结构中,这使得一次一个地处理一个文件变得困难。我希望bash命令或Ruby命令遍历所有子文件夹并找到所有.mp4并转换它们。我找到了一份关于如何使用Google执行此操作的引用资料:http://athmasagar.wordpress.com/2011/05/12/a-bash-script-to-convert-mp4-files-to-oggogv/#!/bin/bashforfin$(ls*mp4|se

一、什么是web项目ui自动化测试?通过测试工具模拟人为操控浏览器,使软件按照测试人员的预定计划自动执行测试的一种方式,可以完成许多手工测试无法完成或者不易实现的繁琐工作。正确使用自动化测试,可以更全面的对软件进行测试,从而提高软件质量进而缩短迭代周期。二、构建测试用例的“九部曲”(一)创建流程包划分功能模块日常测试活动中,都会根据功能模块进行拆分,所以在设计器中我们可以通过创建流程包的方式来拆分需要测试的功能模块,如下图中操作创建一个电脑流程包并且取名为对应的功能模块名称,如果有多个功能模块就创建多个对应的流程包,实在RPA设计器有易用的图形可视化界面,方便管理较多的功能模块。(二)在流程包

目录需求基于JavaCV跨平台执行ffmpeg命令[^1]坑一内存不足坑二多个ffmpeg进程并行导致IO负载大,进而导致ioerror?坑三使用Java操作ffmpeg时,有时会卡死坑四Process的waitFor死锁问题及解决办法需求给透明背景的视频自动叠加一张背景图片基于JavaCV跨平台执行ffmpeg命令1我测试发现的本需求的最小依赖:dependency>groupId>org.bytedecogroupId>artifactId>ffmpeg-platform-gplartifactId>version>5.0-1.5.7version>dependency>核心代码:Stri

摘要本论文主要论述了如何使用Python技术开发一个短视频智能推荐,本系统将严格按照软件开发流程进行各个阶段的工作,采用B/S架构,面向对象编程思想进行项目开发。在引言中,作者将论述短视频智能推荐的当前背景以及系统开发的目的,后续章节将严格按照软件开发流程,对系统进行各个阶段分析设计。 短视频智能推荐的主要使用者分为管理员和用户,实现功能包括管理员:首页、个人中心、用户管理、热门视频管理、用户上传管理、系统管理,用户:首页、个人中心、用户上传管理、我的收藏管理,前台首页;首页、热门视频、用户上传、公告信息、个人中心、后台管理等功能。由于本网站的功能模块设计比较全面,所以使得整个短视频智能推荐信