前段时间,很荣幸能参加云栖大会,并分享交流一个议题,接下来我们来回顾一下

这次给大家带来的题目是《小米大数据运维管理体系的建设和实践》

今天整个分享分两部分,第一部分我们先来聊聊大数据运维数字化转型相关的内容 看看运维层面如何做到化繁为简,打造极致效率的;

紧接着第二部分,会给大家介绍一下小米大数据的技术架构 大家可以从中了解到小米怎样应对海量数据挑战的。

为了帮助大家理解,我们先来简单聊一聊小米服务的架构

整个业务架构按照云计算的分层模型来说分为三层,依次是iass层、pass层、sass层

小米的iass层是一个混合云的现状,涉及IDC、公有云、网络等资源

小米的saas层不仅包含战略业务手机 * IOT * 汽车,还包括互联网、电商等数百个业务线

大数据作为pass层的一员,向下对接基础资源,向上承接业务的数据需求

提供离线报表、实时数仓等多种场景化能力

进一步帮助业务沉淀数据资产,提升整体数据效率

同时,大数据是的集团数字化底座,起到中流砥柱的作用

我们再来看下小米服务架构

整个小米的大数据服务是立足于x86和ecs之上的自下而上分为4层,依次是数据采集层、数据存储层、数据计算层、数据平台层

数据采集层:主要使用自研的LCS和以Talos为代表的消息队列组合去实现的,这一块也会在后面的分享中展开讲述

数据存储层:各类开源和自研存储引擎,包含我们的文件存储HDFS、KV存储HBase、对象存储Ceph等等;其中Pegasus是小米自研的,目前在apache已经开源。

数据计算层:小米使用Yarn作为统一的资源管理,基于Yarn之上提供了批处理、流处理多种计算引擎,比如我们常见的MapReduce、Spark、Flink等;除此之外提供丰富的Olap引擎, 满足即席查询和检索需求。

数据平台层:我们内部称之为数据工场,主要提供一站式的数据开发和数据管理能力

小米大数据业务发展非常迅速,已经覆盖国内海外多个区域

现已达到千+集群,数万节点的规模,在存储总量上已经近EB,计算任务30w/天

如此数据规模,给服务运维带来了很多挑战,接下来,我们重点聊一聊

运维成本高:传统运维方案和服务快速发展间的摩擦越来越多,导致运维成本呈墒增趋势,表现在质量、成本、效率各方面

服务生命周期断层:大数据服务场景多、差异大,进一步增加了运维复杂度

数据孤岛问题导致数据效率难以达到最佳状态

运维层面呈经验型单核心发展,导致流程多落地难

识别到问题后我们内部经过充分讨论,结合小米长期处于混合云的状态,发起了大数据运维中台-轻舟的整体规划

轻舟的主线是通过建设通用的基线能力、打造极致的垂域能力,来彻底贯通服务的生命周期

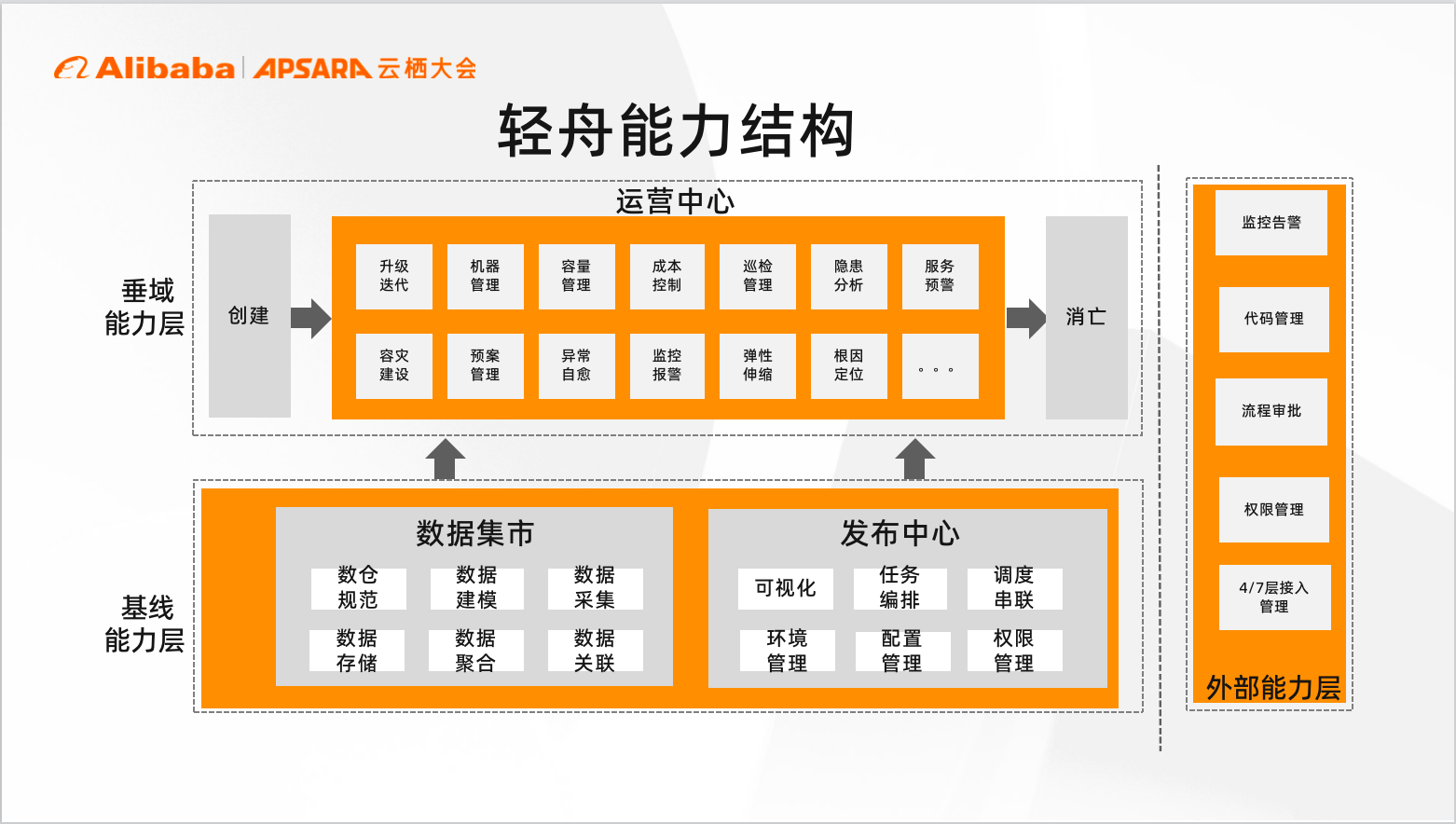

轻舟的整体能力结构是两能力+三中心

基线能力层包含数据集市和发布中心,是整个运维管理体系的基础

垂域能力层是贯穿服务的生命周期的,从服务的创建、运营到消亡,运营是我们日常工作花费时间精力最多的部分,包含服务升级迭代、机器管理、巡检管理等等

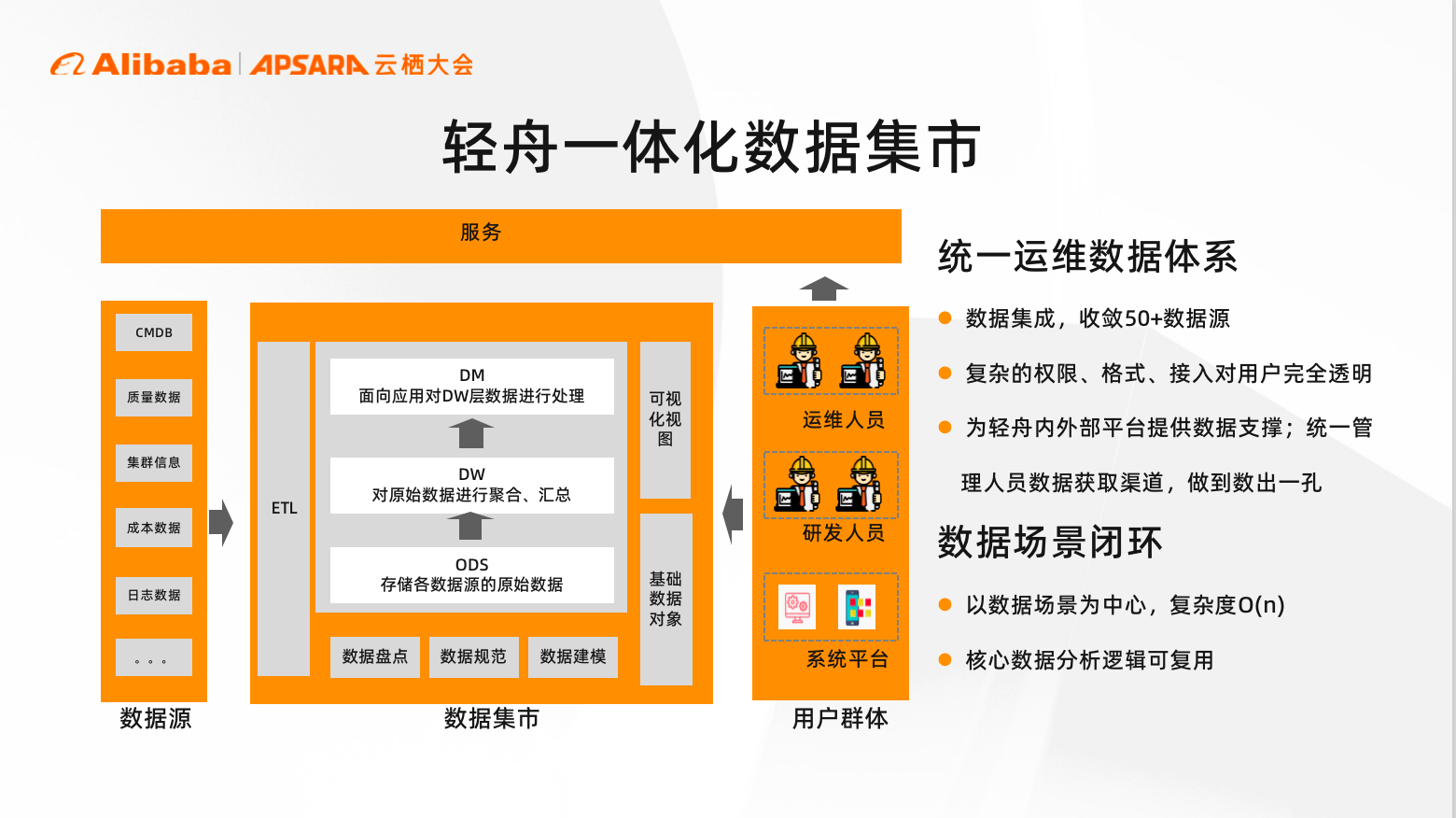

在数据上为了解决孤岛问题,我们的解决方案是数据集成、架构解耦

通过构建大数据的一体化运维数据集市,收敛运维周边的所有数据,在数据源头和数据使用方之间做了一层解耦

在数据集市层我们制定了数据规范,将运维数据进行建模和分层处理

最后针对现有的数据源进行ETL调度,最终实现数据统一存储和使用

新的数据架构统一了运维数据体系,解决数据孤岛问题的同时,降低数据使用门槛,

目前整套数据体系已经应用到所有的大数据服务当中,真正做到了数出一孔

再有整个数据场景是闭环的,复杂度由O(n^2)变成O(n),并且核心数据分析逻辑可复用

整个新的数据架构是以数据场景为中心,取代之前以人为中心

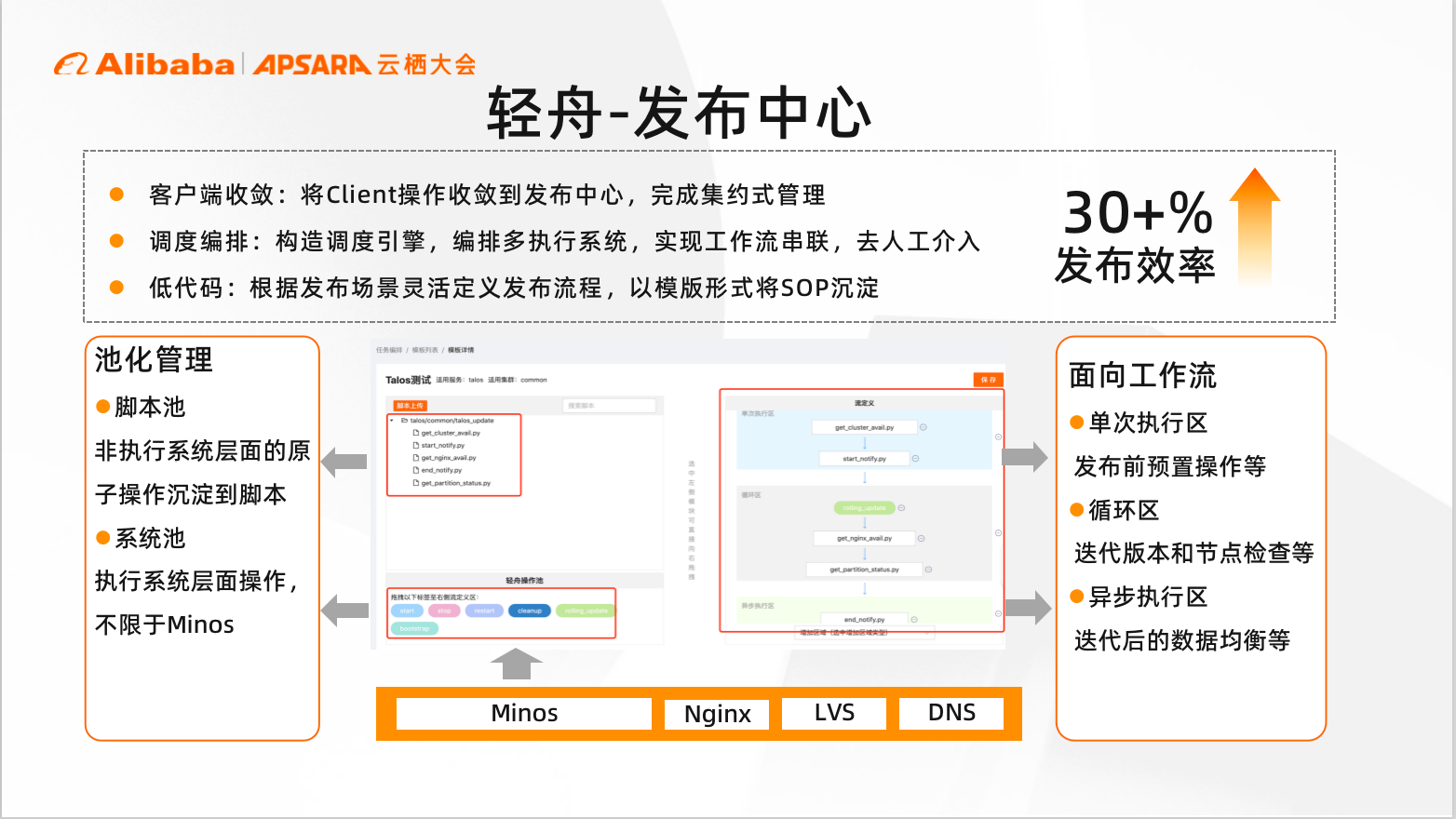

轻舟的发布中心,通过调度编排+低代码的模式,去灵活定义工作流

同时依托模版将SOP进行沉淀,将个人经验转化为组织能力

上图就是发布中心的工作流模版,我们将执行系统和自定义脚本抽象为操作池

在调度编排上定义了多种逻辑区域,如我们的单次执行区,循环区和异步执行区。

目前整套正在逐步推广到所有大数据服务中,并且在一些场景中实现了变更的无人值守,效率提升30%;

后续整个发布中心也会在现有基础上继续优化和迭代,打造全局互联互通,最终实现全流程自动化

在运营中心中,我们结合数据和混合ops的理念,重点解决协同、服务差异和经验化等多个核心痛点

目前整体的效果还是不错的,比如在机器故障处理上已经实现了全流程自动

覆盖了95%的大数据服务,年均自动化处理机器故障近万次

在容量管理上,通过数据趋势的分析,覆盖全场景的容量的检测,降低大量的人工介入

在巡检管理上,通过将风险量化打分,进一步固化了巡检标准和处理流程

此外还有环境管理、配置管理,这里由于时间关系,就不一一介绍了

目前整个运营中心还在持续建设和完善中

接下来是第二部分,大数据的架构实践

小米的核心数据链路,是以消息队列Talos+接入转储这样的组合,作为数据总线去实现数据从端到端的打通

各类原始数据,通过Agent的采集方式,进入到消息队列中,同时也支持基于binlog的存量和增量采集

在转储层一般通过的统一transfer模块,将数据灌入其他大数据的存储引擎中,供进一步使用

目前小米半数以上的数据都是通过这套方案接入的

整套流程做了产品化的设计,用户可以基于平台可自由定义数据链路

小米在数仓这个方向上也经历了基于Hadoop的离线数仓、Kappa实时数仓、Lambda架构数仓的过程

最新的数仓体系是基于数据湖iceberg+flink+spark构建的离线+实时数仓

结合上面提到的,数据经过MQ,最终进入到数据湖当中

数仓的每一层之间通过spark或flink方式进行etl建设

同时小米的olap引擎经过改造可直接查询湖中数据

整个方案在性能上效果表现很好,相比历史架构,其复杂度更低

由于了数仓存储层的统一和ztsd压缩算法的升级,在存储上也有很大的优化

上面提到的数据湖iceberg的底座也是基于HDFS的,这里我们聊聊HDFS 的数据架构实践

一般业界实现中,为了实现数据分层的目的,会使用固态盘、机械盘和高密度存储的方式

在小米内部实现中,为了进一步压缩成本,自研了一套HDFS Tering的架构,将冷数据直接上云管理

上面就是整体的架构图,可以看到后台会有一个mover程序自动的将HDFS冷数据的转储到阿里云OSS上

随后更新Namenode上的元数据,实现文件属性到block到对象的变化

同时对用户透明,在架构上增加了proxydn模块

目前整套方案,已经累计冷备了200+PB数据,数据成本降低80+%

为了支撑小米IOT的战略,解决业务海量数据索引+事务的需求

小米历史是基于封装HBase Coprocessor实现的自研存储,我们内部称之为SDS

但随着数据规模不断上涨,暴露了很多架构问题,比如基于范围分片,failover时间慢,依赖链路多等等

同时无法支撑业务的时序数据需求;此外SDS在开发维护成本上也非常高昂

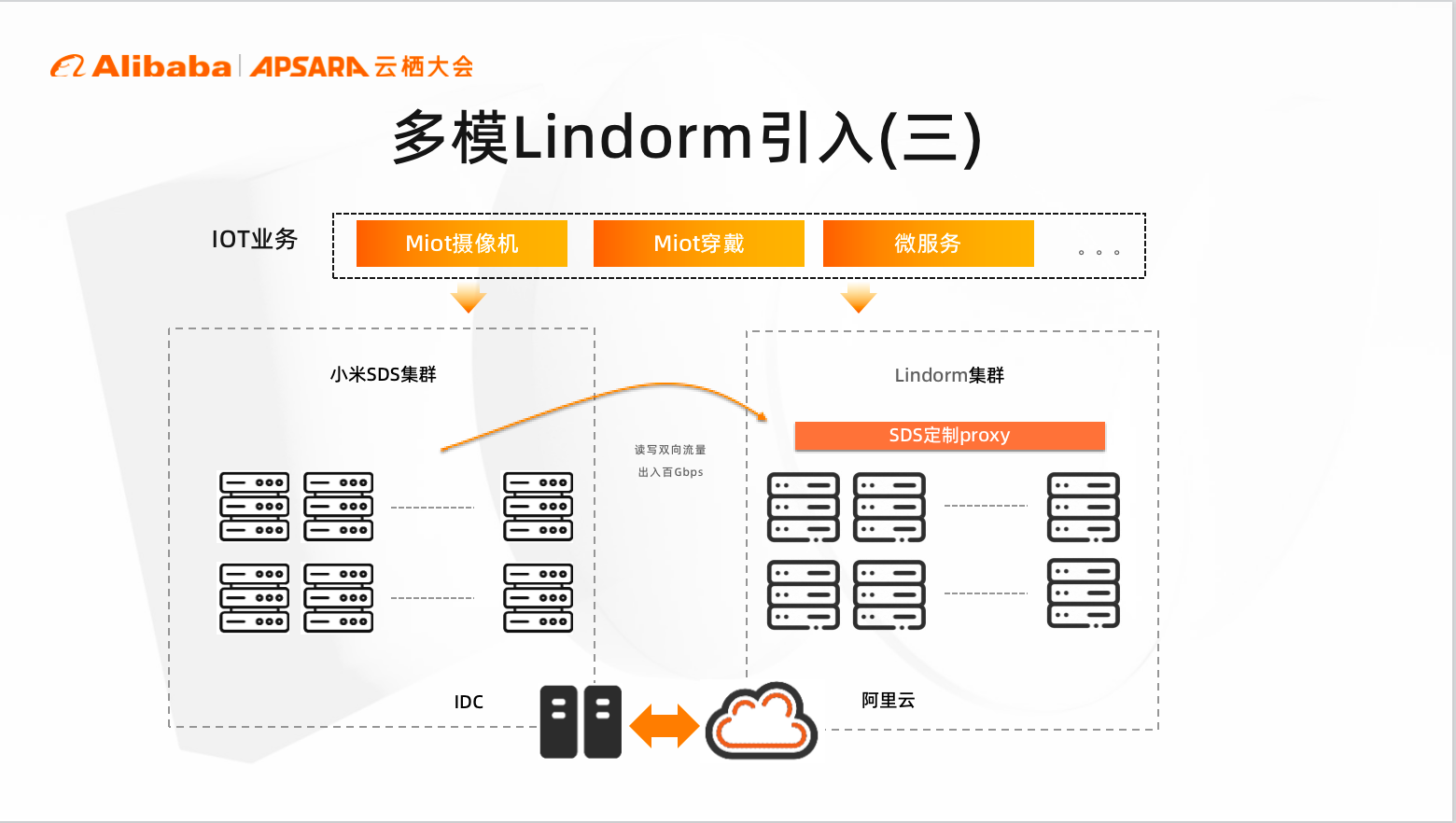

经过我们选型后,阿里云的Lindorm是非常符合我们需求的,在图中我们可以看到

Lindorm兼容HBase、Hadoop等协议,提供了宽表引擎的同时,还提供了时序等多种引擎

与此同时结合多级混合存储、Serverless等多种特性,可以解决很多遗留问题

小米内部测试后性能还是蛮不错的,符合我们的整体需求

选型完成后,如何低成本的由sds迁移到lindorm上也是一个至关重要的问题。

图中就是整体的迁移架构,我们为IDC到云间打通百G的网络链路

服务层面,SDS和Lindorm之间会提前建立好数据同步链路,保证SDS 和Lindorm都是最新数据

为了最小化业务改动成本,提供了sds proxy的组件

将数据代理到lindorm上,最终实现业务迁移

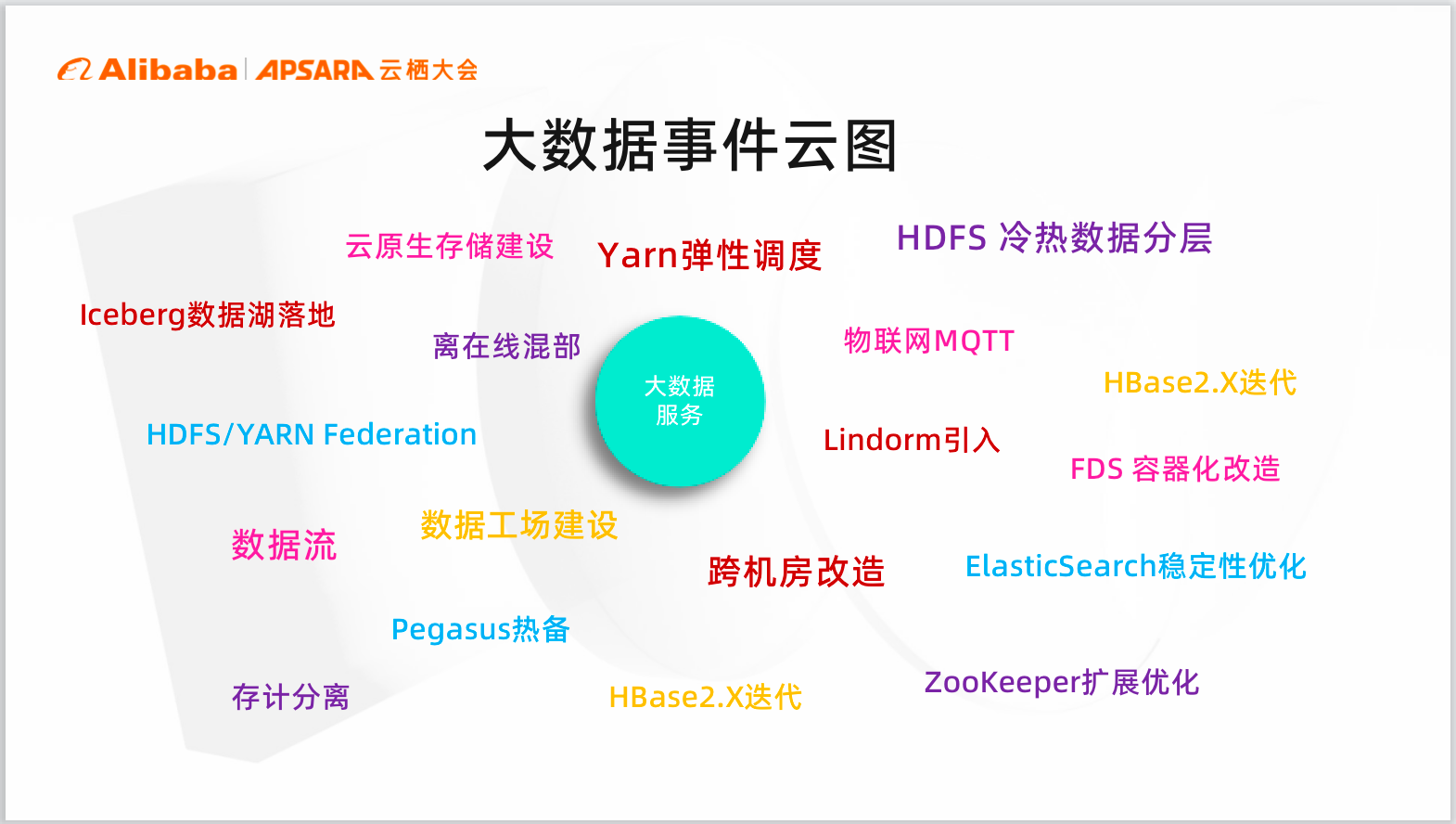

这一页是最近一段时间参与的大数据相关的事件云图,由于时间关系,很遗憾不能展开说,感兴趣的老师可以线下沟通

「原创推荐」

「好文推荐」

「最佳实践」

很好奇,就使用rubyonrails自动化单元测试而言,你们正在做什么?您是否创建了一个脚本来在cron中运行rake作业并将结果邮寄给您?git中的预提交Hook?只是手动调用?我完全理解测试,但想知道在错误发生之前捕获错误的最佳实践是什么。让我们理所当然地认为测试本身是完美无缺的,并且可以正常工作。下一步是什么以确保他们在正确的时间将可能有害的结果传达给您? 最佳答案 不确定您到底想听什么,但是有几个级别的自动代码库控制:在处理某项功能时,您可以使用类似autotest的内容获得关于哪些有效,哪些无效的即时反馈。要确保您的提

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

有时我需要处理键/值数据。我不喜欢使用数组,因为它们在大小上没有限制(很容易不小心添加超过2个项目,而且您最终需要稍后验证大小)。此外,0和1的索引变成了魔数(MagicNumber),并且在传达含义方面做得很差(“当我说0时,我的意思是head...”)。散列也不合适,因为可能会不小心添加额外的条目。我写了下面的类来解决这个问题:classPairattr_accessor:head,:taildefinitialize(h,t)@head,@tail=h,tendend它工作得很好并且解决了问题,但我很想知道:Ruby标准库是否已经带有这样一个类? 最佳

我正在尝试使用Curbgem执行以下POST以解析云curl-XPOST\-H"X-Parse-Application-Id:PARSE_APP_ID"\-H"X-Parse-REST-API-Key:PARSE_API_KEY"\-H"Content-Type:image/jpeg"\--data-binary'@myPicture.jpg'\https://api.parse.com/1/files/pic.jpg用这个:curl=Curl::Easy.new("https://api.parse.com/1/files/lion.jpg")curl.multipart_form_

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

导读:随着叮咚买菜业务的发展,不同的业务场景对数据分析提出了不同的需求,他们希望引入一款实时OLAP数据库,构建一个灵活的多维实时查询和分析的平台,统一数据的接入和查询方案,解决各业务线对数据高效实时查询和精细化运营的需求。经过调研选型,最终引入ApacheDoris作为最终的OLAP分析引擎,Doris作为核心的OLAP引擎支持复杂地分析操作、提供多维的数据视图,在叮咚买菜数十个业务场景中广泛应用。作者|叮咚买菜资深数据工程师韩青叮咚买菜创立于2017年5月,是一家专注美好食物的创业公司。叮咚买菜专注吃的事业,为满足更多人“想吃什么”而努力,通过美好食材的供应、美好滋味的开发以及美食品牌的孵

本教程将在Unity3D中混合Optitrack与数据手套的数据流,在人体运动的基础上,添加双手手指部分的运动。双手手背的角度仍由Optitrack提供,数据手套提供双手手指的角度。 01 客户端软件分别安装MotiveBody与MotionVenus并校准人体与数据手套。MotiveBodyMotionVenus数据手套使用、校准流程参照:https://gitee.com/foheart_1/foheart-h1-data-summary.git02 数据转发打开MotiveBody软件的Streaming,开始向Unity3D广播数据;MotionVenus中设置->选项选择Unit

文章目录一、概述简介原理模块二、配置Mysql使用版本环境要求1.操作系统2.mysql要求三、配置canal-server离线下载在线下载上传解压修改配置单机配置集群配置分库分表配置1.修改全局配置2.实例配置垂直分库水平分库3.修改group-instance.xml4.启动监听四、配置canal-adapter1修改启动配置2配置映射文件3启动ES数据同步查询所有订阅同步数据同步开关启动4.验证五、配置canal-admin一、概述简介canal是Alibaba旗下的一款开源项目,Java开发。基于数据库增量日志解析,提供增量数据订阅&消费。Git地址:https://github.co

我正在尝试在Rails上安装ruby,到目前为止一切都已安装,但是当我尝试使用rakedb:create创建数据库时,我收到一个奇怪的错误:dyld:lazysymbolbindingfailed:Symbolnotfound:_mysql_get_client_infoReferencedfrom:/Library/Ruby/Gems/1.8/gems/mysql2-0.3.11/lib/mysql2/mysql2.bundleExpectedin:flatnamespacedyld:Symbolnotfound:_mysql_get_client_infoReferencedf

文章目录1.开发板选择*用到的资源2.串口通信(个人理解)3.代码分析(注释比较详细)1.主函数2.串口1配置3.串口2配置以及中断函数4.注意问题5.源码链接1.开发板选择我用的是STM32F103RCT6的板子,不过代码大概在F103系列的板子上都可以运行,我试过在野火103的霸道板上也可以,主要看一下串口对应的引脚一不一样就行了,不一样的就更改一下。*用到的资源keil5软件这里用到了两个串口资源,采集数据一个,串口通信一个,板子对应引脚如下:串口1,TX:PA9,RX:PA10串口2,TX:PA2,RX:PA32.串口通信(个人理解)我就从串口采集传感器数据这个过程说一下我自己的理解,