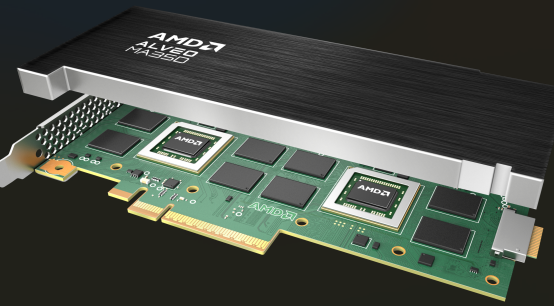

近年来,音视频市场呈现裂变式发展。数据显示,2019年,全球实时视频流总市值达到260亿美元,预计到2026年或将达到约940亿美元。面对庞大的市场需求,如何提供最优化视频直播解决方案,成为摆在企业面前的挑战之一。为此,AMD近期正式推出了一款全新媒体加速器卡:Alveo MA35D,该卡专为推动大规模直播互动流媒体服务新时代而打造,基于ASIC架构设计、采用5nm的工艺制程,并支持AV1压缩标准的视频处理单元(VPU)。

AMD 视频战略与市场开发主管Sean GardnerGardne表示,在实况直播市场,无论是营收,还是在基础设施部署方面,增长都非常迅速。Alveo MA35D的推出能够大幅改善视频直播行业的经济性,从而使得新的应用场景变得商业可行。

面向多对多直播模式的视频加速卡

随着直播模式的不断成熟,未来的直播场景由一对多向多对多模式转变,即每个人都是主播,既是数据源也是接收器,其中包括连线观赏、直播购物、在线拍卖和社交流媒体等场景。

Sean GardnerGardne认为,未来的直播场景要求对数据的处理更加贴近用户,这就必须把数据的处理转移到边缘端。在这种应用场景之下,原有云集中的方式显然已经不能获得最佳的经济效益,这就需要彻底改变基础设施的部署方式。因此,随着当前流媒体直播对时延的要求越来越高,以及部署在边缘的成本大幅提高,驱使我们开发新一代的实况交互式流媒体解决方案。

据介绍,Alveo MA35D卡可通过以每流1瓦的功率每卡提供多达32路1080p 60转码密度。Alveo MA35D的4K编码时延最低为8毫秒,仅为常规处理时间(16毫秒)的一半。Alveo MA35D具备22 TOPS AI算力(INT8),能够支持更多的新的应用场景。

与上一代Alveo U30比较, Alveo MA35D的通道密度提高了4倍、功耗降低了3倍、时延降低了4倍。

据AMD 产品管理与营销总监 Girish Malipeddi介绍,在流媒体功耗方面,与Alveo MA35D相比,GPU卡功耗要高很多。因为绝大部分GPU卡的功耗都要达到75瓦,而Alveo MA35D仅有35瓦左右。

Sean GardnerGardne表示,Alveo MA35D同时具有高密度、超低时延的处理单元以及人工智能的赋能,能够大大的改善经济性,从而使得新的应用场景变得商业可行。

据介绍,Alveo MA35D的建议零售价1595美元,非常有吸引力。

引入人工智能分析技术实现降本增效

与上一代产品相比,Alveo MA35D创新性的引入了人工智能分析视频内容的技术,以及人工智能和机器学习的能力,以此来对视频类型、复杂程度进行分析,更好地理解视频的内容特点,更加高效的处理视频。

Sean GardnerGardne认为,将人工智能和机器学习的技术加入到Alveo MA35D当中,能够动态地对视频内容进行编码,实现真正的动态视频处理,降低带宽和存储需求,进一步提高视频编码的效率。

为了让我们了解人工智能技术给Alveo MA35D带来的优势,Sean GardnerGardne通过晚间新闻直播的实例进行了详细的介绍。在晚间新闻节目中,主持人通常以头像的形式进行播间,其间会切换到汽车赛事等具有非常多动态的画画。当主持人画面出现后,人工智能技术就能够通过配置编码器降低带宽,当切换到体育赛事时,就能够进行实时的动态调整,保证视频更加流畅。因此,利用Alveo MA35D具备地高度智能动态和优化视频处理能力,能够大规模降低功耗和成本。

为了解决人工智能判断不准确的问题,Alveo MA35D还创新性的加入了VQ分析IP模块。该IP模块在人工智能进行动态调整和变化过程中形成反馈环,以确保做出正确的决策。通过VQ分析可以确保视频每一帧的质量,一旦出现错误都可以及时调整。

Girish Malipeddi表示,对于流媒体客户来说,带宽消耗是非常大一项运营开支。我们通过对编码解码器的改善,在保证视频质量的同时,降低流媒体带宽。数据显示,AV1编码器在达到同等视觉质量的情况下,可以节省高达52%的带宽。

优势互补确保用户的成本效益

为了能够让用户更加方便的使用Alveo MA35D视频加速卡,AMD平台的用户可以通过媒体加速软件开发套件(SDK)进行访问,并通过支持广泛使用的FFmpeg和Gstreamer视频框架,易于开发。

我们知道,AMD目前有着丰富的产品线,包括CPU、GPU、视频加速卡等,此次发布的Alveo MA35D新产品,是否与旗下的GPU形成竞争关系,也是我们非常关注的话题。

Sean GardnerGardne明确表示,Alveo MA35D与AMD CPU和GPU并非竞争关系,而是补充性的产品。他强调,AMD旗下的所有产品都各具所长,而且效率都非常高。CPU可以提供高性能的压缩,但如果处理几百万个流视频,经济性就会差一些。在图像呈现的应用场景中,GPU就是最好的选择。

Sean GardnerGardne表示,在一些应用场景中,需要三者协作来提供具有成本效益和高性能的解决方案。例如在云电竞或云游戏中,GPU能够更好地呈现游戏内容,Alveo MA35D则用来完成内容的低时延高质量编码,EPYC处理器则用以完成所有应用级的系统处理。这样的组合方案,能够为客户提供最高密度、最优的价格和更低功耗。

据介绍,Alveo MA35D 媒体加速器卡现已提供样品,预计在第三季度量产出货。

其实做自媒体的成本并不高,入门只需要一部手机即可!在手机上找视频素材、使用手机剪辑视频、最后使用手机发布视频作品获得收益!方法并不难,今天这期内容就来给粉丝们分享一种小方法,每天稳定收益100-300,抓紧点赞收藏!1、找素材(1)使用手机拍摄自己喜欢的经典段落,使用程序把文案内容提取出来(2)也可以在豆瓣、知乎、微博等网站中找一些自己需要的文案素材(3)把文案进行润色修改,可以加入一些自己的观点(4)视频素材可以使用软件中自带的素材,也可以在素材网站中下载完整版的素材2、文案配音(1)把复制好的文案直接导入小程序中(2)调整音色、音调后一键合成音频即可(3)可以选择自己朗读配音,需要花一点时

我正在运行RubyonRails3,我想使用Paperclip插件/gem降低上传图像的质量。我该怎么做?此时在我的模型文件中我有:has_attached_file:avatar,:styles=>{:thumb=>["50x50#",:jpg],:medium=>["250x250#",:jpg],:original=>["600x600#",:jpg]}这会将图像转换为.jpg格式并设置尺寸。 最佳答案 尝试使用convert_options。has_attached_file:avatar,:styles=>{:thumb=

警告:找不到RubyGems1.2+索引:RubyGems将恢复到降低性能的遗留索引。如果有人能帮我解决这个问题,我会给他们50.00美元我用尽了谷歌,重新安装了所有东西。我只想做gem安装...就是这样 最佳答案 删除罪魁祸首URL。就我而言,我使用的是Centos5.4,我收到的完整错误消息是:root#geminstallrackWARNING:RubyGems1.2+indexnotfoundfor:http://rubyworks.rubyforge.org/redhat/5/GEMS/x86_64/RubyGemswil

我正在从Rails3.2进行流式下载(CSV),并且遇到初始页面请求需要很长时间的问题。以下Controller代码说明了我的问题:self.response_body=Enumerator.newdo|y|10_000_000.timesdoy有了上面的内容,响应看起来确实像是流式传输(来自可以支持它的服务器......在我的例子中是Unicorn)。也就是说,在它开始流式传输之前,它挂起的时间比我想要的要长得多。如果我将其更改为以下内容,它会启动得更快:self.response_body=Enumerator.newdo|y|1000.timesdoy我的理解是响应应该从循环的第

我使用Kafka流媒体从KAFKA主题中消费。(KafkaDirect流)此主题中的数据每5分钟从另一个来源到达。现在,我需要处理每5分钟后到达的数据,并将其转换为SparkDataFrame。现在,流是数据的连续流。我的问题是,如何确定我已经完成了在Kafka主题中加载的第一组数据的阅读?(以便我可以将其转换为数据框架并开始我的工作)我知道我可以提及某个数字的批处理间隔(在JavastreamingContext中),但是即使那样,我也永远无法确定源将数据将数据推到主题的时间。欢迎任何建议。看答案如果我正确理解您的问题,您希望不创建批处理,直到阅读5分钟的所有数据。开箱即用的Spark不会提

我正在尝试将图像上传到PingFM。他们的documentation说:media–base64encodedmediadata.我可以通过URL访问此图像。我试过(几乎猜到了)这个:ActiveSupport::Base64.encode64(open("http://image.com/img.jpg"))但是我得到这个错误:TypeError:can'tconvertTempfileintoStringfrom/usr/lib/ruby/1.8/base64.rb:97:in`pack'from/usr/lib/ruby/1.8/base64.rb:97:in`encode64'

MediaSourceExtensions和WebRTC之间的根本区别是什么?请允许我表达一下自己的理解。WebRTC包括一个RTCPeerConnection,它处理从媒体流中获取流并将它们传递到一个协议(protocol)中,以便流式传输到应用程序的连接对等点。似乎在WebRTC的幕后抽象了许多更大的问题,如编解码器和转码。这是一个正确的评估吗?MediaSourceExtensions适合什么地方?我的知识有限,但看过开发人员运行自适应流媒体的示例。MSE是否只处理来自您服务器的流?帮助将不胜感激。 最佳答案 不幸的是,这些与

我有一个带有输入字段的页面。当页面处于媒体类型打印时,我想隐藏所有0值文本字段。我试过jQuery.但这在屏幕模式和打印模式下都有效。HTML:somescreensomeprintPrintJS:$('button').click(function(){$('input[type=text]').each(function(){if($(this).val()==0){$(this).hide()}})})CSS:@mediaprint{.screen{display:none;}.print{display:block;}}@mediascreen{.screen{display:

我正在尝试与KurentoWebRtc服务器共享我的屏幕。但是得到这个错误:NavigatorUserMediaError{name:"ScreenCaptureError",message:"",constraintName:""}同样的代码在Firefox中没有错误。用于webrtc的约束:varconstraints={audio:true,video:{mandatory:{chromeMediaSource:'screen',maxWidth:1920,maxHeight:1080,maxFrameRate:30,minFrameRate:15,minAspectRatio:

我如何在纯js中停止和退出,在WEBRTCapijs中流式传输网络摄像头,我的代码中有以下脚本:$(document).ready(function(){$("#abrirModal").click(function(){navigator.getUserMedia=navigator.getUserMedia||navigator.webkitGetUserMedia||navigator.mozGetUserMedia;varconstraints={audio:false,video:true};varlive=document.getElementById("live");fu