VGG16

我们都知道Alexnet是卷积神经网络的开山之作,但是由于卷积核太大,移动步长大,无填充,所以14年提出的VGG网络解决了这一问题

VGG网络由牛津大学在2014年ImageNet挑战赛本地和分类追踪分别获得了第一名和第二名。研究卷积网络深度对其影响在大规模图像识别设置中的准确性,主要贡献是全面评估网络的深度,使用3*3卷积滤波器来提取特征。解决了Alexnet容易忽略小部分的特征。

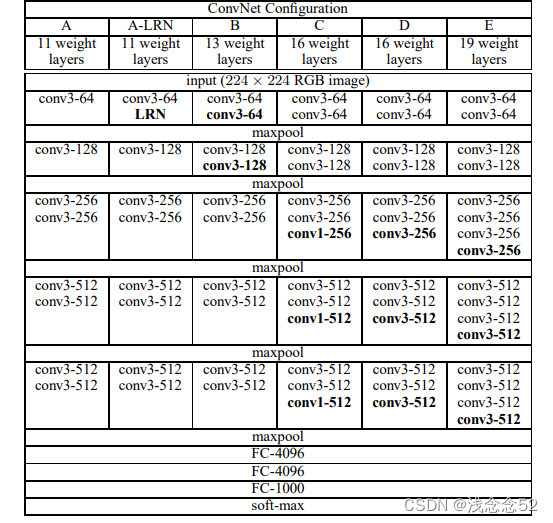

从这张图中可以看到,VGG网络有11-19层,今天我们主要了解VGG16,VGG网络有一个特点,在每一次池化之后,经过卷积通道数都会翻倍,这样的好处就是为了保留更多的特征。

VGG16一个有13个卷积层3个全连接层。

1.通过上面表格我们可以发现,经过max池化之后,通道数会翻倍,我们可以为了减少代码量,把这一过程封装成一个类,在使用过程中,直接调用就可以了。

class tiao(nn.Module):

def __init__(self,shuru):

super(tiao, self).__init__()

self.conv1=nn.Conv2d(in_channels=shuru,out_channels=shuru*2,kernel_size=(3,3))

self.conv2=nn.Conv2d(in_channels=shuru*2,out_channels=shuru*2,kernel_size=(3,3))

self.relu=nn.ReLU()

def forward(self,x):

x1=self.conv1(x)

x2=self.relu(x1)

x3=self.conv2(x2)

x4=self.relu(x3)

return x4

这个类,很简单就是两层卷积,加两层激活函数,输出通道数翻倍

2.第二步就可以按照表格实现VGG16网络

2.1

输入三通道,输出64通道,卷积核为3

self.conv1=nn.Conv2d(in_channels=3,out_channels=64,kernel_size=(3,3))

self.conv2=nn.Conv2d(in_channels=64,out_channels=64,kernel_size=(3,3))

2.2

经过最大池化,通道数翻倍 输入64通道 经过两次卷积 输出通道128

这里直接调用上面封装好的类就行

self.tiao128=tiao(64)

2.3

经过最大池化,输入128通道 经过两次33卷积一次11卷积 输出通道256

self.tiao256=tiao(128)

self.conv1_256=nn.Conv2d(in_channels=256,out_channels=256,kernel_size=(1,1))

2.4

经过最大池化,输入256通道 经过两次33卷积一次11卷积 输出通道512

self.tiao512=tiao(256)

self.conv1_512=nn.Conv2d(in_channels=512,out_channels=512,kernel_size=(1,1))

2.5

经过最大池化,输入512通道,经过两次33卷积一次11卷积 输出通道512

self.conv512 = nn.Conv2d(in_channels=512, out_channels=512, kernel_size=(3, 3))

self.conv1_512=nn.Conv2d(in_channels=512,out_channels=512,kernel_size=(1,1))

2.6

最后的三层全连接,这里要注意,使用自适应池化,池化之后图片尺寸是7*7

self.zsy=nn.AdaptiveAvgPool2d(7)

self.l1=nn.Linear(512*7*7,4096)

self.l2=nn.Linear(4096,4096)

self.l3=nn.Linear(4096,10)

2.7

还有relu激活函数,dropout随机失活函数,这里为了整洁,图表没有明确指出

self.relu=nn.ReLU()

self.dropout=nn.Dropout2d(p=0.2)

2.8

最后就是前向传播

x1=self.conv1(x)

x2=self.relu(x1)

x3=self.conv2(x2)

x4=self.maxpool(x3)

x5=self.tiao128(x4)

x6=self.maxpool(x5)

x7=self.tiao256(x6)

x8=self.conv1_256(x7)

x9=self.maxpool(x8)

x10=self.tiao512(x9)

x11=self.conv1_512(x10)

x12=self.maxpool(x11)

x13=self.conv512(x12)

x14=self.conv512(x13)

x15=self.conv1_512(x14)

x16=self.zsy(x15)

x17=x16.view(x16.size()[0],-1)

x18=self.l1(x17)

x19 = self.relu(x18)

x20=self.dropout(x19)

x22 = self.l2(x20)

x23=self.relu(x22)

x24=self.dropout(x23)

x25=self.l3(x24)

return x25

到这里VGG16网络就全部完成了

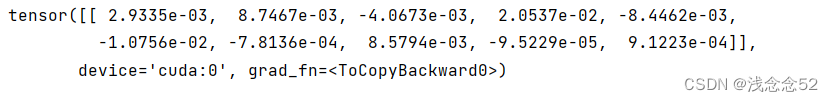

这里我们可以进行验证,看网络有没有什么问题

model=VGG16()

input=torch.randn(1,3,224,224)

output=model(input).cuda()

print(output)

transform=transforms.Compose([

#图像增强

transforms.Resize(120),

transforms.RandomHorizontalFlip(),

transforms.RandomCrop(224),

transforms.ColorJitter(brightness=0.5,contrast=0.5,hue=0.5),

#转变为tensor 正则化

transforms.ToTensor(),

transforms.Normalize((0.5,0.5,0.5),(0.5,0.5,0.5)) #正则化

])

读取数据时,可以调整线程数,batch_size可以使代码跑起来更快,提高GPU利用率,这里要注意一个问题,线程数过大新手会出现页面太小报错,这时候调整虚拟内存就可以了

trainset=tv.datasets.CIFAR10(

root=r'E:\桌面\资料\cv3\数据集\cifar-10-batches-py',

train=True,

download=True,

transform=transform

)

trainloader=data.DataLoader(

trainset,

batch_size=8,

drop_last=True,

shuffle=True, #乱序

num_workers=4,

)

testset=tv.datasets.CIFAR10(

root=r'E:\桌面\资料\cv3\数据集\cifar-10-batches-py',

train=False,

download=True,

transform=transform

)

testloader=data.DataLoader(

testset,

batch_size=4,

drop_last=True,

shuffle=False,

num_workers=2

)

数据读取完成,我们就可以训练模型,以及测试模型准确率

for i in range(3):

running_loss=0

for index,data in enumerate(trainloader):

x,y=data

x=x.cuda()

y=y.cuda()

x,y=Variable(x),Variable(y)

opt.zero_grad()

h=model(x)

loss1=loss(h,y)

loss1.backward()

opt.step()

running_loss+=loss1.item()

if index % 10 == 9:

avg_loss = running_loss/ 10.

running_loss = 0

print('avg_loss', avg_loss)

if index%1000==99:

acc=0

total=0

for data in testloader:

images,labels=data

outputs=model(Variable(images.cuda()))

_,predicted=torch.max(outputs.cpu(),1)

total+=labels.size(0)

bool_tensor=(predicted==labels)

acc+=bool_tensor.sum()

print("1000张精度为 %d %%"%(100*acc/total))

在vgg网络中,按照道理来说,随着层数的不断提高,网络模型会越来越好,但是研究发现,随着层数的不断提高,准确率缺不断下降,为了这个问题,随后提出的残差网络,解决了这一问题。

我想在Ruby中创建一个用于开发目的的极其简单的Web服务器(不,不想使用现成的解决方案)。代码如下:#!/usr/bin/rubyrequire'socket'server=TCPServer.new('127.0.0.1',8080)whileconnection=server.acceptheaders=[]length=0whileline=connection.getsheaders想法是从命令行运行这个脚本,提供另一个脚本,它将在其标准输入上获取请求,并在其标准输出上返回完整的响应。到目前为止一切顺利,但事实证明这真的很脆弱,因为它在第二个请求上中断并出现错误:/usr/b

嗨~大家好,这里是可莉!今天给大家带来的是7个C语言的经典基础代码~那一起往下看下去把【程序一】打印100到200之间的素数#includeintmain(){ inti; for(i=100;i 【程序二】输出乘法口诀表#includeintmain(){inti;for(i=1;i 【程序三】判断1000年---2000年之间的闰年#includeintmain(){intyear;for(year=1000;year 【程序四】给定两个整形变量的值,将两个值的内容进行交换。这里提供两种方法来进行交换,第一种为创建临时变量来进行交换,第二种是不创建临时变量而直接进行交换。1.创建临时变量来

网络编程套接字网络编程基础知识理解源`IP`地址和目的`IP`地址理解源MAC地址和目的MAC地址认识端口号理解端口号和进程ID理解源端口号和目的端口号认识`TCP`协议认识`UDP`协议网络字节序socket编程接口`sockaddr``UDP`网络程序服务器端代码逻辑:需要用到的接口服务器端代码`udp`客户端代码逻辑`udp`客户端代码`TCP`网络程序服务器代码逻辑多个版本服务器单进程版本多进程版本多线程版本线程池版本服务器端代码客户端代码逻辑客户端代码TCP协议通讯流程TCP协议的客户端/服务器程序流程三次握手(建立连接)数据传输四次挥手(断开连接)TCP和UDP对比网络编程基础知识

在VMware16.2.4安装Ubuntu一、安装VMware1.打开VMwareWorkstationPro官网,点击即可进入。2.进入后向下滑动找到Workstation16ProforWindows,点击立即下载。3.下载完成,文件大小615MB,如下图:4.鼠标右击,以管理员身份运行。5.点击下一步6.勾选条款,点击下一步7.先勾选,再点击下一步8.去掉勾选,点击下一步9.点击下一步10.点击安装11.点击许可证12.在百度上搜索VM16许可证,复制填入,然后点击输入即可,亲测有效。13.点击完成14.重启系统,点击是15.双击VMwareWorkstationPro图标,进入虚拟机主

目录第1题连续问题分析:解法:第2题分组问题分析:解法:第3题间隔连续问题分析:解法:第4题打折日期交叉问题分析:解法:第5题同时在线问题分析:解法:第1题连续问题如下数据为蚂蚁森林中用户领取的减少碳排放量iddtlowcarbon10012021-12-1212310022021-12-124510012021-12-134310012021-12-134510012021-12-132310022021-12-144510012021-12-1423010022021-12-154510012021-12-1523.......找出连续3天及以上减少碳排放量在100以上的用户分析:遇到这类

是否可以在不实际下载文件的情况下检查文件是否存在?我有这么大的(~40mb)文件,例如:http://mirrors.sohu.com/mysql/MySQL-6.0/MySQL-6.0.11-0.glibc23.src.rpm这与ruby不严格相关,但如果发件人可以设置内容长度就好了。RestClient.get"http://mirrors.sohu.com/mysql/MySQL-6.0/MySQL-6.0.11-0.glibc23.src.rpm",headers:{"Content-Length"=>100} 最佳答案

我在这方面尝试了很多URL,在我遇到这个特定的之前,它们似乎都很好:require'rubygems'require'nokogiri'require'open-uri'doc=Nokogiri::HTML(open("http://www.moxyst.com/fashion/men-clothing/underwear.html"))putsdoc这是结果:/Users/macbookair/.rvm/rubies/ruby-2.0.0-p481/lib/ruby/2.0.0/open-uri.rb:353:in`open_http':404NotFound(OpenURI::HT

深度学习12.CNN经典网络VGG16一、简介1.VGG来源2.VGG分类3.不同模型的参数数量4.3x3卷积核的好处5.关于学习率调度6.批归一化二、VGG16层分析1.层划分2.参数展开过程图解3.参数传递示例4.VGG16各层参数数量三、代码分析1.VGG16模型定义2.训练3.测试一、简介1.VGG来源VGG(VisualGeometryGroup)是一个视觉几何组在2014年提出的深度卷积神经网络架构。VGG在2014年ImageNet图像分类竞赛亚军,定位竞赛冠军;VGG网络采用连续的小卷积核(3x3)和池化层构建深度神经网络,网络深度可以达到16层或19层,其中VGG16和VGG

(本文是网络的宏观的概念铺垫)目录计算机网络背景网络发展认识"协议"网络协议初识协议分层OSI七层模型TCP/IP五层(或四层)模型报头以太网碰撞路由器IP地址和MAC地址IP地址与MAC地址总结IP地址MAC地址计算机网络背景网络发展 是最开始先有的计算机,计算机后来因为多项技术的水平升高,逐渐的计算机变的小型化、高效化。后来因为计算机其本身的计算能力比较的快速:独立模式:计算机之间相互独立。 如:有三个人,每个人做的不同的事物,但是是需要协作的完成。 而这三个人所做的事是需要进行协作的,然而刚开始因为每一台计算机之间都是互相独立的。所以前面的人处理完了就需要将数据

安全产品安全网关类防火墙Firewall防火墙防火墙主要用于边界安全防护的权限控制和安全域的划分。防火墙•信息安全的防护系统,依照特定的规则,允许或是限制传输的数据通过。防火墙是一个由软件和硬件设备组合而成,在内外网之间、专网与公网之间的界面上构成的保护屏障。下一代防火墙•下一代防火墙,NextGenerationFirewall,简称NGFirewall,是一款可以全面应对应用层威胁的高性能防火墙,提供网络层应用层一体化安全防护。生产厂家•联想网御、CheckPoint、深信服、网康、天融信、华为、H3C等防火墙部署部署于内、外网编辑额,用于权限访问控制和安全域划分。UTM统一威胁管理(Un