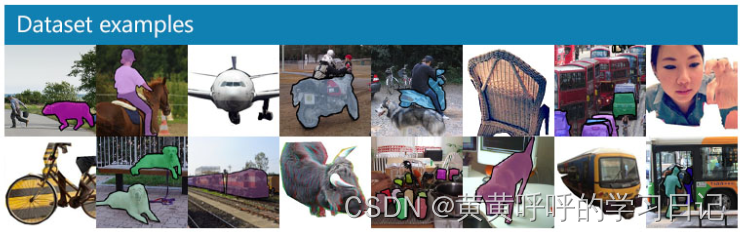

MS COCO的全称是Microsoft Common Objects in Context,起源于微软于2014年出资标注的Microsoft COCO数据集。

COCO是一个具有非常高的行业地位且规模非常庞大的数据集,用于目标检测、分割、图像描述等等场景。特点包括:

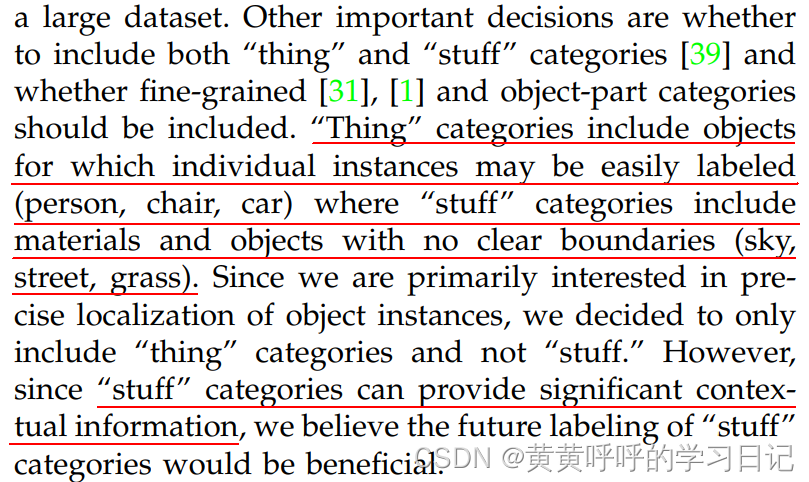

关于上面80个目标类别和91个物体类别(不知道翻译的对不对,嘻嘻)的进一步解释。

官方论文中说明:

1.“stuff” categories include materials and objects with no clear boundaries (sky, street, grass).也就是说,stuff类别包含了一些没有明确边界的目标,例如天空、街道、草等等。

2.对于目标检测任务来说,80类是完全足够的。而包含91类的stuff category能够提供更多上下文信息。所以,80 object categories 是91 stuff categories的子集。

3. 2014年发布的数据集中只包含了80类。(后续我们从代码中也能看到,2014的数据集中,虽然类别id从1-91,但实际上有11类没有被使用。)

4. 相差的11 categories: hat, shoe, eyeglasses (too many instances), mirror, window, door, street sign (ambiguous and difficult to label), plate, desk (due to confusion with bowl and dining table, respectively) and blender, hair brush (too few instances).

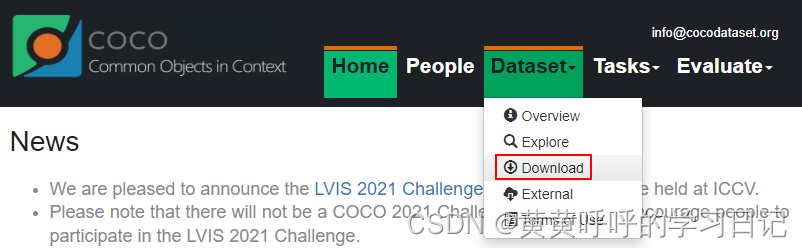

论文链接:下载(在官网首页也能找到下载链接)

官网首页,点击DataSet-Download可以进入下载界面。

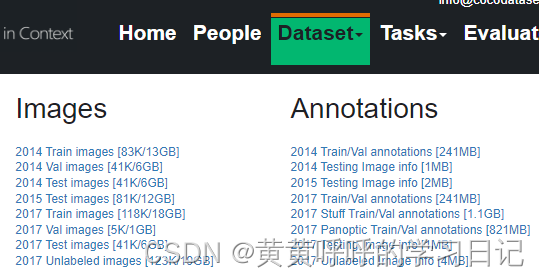

可以下载到对应的数据集。

其中,

Train images:训练集,训练过程中使用到的图像

Val images:验证集,验证过程中使用到的图像

Test images:测试集,测试过程中使用到的图像(如果使用test数据集,那么可以把验证集合训练集一起用于训练),后续例子中没有下载使用

Train/Val annotations:训练集和验证集的标注文件,json格式

下载后,压缩到同一个文件夹中,以COCO2017为例,形成如下结构:

COCO_2017

├── val2017 # 验证集所在文件夹,包含5000张图像

├── train2017 # 训练集所在文件夹,包含118287张图像

├── annotations # 标注文件所在文件夹,包含如下文件

├── instances_train2017.json # 目标检测、分割任务的训练集标注文件

├── instances_val2017.json # 目标检测、分割任务的验证集标注文件文件

├── person_keypoints_train2017.json # 人体关键点检测的训练集标注文件

├── person_keypoints_val2017.json # 人体关键点检测的验证集标注文件

├── captions_train2017.json # 图像描述的训练集标注文件

├── captions_val2017.json # 图像描述的验证集标注文件

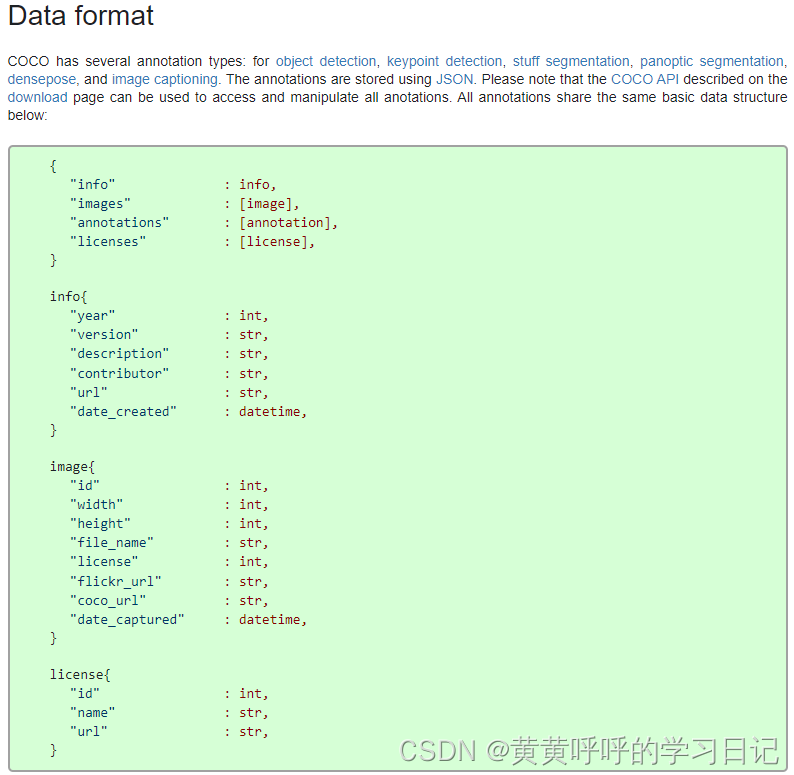

官方主页有对数据格式进行描述。

此处使用json包来对数据进行简单查看。

import json

json_path = "./data/annotations/instances_val2014.json"

json_labels = json.load(open(json_path,'r'))

json_labels.keys()

此时返回结果为:

dict_keys(['info', 'licenses', 'categories', 'images', 'annotations'])

3.1 info字段

json_labels['info']此时返回结果为:

{'description': 'COCO 2014 Dataset',

'url': 'http://cocodataset.org',

'version': '1.0',

'year': 2014,

'contributor': 'COCO Consortium',

'date_created': '2017/09/01'}

3.2 licenses字段

一个列表,包含了不同类型的licenses,并在images中按照id号被引用,基本不参与到数据解析过程中。

json_labels['licenses']此时返回结果为:

[{'url': 'http://creativecommons.org/licenses/by-nc-sa/2.0/',

'id': 1,

'name': 'Attribution-NonCommercial-ShareAlike License'},

{'url': 'http://creativecommons.org/licenses/by-nc/2.0/',

'id': 2,

'name': 'Attribution-NonCommercial License'},

...,

'name': 'No known copyright restrictions'},

{'url': 'http://www.usa.gov/copyright.shtml',

'id': 8,

'name': 'United States Government Work'}]

3.3 categories字段

一个列表,元素个数等于类别数,列表中每个元素都是一个dict,对应每个类别的信息,包括所属父类supercategory、类别id、子类名称name。

COCO2014数据集共计有80类(按照子类统计)。

json_labels['categories']此时返回结果为:

[{'supercategory': 'person', 'id': 1, 'name': 'person'},

{'supercategory': 'vehicle', 'id': 2, 'name': 'bicycle'},

{'supercategory': 'vehicle', 'id': 3, 'name': 'car'},

......

{'supercategory': 'indoor', 'id': 89, 'name': 'hair drier'},

{'supercategory': 'indoor', 'id': 90, 'name': 'toothbrush'}]

注意,虽然id超过了80,但实际上中间有些数字是缺失的,也就是stuff中11类并没有被使用。

len(json_labels['categories']) # 此时返回80另外,可以发现id是从1开始的,实际上0会给到背景这一类别。

3.4 images字段

一个列表,元素个数等于图像数,列表中每个元素都是一个dict,对应一张图片的相关信息,包括图像名称、宽度、高度、id等信息,其中的id唯一地标识每一张图片。

json_labels['images']此时返回结果为:

[{'license': 1,

'file_name': 'COCO_val2014_000000556101.jpg',

'coco_url': 'http://images.cocodataset.org/val2014/COCO_val2014_000000556101.jpg',

'height': 640,

'width': 480,

'date_captured': '2013-11-16 15:42:33',

'flickr_url': 'http://farm8.staticflickr.com/7442/9281624471_f030c5331e_z.jpg',

'id': 556101},

......,

{'license': 1,

'file_name': 'COCO_val2014_000000281028.jpg',

'coco_url': 'http://images.cocodataset.org/val2014/COCO_val2014_000000281028.jpg',

'height': 480,

'width': 640,

'date_captured': '2013-11-17 04:16:09',

'flickr_url': 'http://farm4.staticflickr.com/3235/2888670184_48d33767a0_z.jpg',

'id': 281028}]

3.5 annotations字段

一个列表,元素个数等于数据集中所有标注的目标个数(一张图像可能有多个标注目标),列表中每个元素都是一个dict,对应一个目标的标注信息。包括:

segmentation:目标的分割点集(polygon多边形)

area:区域面积

image_id:该标注所在的图像id

iscrowd:0或1。一般情况下,0表示标注单个目标,此时segmentation使用polygon表示;1表示标注的是一组目标,此时segmentation使用RLE格式。

bbox:目标的矩形标注框,[x,y,width,height](左上角x,左上角y坐标,宽,高)

category_id:该标注的类别id

id:当前标注的id,每个id对应一个标注,一张图片上可能有多个目标标注

json_labels['annotations'][2]此时返回结果为:

{'segmentation': [[334.39,

383.8,

......

332.88,

376.99]],

'area': 1164.7766999999994,

'iscrowd': 0,

'image_id': 556101,

'bbox': [294.28, 339.54, 40.11, 59.4],

'category_id': 31,

'id': 1433627}

因为完整的COCO数据集比较大,后续使用COCO2014的子集作为例子。

官方有给出MS COCO数据集读取和操作的使用demo,参考GitHub:链接。

4.1 安装

Linux系统安装pycocotools:

pip install pycocotoolsWindows系统安装pycocotools:

pip install pycocotools-windows本人Windows系统,配置清华镜像源,安装pycocotools上述命令亲测好使。

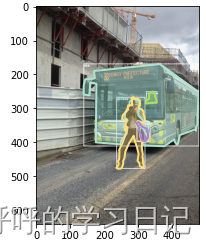

4.2 绘制annotation

from pycocotools.coco import COCO

from PIL import Image, ImageDraw

from matplotlib import pyplot as plt

anno_file = './data/annotations/instances_val2014.json'

# 加载coco标注文件

coco = COCO(anno_file)

# 获取所有图片的id

ids = list(coco.imgs.keys()) # 返回结果:[556101,509020,...]共497个元素

# print("number of images: {}".format(len(ids)))

# 获取目标类别,最终为一个字典:classs_dict={1: 'person',2: 'bicycle',...,90: 'toothbrush'}

classs_dict = {}

cat_ids = coco.loadCats(coco.getCatIds())

for cat in cat_ids:

classs_dict[cat["id"]] = cat["name"]

# 获取第一章图片的标注id

ann_ids = coco.getAnnIds(ids[0]) # 返回结果:[163368, 192442, 1433627, 1687504, 2210763],当前图片中所有标注的id值

# 根据annotation id获取所有目标的标注信息

anns = coco.loadAnns(ann_ids) # 返回结果:一个由5个字典组成的列表,每个字典是一个annotation

# 获取图片名称

path = coco.loadImgs(ids[0])[0]['file_name'] # 'COCO_val2014_000000556101.jpg'

# 获取图片

img = Image.open(os.path.join(img_path, path)).convert('RGB')

plt.imshow(img)

# 绘制annotation

coco.showAnns(anns)

#plt.show()

draw = ImageDraw.Draw(img)

# 绘制bbox

for ann in anns:

x, y, w, h = ann["bbox"]

x1, y1, x2, y2 = x, y, int(x + w), int(y + h)

draw.rectangle((x1, y1, x2, y2),width=2)

draw.text((x1, y1), classs_dict[ann["category_id"]])

# 展示图片

plt.imshow(img)

plt.show()此时返回结果:

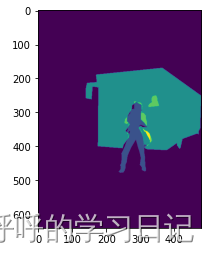

4.3 绘制mask

from pycocotools.coco import COCO

from PIL import Image, ImageDraw

from matplotlib import pyplot as plt

anno_file = './data/annotations/instances_val2014.json'

# 加载coco标注文件

coco = COCO(anno_file)

# 获取所有图片的id

ids = list(coco.imgs.keys()) # 返回结果:[556101,509020,...]共497个元素

# print("number of images: {}".format(len(ids)))

# 获取目标类别,最终为一个字典:classs_dict={1: 'person',2: 'bicycle',...,90: 'toothbrush'}

classs_dict = {}

cat_ids = coco.loadCats(coco.getCatIds())

for cat in cat_ids:

classs_dict[cat["id"]] = cat["name"]

# 获取第一章图片的标注id

ann_ids = coco.getAnnIds(ids[0]) # 返回结果:[163368, 192442, 1433627, 1687504, 2210763],当前图片中所有标注的id值

# 根据annotation id获取所有目标的标注信息

anns = coco.loadAnns(ann_ids) # 返回结果:一个由5个字典组成的列表,每个字典是一个annotation

# 获取图片名称

path = coco.loadImgs(ids[0])[0]['file_name'] # 'COCO_val2014_000000556101.jpg'

# 获取图片

img = Image.open(os.path.join(img_path, path)).convert('RGB')

mask = coco.annToMask(anns[0])

for i in range(len(anns)):

mask += coco.annToMask(anns[i])

# 展示图片

plt.imshow(img)

plt.imshow(mask)

plt.show()此时返回结果:

后续如有新增,会逐渐补充。

如果需要这个小小的COCO2014数据集,我想想办法嘿。

我主要使用Ruby来执行此操作,但到目前为止我的攻击计划如下:使用gemsrdf、rdf-rdfa和rdf-microdata或mida来解析给定任何URI的数据。我认为最好映射到像schema.org这样的统一模式,例如使用这个yaml文件,它试图描述数据词汇表和opengraph到schema.org之间的转换:#SchemaXtoschema.orgconversion#data-vocabularyDV:name:namestreet-address:streetAddressregion:addressRegionlocality:addressLocalityphoto:i

有时我需要处理键/值数据。我不喜欢使用数组,因为它们在大小上没有限制(很容易不小心添加超过2个项目,而且您最终需要稍后验证大小)。此外,0和1的索引变成了魔数(MagicNumber),并且在传达含义方面做得很差(“当我说0时,我的意思是head...”)。散列也不合适,因为可能会不小心添加额外的条目。我写了下面的类来解决这个问题:classPairattr_accessor:head,:taildefinitialize(h,t)@head,@tail=h,tendend它工作得很好并且解决了问题,但我很想知道:Ruby标准库是否已经带有这样一个类? 最佳

我正在尝试使用Curbgem执行以下POST以解析云curl-XPOST\-H"X-Parse-Application-Id:PARSE_APP_ID"\-H"X-Parse-REST-API-Key:PARSE_API_KEY"\-H"Content-Type:image/jpeg"\--data-binary'@myPicture.jpg'\https://api.parse.com/1/files/pic.jpg用这个:curl=Curl::Easy.new("https://api.parse.com/1/files/lion.jpg")curl.multipart_form_

无论您是想搭建桌面端、WEB端或者移动端APP应用,HOOPSPlatform组件都可以为您提供弹性的3D集成架构,同时,由工业领域3D技术专家组成的HOOPS技术团队也能为您提供技术支持服务。如果您的客户期望有一种在多个平台(桌面/WEB/APP,而且某些客户端是“瘦”客户端)快速、方便地将数据接入到3D应用系统的解决方案,并且当访问数据时,在各个平台上的性能和用户体验保持一致,HOOPSPlatform将帮助您完成。利用HOOPSPlatform,您可以开发在任何环境下的3D基础应用架构。HOOPSPlatform可以帮您打造3D创新型产品,HOOPSSDK包含的技术有:快速且准确的CAD

本教程将在Unity3D中混合Optitrack与数据手套的数据流,在人体运动的基础上,添加双手手指部分的运动。双手手背的角度仍由Optitrack提供,数据手套提供双手手指的角度。 01 客户端软件分别安装MotiveBody与MotionVenus并校准人体与数据手套。MotiveBodyMotionVenus数据手套使用、校准流程参照:https://gitee.com/foheart_1/foheart-h1-data-summary.git02 数据转发打开MotiveBody软件的Streaming,开始向Unity3D广播数据;MotionVenus中设置->选项选择Unit

文章目录一、概述简介原理模块二、配置Mysql使用版本环境要求1.操作系统2.mysql要求三、配置canal-server离线下载在线下载上传解压修改配置单机配置集群配置分库分表配置1.修改全局配置2.实例配置垂直分库水平分库3.修改group-instance.xml4.启动监听四、配置canal-adapter1修改启动配置2配置映射文件3启动ES数据同步查询所有订阅同步数据同步开关启动4.验证五、配置canal-admin一、概述简介canal是Alibaba旗下的一款开源项目,Java开发。基于数据库增量日志解析,提供增量数据订阅&消费。Git地址:https://github.co

我正在尝试在Rails上安装ruby,到目前为止一切都已安装,但是当我尝试使用rakedb:create创建数据库时,我收到一个奇怪的错误:dyld:lazysymbolbindingfailed:Symbolnotfound:_mysql_get_client_infoReferencedfrom:/Library/Ruby/Gems/1.8/gems/mysql2-0.3.11/lib/mysql2/mysql2.bundleExpectedin:flatnamespacedyld:Symbolnotfound:_mysql_get_client_infoReferencedf

文章目录1.开发板选择*用到的资源2.串口通信(个人理解)3.代码分析(注释比较详细)1.主函数2.串口1配置3.串口2配置以及中断函数4.注意问题5.源码链接1.开发板选择我用的是STM32F103RCT6的板子,不过代码大概在F103系列的板子上都可以运行,我试过在野火103的霸道板上也可以,主要看一下串口对应的引脚一不一样就行了,不一样的就更改一下。*用到的资源keil5软件这里用到了两个串口资源,采集数据一个,串口通信一个,板子对应引脚如下:串口1,TX:PA9,RX:PA10串口2,TX:PA2,RX:PA32.串口通信(个人理解)我就从串口采集传感器数据这个过程说一下我自己的理解,

SPI接收数据左移一位问题目录SPI接收数据左移一位问题一、问题描述二、问题分析三、探究原理四、经验总结最近在工作在学习调试SPI的过程中遇到一个问题——接收数据整体向左移了一位(1bit)。SPI数据收发是数据交换,因此接收数据时从第二个字节开始才是有效数据,也就是数据整体向右移一个字节(1byte)。请教前辈之后也没有得到解决,通过在网上查阅前人经验终于解决问题,所以写一个避坑经验总结。实际背景:MCU与一款芯片使用spi通信,MCU作为主机,芯片作为从机。这款芯片采用的是它规定的六线SPI,多了两根线:RDY和INT,这样从机就可以主动请求主机给主机发送数据了。一、问题描述根据从机芯片手

前言一般来说,前端根据后台返回code码展示对应内容只需要在前台判断code值展示对应的内容即可,但要是匹配的code码比较多或者多个页面用到时,为了便于后期维护,后台就会使用字典表让前端匹配,下面我将在微信小程序中通过wxs的方法实现这个操作。为什么要使用wxs?{{method(a,b)}}可以看到,上述代码是一个调用方法传值的操作,在vue中很常见,多用于数据之间的转换,但由于微信小程序诸多限制的原因,你并不能优雅的这样操作,可能有人会说,为什么不用if判断实现呢?但是if判断的局限性在于如果存在数据量过大时,大量重复性操作和if判断会让你的代码显得异常冗余。wxswxs相当于是一个独立