文章目录

前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。

贝叶斯分类器主要思想是基于贝叶斯定理,是机器学习中重要的分类算法,适用于高维度的大数据集,速度快,准确率高,一个经典的应用场景是识别垃圾邮件。

首先需要知道一些概率论的知识:

比如箱子里有4个小球,3个蓝色1个红色,且分别标有数字0和1:

那么我们很容易知道先验概率:

P(红)=

1

4

\frac{1}{4}

41,P(蓝)=

3

4

\frac{3}{4}

43

P(0)=

1

2

\frac{1}{2}

21,P(1)=

1

2

\frac{1}{2}

21

相应的条件概率:

P(1|蓝)=

2

3

\frac{2}{3}

32,P(0|蓝)=

1

3

\frac{1}{3}

31

P(1|红)=

0

0

0,P(0|红)=

1

1

1

比如P(1|蓝)表示抽中蓝色球的前提下,数字是1的概率。也就是3个蓝球中有两个为1。

往往困难的是后验概率的计算,比如知道结果是数字0,那导致结果(数字0)的条件(颜色)概率怎么计算?即P(蓝|0)和P(红|0)。

虽然这个例子的后验概率也能一眼看出,那假设不知道,又如何通过先验概率和条件概率进行求解呢?这就是贝叶斯定理解决的问题。

贝叶斯公式如下:

P

(

A

∣

B

)

=

P

(

A

)

P

(

B

∣

A

)

P

(

B

)

P(A|B)=\frac{P(A)~P(B|A)}{P(B)}

P(A∣B)=P(B)P(A) P(B∣A)

带入公式:

P

(

蓝

∣

0

)

=

P

(

蓝

)

P

(

0

∣

蓝

)

P

(

0

)

=

3

4

⋅

1

3

1

2

=

1

2

P(蓝|0)=\frac{P(蓝)P(0|蓝)}{P(0)}=\frac{\frac{3}{4}·\frac{1}{3}}{\frac{1}{2}}=\frac{1}{2}

P(蓝∣0)=P(0)P(蓝)P(0∣蓝)=2143⋅31=21

P

(

红

∣

0

)

=

P

(

红

)

P

(

0

∣

红

)

P

(

0

)

=

1

4

⋅

1

1

2

=

1

2

P(红|0)=\frac{P(红)P(0|红)}{P(0)}=\frac{\frac{1}{4}·1}{\frac{1}{2}}=\frac{1}{2}

P(红∣0)=P(0)P(红)P(0∣红)=2141⋅1=21

对应验证图中两个数字0的球中,1个蓝色,1个红色。

设特征向量 X \bold X X有 n n n个属性,即 X = { x 1 , x 2 , … , x n } \bold X=\{x_1,x_2,…,x_n\} X={x1,x2,…,xn},标签 Y Y Y有 K K K个类,记为 { C 1 , C 2 , … , C K } \{C_1,C_2,…,C_K\} {C1,C2,…,CK},在训练样本中用极大似然法统计频率,从而学习到先验分布 P ( Y = C k ) , ( k = 1 , 2 , . . . , K ) P(Y=C_k),(k=1,2,...,K) P(Y=Ck),(k=1,2,...,K),同样也可以学习到条件分布 P ( X = x ∣ Y = C k ) = P ( X 1 = x 1 , X 2 = x 2 , … , X n = x n ∣ Y = C k ) P(\bold X=\bold x|Y=C_k)=P(X_1=x_1,X_2=x_2,\dots,X_n=x_n|Y=C_k) P(X=x∣Y=Ck)=P(X1=x1,X2=x2,…,Xn=xn∣Y=Ck)。

对于新的测试数据

x

\bold x

x,利用贝叶斯公式,就可求得属于第

k

k

k个类别

C

k

C_k

Ck的概率:

P

(

Y

=

C

k

∣

X

=

x

)

=

P

(

Y

=

C

k

)

P

(

X

=

x

∣

Y

=

C

k

)

P

(

X

=

x

)

P(Y=C_k|\bold X=\bold x)=\frac{P(Y=C_k)~P(\bold X=\bold x|Y=C_k)}{P(\bold X=\bold x)}

P(Y=Ck∣X=x)=P(X=x)P(Y=Ck) P(X=x∣Y=Ck)

最后比较属于各个类别的概率 P ( Y = C k ∣ X = x ) , ( k = 1 , 2 , … , K ) P(Y=C_k|\bold X=\bold x),(k=1,2,\dots,K) P(Y=Ck∣X=x),(k=1,2,…,K),将概率最大的作为预测类别。

但是上述模型中存在一个头疼的问题: P ( X 1 = x 1 , X 2 = x 2 , … , X n = x n ∣ Y = C k ) P(X_1=x_1,X_2=x_2,\dots,X_n=x_n|Y=C_k) P(X1=x1,X2=x2,…,Xn=xn∣Y=Ck)很难求出,比如有50个特征,每个特征只有2个属性,那么特征排列组合得到的计算量都有 2 50 2^{50} 250这么大。

为此朴素贝叶斯(naive bayes)采用了“属性条件独立性假设”,也就是考虑特征属性的取值互不干扰,是独立的。如果X和Y是相互独立的,那么由条件独立公式:

P

(

X

,

Y

)

=

P

(

X

)

P

(

Y

)

P(X,Y)=P(X)P(Y)

P(X,Y)=P(X)P(Y),得到朴素贝叶斯模型:

P

(

Y

=

C

k

∣

X

=

x

)

=

P

(

Y

=

C

k

)

P

(

X

=

x

)

∏

i

=

1

n

P

(

X

i

=

x

i

∣

Y

=

C

k

)

P(Y=C_k|\bold X=\bold x)=\frac{P(Y=C_k)}{P(\bold X=\bold x)}\prod_{i=1}^nP(X_i=x_i|Y=C_k)

P(Y=Ck∣X=x)=P(X=x)P(Y=Ck)i=1∏nP(Xi=xi∣Y=Ck)

对于一个测试数据

x

\bold x

x,计算它在不同类别的概率,由于最后只需要比较大小,取概率最大的类,所以简化掉相同分母,得到表达式:

m

a

x

C

k

∈

C

P

(

Y

=

C

k

)

∏

P

(

X

i

=

x

i

∣

Y

=

C

k

)

\mathop{max}\limits_{C_k\in C}~P(Y=C_k)\prod P(X_i=x_i|Y=C_k)

Ck∈Cmax P(Y=Ck)∏P(Xi=xi∣Y=Ck)

最后,在计算先验概率时,需要考虑不同的分布假设,比如离散值和连续值的参数求解是不一样的。包括高斯朴素贝叶斯、多项式朴素贝叶斯和伯努利朴素贝叶斯三种。

高斯朴素贝叶斯的特征变量是连续型变量,样本符合高斯分布或正态分布。如人的身高。

使用正态分布的概率密度函数来算概率:

P

(

x

i

∣

y

)

=

1

2

π

σ

y

2

e

x

p

(

−

(

x

i

−

μ

y

)

2

2

σ

y

2

)

P(x_i|y)=\frac{1}{\sqrt{2\pi\sigma_y^2}}exp(-\frac{(x_i-\mu_y)^2}{2\sigma_y^2})

P(xi∣y)=2πσy21exp(−2σy2(xi−μy)2)

μ

y

\mu_y

μy表示类别为

y

y

y的样本中,特征

x

i

x_i

xi的均值;

σ

y

\sigma_y

σy表示类别为

y

y

y的样本中,特征

x

i

x_i

xi的标准差;

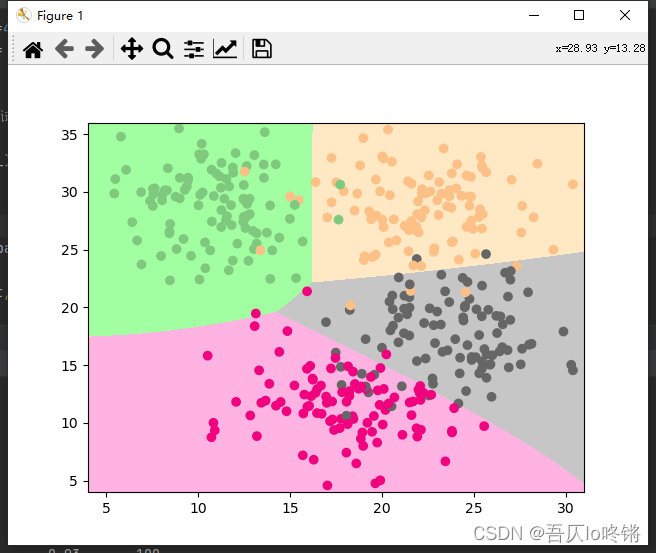

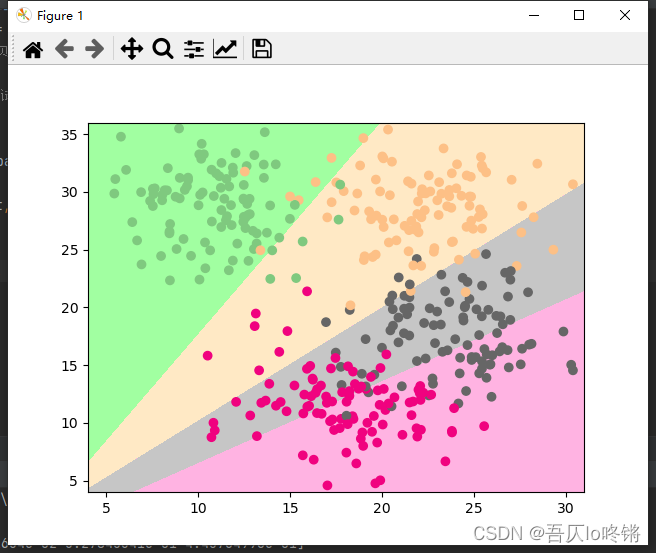

使用sklearn库中GaussianNB()创建高斯朴素贝叶斯模型:

import matplotlib.pyplot as plt

import numpy as np

import pandas as pd

from matplotlib.colors import ListedColormap

from sklearn.datasets import make_blobs

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import GaussianNB

from sklearn.metrics import classification_report

import seaborn as sns

def plot_boundary(model, axis): # 画边界

x0, x1 = np.meshgrid(

np.linspace(axis[0], axis[1], int((axis[1] - axis[0]) * 100)).reshape(-1, 1),

np.linspace(axis[2], axis[3], int((axis[3] - axis[2]) * 100)).reshape(-1, 1),

)

X_new = np.c_[x0.ravel(), x1.ravel()]

y_predict = model.predict(X_new)

zz = y_predict.reshape(x0.shape)

custom_cmap = ListedColormap(['#A1FFA1', '#FFE9C5', '#FFB3E2', '#C6C6C6'])

plt.contourf(x0, x1, zz, cmap=custom_cmap)

# 创建数据:400个样本,2个特征,4个类别,方差3

X, y = make_blobs(400, 2, centers=4, cluster_std=3, center_box=(10, 30), random_state=20221026)

x_train, x_test, y_train, y_test = train_test_split(X, y) # 划分训练集测试集

gnb = GaussianNB() # 高斯朴素贝叶斯

gnb.fit(x_train, y_train) # 训练

y_pred = gnb.predict(x_test) # 测试

# 结果和相关参数

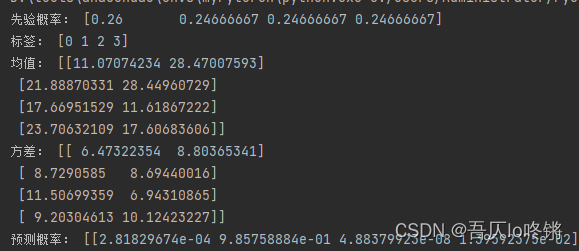

print('先验概率:', gnb.class_prior_)

print('标签:', gnb.classes_)

print('均值:', gnb.theta_)

print('方差:', gnb.sigma_)

print('预测概率:', gnb.predict_proba(x_test))

# 评估

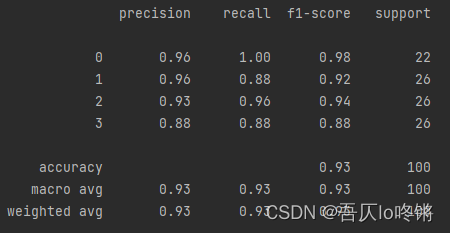

print(classification_report(y_test, y_pred))

# 可视化

plot_boundary(gnb, axis=[4, 31, 4, 36]) # 边界

plt.scatter(X[:, 0], X[:, 1], c=y, cmap='Accent') # 数据点

#cm = pd.crosstab(y_pred, y_test) # 混淆矩阵

#sns.heatmap(data=cm, annot=True, cmap='GnBu', fmt='d')

#plt.xlabel('Real')

#plt.ylabel('Predict')

plt.show()

多项式朴素贝叶斯的特征变量是离散型变量,样本符合多项分布。如掷色子。

特征值不能是负数。

P

(

x

i

∣

y

)

=

N

y

i

+

α

N

y

+

α

n

P(x_i|y)=\frac{N_{y_i}+\alpha}{N_y+\alpha n}

P(xi∣y)=Ny+αnNyi+α

α

\alpha

α表示平滑系数;

N

y

N_y

Ny表示属于类别

y

y

y所有的样本数;

N

y

i

N_{y_i}

Nyi表示第

i

i

i个特征中,属于类别

y

y

y的样本数;

n

n

n表示特征数量。

(

插播反爬信息)博主CSDN地址:https://wzlodq.blog.csdn.net/

使用sklearn库中MultinomialNB()创建多项式朴素贝叶斯模型:

import matplotlib.pyplot as plt

import numpy as np

import pandas as pd

from matplotlib.colors import ListedColormap

from sklearn.datasets import make_blobs

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import MultinomialNB

from sklearn.metrics import classification_report

import seaborn as sns

def plot_boundary(model, axis): # 画边界

x0, x1 = np.meshgrid(

np.linspace(axis[0], axis[1], int((axis[1] - axis[0]) * 100)).reshape(-1, 1),

np.linspace(axis[2], axis[3], int((axis[3] - axis[2]) * 100)).reshape(-1, 1),

)

X_new = np.c_[x0.ravel(), x1.ravel()]

y_predict = model.predict(X_new)

zz = y_predict.reshape(x0.shape)

custom_cmap = ListedColormap(['#A1FFA1', '#FFE9C5', '#FFB3E2', '#C6C6C6'])

plt.contourf(x0, x1, zz, cmap=custom_cmap)

# 创建数据:400个样本,2个特征,4个类别,方差3

X, y = make_blobs(400, 2, centers=4, cluster_std=3, center_box=(10, 30), random_state=20221026)

x_train, x_test, y_train, y_test = train_test_split(X, y) # 划分训练集测试集

mnb = MultinomialNB() # 多项式朴素贝叶斯

mnb.fit(x_train, y_train) # 训练

y_pred = mnb.predict(x_test) # 测试

# 结果和相关参数

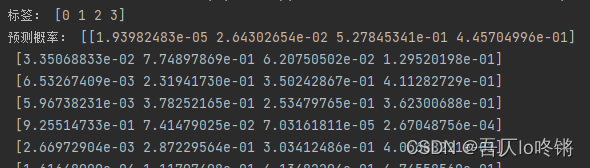

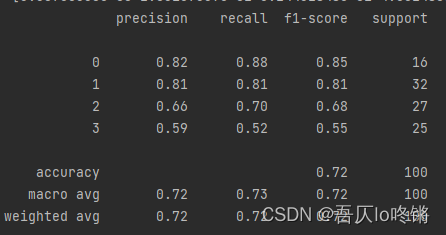

print('标签:', mnb.classes_)

print('预测概率:', mnb.predict_proba(x_test))

# 评估

print(classification_report(y_test, y_pred))

# 可视化

plot_boundary(mnb, axis=[4, 31, 4, 36]) # 边界

plt.scatter(X[:, 0], X[:, 1], c=y, cmap='Accent') # 数据点

#cm = pd.crosstab(y_pred, y_test) # 混淆矩阵

#sns.heatmap(data=cm, annot=True, cmap='GnBu', fmt='d')

#plt.xlabel('Real')

#plt.ylabel('Predict')

plt.show()

伯努利朴素贝叶斯的特征变量是布尔型变量,样本符合二项分布或0-1分布。如抛硬币、特征词是否在文本中出现。

特征值只有两个结果0和1,如果不是的话,需要进行二值化处理。

P

(

x

i

=

1

∣

y

)

=

N

y

i

+

α

N

y

+

2

α

P

(

x

i

=

0

∣

y

)

=

1

−

P

(

x

i

=

1

∣

y

)

P(x_i=1|y)=\frac{N_{y_i}+\alpha}{N_y+2\alpha}\\P(x_i=0|y)=1-P(x_i=1|y)

P(xi=1∣y)=Ny+2αNyi+αP(xi=0∣y)=1−P(xi=1∣y)

α

\alpha

α表示平滑系数;

N

y

N_y

Ny表示属于类别

y

y

y所有的样本数;

N

y

i

N_{y_i}

Nyi表示第

i

i

i个特征中,属于类别

y

y

y的样本数。

使用sklearn库中BernoulliNB()创建伯努利朴素贝叶斯模型。

由于特征属性要二值化处理,前面的数据不利于展示其特长,以文本分类为例介绍(涉及TF-IDF算法可参考我这篇博客)

import matplotlib.pyplot as plt

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import BernoulliNB

from sklearn.metrics import classification_report

import seaborn as sns

from sklearn.datasets import fetch_20newsgroups

from sklearn.feature_extraction.text import TfidfVectorizer

news = fetch_20newsgroups() # 读数据

x_train, x_test, y_train, y_test = train_test_split(news.data, news.target,) # 划分训练集测试集

transfer = TfidfVectorizer() # TF-IDF抽取文本特征

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

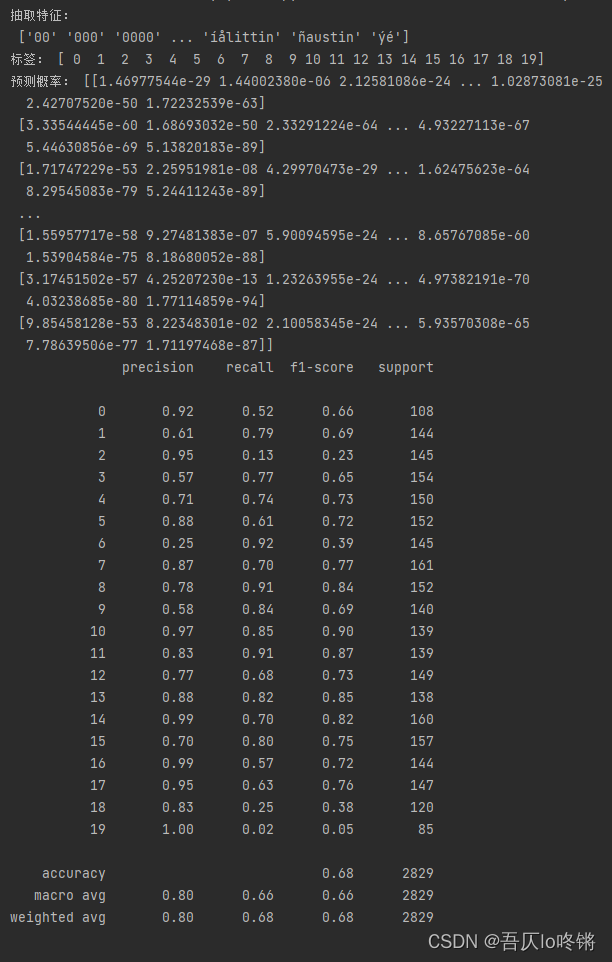

print("抽取特征:\n", transfer.get_feature_names_out())

bnb = BernoulliNB() # 伯努利朴素贝叶斯

bnb.fit(x_train, y_train) # 训练

y_pred = bnb.predict(x_test) # 测试

# 结果和相关参数

print('标签:', bnb.classes_)

print('预测概率:', bnb.predict_proba(x_test))

# 评估

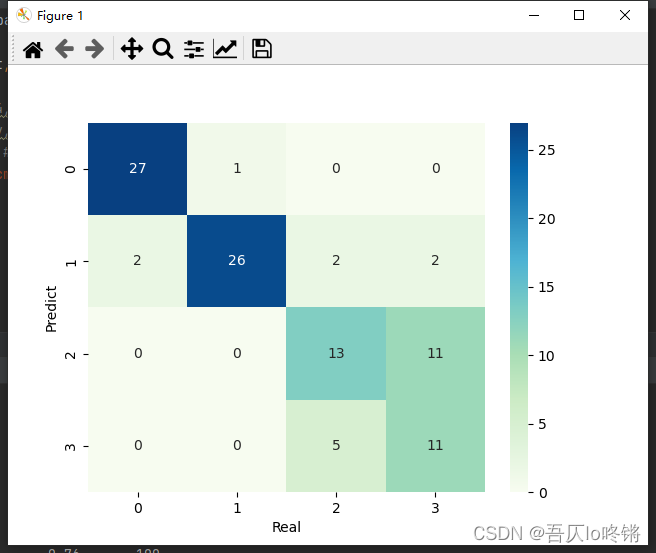

print(classification_report(y_test, y_pred))

# 可视化

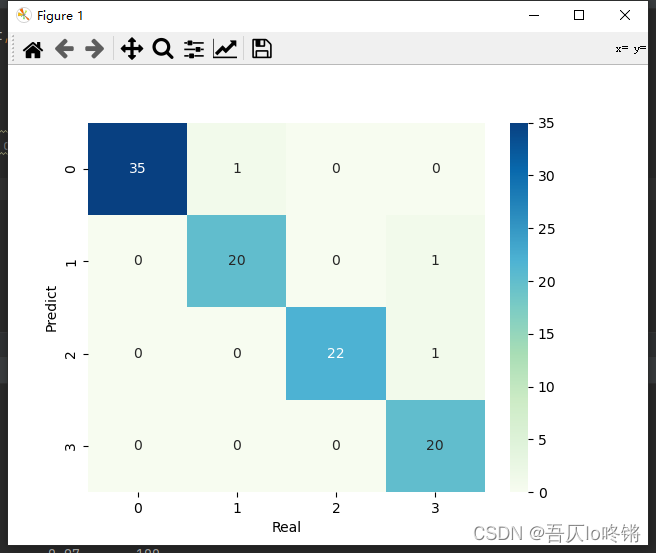

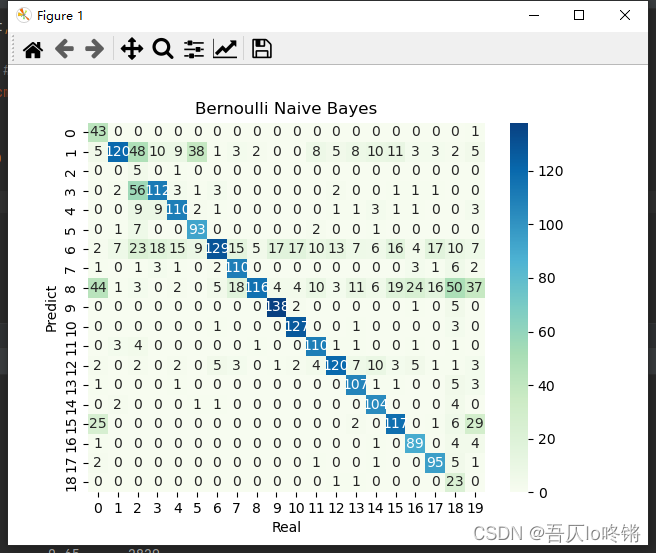

cm = pd.crosstab(y_pred, y_test) # 混淆矩阵

sns.heatmap(data=cm, annot=True, cmap='GnBu', fmt='d')

plt.xlabel('Real')

plt.ylabel('Predict')

plt.title('Bernoulli Naive Bayes')

plt.show()

也可以用多项式朴素贝叶斯,都是离散值。

高斯NB用于连续值;多项式NB用于离散的多值;伯努利NB用于离散的二值。

贝叶斯分类器先对联合概率P(X|Y)建模,然后再由此得到P(Y|X),属于「生成式模型」。而通过训练属性X直接建模P(Y|X)的模型成为「判别式模型」,如支持向量机、决策树、感知机等都是判别式模型。

本文介绍了贝叶斯分类器中最常用的朴素贝叶斯,更多的,还有半朴素贝叶斯、贝叶斯网等,感兴趣可深究。

原创不易,请勿转载(

本不富裕的访问量雪上加霜)

博主首页:https://wzlodq.blog.csdn.net/

来都来了,不评论两句吗👀

如果文章对你有帮助,记得一键三连❤

这似乎非常适得其反,因为太多的gem会在window上破裂。我一直在处理很多mysql和ruby-mysqlgem问题(gem本身发生段错误,一个名为UnixSocket的类显然在Windows机器上不能正常工作,等等)。我只是在浪费时间吗?我应该转向不同的脚本语言吗? 最佳答案 我在Windows上使用Ruby的经验很少,但是当我开始使用Ruby时,我是在Windows上,我的总体印象是它不是Windows原生系统。因此,在主要使用Windows多年之后,开始使用Ruby促使我切换回原来的系统Unix,这次是Linux。Rub

目录前言滤波电路科普主要分类实际情况单位的概念常用评价参数函数型滤波器简单分析滤波电路构成低通滤波器RC低通滤波器RL低通滤波器高通滤波器RC高通滤波器RL高通滤波器部分摘自《LC滤波器设计与制作》,侵权删。前言最近需要学习放大电路和滤波电路,但是由于只在之前做音乐频谱分析仪的时候简单了解过一点点运放,所以也是相当从零开始学习了。滤波电路科普主要分类滤波器:主要是从不同频率的成分中提取出特定频率的信号。有源滤波器:由RC元件与运算放大器组成的滤波器。可滤除某一次或多次谐波,最普通易于采用的无源滤波器结构是将电感与电容串联,可对主要次谐波(3、5、7)构成低阻抗旁路。无源滤波器:无源滤波器,又称

最近在学习CAN,记录一下,也供大家参考交流。推荐几个我觉得很好的CAN学习,本文也是在看了他们的好文之后做的笔记首先是瑞萨的CAN入门,真的通透;秀!靠这篇我竟然2天理解了CAN协议!实战STM32F4CAN!原文链接:https://blog.csdn.net/XiaoXiaoPengBo/article/details/116206252CAN详解(小白教程)原文链接:https://blog.csdn.net/xwwwj/article/details/105372234一篇易懂的CAN通讯协议指南1一篇易懂的CAN通讯协议指南1-知乎(zhihu.com)视频推荐CAN总线个人知识总

深度学习部署:Windows安装pycocotools报错解决方法1.pycocotools库的简介2.pycocotools安装的坑3.解决办法更多Ai资讯:公主号AiCharm本系列是作者在跑一些深度学习实例时,遇到的各种各样的问题及解决办法,希望能够帮助到大家。ERROR:Commanderroredoutwithexitstatus1:'D:\Anaconda3\python.exe'-u-c'importsys,setuptools,tokenize;sys.argv[0]='"'"'C:\\Users\\46653\\AppData\\Local\\Temp\\pip-instal

require"socket"server="irc.rizon.net"port="6667"nick="RubyIRCBot"channel="#0x40"s=TCPSocket.open(server,port)s.print("USERTesting",0)s.print("NICK#{nick}",0)s.print("JOIN#{channel}",0)这个IRC机器人没有连接到IRC服务器,我做错了什么? 最佳答案 失败并显示此消息::irc.shakeababy.net461*USER:Notenoughparame

我完全不是程序员,正在学习使用Ruby和Rails框架进行编程。我目前正在使用Ruby1.8.7和Rails3.0.3,但我想知道我是否应该升级到Ruby1.9,因为我真的没有任何升级的“遗留”成本。缺点是什么?我是否会遇到与普通gem的兼容性问题,或者甚至其他我不太了解甚至无法预料的问题? 最佳答案 你应该升级。不要坚持从1.8.7开始。如果您发现不支持1.9.2的gem,请避免使用它们(因为它们很可能不被维护)。如果您对gem是否兼容1.9.2有任何疑问,您可以在以下位置查看:http://www.railsplugins.or

如何学习ruby的正则表达式?(对于假人) 最佳答案 http://www.rubular.com/在Ruby中使用正则表达式时是一个很棒的工具,因为它可以立即将结果可视化。 关于ruby-我如何学习ruby的正则表达式?,我们在StackOverflow上找到一个类似的问题: https://stackoverflow.com/questions/1881231/

深度学习12.CNN经典网络VGG16一、简介1.VGG来源2.VGG分类3.不同模型的参数数量4.3x3卷积核的好处5.关于学习率调度6.批归一化二、VGG16层分析1.层划分2.参数展开过程图解3.参数传递示例4.VGG16各层参数数量三、代码分析1.VGG16模型定义2.训练3.测试一、简介1.VGG来源VGG(VisualGeometryGroup)是一个视觉几何组在2014年提出的深度卷积神经网络架构。VGG在2014年ImageNet图像分类竞赛亚军,定位竞赛冠军;VGG网络采用连续的小卷积核(3x3)和池化层构建深度神经网络,网络深度可以达到16层或19层,其中VGG16和VGG

文章目录1、自相关函数ACF2、偏自相关函数PACF3、ARIMA(p,d,q)的阶数判断4、代码实现1、引入所需依赖2、数据读取与处理3、一阶差分与绘图4、ACF5、PACF1、自相关函数ACF自相关函数反映了同一序列在不同时序的取值之间的相关性。公式:ACF(k)=ρk=Cov(yt,yt−k)Var(yt)ACF(k)=\rho_{k}=\frac{Cov(y_{t},y_{t-k})}{Var(y_{t})}ACF(k)=ρk=Var(yt)Cov(yt,yt−k)其中分子用于求协方差矩阵,分母用于计算样本方差。求出的ACF值为[-1,1]。但对于一个平稳的AR模型,求出其滞

目录0专栏介绍1平面2R机器人概述2运动学建模2.1正运动学模型2.2逆运动学模型2.3机器人运动学仿真3动力学建模3.1计算动能3.2势能计算与动力学方程3.3动力学仿真0专栏介绍?附C++/Python/Matlab全套代码?课程设计、毕业设计、创新竞赛必备!详细介绍全局规划(图搜索、采样法、智能算法等);局部规划(DWA、APF等);曲线优化(贝塞尔曲线、B样条曲线等)。?详情:图解自动驾驶中的运动规划(MotionPlanning),附几十种规划算法1平面2R机器人概述如图1所示为本文的研究本体——平面2R机器人。对参数进行如下定义:机器人广义坐标